はじめに

本日、Difyは新機能「ナレッジパイプライン(Knowledge Pipeline)」を正式リリースしました。これは、煩雑な企業データをLLM向けの高品質なコンテキストへと変換する、オーケストレーション可能、拡張可能、そして可観測性を備えたRAGデータ処理パイプラインです。

多くの企業において、AI導入の真のボトルネックはモデルそのものではなく、「コンテキストエンジニアリング」にあります。重要な企業データの大部分は、PDF、PPT、Excel、画像、HTMLなど、さまざまな非構造化ファイルに閉じ込められています。

分散し、形式が異なり、絶えず更新される膨大な内部データを、LLMが確実に利用できる高品質なコンテキストへと安定的に変換すること——これは単純なデータインポート作業ではありません。体系的な設計、継続的なチューニング、そして可観測性を必要とする高度なエンジニアリングプロセスなのです。

従来のRAGが直面する3つの課題

エンタープライズグレードのデータに対して、従来のRAGシステムは以下の問題により、回答品質にばらつきが生じていました

1. データソースの分断

企業データはERP、Wiki、メール、クラウドストレージなど数十のシステムに分散しています。各システムは独自の認証方式とデータ形式を持ち、個別対応のコストは膨大です。

2. 異種データの解析困難

ドキュメントや表は解析後に順序のないテキストになり、グラフや数式などのマルチモーダルコンテンツは失われます。機械的なチャンキングは文書の論理構造を破壊し、LLMは不完全な情報断片から回答を生成せざるを得ません。

3. 処理プロセスのブラックボックス化

データ処理の各段階が不可視で、解析エラー、チャンキング異常、ベクトル化の失敗のいずれが原因なのか特定できません。エラーの再現も困難で、盲目的なデバッグを強いられます。

そこで私たちは、コンテキストエンジニアリングのための重要なデータ処理基盤としてナレッジパイプラインを開発しました。可視化され、オーケストレーション可能なパイプラインを通じて、企業は原始データから高品質なコンテキストへの変換プロセス全体を真にコントロールできるようになります。

可視化・オーケストレーション可能なナレッジパイプライン

ナレッジパイプラインは、Difyのワークフローが持つキャンバスベースの直感的な操作性を継承し、RAGにおけるETL(Extract, Transform, Load)プロセスを完全に可視化します。データソースへの接続、ドキュメントの解析、チャンキング戦略の適用といった各処理ステップが独立したノードとして表現されます。

これにより、テキスト、画像、表、スキャンされたドキュメントなど、多様なモーダルのデータに対応する最適なプラグインを各ステップで選択できます。DifyのMarketplaceが提供する豊富なプラグインエコシステムを活用し、開発チームはまるでレゴブロックを組み合わせるように、業界やデータ形式に特化したデータ処理パイプラインを自由に構築できます。

必要に応じて、ワークフローのロジックノード、コードノード、LLMノードなどを処理パイプラインに組み込むことも可能です。大規模言語モデルを用いてコンテキストを強化したり、カスタムコードで特定のルールに基づいたデータクレンジングを行ったりと、真に柔軟なデータ処理のカスタマイズが実現します。

主要機能

1. エンタープライズグレードのデータソース統合

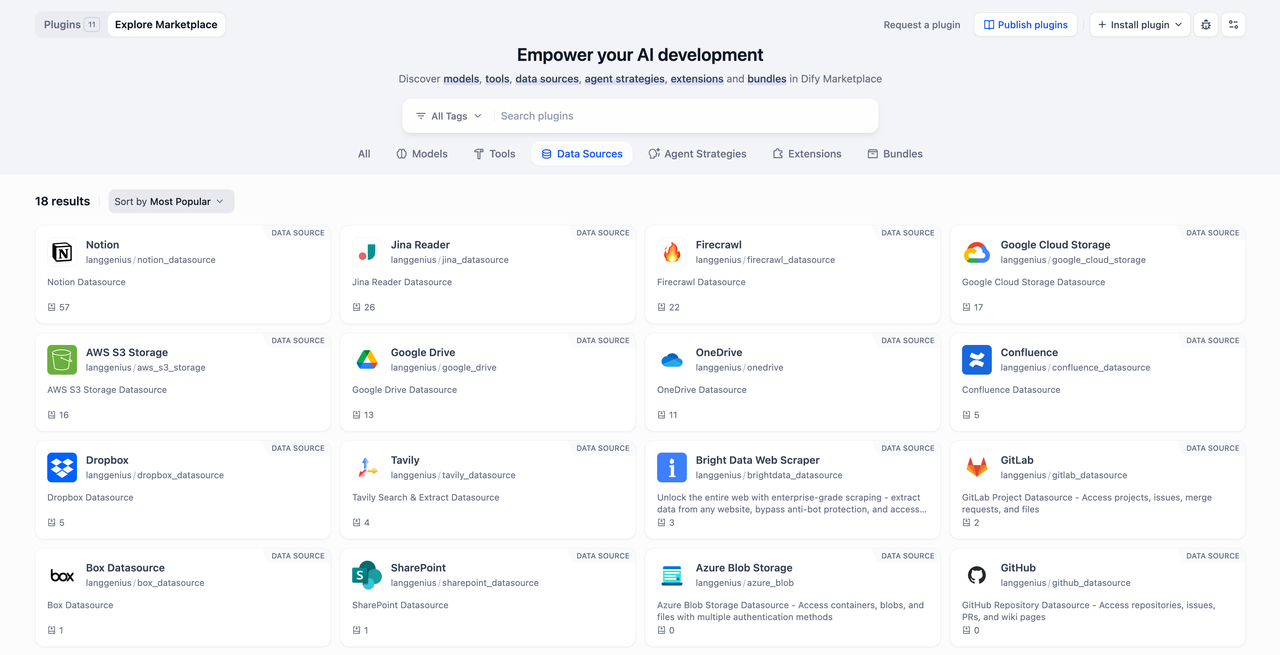

従来のデータソースの制限を打破するため、私たちは全く新しい「データソース・プラグイン」を導入しました。このプラグインアーキテクチャにより、各ナレッジベースは複数の非構造化データソースに同時に接続できます。これまでデータソースごとにカスタムコードを記述し、認証ロジックを維持する必要がありましたが、今ではMarketplaceからプラグインをワンクリックで導入するだけで接続が完了します。

また、標準インターフェースに基づいて独自のデータソース・プラグインを開発し、特定の内部システムや専有プラットフォームに連携させることも可能です。

対応済みの主要データソース:

- ローカルファイル: PDF, Word, Excel, PPT, Markdownなど30種類以上のフォーマット

- クラウドストレージ: Google Drive, AWS S3, Azure Blob, Box, OneDrive, Dropboxなど

- オンラインドキュメント: Notion, Confluence, SharePoint, GitLab, GitHubなど

- Webクローリング: Firecrawl, Jina, Bright Data, Tavilyなどのサービス

2. プラガブルなデータ処理パイプライン

データ処理プロセスの透明性と拡張性を高めるため、ナレッジパイプラインはデータ処理の各工程を標準化されたノードに分割しています。これにより、シナリオに応じて各ステップのプラグインを自由に変更できます。

-

Extract (データ抽出):

上述の多様なデータソースから並行してデータを取り込み、テキスト、画像、音声・動画といったマルチモーダルなコンテンツを統一的に扱います。後続のノードは、異なるデータソースの出力タイプ(ファイルオブジェクトやページコンテンツなど)に応じて、自動的に処理戦略を適応させます。 -

Transform (データ加工):

パイプラインの中核を担う部分で、主に4つのステップで構成されます。- 解析 (Parse): ファイルタイプに応じて最適なパーサーを選択し、テキストと構造化されたメタデータを抽出します。スキャンされた書類のOCR、表の復元、PowerPointのテキストボックスの順序整理など、特殊なケースにも複数のパーサーを並列実行させることで情報損失を防ぎます。

- 強化 (Enrich): LLMや他のロジックノードを利用して、エンティティ抽出、要約生成、タグ分類、機密情報のマスキングなどを行い、コンテンツの品質を向上させます。

- チャンキング (Chunking): 現在、「General(汎用)」「Parent-Child(精度とコンテキストのバランス)」「Q&A(構造化された質疑応答)」の3つの戦略を提供し、様々なドキュメントタイプに対応します。

- ベクトル化 (Embedding): コスト、言語、次元数などの要件に応じて、異なるプロバイダーのEmbeddingモデルを柔軟に選択・切り替えできます。

-

Load (インデックス保存):

処理済みのベクトルとメタデータをナレッジベースに書き込み、効率的なインデックスを構築します。高品質なベクトルインデックスと経済的な転置インデックスをサポートし、メタデータタグを用いた正確なフィルタリングや権限制御も設定可能です。

データ処理完了後、検索システムはベクトル検索、全文検索、またはハイブリッド検索戦略をサポートします。メタデータフィルタリングと関連性のリランキングにより、原文の引用を含む正確な結果を出力できます。最終的にLLMが情報を整理・出力し、テキストと画像の混在表示をサポートすることで、検索精度とユーザー体験を向上させます。

3. 可観測性を備えたデバッグプロセス

従来のデータ処理フローはブラックボックスのように中間プロセスを観察できず、問題の特定が困難でした。ナレッジパイプラインでは、この課題を完全に解決します。

- テスト実行 (Test Run): パイプライン全体をノードごとに実行し、各ステップの入力と出力が期待通りかを確認できます。

- 変数インスペクター (Variable Inspect): パイプライン内の任意の中間変数やコンテキストの状態をリアルタイムで観測し、解析エラー、チャンキングの異常、メタデータの欠落といった問題を素早く特定できます。

デバッグが完了したら、ワンクリックでパイプラインを利用可能状態に公開し、標準化されたデータ処理を開始できます。

より詳しい操作手順については、公式ドキュメントをご参照ください。

4. 豊富なシナリオに対応する内蔵テンプレート

迅速な開発を支援するため、多様なニーズに応える7種類のプリセットテンプレートを提供しています。

- 一般文書処理 - General Mode (ECO): ドキュメントを汎用段落ブロックに分割し、経済的なインデックスを採用。大量のドキュメントの高速処理に適しています。

- 長文書処理 - Parent-Child (HQ):親子階層型チャンキング戦略を採用。具体的なコンテンツを正確に特定しながら、完全なコンテキストを保持。技術文書や研究レポートなどの長編資料に最適です。

- 表データQ&A抽出 - Simple Q&A:表から指定列を抽出して構造化された質問応答ペアを生成。自然言語でのデータ検索を可能にします。

- インテリジェントQ&A生成 - LLM Generated Q&A: ドキュメントから重要情報を自動抽出して質問応答ペアを生成し、長文ドキュメントを正確な知識ポイントに変換します。

- 文書形式変換 - Convert to Markdown:Office形式のファイルをMarkdownに変換し、処理効率と互換性を向上させます。

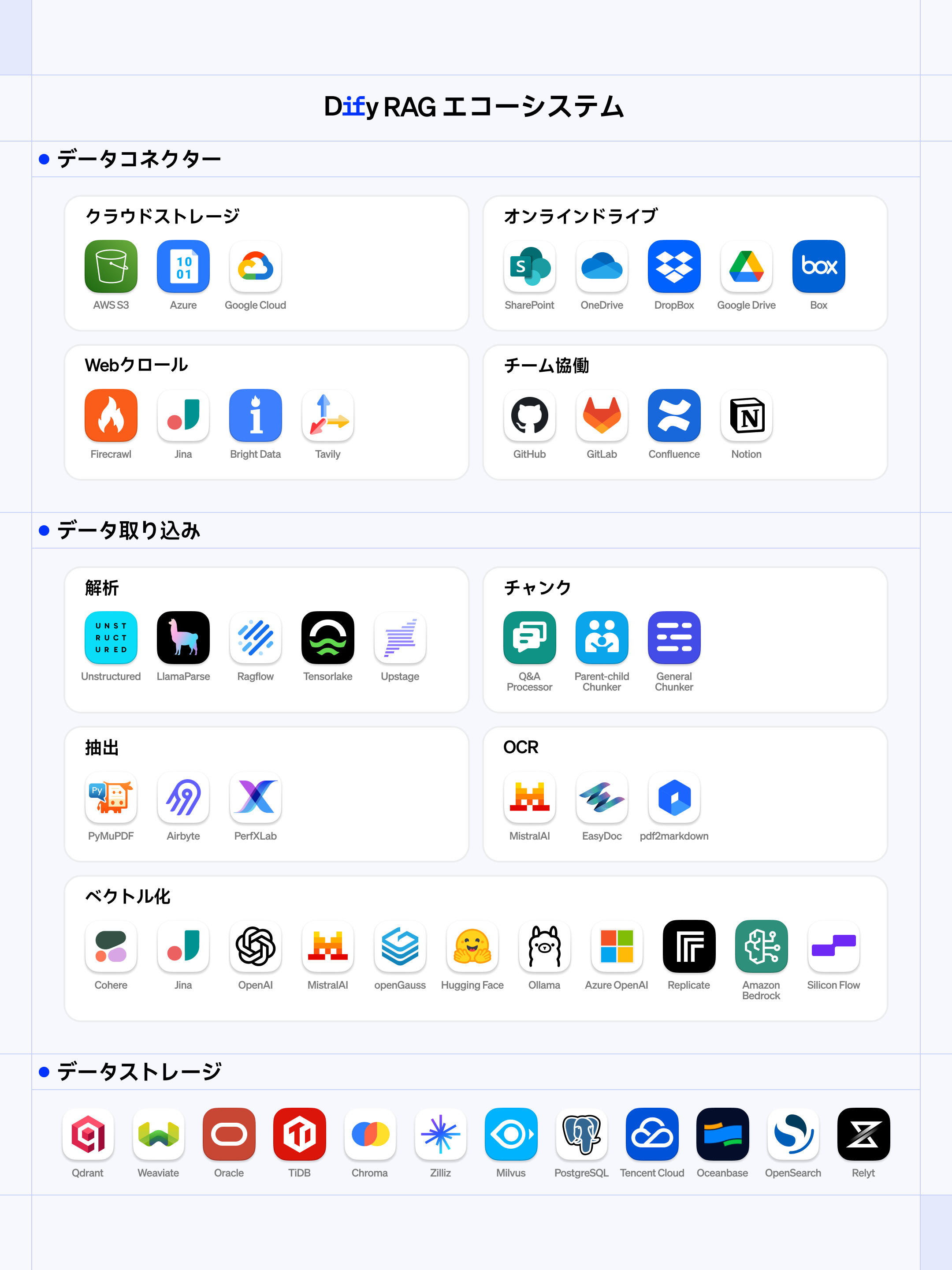

RAGプラグインエコシステム

Difyは、公式、パートナー、そしてコミュニティの貢献を結集した、オープンで活発なプラグインエコシステムを構築しています。ナレッジパイプラインはプラグインアーキテクチャに基づき、企業は自身のニーズに合わせてデータ処理ツールを柔軟に選択できるようにします。

- Connector: Google Drive、Notion、Confluenceなど、数十種類のデータソースに接続します。

- Ingestion: LlamaParse、Unstructured、各種OCRツールなど、専門的な解析ツールを選択します。

- Storage: Qdrant、Weaviate、Milvus、Oracleなど主要なベクトルデータベースと連携し、エンタープライズ版およびオープンソース版のカスタム設定をサポートします。

なぜナレッジパイプラインを選ぶのか

ナレッジパイプラインは、コンテキストエンジニアリングを実践するための重要な基盤です。企業の非構造化データを高品質なコンテキストに変換することで、後続の検索、推論、そしてアプリケーション全体の質を飛躍的に向上させます。

この基盤がもたらす3つの核心的価値は以下の通りです。

-

ビジネスニーズとデータエンジニアリングの橋渡し

ナレッジパイプラインにより、ビジネスチームもAIシステムの最適化に参加できます。可視化された編集とリアルタイムデバッグを通じて、ビジネスエキスパートはデータがどのように処理されるかを直接確認し、検索プロセスの問題点を特定できます。技術チームとの繰り返しのコミュニケーションが不要になり、技術チームはビジネス成長に直結するコア業務に集中できます。 -

開発・保守コストの削減

従来のRAGプロジェクトは多くが一度限りの納品で、シナリオごとに重複して構築されていました。Dify ナレッジパイプラインはデータ処理プロセスを再利用可能なアセット(資産)へと変えます。契約レビュー、カスタマーサポートナレッジベース、技術文書の処理などをテンプレート化し、チーム間で複製・調整することで、重複開発と後期保守を大幅に削減します。 -

世界トップクラスのRAGソリューションの統合

完全な内製化か、単一ベンダーへの依存か、という二者択一に悩む必要はもうありません。OCR、ドキュメント解析、構造化データ抽出、ベクトルストア、リランキングといった各コンポーネントを、必要に応じていつでも市場で最高のソリューションに置き換えることができます。これにより、全体のアーキテクチャを安定させつつ、常に最先端の技術を取り入れることが可能です。

今後の展望

最新バージョンでは、ワークフローエンジンのバックエンドをキューベースのグラフ実行モデルへと再構築しました。この新エンジンは、複雑な並列処理シナリオにおける既存アーキテクチャの制限を取り除き、より柔軟なノード接続と実行制御を実現します。具体的には、パイプラインの任意のノードからの実行開始や、中間ノードでの一時停止・再開をサポートし、将来的なブレークポイントデバッグ、Human-In-The-Loop、トリガーベースの実行といった高度な機能の基盤を築いています。

エンタープライズグレードのナレッジパイプライン編成を今すぐ始めましょう。