はじめに

2026年3月9日(月)、Anthropic は Claude Code に「Code Review」という新機能を発表しました。

これは GitHub のプルリクエスト(PR)が作成されるたびに、

複数のAIエージェントがチームを組んでバグを自動検出するマルチエージェント型のコードレビューシステムです。

Anthropic 社内でほぼすべてのPRに対して運用されてきた仕組みを製品化したもので、現在はリサーチプレビュー(ベータ版)として Claude for Teams / Enterprise プランのユーザーに提供されています。

この記事では、この新機能を初心者にもわかりやすくまとめます。

参考(公式ブログ):

**参考(公式ドキュメント):

お知らせ(採用情報)

AppTime では一緒に働くメンバーを募集しております。

詳しくは採用情報ページをご確認ください。

みなさまからのご応募をお待ちしております。

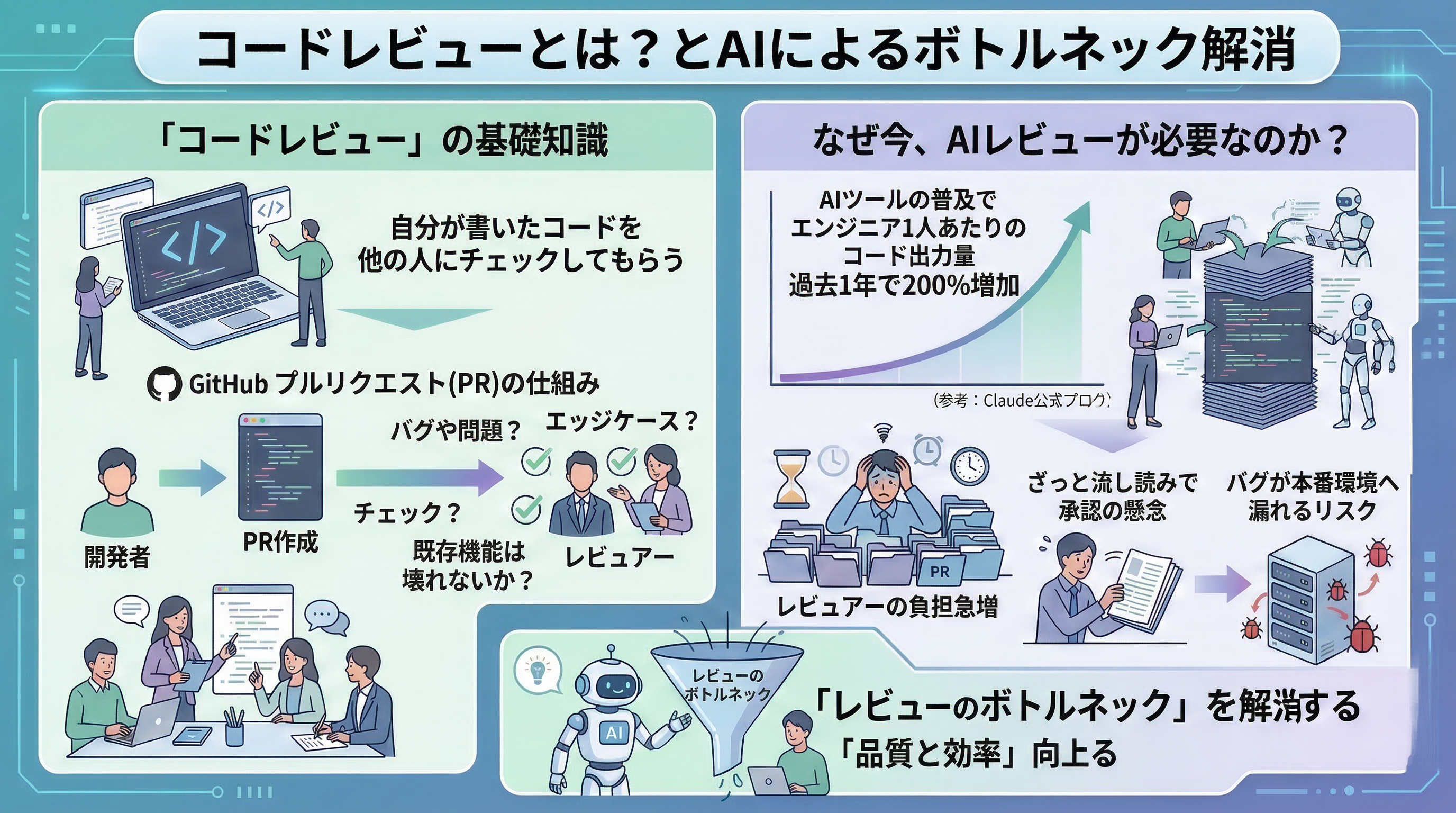

そもそも「コードレビュー」って何?

コードレビューとは、自分が書いたコードを他の人に見てもらい、

バグや問題がないかチェックしてもらう工程のことです。

GitHub を使ったチーム開発では、プルリクエスト(PR) という仕組みを通じて

レビューが行われます。

たとえば新しい画面を追加したり、状態管理ロジックを変更したりした際、

チームメンバーが「この変更で既存機能が壊れないか」「エッジケースは考慮されているか」を確認します。

なぜ今、AIレビューが必要なのか

Anthropic の公式ブログによると、AIコーディングツールの普及でエンジニア一人あたりのコード出力量が過去1年で200%増加しました

(参考:Claude公式ブログ)。

コードが増えればレビューすべきPRも増え、レビュアーの負担は急増します。

その結果、多くのPRが「ざっと流し読み」で承認されてしまい、本来見つけるべきバグが本番環境に漏れるリスクが高まっていました。Code Review はこの**「レビューのボトルネック」を解消する**ために生まれた機能です。

参考: TechCrunch の報道では、Anthropic のプロダクト責任者 Cat Wu 氏が「Claude Code でコードを書くエンジニアが増えるほど、新機能を作るハードルは下がり、コードレビューの需要が急増している」と述べています(参考:TechCrunch)。

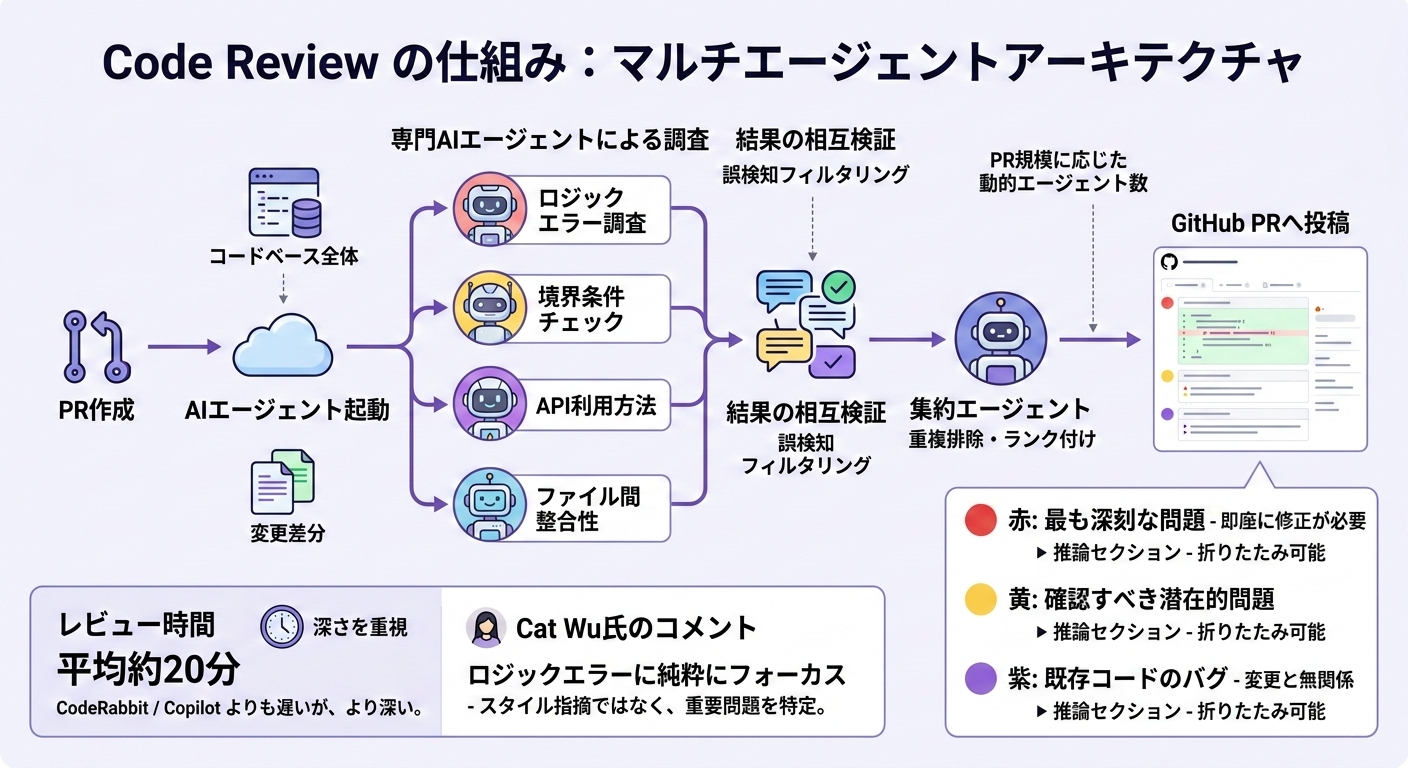

Code Review の仕組み:マルチエージェントアーキテクチャ

Code Review の最大の特徴は、マルチエージェントアーキテクチャと呼ばれる設計です。1つのAIがレビューするのではなく、複数の専門的なAIエージェントがチームとして並列に動きます。

レビューの流れ

PRが作成される

↓

複数のAIエージェントがクラウド上で起動

↓

各エージェントが異なる観点(ロジックエラー、境界条件、API使い方、ファイル間整合性等)でコードを調査

↓

変更差分だけでなく、リポジトリ全体のコードベースも参照

↓

見つかった問題を互いに検証(誤検知をフィルタリング)

↓

集約エージェントが重複を排除し、重要度順にランク付け

↓

GitHub のPR上にインラインコメントとして結果を投稿

PRの規模に応じて投入されるエージェント数も動的に変わります。大規模で複雑なPRにはより多くのエージェントが割り当てられ、小さな修正には軽量なパスで対応されます。

レビュー時間は平均約20分

gihyo.jp の報道によると、レビュー時間は平均約20分とのことです(参考:gihyo.jp)。CodeRabbit や GitHub Copilot のほぼ即時のフィードバックと比べると遅いですが、その分**「深さ」を重視**した設計になっています。

Cat Wu 氏は「私たちはロジックエラーに純粋にフォーカスすることを決めました。スタイルの指摘ではなく、最も優先度の高い修正すべき問題を捕まえます」と説明しています

参考:

レビュー結果の見え方

レビュー結果は GitHub のPR上に、全体の概要コメントと問題箇所へのインラインコメントとして投稿されます。各コメントには以下が含まれます。

- 🔴 赤:最も深刻な問題(即座に修正が必要)

- 🟡 黄:確認すべき潜在的問題

- 🟣 紫:変更とは関係のない既存コードに潜んでいたバグ

各コメントには折りたたみ可能な推論セクションがあり、なぜその問題がフラグされたのか、どのように検証されたのかを確認できます(参考:Claude Code Docs)。

驚きの検出精度:Anthropic 社内での実績データ

Anthropic はこの機能を数ヶ月間にわたり社内で運用してきたデータを公開しています(参考:Claude公式ブログ、gihyo.jp)。

| 指標 | 数値 |

|---|---|

| 大規模PR(1,000行以上)でバグが見つかる割合 | 84%(平均 7.5 件の問題を検出) |

| 小規模PR(50行未満)でコメントがつく割合 | 31%(平均 0.5 件) |

| エンジニアが「誤検知」と判断した割合 | 1%未満 |

| 実質的なレビューコメントがつくPRの割合(導入前→導入後) | 16% → 54% |

注目すべき実例

実例1:認証を破壊する1行変更を検出(Anthropic社内)

本番サービスへの1行だけの変更がルーティンに見えたものの、Code Review が認証メカニズムを破壊する重大な問題としてフラグを立てました。担当エンジニアは「自分では気づけなかっただろう」と述べています(参考:

実例2:TrueNAS の暗号鍵キャッシュバグを発見(顧客事例)

オープンソースストレージソフト TrueNAS の ZFS 暗号化リファクタリング中に、変更箇所とは別の既存コードに潜んでいた型不一致のバグ(暗号鍵キャッシュが毎回消去される問題) を発見しました。これはPRの差分をスキャンしている人間のレビュアーでは見つけにくい種類のバグです

参考:

誤検知率に関する注意点

VentureBeat は1%未満という誤検知率について重要な注意を指摘しています。

この数値は「エンジニアが能動的に"間違い"とマークした」割合であり、時間に追われた開発者が無関係なコメントを単に無視した場合はカウントされないため、

実際の誤検知率はこれより高い可能性があるとしています

(参考:[VentureBeat]

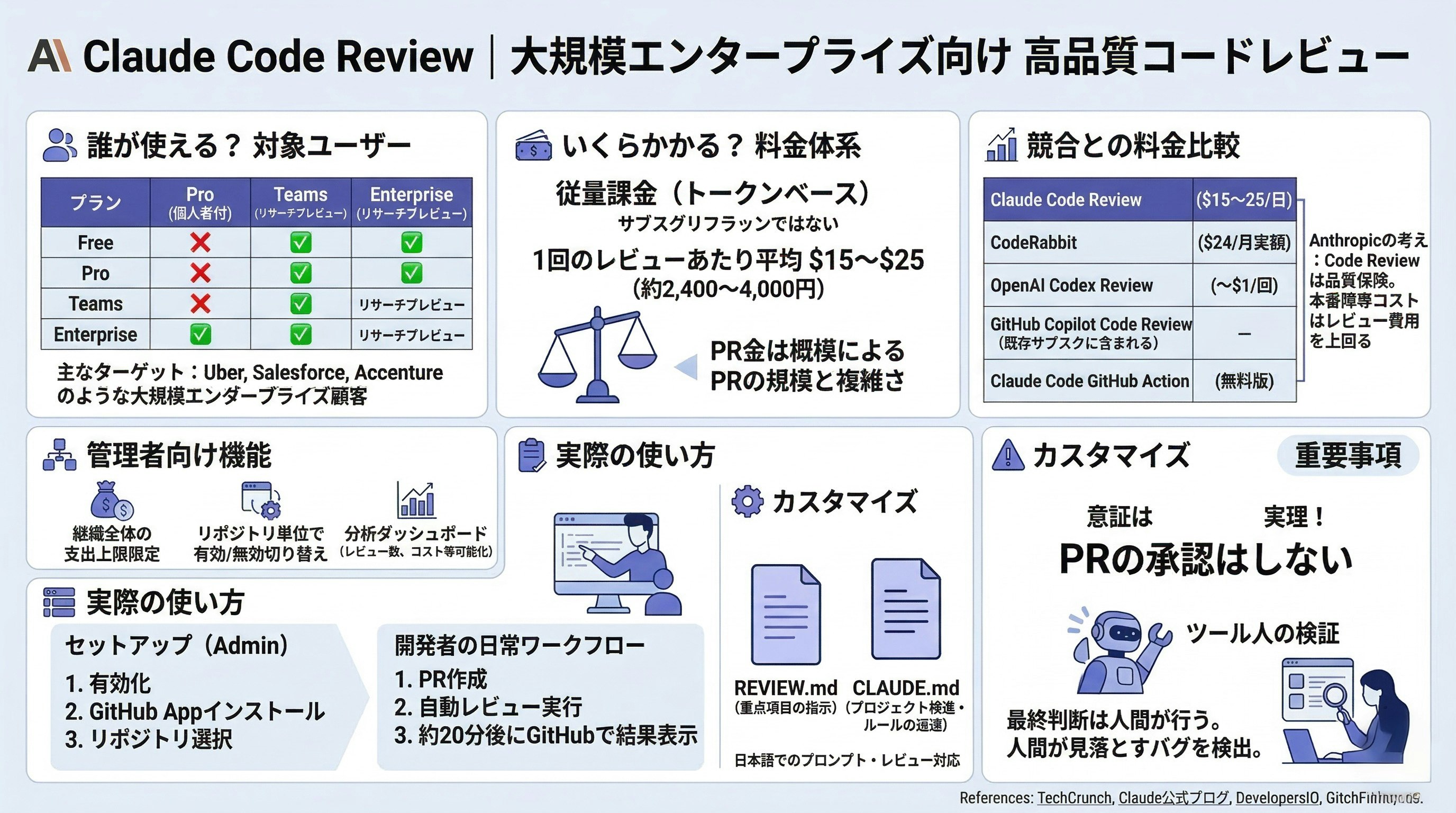

誰が使える?いくらかかる?

対象ユーザー

| プラン | 利用可否 |

|---|---|

| Free(無料) | ❌ |

| Pro(個人有料) | ❌ |

| Teams | ✅(リサーチプレビュー) |

| Enterprise | ✅(リサーチプレビュー) |

主なターゲットは Uber、Salesforce、Accenture のような大規模エンタープライズ顧客です(参考:TechCrunch)。

料金

料金はサブスクリプション型ではなくトークン使用量に基づく従量課金で、1回のレビューあたり平均 $15〜$25(約2,400〜4,000円) かかります。PRの規模や複雑さに応じてスケールします(参考:Claude公式ブログ)。

競合との料金比較

| ツール | 料金体系 |

|---|---|

| Claude Code Review | 1回 $15〜25(従量課金) |

| CodeRabbit | 月額 $24(定額) |

| OpenAI Codex Review | 1回 約$1 |

| GitHub Copilot Code Review | 既存サブスクに含まれる |

| Claude Code GitHub Action(無料版) | オープンソース・無料 |

価格差は大きいですが、Anthropic は「Code Review は品質保険であり、本番障害のコスト(ロールバック、ホットフィックス、オンコール対応)は1回 $20 のレビュー費用をはるかに上回る」と説明しています。FindArticles の試算では、100人の開発者チームで月2,000件のPRを処理すると月約 $40,000 になりますが、IBM のデータ漏洩コストレポートでは平均的なセキュリティインシデントのコストが 400万ドル超であることを引き合いに出しています(参考:FindArticles)。

管理者向けのコスト管理機能

- 月間の組織全体の支出上限を設定可能

- リポジトリ単位でレビューの有効/無効を切り替え可能

- 分析ダッシュボードでレビュー数、受け入れ率、総コストを可視化

実際の使い方

セットアップ(管理者が行う作業)

- Claude Code の設定画面(

claude.ai/admin-settings/claude-code)で Code Review を有効化 - GitHub App をインストール(GitHub の組織アカウントと連携)

- レビューを実行したいリポジトリを選択

開発者の日常ワークフロー

管理者がセットアップを完了すれば、開発者側で特別な設定は不要です。対象リポジトリでPRを作成するだけで自動的に Code Review が実行されます。約20分後に GitHub のPR画面上にレビュー結果が表示されます(参考:Claude Code Docs)。

カスタマイズ

REVIEW.md ファイルをリポジトリに置くことで、Code Review に「何を重点的に見てほしいか」を指示できます。また CLAUDE.md ファイルでプロジェクトの構造やルールを伝えることで、よりプロジェクト固有の文脈を理解したレビューが可能になります。

DevelopersIO の記事では、日本語でプロンプトを書けば日本語でレビューが返ってくることが確認されています(参考:DevelopersIO)。

重要:PRの承認はしない

Code Review はPRを承認(Approve)しません。最終的な承認判断は常に人間のレビュアーが行います。あくまで人間のレビュアーが見落としがちなバグを事前に検出し、より質の高いレビューを支援するツールという位置づけです

参考:

ユーザーの声・現場での評価

「レビューがつらい」問題の解決策として期待

Claude Code でのコード生成が爆速になった一方で、「レビューが追いつかない」 という声は以前から多く上がっていました。あるエンジニアは「10歩進んで7歩くらい下がるを繰り返している感覚。とにかくレビューがつらい」と述べています(参考:機械音痴な情報系)。Code Review はまさにこの課題に対するアンサーと言えます。

既に Claude Code でレビューを自動化していた開発者の知見

Code Review の正式リリース前から、Claude Code の GitHub Action やカスタムコマンドを使ってレビューを自動化していた開発者も多くいます。

microCMS のエンジニアは、REVIEW.md にレビュー観点を記述し、Claude Code に「ultrathink」キーワードを付けて深い思考でレビューさせるワークフローを紹介しています。過去にインシデントとなった変更を改めてレビューしてもらい、その時の問題点が正しく指摘されることを確認したとのことです。1回のレビューにかかったAPI費用は約5円で、インシデント防止を考えれば十分ペイする金額だと評価しています(参考:Zenn - microCMS)。

Progate のエンジニアは、レビュー依頼が来るたびに自動でClaude Code がレビューし、結果をMarkdownに保存するシステムを構築。「MTG中に裏側で勝手にレビューが進んでいる」「重点的にレビューするポイントが事前にわかる」という効果を実感しています(参考:Zenn - Progate)。

Codex との比較検証

ある企業のエンジニアが Claude と OpenAI Codex を同じPRに対して比較検証した結果、Codex は実装リスクの検知(パフォーマンスや動作時のリスク)に強く、Claude はプロジェクトルールへの準拠と具体的な修正提案に強いという傾向が見られたとのこと。両者を併用する「ダブルチェック体制」が効果的だと結論づけています(参考:divx.co.jp)。

Product Hunt でのユーザー評価

Product Hunt では Claude Code 全般に対して「推論の深さとコンテキスト理解が優れている」「大規模コードベースでのファイル横断的な推論が一貫している」「シニアエンジニアの85%承認率を達成できる品質」といった高い評価が寄せられています(参考:Product Hunt)。

従来のツールとの違いまとめ

| 比較項目 | Claude Code Review | GitHub Copilot Review | CodeRabbit | Claude Code GitHub Action |

|---|---|---|---|---|

| レビュー速度 | 約20分 | 数秒〜数分 | 7〜30分 | 数分 |

| レビューの深さ | 非常に深い(マルチエージェント) | 標準 | 深い | 標準 |

| 料金 | $15〜25/回 | サブスク内 | 月額$24 | 無料(API費用のみ) |

| フォーカス | ロジックエラー重視 | 汎用 | 汎用 | カスタマイズ可 |

| PR承認 | しない | する | する | しない |

| 対応プラン | Teams/Enterprise | GitHub有料プラン | 全プラン | 全プラン |

The New Stack のインタビューで Cat Wu 氏は「他のコードレビューツールよりも長く実行されるが、それが非常にインテリジェントで網羅的なレビューを実現するためのトレードオフだ」と述べています(参考:The New Stack)。

個人開発者でも使える代替手段

Code Review 自体は Teams/Enterprise 限定ですが、個人開発者でも以下の方法で Claude によるコードレビューを活用できます。

1. Claude Code GitHub Action(無料・オープンソース)

Anthropic が公式提供している GitHub Action で、PRに @claude とメンションするだけでレビューを依頼できます。Code Review ほど深くはありませんが、十分実用的です。

2. カスタムコマンドでレビュー

.claude/commands/ ディレクトリにレビュー用の Markdown ファイルを配置し、独自のレビューコマンドを作成する方法です。microCMS や Progate のエンジニアが実践している手法です。

3. code-review プラグイン

Claude Code のプラグインマーケットプレイスで提供されている公式プラグインで、4つの並列エージェントでレビューし、信頼度スコアリングで誤検知をフィルタリングする仕組みです(参考:DevelopersIO)。

関連機能:Claude Code Security

Anthropic は Code Review とは別に、セキュリティに特化した Claude Code Security という別製品も2月に発表しています。Code Review でも軽いセキュリティチェックは行いますが、本格的な脆弱性スキャンには Claude Code Security の利用が推奨されています(参考:TechCrunch)。

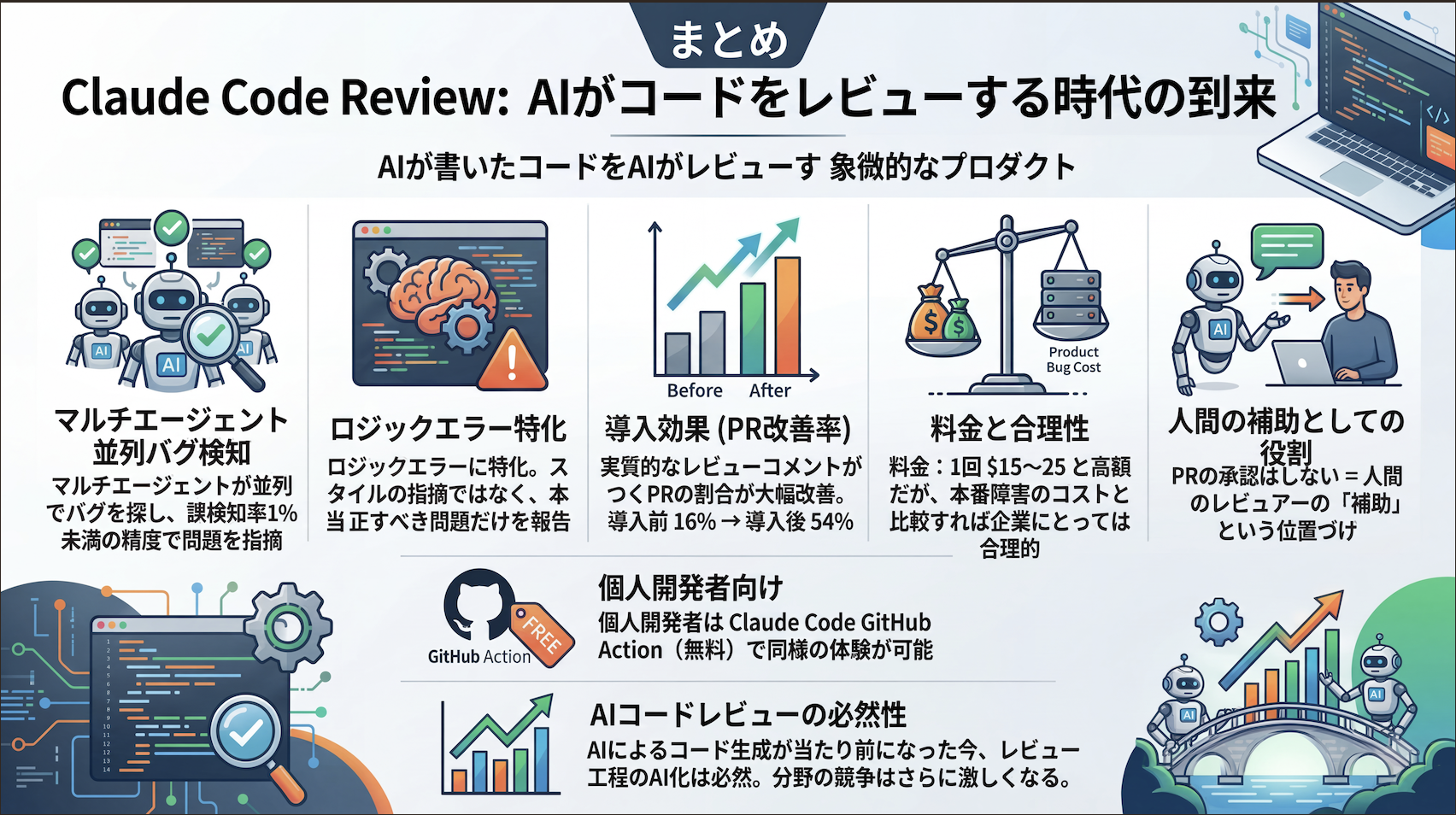

まとめ

Claude Code Review は「AIが書いたコードをAIがレビューする」時代の到来を示す象徴的なプロダクトです。

ポイントを整理すると:

- マルチエージェントが並列でバグを探し、誤検知率1%未満の精度で問題を指摘

- ロジックエラーに特化し、スタイルの指摘ではなく本当に修正すべき問題だけを報告

- 導入前16%→導入後54%と、実質的なレビューコメントがつくPRの割合が大幅改善

- 料金は1回 $15〜25 と高額だが、本番障害のコストと比較すれば企業にとっては合理的

- PRの承認はしない = 人間のレビュアーの「補助」という位置づけ

- 個人開発者は Claude Code GitHub Action(無料)で同様の体験が可能

AI によるコード生成が当たり前になった今、レビュー工程のAI化は必然的な次のステップです。この分野の競争は今後さらに激しくなることが予想されます。