ハルシネーション(Hallucination)とは?

もっともらしいウソ(=事実とは異なる内容や、文脈と無関係な内容)の出力が生成されることである。人間が現実の知覚ではなく脳内の想像で「幻覚」を見る現象と同様に、まるでAIが「幻覚」を見て出力しているみたいなので、このように呼ばれる。

なぜハルシネーションを起こすのか?

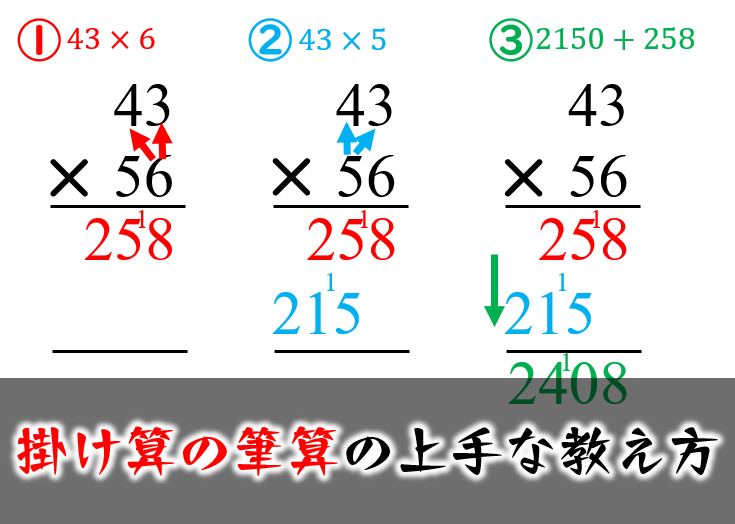

AIに掛け算をさせてみよう

5x5=は正解できたが、438890x819471=は不正解である。なぜならAIは掛け算を理解しておらず、人間が九九を暗記しているにすぎないのである。

ではどうすれば、438890x819471=を正解できるのであろうか?それは、簡単だ。RNNのように時系列の次元をTransformerに追加することで正解に導くことができる。

これは一体何を意味するのだろうか。GPT-4はまさにマルチモーダル(画像)を扱えるが、GPT-5で動画。

つまり、時系列を追加することで自己検証が可能となりハルシネーションがなくなるだろう。自己検証が可能となれば、RLHFのような人間のフィードバックも必要ではなくなるだろう

まとめ

AIからハルシネーションをなくすには、transformerにMLMではなく時系列の次元を追加したモデルを開発すべきである

AGIは近い