「これで解決!ゲームに必要な3Dオーディオの全て」講演レポート

概要

このセッションはCEDEC2017、8/30の11:20~12:20に行われたものです。SNS公開可能と記載されていたため、本レポートは講演での口頭説明をしていた部分を付け加えつつ、資料と合わせて見返した時、内容がすぐわかるように講演内容をまとめたものとして掲載しています。

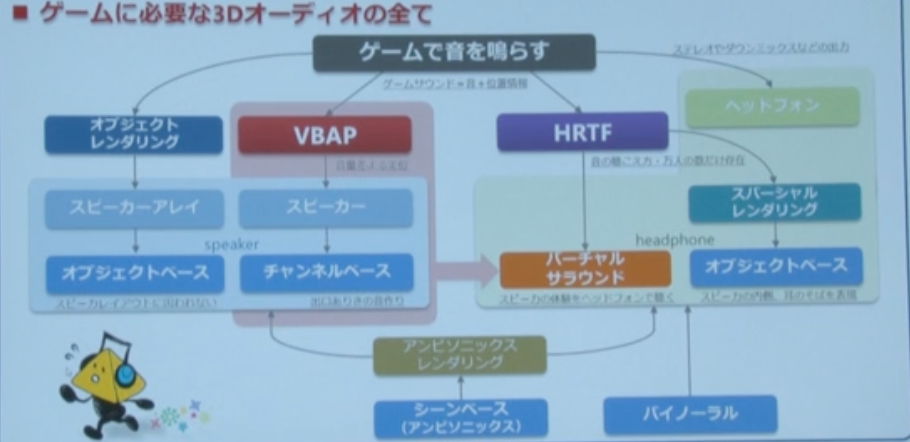

3Dの空間音響レンダリング方法

Ambisonics

これは音響再現手法の1つで1970年だからある技術。

これについては別セッションで詳しく取り上げられるため割愛。

Binaural

ステレオ録音方法の1つ。

360度にある音を人間は2つの耳で聞いている。ならば2つの耳で聞いている時の音を収録すれば人間の頭部の音響効果を再現できるんじゃないかと考えられて生み出されたのがバイノーラル。

もしくは、音が耳に届くまでの道筋を次に紹介するHRTFによってシミュレーションすることで、ヘッドフォンやイヤフォンで聴いた時に、その場の距離感を再現できる。

HRTF (頭部伝達関数)

音が鳴った場所から自分の耳に届くまでの道筋は、上半身の形状、頭の幅、顔の形状などによって音の方向が変わったり吸収されたりして変化するため、万人の数だけ音の聴こえ方も違ってくる。

特定の位置から両耳に届くまでの関数=超短いIR(インパルスレスポンス)だと考える。

角度ごとに短いIRを集合体として持ったものがHRTFである。

バイノーラルでは一点の場所で鳴った音が耳に入るまでを再現するが、HRTFはIRを掛け撮りしてるようなイメージ。掛け録りすることで、音源地が変わっても自分の耳に入るまでの道筋を再現することができる。

バイノーラルやHRTFに関する詳しいセッションも公開されるので後ほどレポートにする予定。

覚えておきたい基本用語

- VBAP(ベクトルベース振幅パンニング):各スピーカーの音量差によって、左右どちらから音が聞こえてくるように感じるかが変わるようにする(音が定位)。

- HRTF(頭部伝達関数):人それぞれの音の聴こえ方。

覚えておきたい「○○ベースオーディオ」

想定シチュエーションとして「ヘリコプターが自分の前方から右上を通って左後ろに抜ける」をイメージする。

チャンネルベース

曲のMIXや楽器のパンニングとほぼ一緒。音の出口があることを確定して音を作成し、最終的にアウトプットのチャンネルに向けてミキシング(各音の音量調節をしつつ音を足し合わせる作業)した音源を再生する。

オブジェクトベース

「音源」と「音の移動情報(metadata)」を持たせて、再生機器側で処理を行って音を再生させ、移動を再現する。

シーンベース

ある一点で録音した音で、そのシーンを表現する。これを音場再現と言う。

絶対位置をキープしたまま指向性を制御できて、ヘッドトラッキングにも対応することが可能。

今回の場合だと、自分のいる場所にマイクを立ててヘリコプターの移動する音をそのまま録音して再現する。

シーンベースはアンビソニックスと同じと捉えても問題はない。

じゃあゲームは何ベースか?

今までのゲームオーディオは内部的にはオブジェクトベースだが、オブジェクトベースで出力する手段がなかったので、出力段階でチャンネルベースと言う形を取っている。(音源座標とリスニングポイントとの相対的な位置関係によって角度を求め、VBAPでチャンネル出力)

最近はオブジェクトベースで出力できる環境が整ってきている。

スピーカーで聴く3Dオーディオのシチュエーション

チャンネルベース

今まで通り、ゲーム中の音源座標とリスニングポイントの座標位置から角度などを計算し、VBAP法によって各チャンネルに振り分けられて音が定位し、設置したスピーカーから音が鳴る。

オブジェクトベース

音源と位置情報がオブジェクトベースのアルゴリズムで計算されて再生機側で処理されて出音される。

チャンネルベースとオブジェクトベースは聞こえ方は同じ?

ビット単位で同じかと言われたらそうではないかもしれないが、体験としては同じように感じることができる。

ヘッドフォンで聴く3Dオーディオシチュエーション

チャンネルベース

基本的にはサラウンドの音でも破綻しないようにダウンミックスされる。(7.1chなどから2.0chへ)

バーチャルサラウンド(仮想スピーカー定位)

HRTFを用いて音響処理を施し、7.1chなどの2.0ch以上のものを、そのままの音響で体験することができる。

一昔前にヘッドフォンの中にユニットがいくつかあって、バーチャルで5.1ができますといったものもあったが、最近ではHRTFを用いて音響処理をする方が精度も上がってきているため主流である。

オブジェクトベース

スパーシャル・レンダリング(空間音響処理)という、HRTFを用いて、その音が実際に耳に聞こえるように再生する手法。

スピーカーの内側・耳に近い音を表現できる。これはバーチャルサラウンドだと、どうしても接近音を1m先のスピーカーから聴く状態になってしまう。

ゲームの音を、その世界に入ったように体験することができるため、VRで使えると注目されている。

バーチャルサラウンドを理解する

バーチャルサラウンドで実現している2.0ch以上の音響の再現はどのように行われているのか?を確認する。

バーチャルサラウンドで一番理にかなっているのは、「SMYTH RESEARCH SVS - Realizer A8」という機材。HRTFは万人の数だけ存在するので、汎用的なHRTFを作ることは不可能。この「SMYTH SVS」というのは個人に特化したHRTFをリアルタイムで作り出すことができる。

「SMYTH SVS」

これはターゲットとなるスタジオや部屋のスピーカーから出る音と、ほぼ等しい音質と音場をヘッドフォンでエミュレーションできるシステム。

このエミュレーションは、部屋の音響特性やスピーカーの性能や、使用される機器の特性もカバーされる。

個人に特化したHRTFを取得するのに、3つの計測を「SMYTH SVS」で行う。

1. 「パーソナリゼーション」

5.1chのスピーカーシステムが組まれているスタジオのスイートスポットに座っていると想定して、自分の耳に小型マイクを入れておく。そこで各スピーカーから測定用サウンドを鳴らして、部屋の音響特性やスピード、機材の特性も含まれた、自分の耳に届くまでの個人に特化したHRTFを取得する。

2. 「ヘッド・トラッキング」

頭の動きに合わせて音が移動するというのは普通のスタジオではあり得ない。なので、その状況を作り出すために、まず右を向いた状態で右スピーカーから測定用の音を流してHRTFを取得し、同じように左を向いてHRTFを取得する。これらを取得することで、例えばヘッドフォンをしたまま頭を動かすと、右の音はそのまま右のスピーカーの位置で鳴るので実際の音場を再現することがで着る。

3. 「音響機器の特性を補完」

この機械はどんなヘッドフォンでも繋げることができる。この場合、ヘッドフォンから測定用サウンドを鳴らして、ヘッドフォンから自分の耳までの距離の音の変化のHRTFも測定可能。ヘッドフォンの特性によって変化する音も補完する。

これらをゲームに持っていけるか?

20万近くする機械なのでゲームを買ってこれも買ってはきつい。利便性は微妙。

HRTFとヘッドフォン補正を両方パーソナライズするのが再現度的には一番いいかもしれないけど難しい。

HRTFを汎用性のものにして、ヘッドフォン補正がプリセットで存在するものにした場合(DTS Headphone Xなど)再現度は若干落ちるけど、利便性的には上がる。

じゃあHRTFは汎用的でヘッドフォン補正がない場合は上の3つと比べると再現度は落ちるが利便性は一番高い。自分の好きなヘッドフォンで聴けるから。

ゲームへの導入は利便性も重要。

スピーカーで聴く vs ヘッドフォンで聴く

この2つは違う体験である。だがヘッドフォンでバーチャルサラウンドを聴いてる時の体験としては、スピーカーで聴く時と同じ状態となる。

VRコンテンツの音響制作

ゲームでの音響制作の基本は「演出」と「再現」の2つで、これはVRでも同様である。この2つをバランスよくすることで、ユーザーが気持ちよくプレイできることが大事。

VRで鳴らすことのできる音の種類

ザッとフォーマットで分けると以下の通りになる。

- オブジェクトベース

処理負荷の関係で、全部の音を表現できるわけではない。一部をオブジェクトベース、他をバーチャルサラウンドのような感じにする。 - チャンネルベース

- バーチャルサラウンド

- シーンベース

VRでの音響制作となると基本的にヘッドフォンを想定していて、これらのフォーマットを組み合わせて作成していくこととなる。

例えば森&鳥はバーチャルサラウンド(Quad)、ヘリコプターもバーチャルサラウンド(Mono・VBAP)、BGMはチャンネルベース(Stereo)、耳元で話す声もチャンネルベース(バイノーラル)、蚊が飛ぶ音はオブジェクトベース(Mono)、どこかで流れる滝の音はシーンベース(B-format)など。

まとめと補足

チャンネルベースは心理音響モデルで「芸術的」である。オブジェクトベースは物理音響モデルで「学術的」である。

「芸術的」イメージは演出をメインに考えており、チャンネルベースを主体として聴くことに特化している。つまり「それっぽく聴かせる=気持ちよさ=アーティスティック」。

「学術的」イメージは再現をメインに考えており、オブジェクトベースを主体として体感をすることに特化している。つまり「再現=リアル=アカデミック」

ゲームにとってどちらが正解でどちらが重要かというのは、様々な要件(音の重要度、処理負荷、容量等)で変化する。何が選択するかはゲームサウンドクリエイターの仕事となる。

今回のセッションを一枚でまとめると以下のようになる。(画質はタイムシフトなのでご愛嬌)

感想

今までオーディオ関連に関しては全く勉強してこなかったけれど、1つ1つの単語の意味を紐解きながら学べることができたのでとても面白いセッションでした。また、ゲーム内やVRではどのようなアプローチが必要になるかなども聴くことができたので、大変勉強になりました。