速報

dgx spark 用の公式コンテナが2026/4になって公開されました.

https://catalog.ngc.nvidia.com/orgs/nvidia/containers/vllm?version=26.03.post1-py3

これにより,vLLMのバージョンが 0.15.1 -> 0.17.1 とアップグレードされ,公式コンテナでも nemotron-3-super やqwen3.5系が動きます.

https://github.com/vllm-project/vllm/releases/tag/v0.17.0#:~:text=Full%20support%20for%20the%20Qwen3.5%20model%20family

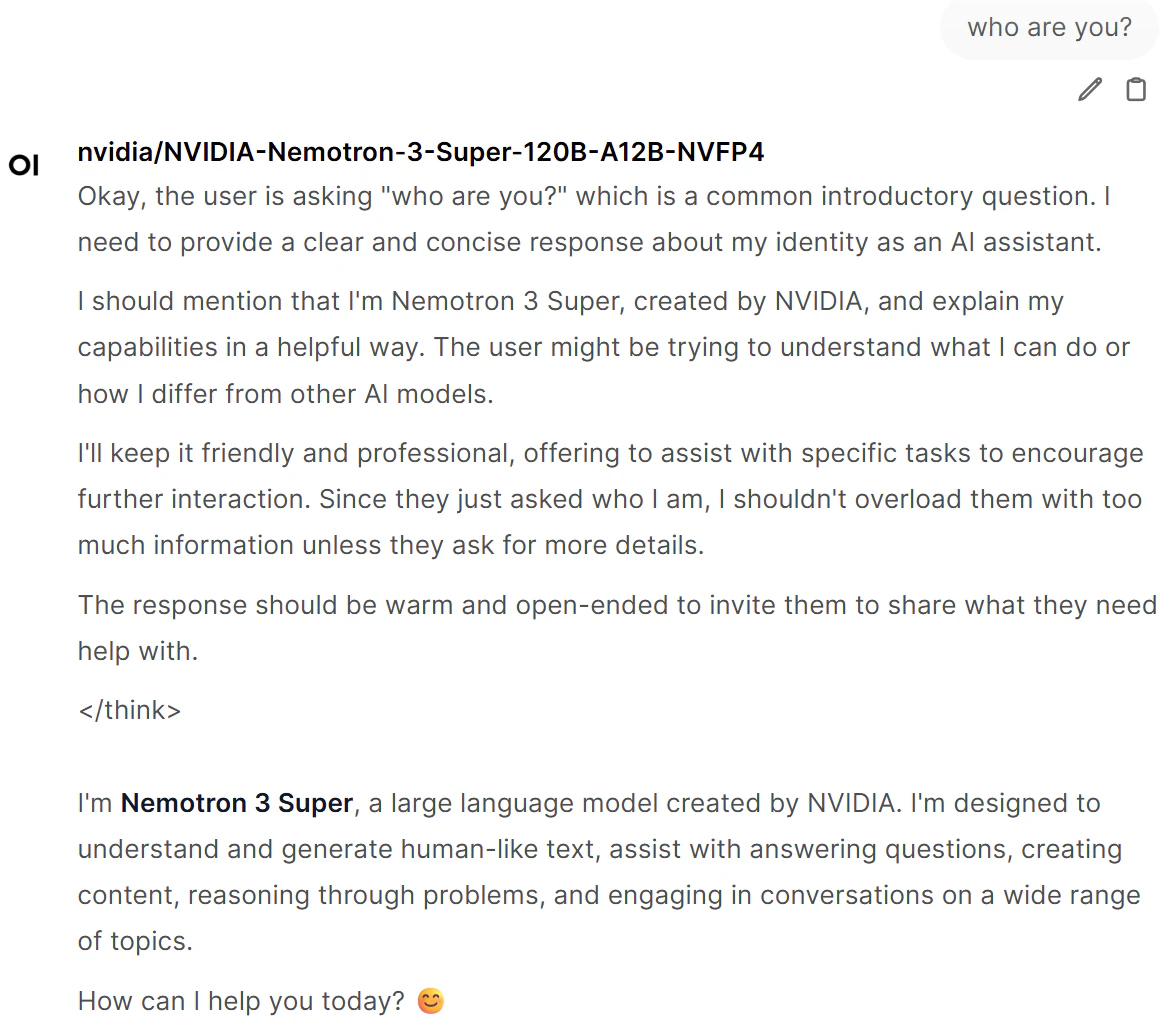

しかし, thinking token が漏れてしまうバグが発生しています.

Open Web UI でも同様に </think> が見えてしまいます.

Chat 用に使う分には問題ありませんが,Codex CLI などを用いて Agent として使うのは難しそうです.

筆者の環境では Codex CLI は起動するものの,構文解析がうまくいかず,正常動作しませんでした.

最新のvLLMを使いたい人はコミュニティ版のコンテナをつかうのがよさそうです.

https://github.com/eugr/spark-vllm-docker

追記

vLLM 公式コンテナで最新バージョンを動かしたところ,バージョン 0.19.1 の vLLM にもかかわらず,thinking token が見えてしまう現象が再現されました...