画像生成などコンピュータービジョンに関するLLMの論文を3つ紹介します。

1. 器用な画像生成モデル「OmniGen」

2. 質の高い3Dアセットの生成

3. ドラッグすることで画像を編集する技術の発展

器用な画像生成モデル「OmniGen」

OmniGen: Unified Image Generation

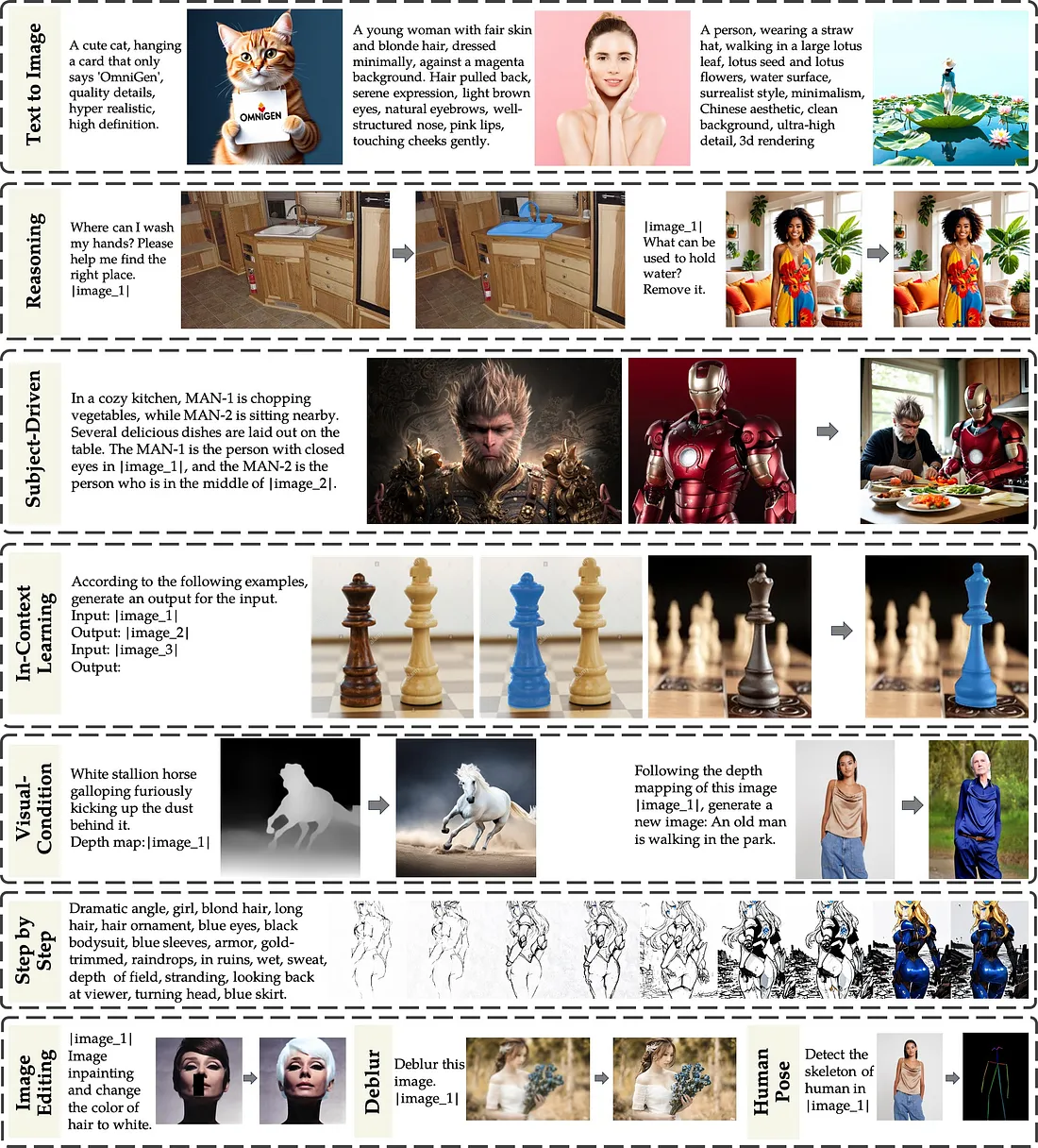

画像生成の領域では、様々なタスクを単一のフレームワークで処理できるモデルはまだほとんど開発されていませんが、「OmniGen」は次のように1つのモデルで様々なタスクを実行できます。

具体的にはこのようなタスクが対象です。

- Text to Image: 文章から画像の生成

- Reasoning: 推論

- Subject-Driven: 主題に合わせた画像の合成

- In-Context Learning: 文脈の理解

- Visual-Condition: 視覚効果の変化

- Step by Step: 徐々に画像を変える

- Image Editing: 画像編集や画質の変更

質の高い3Dアセットの生成

3DTopia-XL: Scaling High-quality 3D Asset Generation via Primitive Diffusion

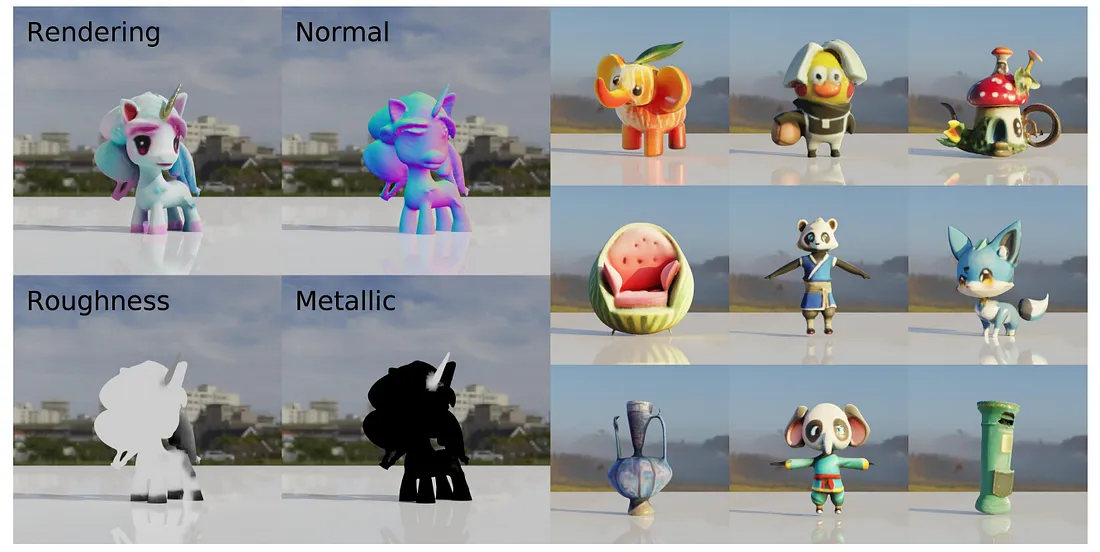

3DTopia-XLという拡散モデルによって高品質な3Dアセットができます。こちらに関してはYouTubeやHugging Faceでデモを見るのが早いです!

得られる3Dアセットは滑らかなジオメトリだけでなく外部の環境を反映するテクスチャやマテリアルを持たせることもできます。

ドラッグすることで画像を編集する技術の発展

InstantDrag: Improving Interactivity in Drag-based Image Editing

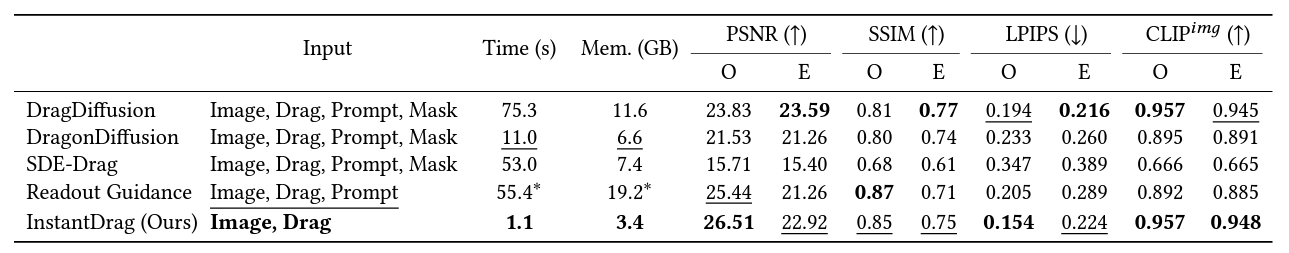

DragGANに代表されるドラッグ操作による画像生成、つまり再編集の技術がさらに発展しました。

近年の技術では、1秒以内にテキストから画像を生成することができる一方で、ドラッグ操作による生成は画像の内容を維持しながら変更点だけ正確に反映するために時間がかかってしまいます。

韓国のチームが開発したInstantDragは、既存の技術で使われていた画像ごとに最適化する手法を必要としないパイプラインによって処理速度を高速化しています。

プロンプトやマスクを入力データに使わずに1.1秒ほどで生成できます。

参考

各arXiv論文はこちらです。

- OmniGen: Unified Image Generation

- 3DTopia-XL: Scaling High-quality 3D Asset Generation via Primitive Diffusion

- InstantDrag: Improving Interactivity in Drag-based Image Editing