2021年も残りわずか!

早いもので12月、というわけで「画像認識できるデバイス」をテーマに

近年のIoTデバイスの状況をまとめます。

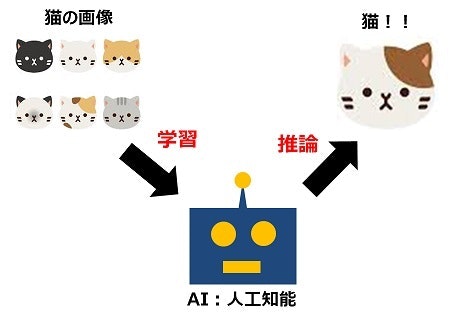

AIタスクはディープラーニングに注目

ここ10年ほどはニューラルネットワークの汎用性と高い精度が着目され、さまざまな分野への応用が進んできました。

(画像引用元 計測・試験機器総合Web展(計測展))

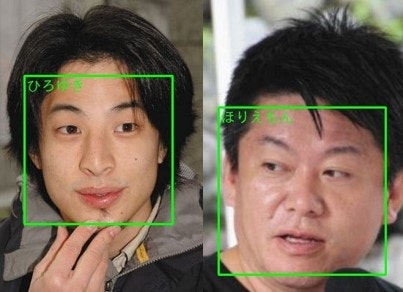

10年前は顔認識なんか個人で扱える術もなく、一部企業の固有技術でした。

下のデジカメの例も、顔を「認識」しているわけでなく「検出」止まり。

(画像引用元 デジカメWatch)

で10年ほど前から突然ディープラーニングのブームに火が点き、オープンに研究されていることもあり、

今ではiPhoneなどのスマートフォンに顔認証が搭載され、画像認識はすっかり浸透した状況です。

使いやすくなったディープラーニング

ディープラーニング自体もユーザが利用しやすいように、進化してきました。

使いやすさについて何点か述べたいと思います。

1. 学習済モデルをダウンロードして使える

ディープラーニングの一般的な流れは次の通り、

学習フェーズにてモデルを鍛え、鍛えた学習済モデルを推論フェーズにて利用する流れです。

(画像引用元 キャド研)

学習フェーズが面倒で大変です。

学習前にモデルの形を設計しますが、専門知識や経験がないと認識精度を確保できません。

加えてモデルの内部パラメータを鍛えるために、大量の学習用データを必要とします。

そして満足できる精度のモデルができるまで、モデルやデータを修正しながら何度も学習しなおす必要があります。

学習を短時間化するためには、高性能なシステムが必要です。

それに比べて、推論フェーズは楽です。

学習済モデルに入力データを突っ込んで、認識結果を受け取るだけ。

今は、画像認識など特定AIを利用するだけなら、精度の良い学習済モデルをダウンロードして利用でき、学習フェーズが不要です。

import sys

import numpy as np

from tensorflow.keras.preprocessing import image

from tensorflow.keras.applications.resnet50 import ResNet50

from tensorflow.keras.applications.resnet50 import preprocess_input, decode_predictions

model = ResNet50(weights='imagenet')

img = image.load_img(sys.argv[1], target_size=(224, 224))

imgin = preprocess_input(np.expand_dims(image.img_to_array(img), axis=0))

preds = model.predict(imgin)

print(decode_predictions(preds)[0])

上記 Pythonのサンプルコードで使われているのは、

ResNet-50 という1000種類の物体を識別できる学習済モデルです。

Kerasのライブラリでは、モデルを自動ダウンロードしてくれます。

$ python3 test.py test.jpg

(省略)

[('n03895866', 'passenger_car', 0.19717215), ('n04285008', 'sports_car', 0.18797779), ('n02974003', 'car_wheel', 0.16151562), ('n03459775', 'grille', 0.12596677), ('n04037443', 'racer', 0.11913665)]

$

車とは認識しているようです。

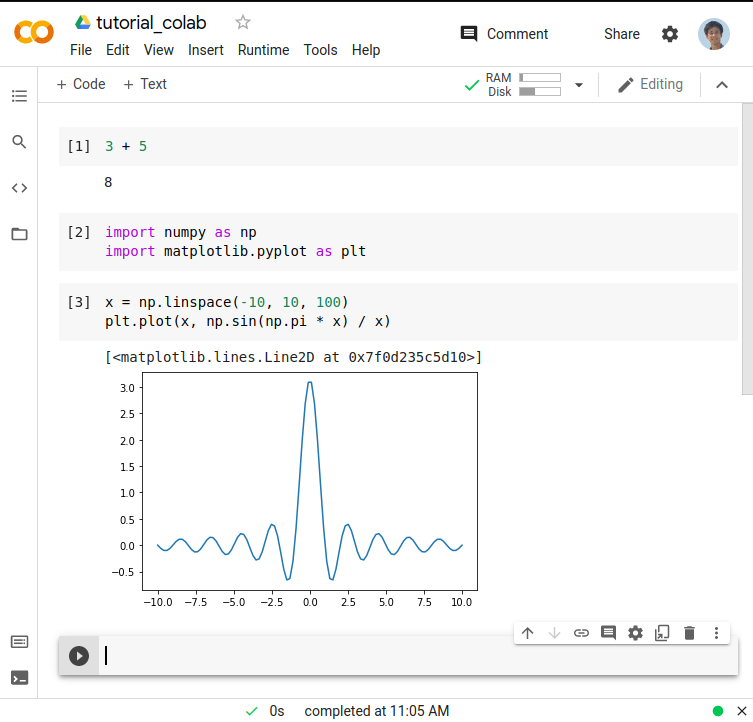

2. 開発環境の充実

Python言語がAIのライブラリも充実しており良く利用されています。

GPU(グラフィックボード) の並列処理機能を利用して、ディープラーニングを高速化できるようになってます。

上記環境をクラウド提供してくれる Google Colaboratory サービスがあります。

(画像引用元 python_textbook)

お試しレベルの利用なら無料で、Pythonや機械学習の勉強にも十分です。

環境構築する手間がなく、ブラウザからすぐ開発に着手できます。

3. IoTデバイスからも利用可能に

IoTデバイスは、一般的に低スペックでデータ処理は難しいとされてきましたが、最近は事情が変わってきています。

Raspberry Pi が代表的な例で、手のひらサイズのマイコンボードに OSが載るほど高性能化しています。

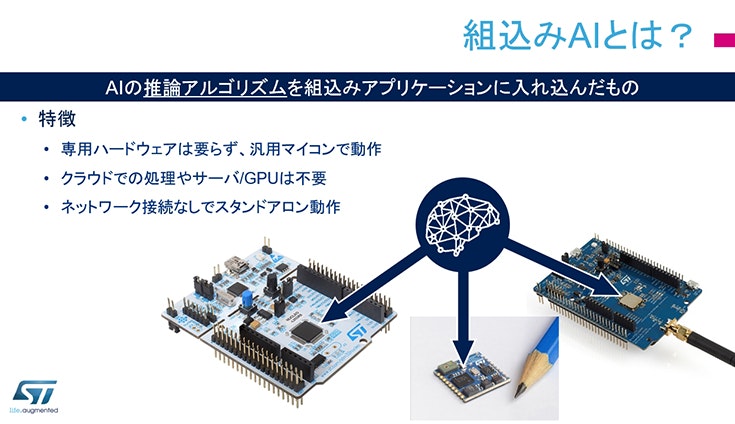

非力なマイコンボードに 「AIチップ」を載せる製品も出てきました。

次の写真の真ん中にある小さいチップは、ST製の 「SensorTile Kit」です。

(画像引用元 ロボスタ)

FPGAによるハードウェア合成でAIチップを自作する試みもあります。

ソフトウェアライブラリも選択肢が増えています。

TensorflowLite などの TinyML と呼ばれる類のライブラリが注目をあびつつあり、メモリの少ないマイコン上でAI処理できるようになっています。

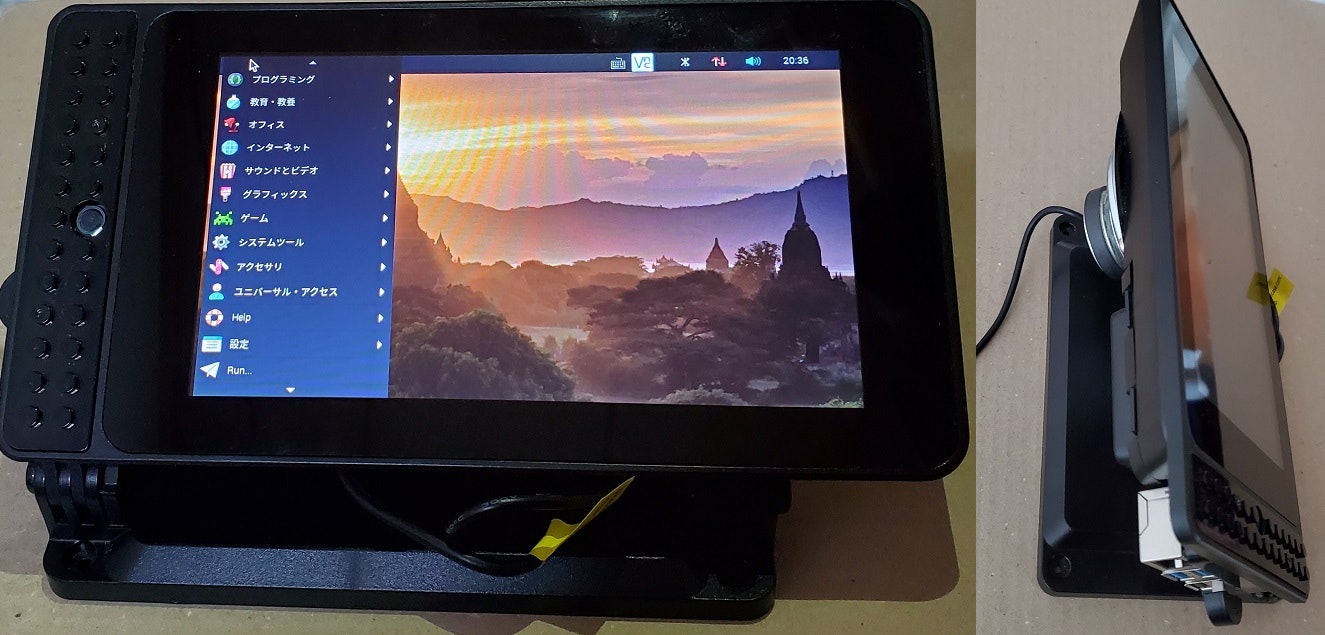

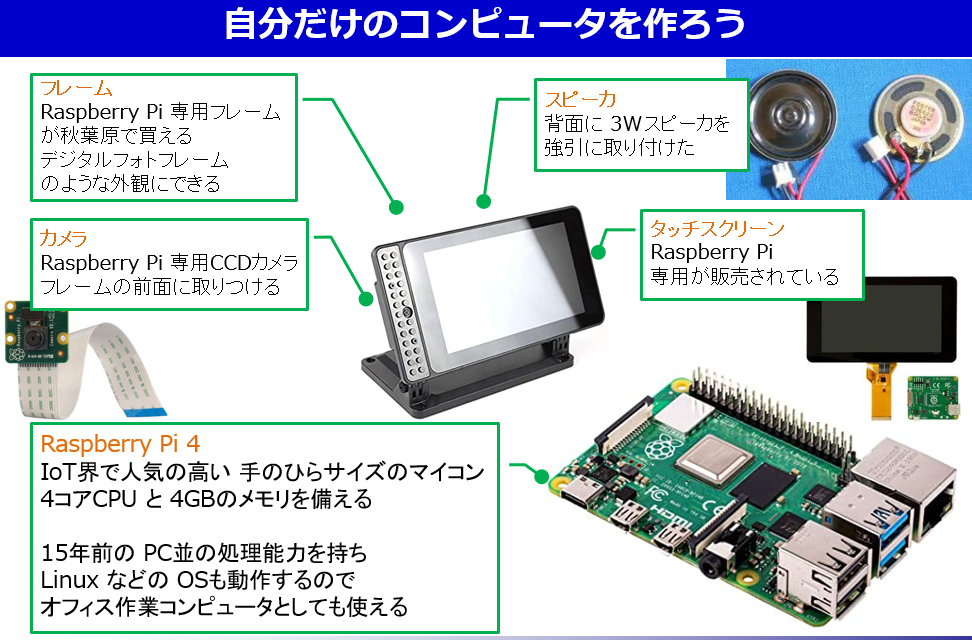

2020年に製作した顔認識デバイス

ここからは実際に触ったIoTデバイスの紹介です。

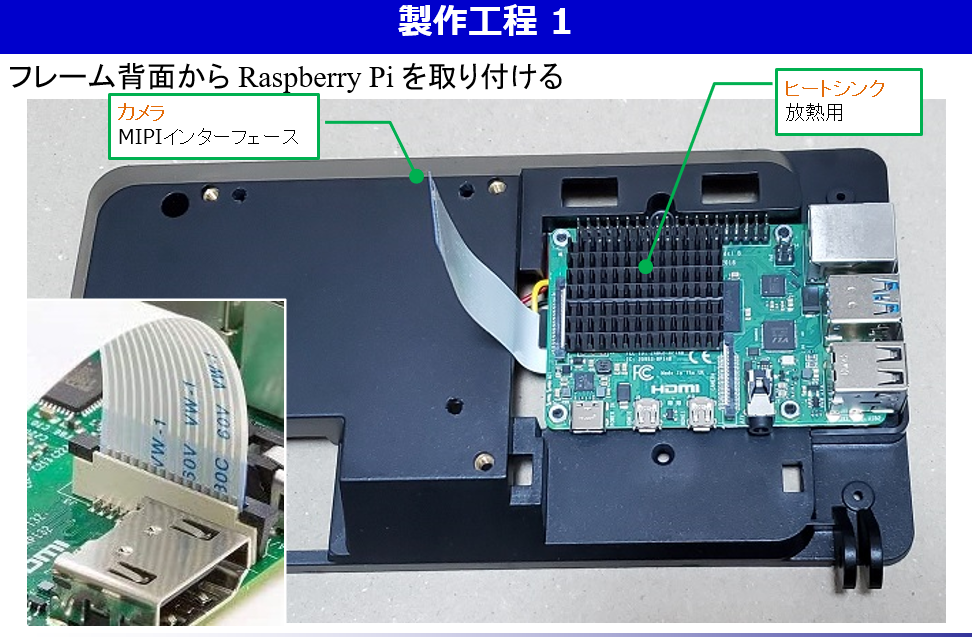

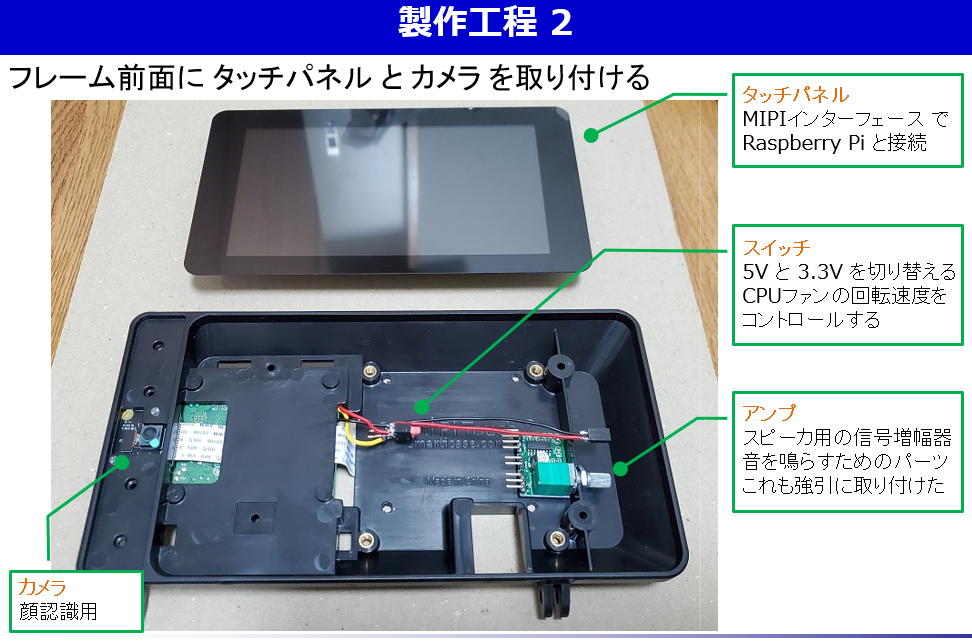

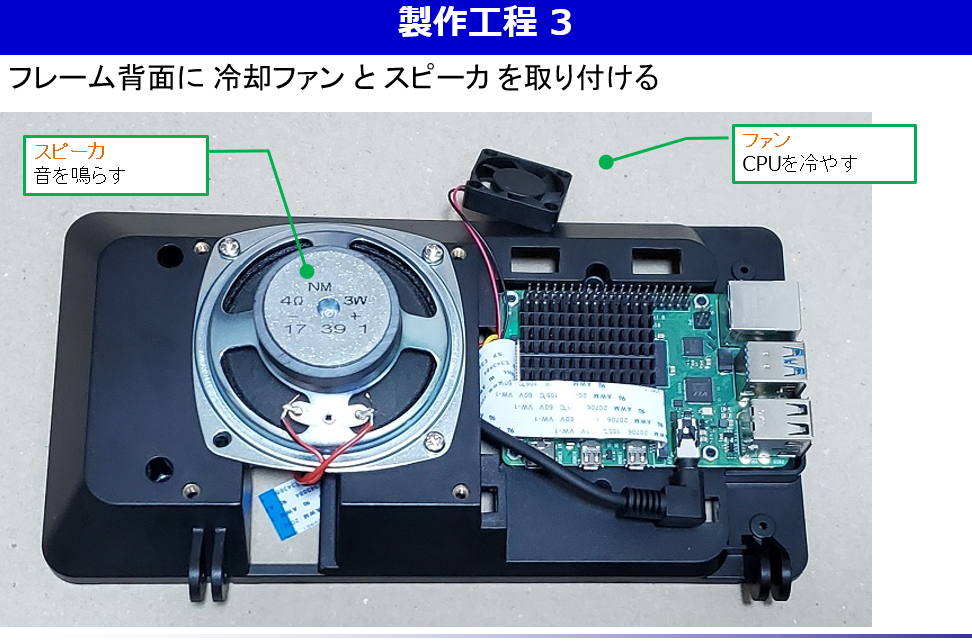

講習会で顔認識のデモ用に、Raspberry Piで顔認識システムを作りました。

Raspberry Pi 4 とタッチパネルをフレームケースに組み込んだもので、

CCDカメラやスピーカーも備えています。

顔認識のアプリケーションも自作しました。 Pythonから Dlibと呼ばれるライブラリを利用しています。

Dlib自体は汎用のデータ分析ライブラリですが、最近はディープラーニングモデルが利用できるなど流行を取り入れた拡張がなされています。

認識された顔の特徴量データと名前をセットで、Elasticsearchへデータベース登録できるようにしました。

アプリケーションの実行イメージは次のような感じです。

2021年に購入したAIカメラデバイス

今年はAI処理ができるマイコン製品をいくつか試しました。

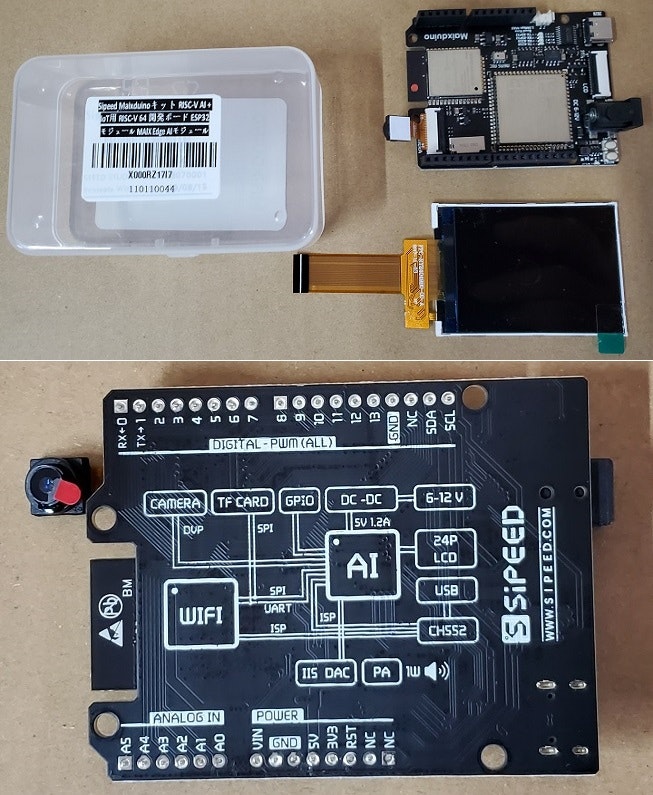

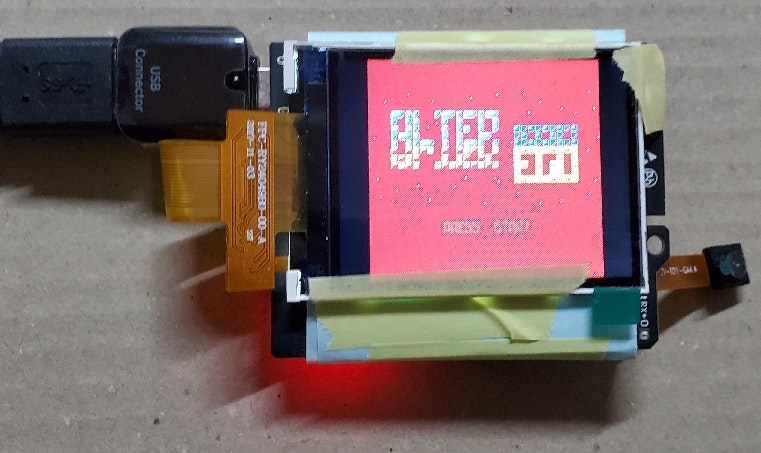

Maixduino

まず、Sipeed社製のマイコンボードである「Maixduino」です。

K210と呼ばれるRISC-VアーキテクチャのSoCがメインで、

KPUと呼ばれるニューラルネットワークアクセラレータを搭載しています。

K210用に MaixPyと呼ばれる MicroPythonが動作するファームウェアが提供されています。

MaixPyでは MicroPythonにより、つまり Pythonでプログラミングが可能です。

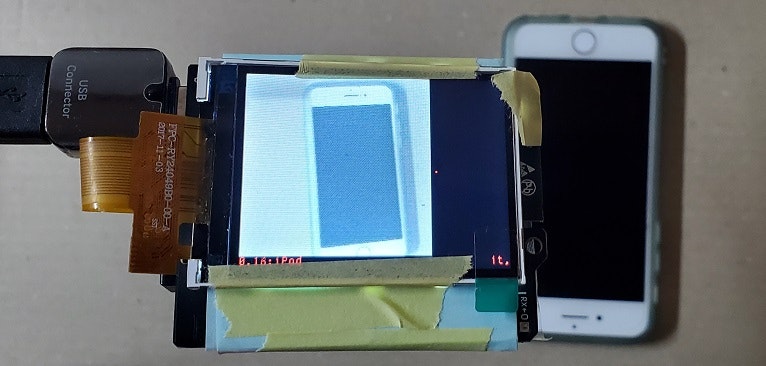

これで、1000クラス(1000種類)判別の画像認識を試しました。

import sensor, lcd

import KPU as kpu

lcd.init()

sensor.reset()

sensor.set_pixformat(sensor.RGB565)

sensor.set_framesize(sensor.QVGA)

sensor.set_windowing((224, 224))

sensor.set_vflip(1)

sensor.run(1)

lcd.clear()

lcd.draw_string(100,96,"MobileNet Demo")

lcd.draw_string(100,112,"Loading labels...")

task = kpu.load(0x300000)

kpu.set_outputs(task, 0, 1, 1, 1000)

f=open('labels.txt','r')

labels=f.readlines()

f.close()

clock = time.clock()

while(True):

img = sensor.snapshot()

clock.tick()

fmap = kpu.forward(task, img)

fps=clock.fps()

plist=fmap[:]

pmax=max(plist)

max_index=plist.index(pmax)

a = lcd.display(img, oft=(0,0))

lcd.draw_string(0, 224, "%.2f:%s "%(pmax, labels[max_index].strip()))

print(fps)

a = kpu.deinit(task)

肝となる部分は、

MobileNetモデルとして学習済のデータを ファームウェアの0x300000番地に書き込んで利用しているところ。

「task = kpu.load(0x300000)」 の部分です。

K210はメモリ 8MB制限があるため、最小サイズのファームウェアを選ぶなど切り詰めないと動作しません。

iPhoneをカメラで認識させたところ iPod と判定されてますが、概ね認識するようです。

MaixPyには、NES(ファミコン)エミュレータを搭載するファームウェアが存在します。

import nes

nes.init(0)

nes.load("nes/Alter_Ego.nes")

while True:

nes.loop()

Maixduinoでは、RGBチャンネルが誤っているためか色が変ですが、とりあえず動きます。

AIといい、ファミコンといい、遊び心満載なのが中華製品の特長と呼べるでしょう。

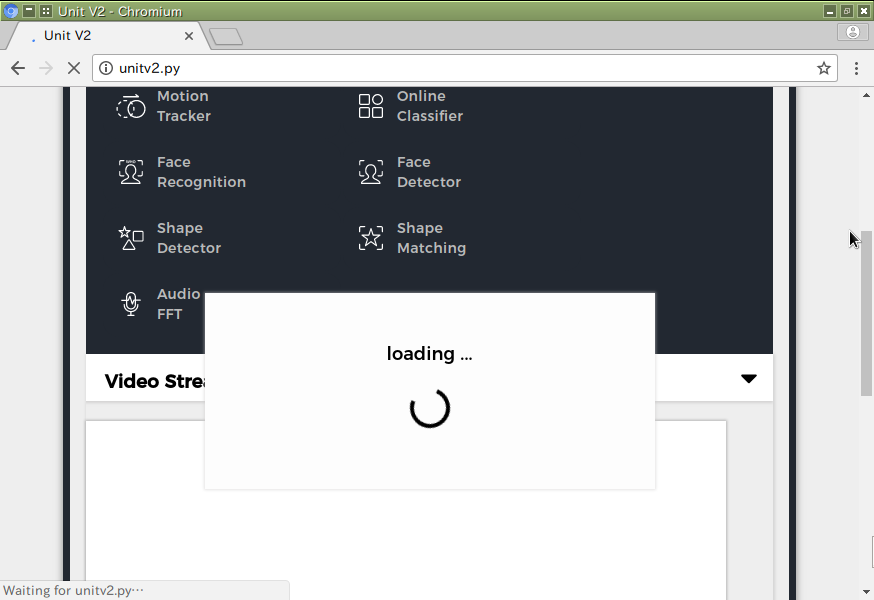

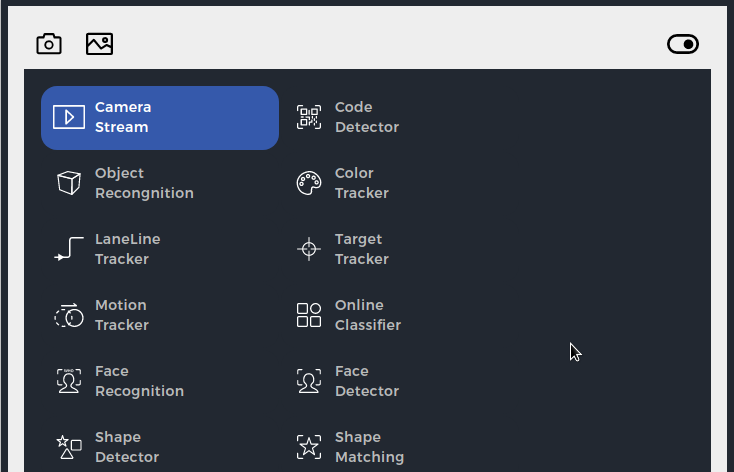

M5Stack UnitV2

次に買ったのは、M5Stack社製 M5Stack UnitV2です。

2021年6月に発売されたばかりの、AIカメラと呼ばれる製品です。

(画像引用元 SWITCHSCIENCE社)

UnitV1 は、Maixduinoと同じ K210を搭載していてメモリサイズに制限がありましたが、

UnitV2 は、128MBメモリを搭載し Linuxが動きます。 このサイズで Linuxマシンです。

さらに標準ファームウェアで Webアプリが動作し、各種AIタスクがメニューから実行可能です。

プログラムとかインストールは不要、買って PCとつなげるだけです。

PCと UnitV2を USBで繋いで、 http://unitv2.py へアクセスすれば、メニュー画面が開きます。

希望のメニューをクリックすると、該当のAIタスクがロードされ実行されます。

メニューはこんな感じ。

イメージで表示しきれてませんが、内蔵マイクを利用した音声波形分析も可能です。

「Camera Stream」は、AIとかなく、カメラの映像をそのまま表示します。

カメラの画質は、昔のスマートフォンレベルです。

「Object Recognition」です、そこそこ認識してくれます。

「Code Detector」はこんな感じです。 QRコードは読み取ってくれるようです。

これ以外も、Jupyter Notebookに切り替えて Pythonプログラムが実行できたり、

Linuxなので、環境やツールのカスタマイズ性が高いというのも魅力です。

この手のものは中国製品が先行している状況で、AIをバンドルした売り方といい、開発力が高いと感じさせられます。

以上

来年も、良いお年を。