会話言語理解を使って言語モデルを作成する

-

MSLearn

-

この学習の目的・やること

- 会話言語理解を理解する。

- 意図や発話などの主要な機能について理解する。

- 自然言語機械学習モデルを構築し、発行する。

-

会話言語を理解するために必要な3つの主な概念

- 発話(Utterances)

- ユーザーが言うこと

- (例1)「ファンのスイッチを入れて」

- (例2)「照明を点けて」

- エンティティ(Entities)

- 「発話」で参照される言葉・項目

- (例1)「ファンのスイッチを入れて」の「ファン」

- (例2)「照明を点けて」の「照明」

- 意図(Intents)

- 「発話」が意味する内容・目的・目標

- (例1)「ファンのスイッチを入れて」 → 電源ON(対象デバイスは「ファン」)

- (例2)「照明を点けて」 → 電源ON(対象デバイスは「照明」)

- 発話(Utterances)

-

会話言語理解用のAzureリソース

- Language Service(Language Understanding)

- NLP(自然言語理解)機能を備えたアプリを構築可能なリソース

- Cognitive Services

- 会話言語理解やその他を含む一般的な共通サービス

- Language Service(Language Understanding)

-

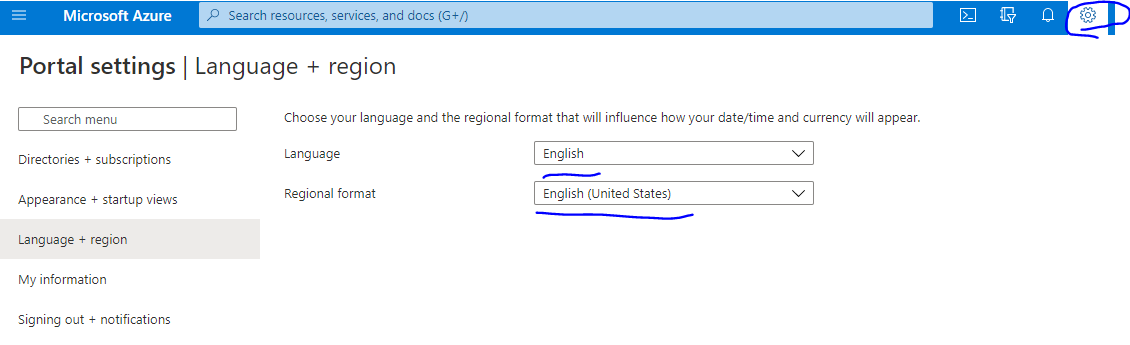

Language Serviceの作成で詰まったとこ

-

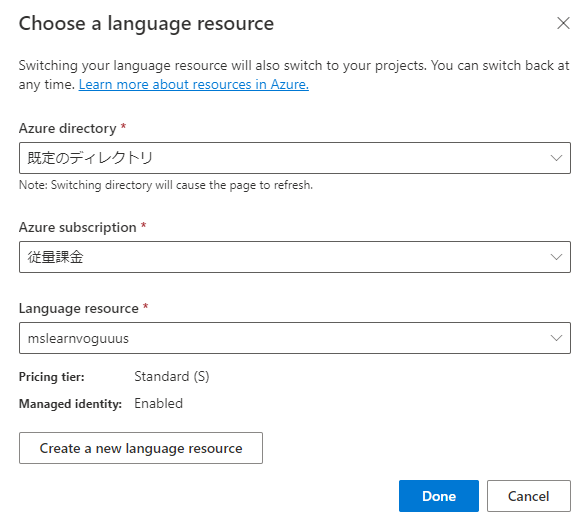

会話言語理解アプリの作成で詰まったとこ

-

intentの作成

-

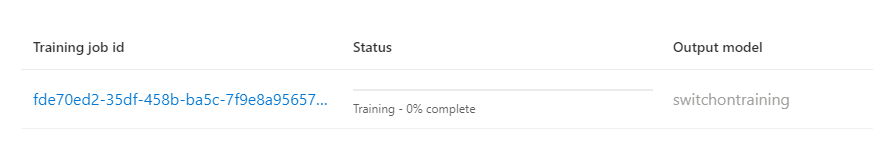

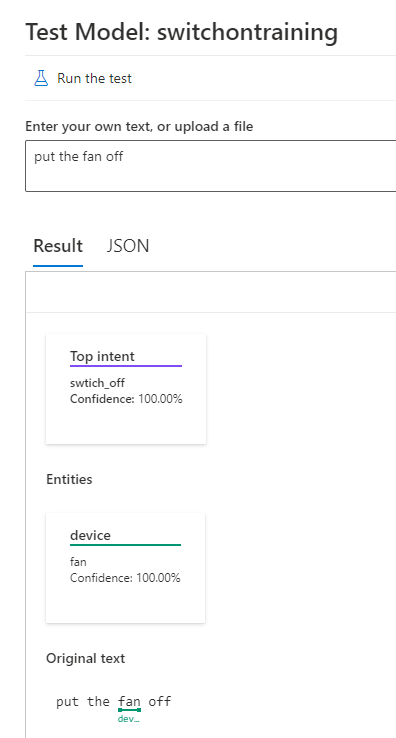

トレーニング&モデルのテスト

-

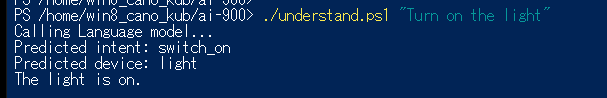

Azure Command Cloud Shellの実行

- AzureポータルからCloud Shellを実行

git clone https://github.com/MicrosoftLearning/AI-900-AIFundamentals ai-900

cd ai-900

code .

- VSCode(ブラウザ)の実行

- エンドポイントとキーに、デプロイモデルから取得したものを貼り付け

- うまくいけばソースから実行可能になる(switch offも同じようにできますね)

# ココ

$endpointUrl="YOUR_ENDPOINT"

$key = "YOUR_KEY"

- 完了

- 無事終わってよかった(英語がちょいちょい面倒だけど)