概要

- データの発生源に近い場所でデータを処理する「エッジAIコンピューティング」が注目されている

- まず、エッジAIのおおまかな概念を理解し、実際にエッジAI端末を購入して使ってみる

- 静止画像解析、次に動画解析と進めていく予定であったが、難易度が高いため今回は動体検知のデモの動作を確認する

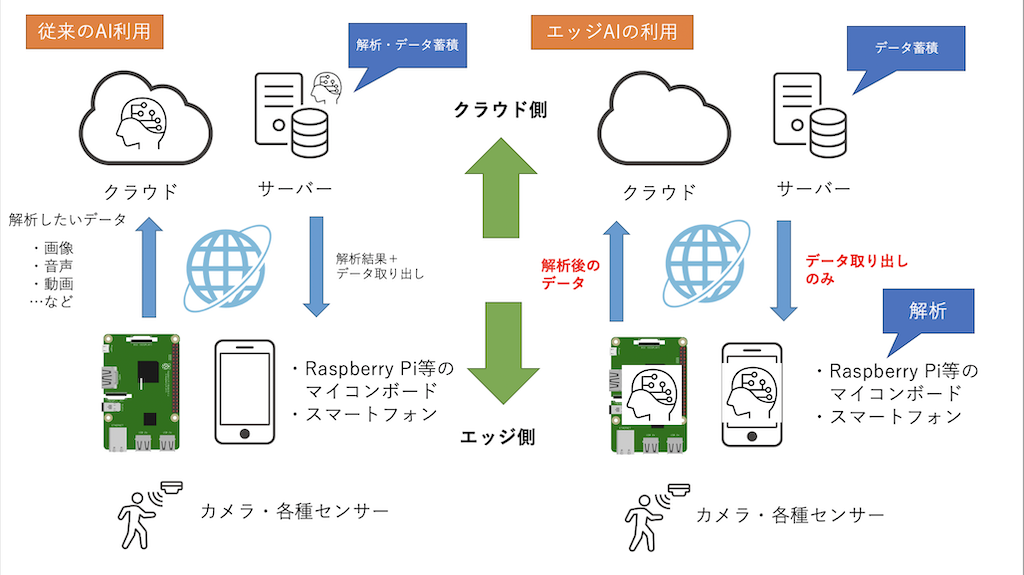

エッジAIとは何か

- 通常AI利用する場合は、センサーから収集された各種データはマイコンボードやスマホ、ネットワークを経由し

、クラウド上や従来型のサーバーで解析処理を行う - エッジAIを利用すると、センサーから収集された各種データはマイコンボードやスマホ内で解析される

用意するもの

- Jetson Nano開発者キット 2GB

- RaspberryPi4 対応 電源セット(5V 3.0A) ←Jetson Nanoにも使えます

- RaspberryPi4純正カメラ、またはUSBカメラ

- microSDカード(32GB以上推奨)

- USB接続のマウス・キーボード

- HDMI接続のディスプレイ(4K推奨)

デモ実行

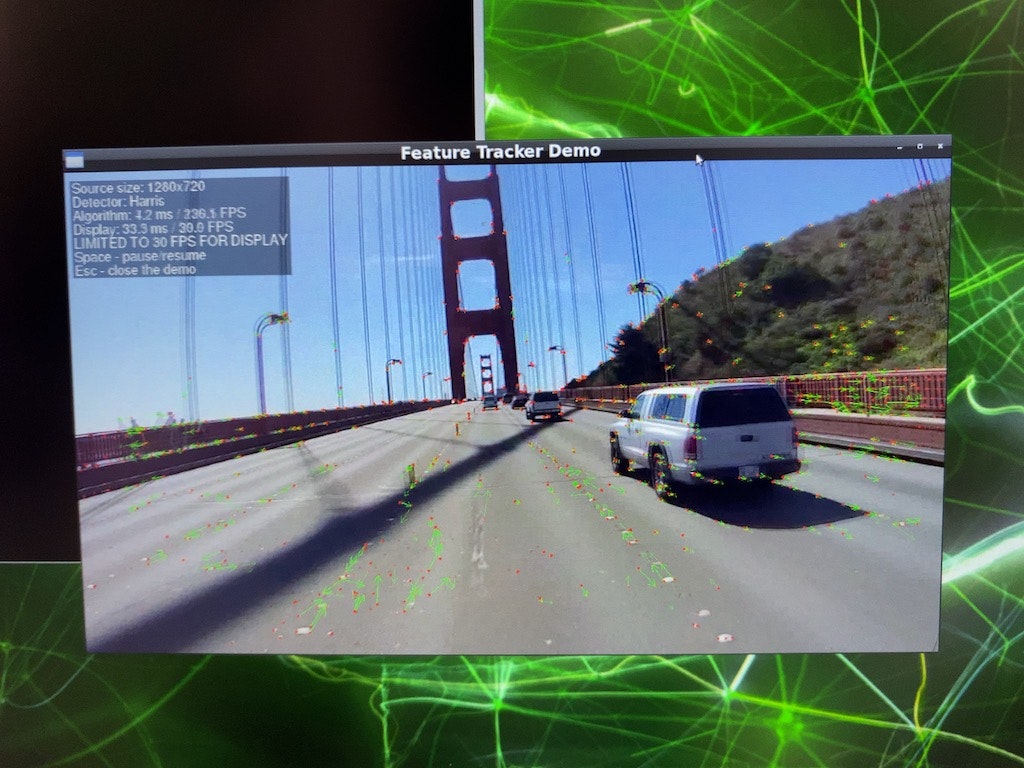

VisionWorksという、カメラ等で撮影した映像をAIでリアルタイム解析し

情報を付加するデモです。

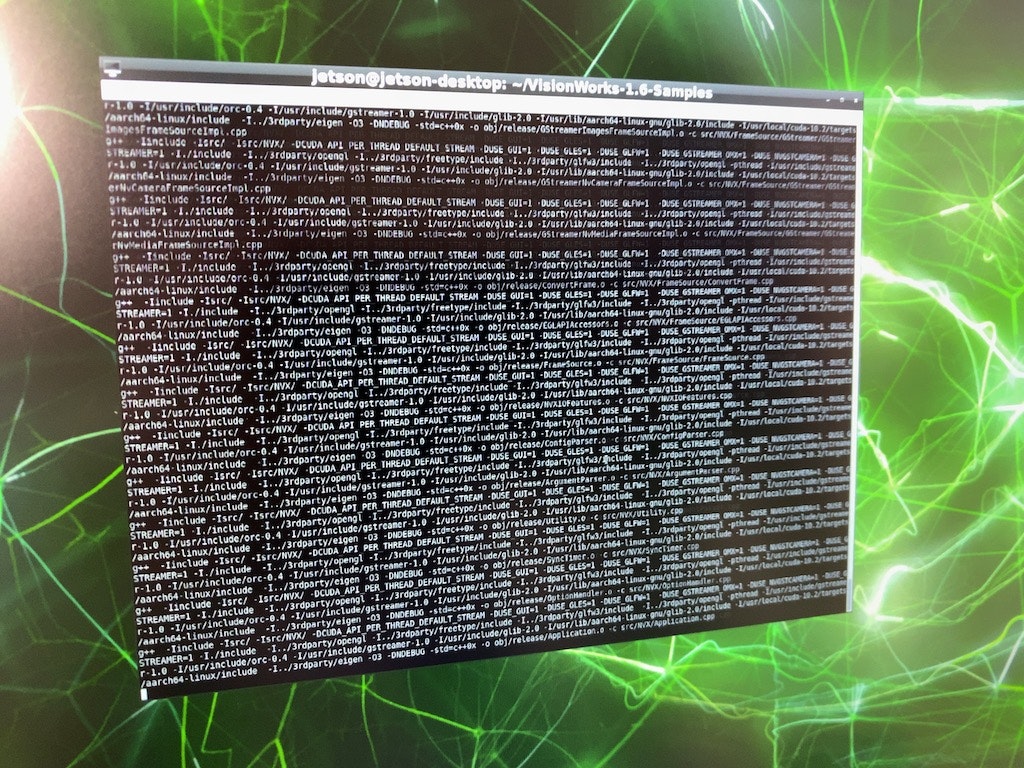

デモ環境のセットアップ

ホームディレクトリ ~/ にデモ環境をインストールする

# /usr/share/visionworks/sources/install-samples.sh ~/

ソースコードの状態なので、そのままでは実行できません。 make コマンドでコンパイルします。

# make -j4 # add dbg=1 to make debug build

makeコマンドのオプション解説

- -j4 makeコマンドをマルチプロセッサ環境で高速化する

※この場合はジョブ数が4となります

※ #以降は、コメントです

動体検知のデモが動作している様子

実行ファイルのあるディレクトリに移動する

# cd bin/aarch64/linux/release/

デモを実行する

赤点は道路やセンターライン、車、橋の柵を検出しているのが分かります

緑色の矢印は、それが移動している方向や速さを示しています。

# ./nvx_demo_feature_tracker

動体検知のデモが動作している様子

動体検知のデモが動作している様子

次回に向けて

- 自分で撮影した動画ファイルを使ってみる、できればUSBカメラを使った検出にもチャレンジしてみる

- OSの起動時にエラーが出るので、次回までには解決したい