こんにちは。この記事はARISE analytics Advent Calender 2023 20日目の記事です。

この記事では、先日行われたHAI Conference 2023で発表された論文についてご紹介します。

はじめに

私は人とAIのコミュニケーションについて関心を持っており、以前も「LLM時代に人は対話AIを信頼できるか?Human Agent Interaction (HAI) の視点から考える」という記事を書いたりしています。

この記事でも扱っている通り、人が信頼を獲得するうえで、AIに対する人の共感というのは重要な要因の一つとなります。

この「共感」という点に関しては、先日行われたHAI分野の国際会議であるHAI Conference 2023において「Session 8: Trust & Empathy in Human-Agent Interaction」というセッションが設けられるなど、「共感」の重要さが分かると思います。

このセッションの中で、特に興味のある論文がありましたのでご紹介します。

論文紹介

論文概要

【概要】

こちらの論文は中国の研究者が発表した論文となっており、中国語でのチャットボットにおける共感ベースのコミュニケーションフレームワークに関する検証とその評価についての内容となっています。

ポジティブ心理学という観点に基づいたチャットボットを利用することで、ユーザの幸福感を向上させ、ユーザが理解されていると感じられるようになったと記載されています。

仕組み

フロー

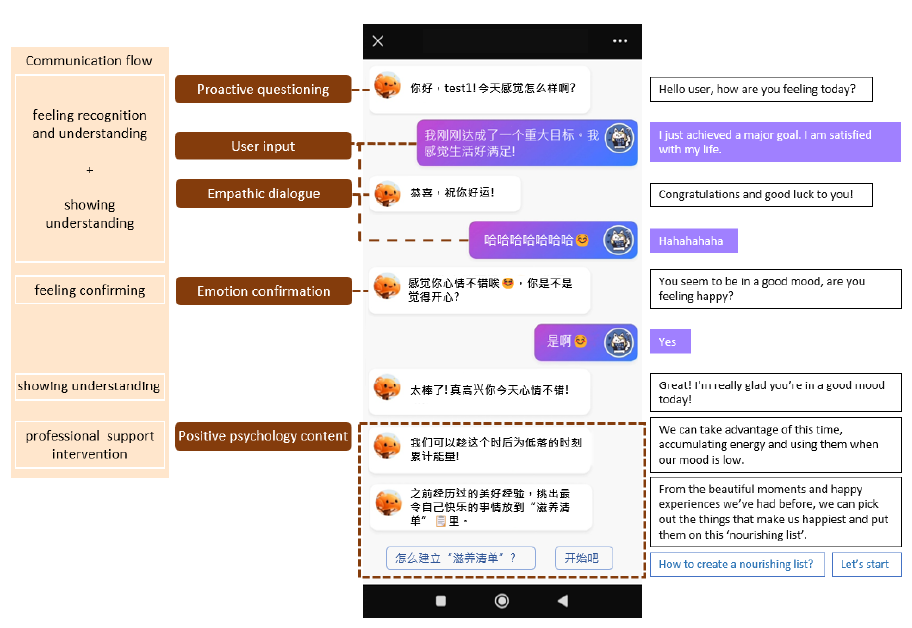

共感コミュニケーションについて、著者は先行研究を元に図のCommunication flowのような手順を構築しています。

構築されたシステムフロー (論文のFigure 2より引用)

最初の数回のオープンな対話を通じて、ユーザの感情・その原因・認知の歪みの状態を認識します。次にユーザの感情がモデルによって認識された感情と同じかを質問することで確認します。3番目に共感モデルがユーザの話題や状態に基づいて応答を生成し、最後にユーザの状態に基づいてポジティブ心理学のコンテンツをユーザに提示し、活用を促します。

使用技術

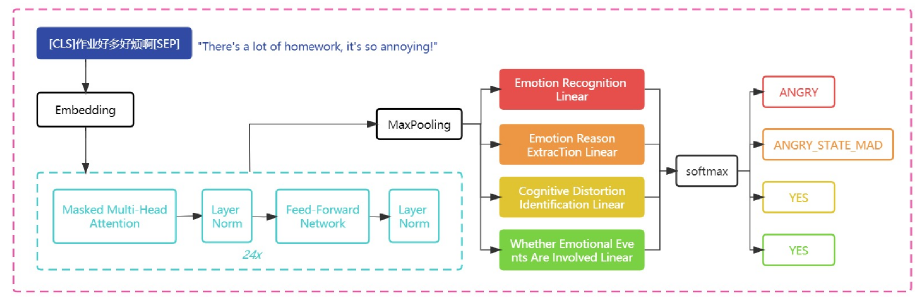

フローは主に自然言語理解 (NLU) と自然言語生成 (NLG) に分けることができます。NLUタスクは感情認識、感情の理由抽出、認知の歪み特定、感情的なイベントが関与しているかの判断が含まれ、NLGタスクは共感応答生成と肯定的応答生成が含まれます。

NLUタスクをこなすための実装は図の通りとなっています。主に中国語の事前学習済みモデルの RoBERTa-wwm-ext-largeが利用されています。RoBERTaはBERTの改良版である24層のTransformerエンコーダ構造を使用したもので、これを中国語に最適化しています。

NLUタスクフロー (論文のFigure 4より引用)

NLGタスクをこなす実装では、対話生成モデルとしてCDual-GPTを利用しています。これは会話生成に特化した中国の小規模事前学習モデルを採用したものです。

実験内容と結果

実験内容

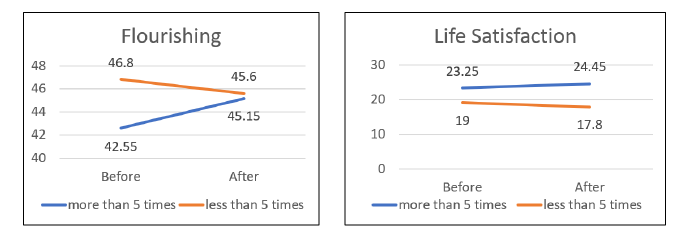

実験では、男性14名と女性11名に対してチャットボットを2週間利用してもらって実施しています。仮説として、チャットボット2週間継続的に利用すると、ユーザの幸福と生活満足度が向上するとしていました。継続的に利用してもらうため、毎日5~10分チャットボットを利用してもらっています。

結果

結果として、表のとおりチャットボットを2週間で5回以上利用すると充実度と生活満足度が統計的に有意に増加することが確認されています。

また、今後の展望として、被験者を増やして結果を再確認すること、チャットボットの技術的な改良によるよりよいフィードバックをユーザに渡せるようにすることが挙げられていました。

チャットボットの利用頻度別充実度と生活満足度のグラフ (論文のFigure 6より引用)

まとめ

本記事では、最新のAIに対する共感をテーマとした論文を紹介しました。この論文では小規模言語モデルのCDual-GPTが活用されていましたが、これは今後大規模言語モデル (LLM) に置き換わっていくのではないかと考えています。また、この論文ではメンタルヘルスをターゲットとしているように、共感というテーマは実用的なテーマとなっています。このような分野もあると知っていただけると嬉しいです。