はじめに

Elastic Stackについて触る機会があったので、メモを残します。

2017/09月時点の作業です。

Elastic Stackはログの解析・可視化等ができるものなのですが、今回その説明は省かせてもらいますので、公式等をご確認下さい。

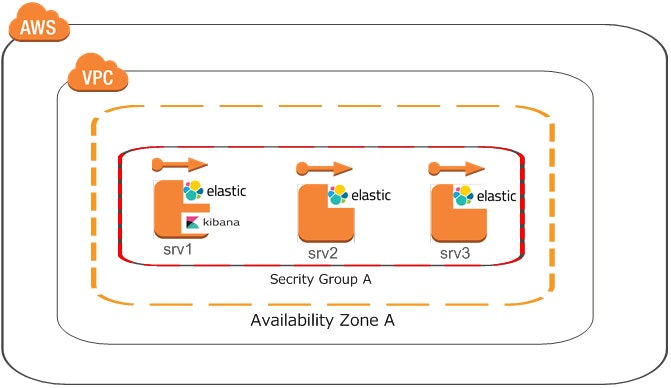

作りたい構成

AWSのVPC環境にElasticsearchを仮想マシン3台にインストールしクラスタ化します。

その後、どれか一台にkibanaをインストールしてクラスタの状態をブラウザから確認します。

AWS側の設定について

AWS側の設定は以下のようにしました。

VPC:192.100.0.0/24

VPC Subnet:192.100.0.0/27

仮想マシン:Amazon Linux

仮想マシンプラン:m4.large

仮想マシン台数:3台

srv1:192.100.0.4/EIP付き

srv2:192.100.0.5/EIP付き

srv3:192.100.0.6/EIP付き

セキュリティグループ

フルオープンはセキュリティ的に問題があるのである程度絞っています。

・仮想マシン操作用

SSH (22) TCP (6) 22 [sshアクセスするIPアドレス]

・Elasticsearchへのアクセス用

カスタム TCP ルール TCP (6) 9200 [ElasticsearchへアクセスするIPアドレス]

・Elasticsearchの内部通信用

カスタム TCP ルール TCP (6) 9300 192.100.0.0/27

・kibanaへのアクセス用

カスタム TCP ルール TCP (6) 5601 [kibanaへアクセスするIPアドレス]

それでは作ります。

構築作業

1.事前準備

1.1 java8(openJDK)のインストール(仮想マシン3台共通作業)

Amazon Linuxでインストールされているjavaのバージョンは1.7.0がインストールされていますので、1.7.0を削除し、1.8.0をインストールします。

デバッグは使うことは無いと思いますがお作法として入れておきます。

# yum -y remove java-1.7.0-openjdk

# yum -y install java-1.8.0-openjdk-devel

# yum -y install java-1.8.0-openjdk-debuginfo --enablerepo=*debug*

1.2 ElasticsearchをyumでインストールできるようにGPGキーのインポートと、リポジトリの作成(仮想マシン3台共通作業)

# rpm --import https://artifacts.elastic.co/GPG-KEY-elasticsearch

# vi /etc/yum.repos.d/elastic.repo

[elasticsearch-5.x]

name=Elasticsearch repository for 5.x packages

baseurl=https://artifacts.elastic.co/packages/5.x/yum

gpgcheck=1

gpgkey=https://artifacts.elastic.co/GPG-KEY-elasticsearch

enabled=1

autorefresh=1

type=rpm-md

2.Elasticsearchのインストールと起動

Elasticsearchをクラスターモードで起動します。

2-1.Elasticsearchのインストール(仮想マシン3台共通作業)

インストールはありがたいことにとても簡単です。

# yum install -y elasticsearch

インストール後のElasticsearchのディレクトリ状況は以下のような感じになっていました。

/var/run/elasticsearch

/var/log/elasticsearch

/var/lib/elasticsearch

/var/lib/yum/yumdb/e/e7a7bc22f961d4dd3889c0cac8f668512fe3d2c0-elasticsearch-5.6.2-1-noarch

/var/lib/yum/repos/x86_64/latest/elasticsearch-5.x

/var/cache/yum/x86_64/latest/elasticsearch-5.x

/etc/elasticsearch

/etc/elasticsearch/elasticsearch.yml

/etc/sysconfig/elasticsearch

/etc/rc.d/init.d/elasticsearch

/usr/lib/systemd/system/elasticsearch.service

/usr/lib/sysctl.d/elasticsearch.conf

/usr/lib/tmpfiles.d/elasticsearch.conf

/usr/share/elasticsearch

/usr/share/elasticsearch/lib/elasticsearch-5.6.2.jar

/usr/share/elasticsearch/modules/reindex/elasticsearch-rest-client-5.6.2.jar

/usr/share/elasticsearch/bin/elasticsearch

/usr/share/elasticsearch/bin/elasticsearch.in.sh

/usr/share/elasticsearch/bin/elasticsearch-keystore

/usr/share/elasticsearch/bin/elasticsearch-systemd-pre-exec

/usr/share/elasticsearch/bin/elasticsearch-translog

/usr/share/elasticsearch/bin/elasticsearch-plugin

2.2.elasticsearch.ymlの設定(仮想マシン毎の設定)

elasticsearch.ymlはデフォルトの設定は全てコメント化されていますので、

追加したい内容を追記すればOKでした。

追加する内容は以下です。

cluster.name [cluster-name]:クラスタ名。入力しないとデフォルトの名前になる。

node.name [node-name]:elasticsearchノードの名前。自身の識別に利用する。

discovery.zen.ping.unicast.hosts ["IPADDRESS","IPADDRESS","IPADDRESS"]:クラスタを構成する相手ホスト名をユニキャストで検索する。(3台構成なので3つ書く)

network.host: 0.0.0.0:通信許可設定。通信の制御はAWSのセキュリティグループで行う為、こちらは全許可で記載します。

上記の設定を各サーバのelasticsearch.ymlに記載します。

# vi /etc/elasticsearch/elasticsearch.yml

cluster.name: my-cluster

node.name: node001

network.host: 0.0.0.0

discovery.zen.ping.unicast.hosts: ["192.100.0.4","192.100.0.5","192.100.0.6"]

# vi /etc/elasticsearch/elasticsearch.yml

cluster.name: my-cluster

node.name: node002

network.host: 0.0.0.0

discovery.zen.ping.unicast.hosts: ["192.100.0.4","192.100.0.5","192.100.0.6"]

# vi /etc/elasticsearch/elasticsearch.yml

cluster.name: my-cluster

node.name: node003

network.host: 0.0.0.0

discovery.zen.ping.unicast.hosts: ["192.100.0.4","192.100.0.5","192.100.0.6"]

2.3.Elasticsearchの起動(仮想マシン3台共通作業)

各サーバのElasticsearchサービスを起動します。この時同じタイミングで起動コマンドを打つと、ノードの認識がうまくいかない場合があります。サービスの起動完了を待ちながら1台ずつ起動します。

# /etc/init.d/elasticsearch start

2.4.クラスタ状態の確認

仮想マシン3台の内、どのサーバでも構いませんので以下コマンドを発行し、ノードの状態を確認します。

# curl localhost:9200/_cat/nodes

192.100.0.5 8 43 0 0.00 0.00 0.00 mdi - node002

192.100.0.6 7 43 0 0.00 0.02 0.00 mdi - node003

192.100.0.4 8 44 0 0.00 0.01 0.04 mdi * node001

※クラスタ化ができていない場合は自分のノード名しか表示されません。

クラスタ化がとても簡単に成功しました。

他にもログを確認することでノードが追加されたか確認することができます。

以下のようにログが出力されます。

[2017-xx-xxTxx:xx:xx,043][INFO ][o.e.g.GatewayService ] [node001] recovered [0] indices into cluster_state

[2017-xx-xxTxx:xx:xx,815][INFO ][o.e.c.s.ClusterService ] [node001] added {{node002}{UTINV4wuTd6UfgLByoG4gQ}{E5ptnPZ0SG-xc629ayXK_Q}{192.100.0.5}{192.100.0.5:9300},},

reason: zen-disco-node-join[{node002}{UTINV4wuTd6UfgLByoG4gQ}{E5ptnPZ0SG-xc629ayXK_Q}{192.100.0.5}{192.100.0.5:9300}]

2.5.自動起動設定(仮想マシン3台共通作業)

無事クラスタ化ができましたので、Elasticsearchサービスを自動起動するよう設定しておきます。

# chkconfig --add elasticsearch

# chkconfig --list elasticsearch

elasticsearch 0:off 1:off 2:on 3:on 4:on 5:on 6:off

3.Kibanaのインストールとx-packのインストール

次に可視化ツールのKibanaをインストールします。

また、クラスタの状態をモニタリングする為、x-packを導入します。

作業はsrv1で実施しました。

3.1.kibanaのインストール

Kibanaもインストールはとても簡単です。

# yum -y install kibana

3.2.kibana.ymlの編集

kibanaは5.0.0からリモートホストからのアクセスを受け入れない為、リモートホストからの接続が必要な場合は設定ファイル「/etc/kibana/kibana.yml」の「server.host」の修正が必要です。今回はブラウザから確認したいので、修正を行いました。

# vi /etc/kibana/kibana.yml

server.host: "0.0.0.0"

kibana.ymlもデフォルトの設定は全てコメント化されていますので、

追加したい内容を追記すればOKでした。

3.3.Kibanaの起動

# /etc/init.d/kibana start

3.4.kibanaへのアクセス

ブラウザから1号機のURLにアクセスしてみます。

http://[srv1のEIP]/5601

とりあえずはページが表示されれば問題ありません。本来の目的にはまだ届いていない為、画像は割愛します。

3.5.自動起動設定

kibanaも自動起動するようにしておきます。

# chkconfig --add kibana

# chkconfig --list kibana

kibana 0:off 1:off 2:on 3:on 4:on 5:on 6:off

3.6.x-packのインストール(仮想マシン3台共通作業)

今回の目的である、kibanaでクラスタの状態を確認する為にx-packプラグインをインストールしていきます。まずはelasticsearch用のx-packをインストールします。

kibanaを停止後、x-packインストールします。

# /etc/init.d/kibana stop

# /usr/share/elasticsearch/bin/elasticsearch-plugin install x-pack

途中y(yes)の入力が必要な為、全文を乗せておきます。

-> Downloading x-pack from elastic

[=================================================] 100%??

@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@

@ WARNING: plugin requires additional permissions @

@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@

* java.io.FilePermission \\.\pipe\* read,write

* java.lang.RuntimePermission accessClassInPackage.com.sun.activation.registries

* java.lang.RuntimePermission getClassLoader

* java.lang.RuntimePermission setContextClassLoader

* java.lang.RuntimePermission setFactory

* java.security.SecurityPermission createPolicy.JavaPolicy

* java.security.SecurityPermission getPolicy

* java.security.SecurityPermission putProviderProperty.BC

* java.security.SecurityPermission setPolicy

* java.util.PropertyPermission * read,write

* java.util.PropertyPermission sun.nio.ch.bugLevel write

* javax.net.ssl.SSLPermission setHostnameVerifier

See http://docs.oracle.com/javase/8/docs/technotes/guides/security/permissions.html

for descriptions of what these permissions allow and the associated risks.

Continue with installation? [y/N]y

@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@

@ WARNING: plugin forks a native controller @

@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@@

This plugin launches a native controller that is not subject to the Java

security manager nor to system call filters.

Continue with installation? [y/N]y

-> Installed x-pack

3.7.elasticsearchのx-packのsecurityを無効化する。(仮想マシン3台共通作業)

x-packには様々な機能が付属しており、securityが有効だとちゃんと設定を行わないとKibanaが起動できません。今回の目的には関係が無い為、securityを無効化することで回避します。

# vi /etc/elasticsearch/elasticsearch.yml

xpack.security.enabled: false

※上記を最下行に追記

追記後Elasticsearchを再起動して反映

# /etc/init.d/elasticsearch restart

3.8.kibanaのx-packのインストール

Kibana用x-packをインストールします。

# /usr/share/kibana/bin/kibana-plugin install x-pack

Attempting to transfer from x-pack

Attempting to transfer from https://artifacts.elastic.co/downloads/kibana-plugins/x-pack/x-pack-5.6.2.zip

Transferring 119528829 bytes....................

Transfer complete

Retrieving metadata from plugin archive

Extracting plugin archive

Extraction complete

Optimizing and caching browser bundles...

Plugin installation complete

途中止まっちゃったかな?と思いたくなるような反応が無い時間がありましたが、気にせず放置しておけば大丈夫です。

3.9.Kibanaの起動

設定が完了しましたのでKibanaを起動します。

# /etc/init.d/kibana start

設定後のプラグインの状態とライセンスの状態がどうなっているかメモしておきます。

コマンドは3台のいずれかのサーバで実行すれば確認できます。

# curl -XGET -u elastic:changeme 'http://localhost:9200/_cat/plugins?v'

name component version

node003 analysis-kuromoji 5.6.2

node003 x-pack 5.6.2

node002 analysis-kuromoji 5.6.2

node002 x-pack 5.6.2

node001 analysis-kuromoji 5.6.2

node001 x-pack 5.6.2

# curl -XGET -u elastic:changeme 'http://localhost:9200/_xpack/license'

{

"license" : {

"status" : "active",

"uid" : "7977deb4-d253-4ef4-8fd1-bf01e1d86315",

"type" : "trial",

"issue_date" : "2017-xx-xxTxx:xx:xx.537Z",

"issue_date_in_millis" : 1506590395537,

"expiry_date" : "2017-xx-xxTxx:xx:xx.537Z",

"expiry_date_in_millis" : 1509182395537,

"max_nodes" : 1000,

"issued_to" : "my-cluster",

"issuer" : "elasticsearch",

"start_date_in_millis" : -1

}

}

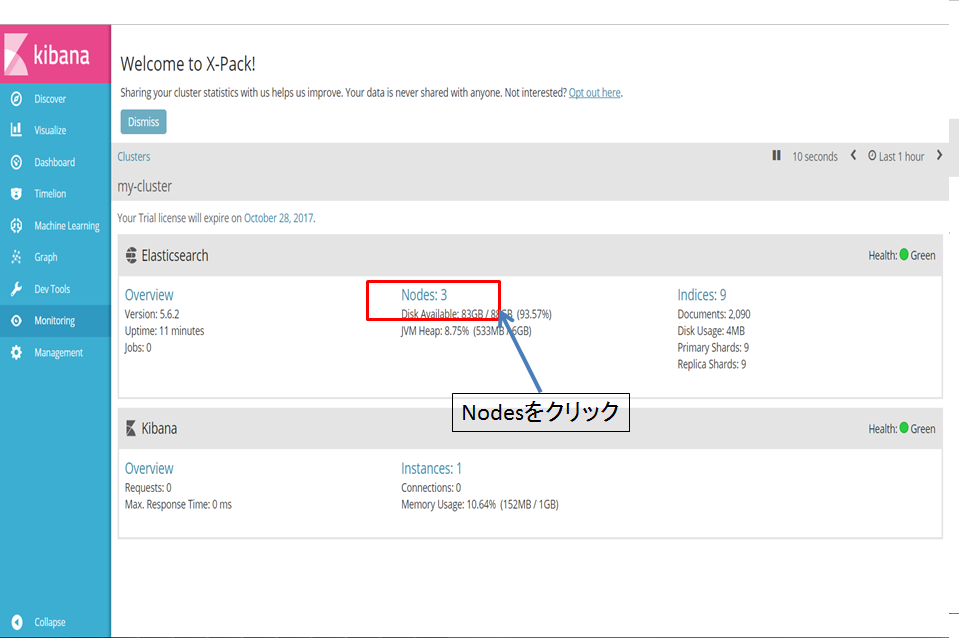

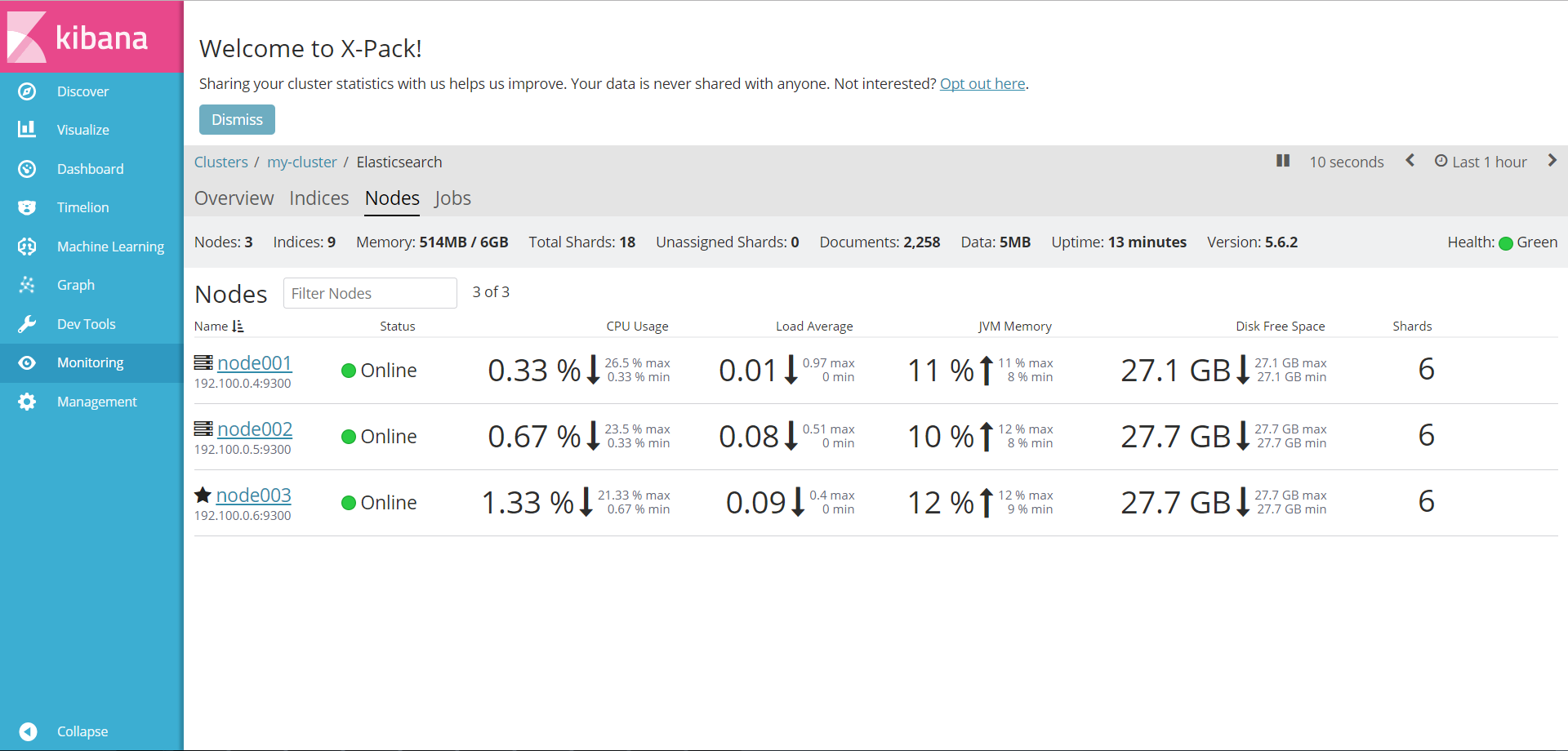

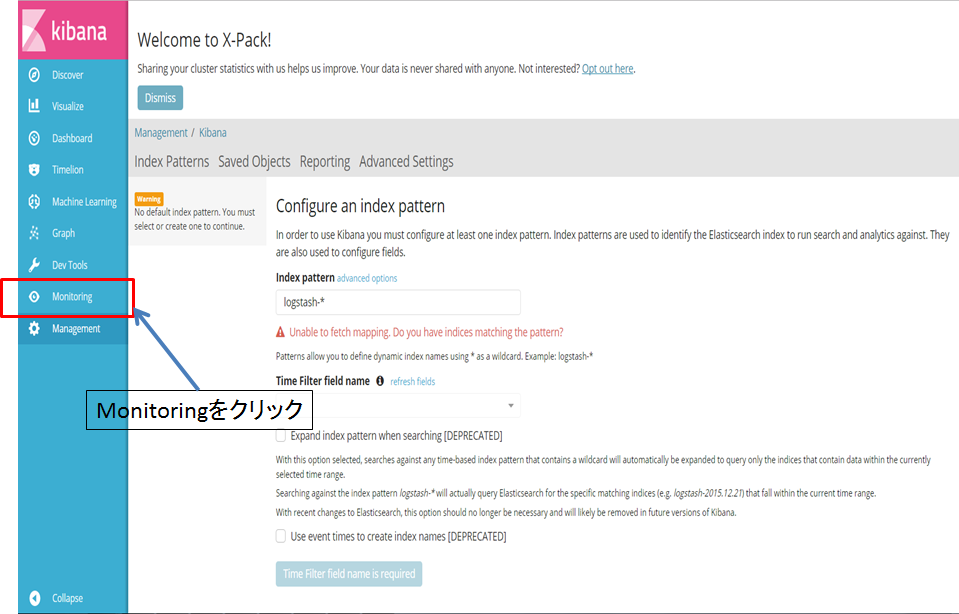

4.kibanaからクラスタ状態を確認

それでは最後にkibanaの画面を確認します。

ブラウザから1号機のURLにアクセスします。

http://[srv1のEIP]:5601

表示された画面の左ペインにある、Monitoringを選択します。

Kibanaの画面上から確認できるようになると、すごくできた感があります。

次回は肝心のログデータの取り込みなんかをメモしたいと思います。