概要

本記事は2020年4月23日に行われた【オンライン】ゆるふわマシンラーニング Vol.3の

登壇内容をまとめたものになります。

※ウフルさんのenebular developersコミュニティ主催

※ゆるふわマシンラーニングVol.3のツイートまとめ

機械学習の技術を利用して自動で作曲ができる「AWS DeepComposer」を使って、

音楽素人の私が(しかもリズム感ゼロ。笑)、作曲してみたという内容で話していきます。

AWS DeepComposerとは

AWS DeepComposerは2019年の秋頃Amazon Web Servicesから発表された

世界初の機械学習対応のキーボードサービスの総称です。

AWS DeepComposer公式サイト

専用のMIDIキーボードを利用し、入力された音を学習済みのモデルが読み取り、

新しい音楽を生成したり、ジャズやロック風にアレンジしたりできます。

※市販のMIDIキーボードでも可。後述します

いままではプレビュー版で限られた人しか使えませんでしたが、

今年の4月に一般向けにリリースされたのでさっそく使ってみました。

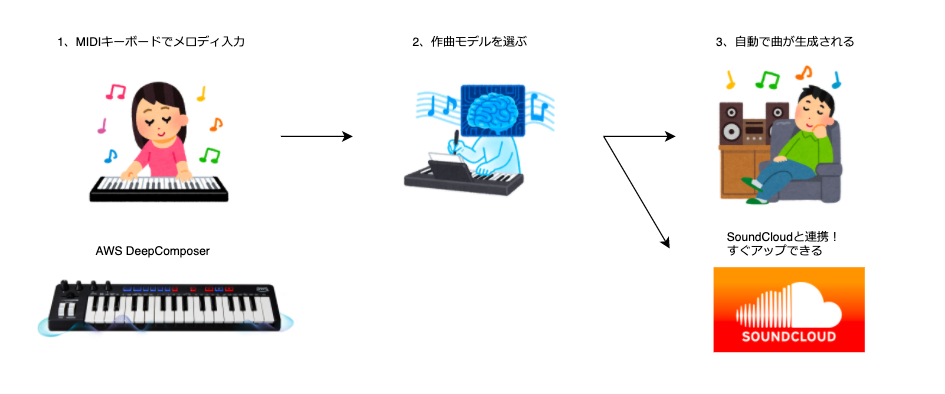

作曲の流れ

基本的な流れとしては以下になります。

①メロディの入力

②モデルを選ぶ

③曲の生成

①メロディの入力

メロディは何でも良いのですが、星野源さんの「うちで踊ろう」が話題なので、

曲を機械学習でアレンジしたら面白いだろうと考え、チャレンジしてみます。

星野源ーうちで踊ろう

沢山リクエストを頂いたので、星野さんが昨夜Instagramでアップした曲 #うちで踊ろう をこちらでもシェアしますね。

— 星野源 Gen Hoshino (@gen_senden) April 3, 2020

多くの重なりをありがとうございます。

ぜひこちらでも伴奏やコーラス、イラストやダンスを重ねてくださいね。#星野源https://t.co/fyYxaEqrXP pic.twitter.com/cS0tT7s89H

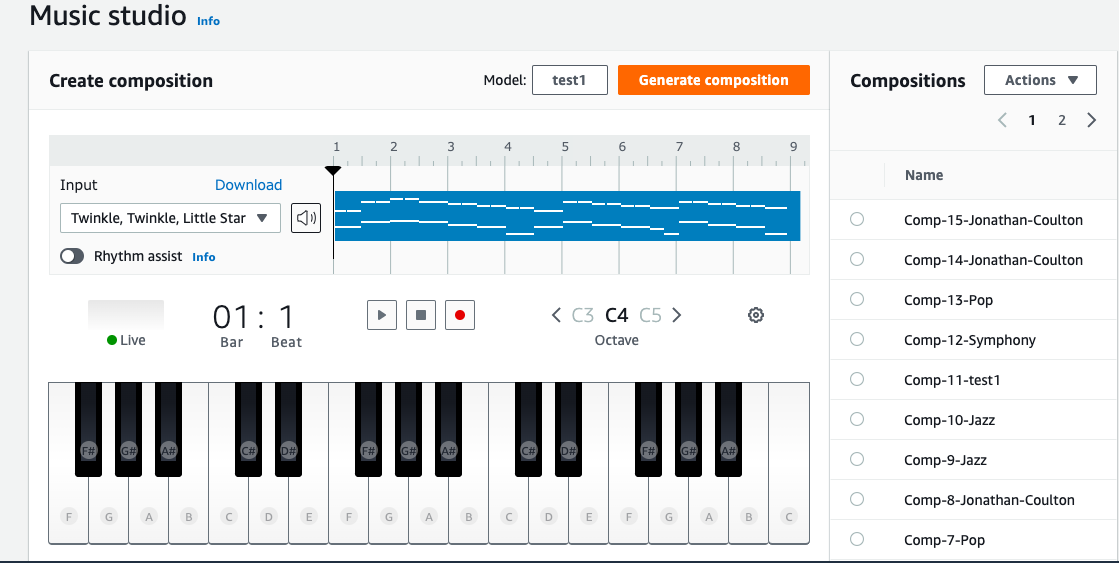

まずはAWS DeepComposerのコンソール上で

MIDIキーボードを接続してメロディを入力していきます。

AWS DeepComposerのMIDIキーボードが使えれば良いのですが、

これが日本では売っていないため市販のMIDIキーボードを購入しました。

KORG microKEY Air-37

ちなみにAWS DeepComposerのMusic studioには仮想キーボードが用意されていて、

クリックすれば普通に音が出ます。面白いですね。

このコンソール上で録画ボタンを押し、

MIDIキーボードでメロディを入力すれば①の作業は完了です。

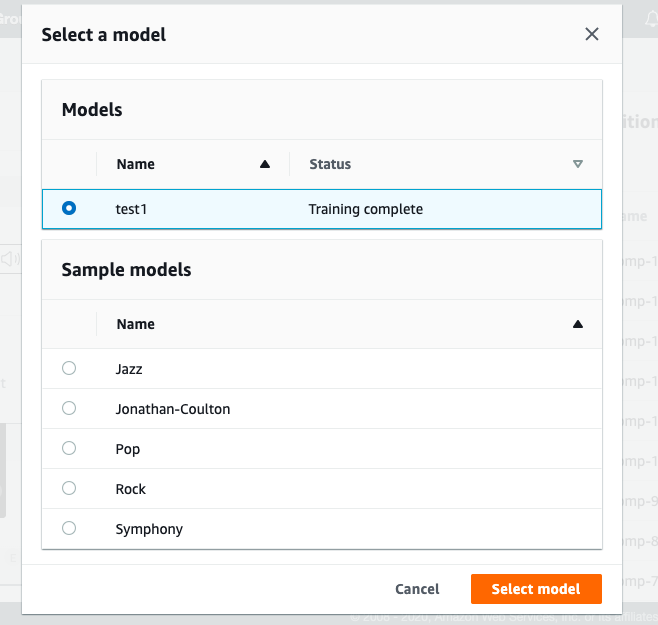

②モデルの選択

次に入力したメロディをどんな風にアレンジしていくかを決めます。

モデルには2種類あり、学習済みのモデル、または自分でモデルを作成できます。

今回はポップな感じでいこうと思い、学習済みのサンプルモデルを使用しました。

※上の段が自分で作成したモデル、下の段がサンプルモデルです。

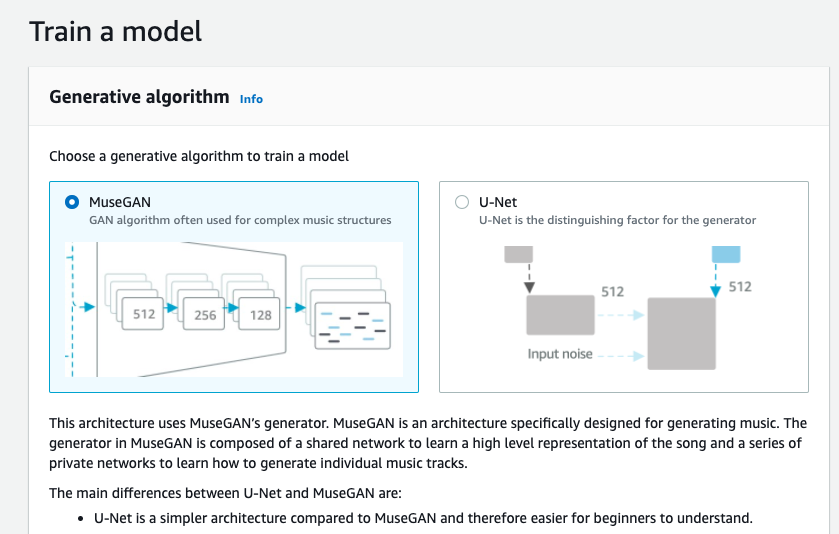

モデルを作る場合

自分でモデルを作る場合は、コンソールの「Models」からモデルを作れます。

AWS Sagemakerを使えばスクラッチでモデルを作れるそうですが、

そのあたりはまだ触れてません。今度触ったら記事にします。

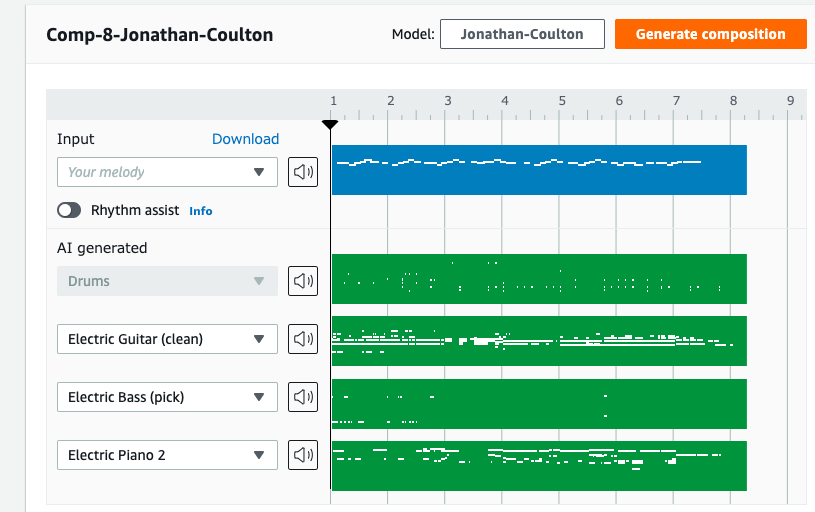

③曲の生成

曲を入力し、モデルを選択。

右上の「Generate Composition」を選択すればあっという間に曲が完成します。

AIが勝手に楽器などを選んでくれるそうで、

今回はエレキギターやベース、ピアノによって構成された曲ができました。

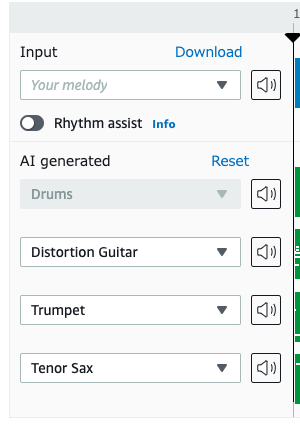

※コンソール上で楽器を変えたりもできるので、ちょっとした音の違いも楽しめます

完成した曲がこちら

SoundCloudと連携していて、すぐアップできるのでアップしました。

星野源のうちで踊ろう AI作曲Ver.

https://soundcloud.com/user-116427957/aiver

ちょっとだけ雰囲気出てますね(?)

終わり

曲聴いてもらえるとわかるのですが、まだまだ精度がいまいちな印象。

ちょっとガチャガチャしてる感じありますね。

もう少し精度上がればきれいな音になるのかな。。

私は作曲もキーボードも初心者なので、

もしかしたら音楽好きな人とかがやるともっと精度上がるかもしれない。

また、今回サンプルモデルを使用したので、

次はモデル作るところからやってリベンジしてみたい。

余談

星野源のうちで踊ろうのメロディを入力するために、

Youtubeの初心者向け講座を観ながら3時間くらい練習した。

DeepComposer上で曲を作るより、キーボードで弾いてる時間の方が長かった。笑