はじめに

先日、AWS Startupsで開催された以下のイベントに参加しました。

DeepSeek自体は触れたことがあったものの、AWSで動かすというところに惹かれて参加しました。

ハンズオンも体験できましたので、備忘も兼ねて簡単ですが記録しておきます。

(当日はWorkshopsで実施できたので、セルフホストでもお金の心配なく触れました)

LLM、DeepSeekR1について

詳細に説明していただきましたが、私の知識・説明能力では正確に伝えられないので、ベタ書きメモを貼り付けます。

・生成AIのトレンドは事前学習から事後学習のトレンドへ

・Reasoning(論理的推論)

LLMは知っている知識をしゃべるだけのところからスタート。算数や論理的推論が不得意だった。

Chain-of-Thought(CoT):LLMに中間的な推論ステップを生成させて、論理的推論能力を向上させる

Zero-shot CoT:ステップバイステップで考えようと伝える

Multi-path CoT with Self-consistency:複数経路の推論を行なってそれらの回答から最終的な結果を導く

Tree of thought(ToT):木構造のような思考プロセスで解を探索

などの手法で改良を重ねてきた

・DeepSeek-R1-Zero

事前学習済み DeepSeek-V3-Baseをベースに強化学習としてGRPOを採用

Group Relative Policy Optimization:LLMが出してくる回答をまとめて評価する、報酬モデルをルールベースで置き換えて計算効率を高めた

(強化学習の仕方が上手かった)

・DeepSeek-R1

強化学習する前に少量のコールドスタートデータ(数千くらい)と複数ステージの学習を行う

Reasoning重視の強化学習

600B

複数のタスクにおいて高度な論理的推論能力を発揮

・DeepSeek-R1-Distill

R1が大き過ぎるので、蒸留モデルで小型に

Distill-QwenとDistill-Llamaの2種類

・AWSのAI/ML向けインスタンス

TrainiumのTrnX、InferentiaのInfX

NVIDIAのP5eなど

・軽く始めるならサーバレスがオススメ

・セルフホステッドだと外部向け通信を制限できるので、DeepSeekのようなモデルでも外部流出のリスクが排除できる

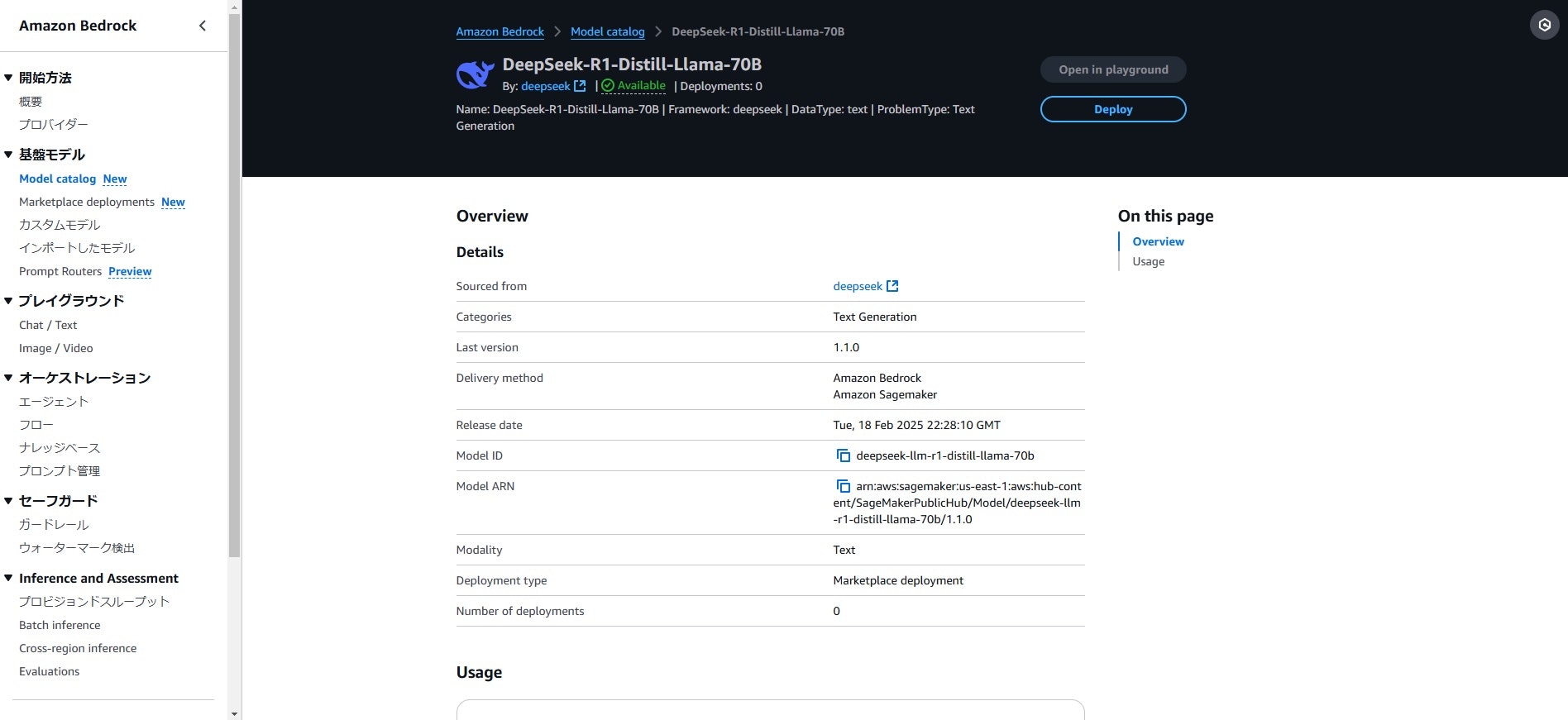

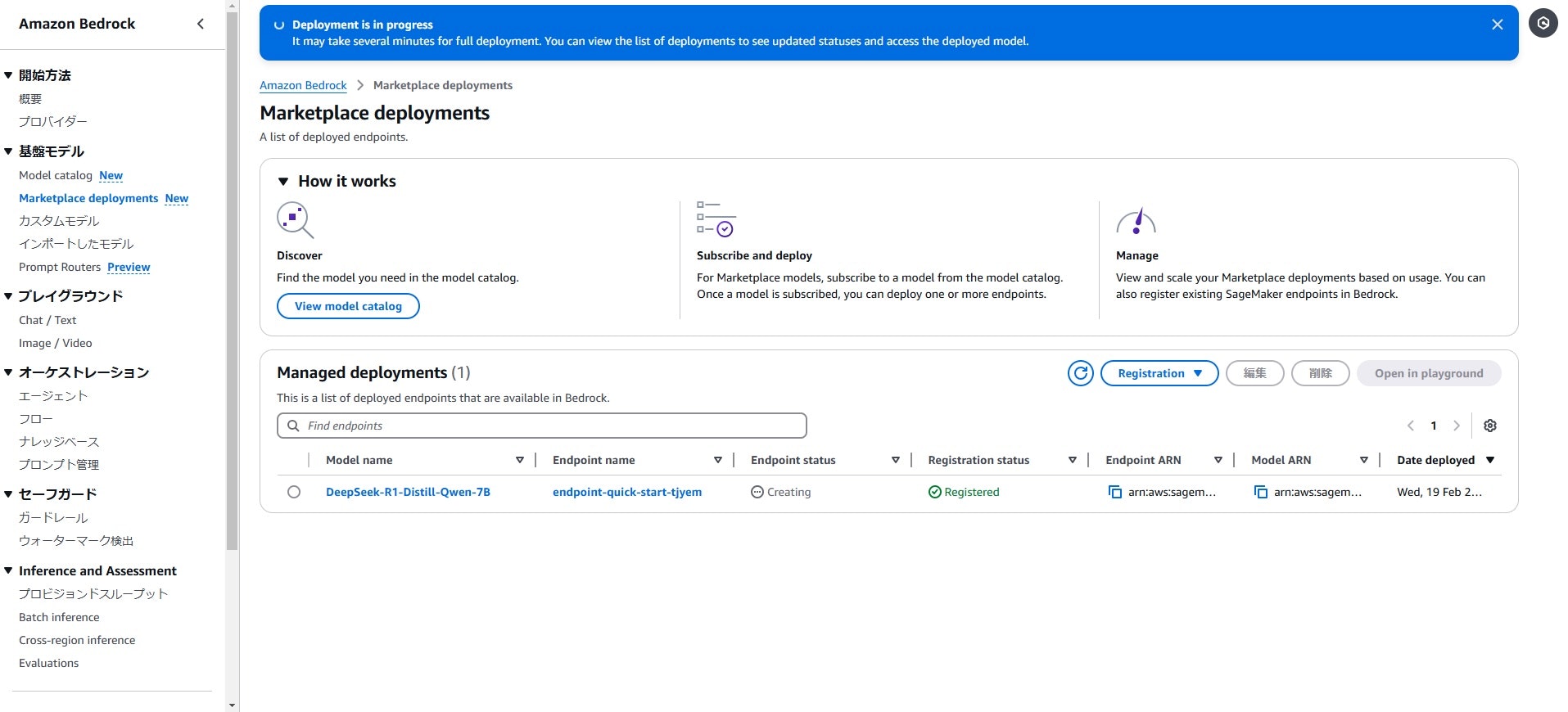

ハンズオン1 MarketplaceでDeepSeekを選んでBedrockで使う

ハンズオンの内容はこちらのGithubで共有されました。

BedrockのModel catalogからDeepSeekを検索して選択

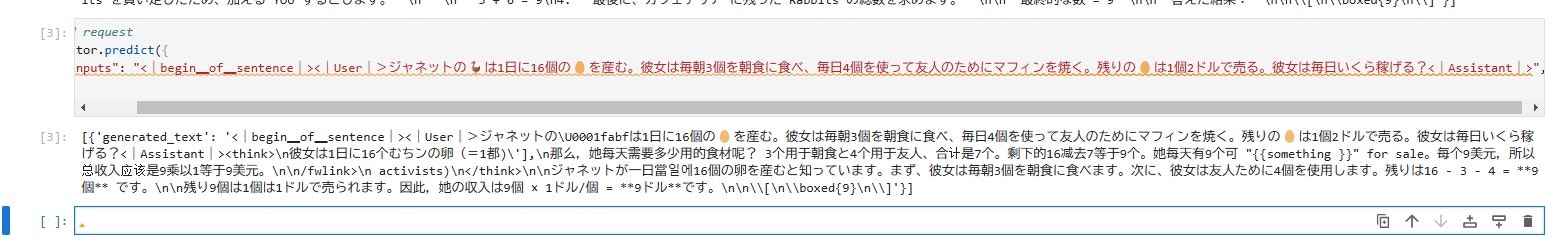

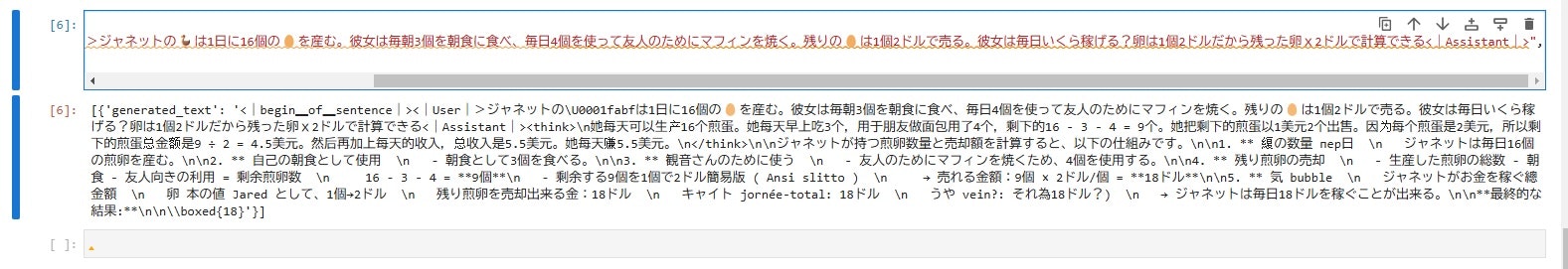

以下の形でプロンプトを組む必要があるとのこと。

<|begin▁of▁sentence|><|User|>***質問***<|Assistant|>

その後、何回かやってみましたが、いまいちな回答しか得られませんでした。

(きっと私の質問の仕方がよくない)

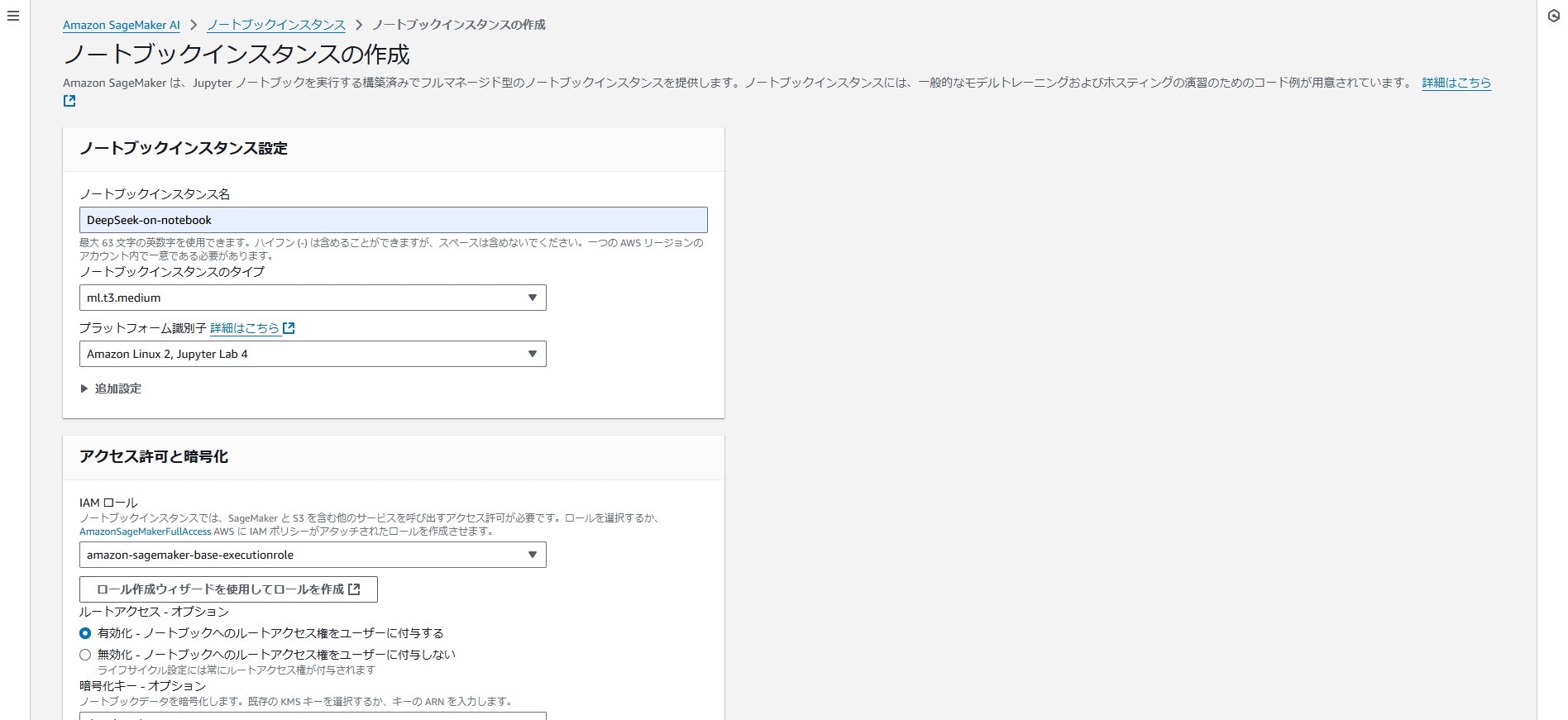

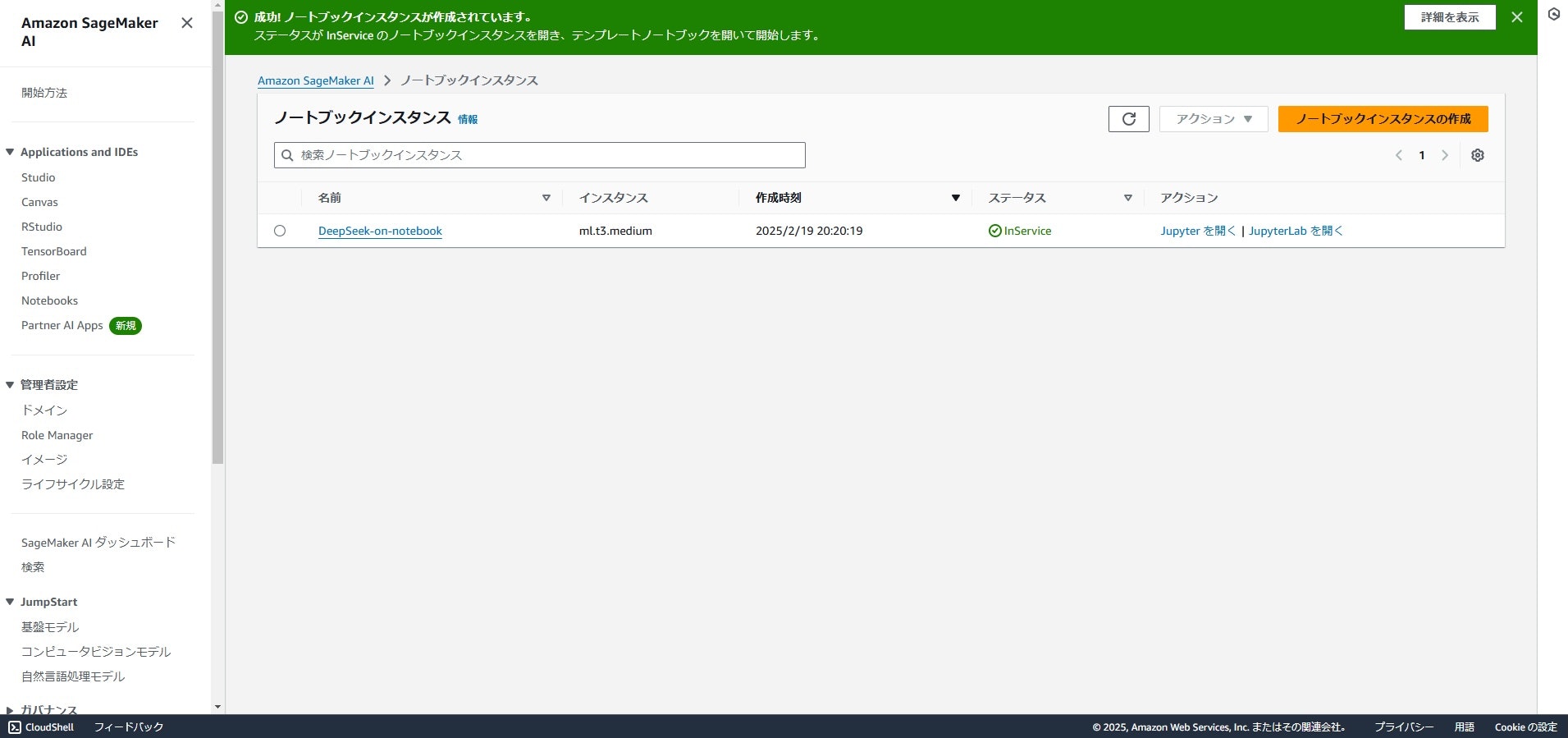

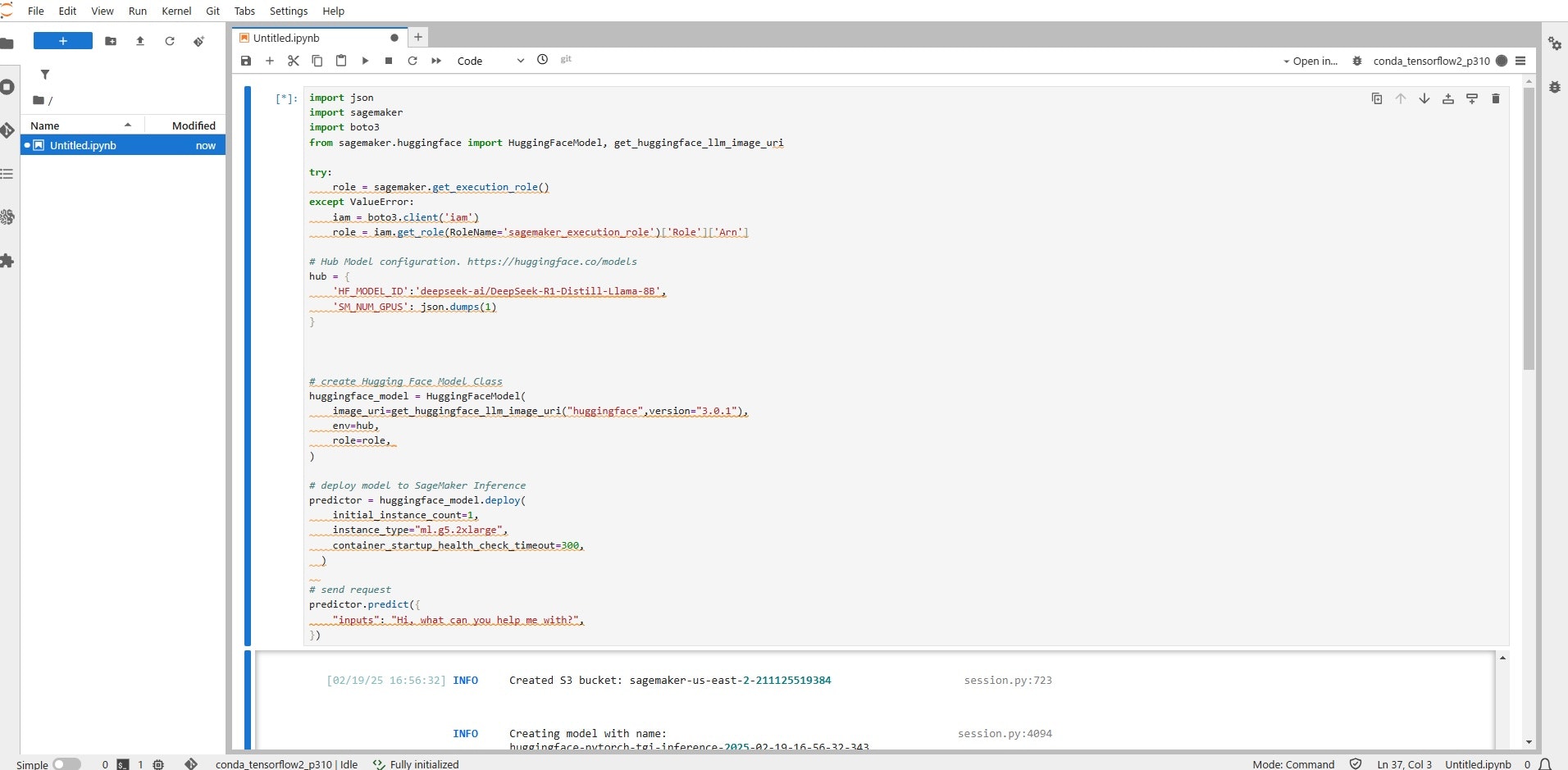

ハンズオン2 DeepSeekをSageMaker AIでデプロイして使う

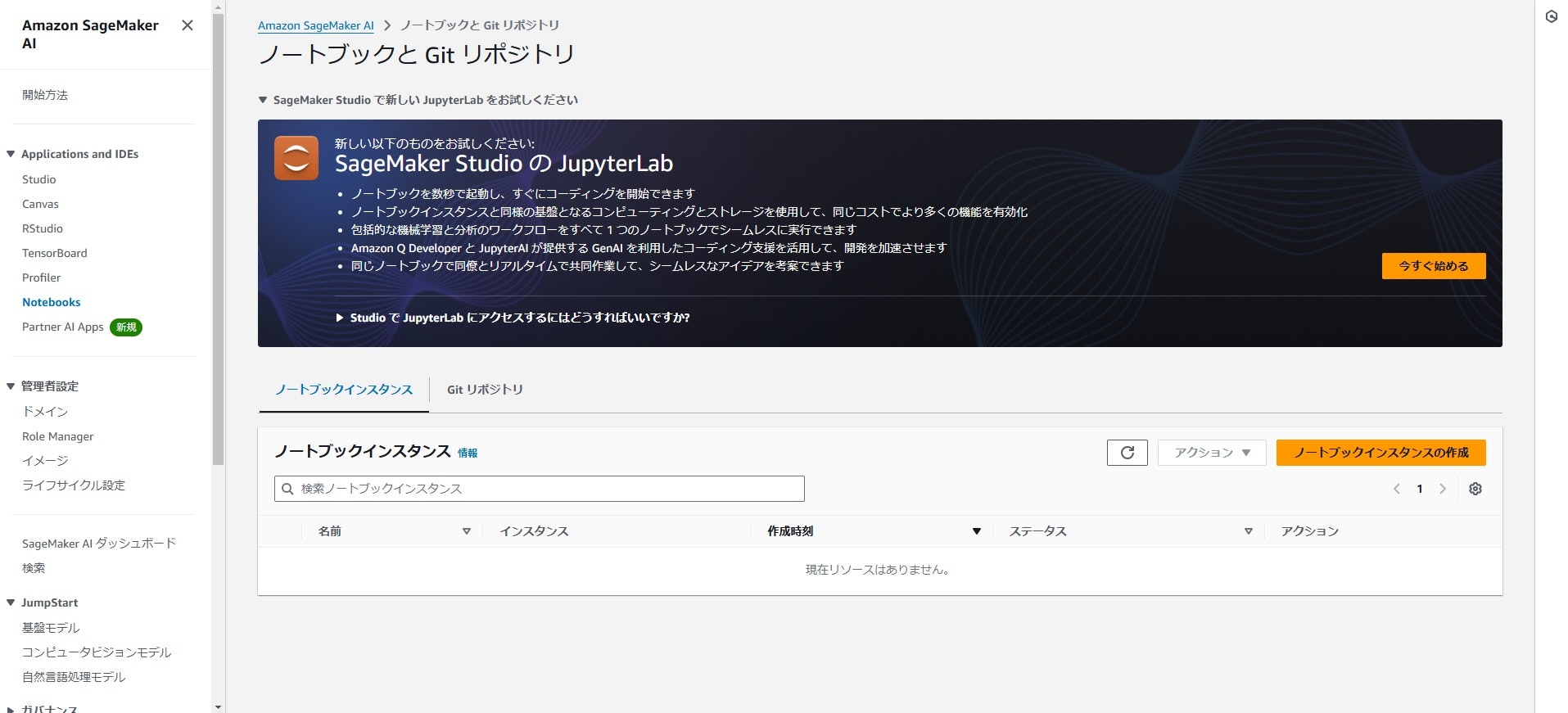

全部入りになったAmazon SageMaker AIを開いて、ノードブックインスタンスの作成を選択

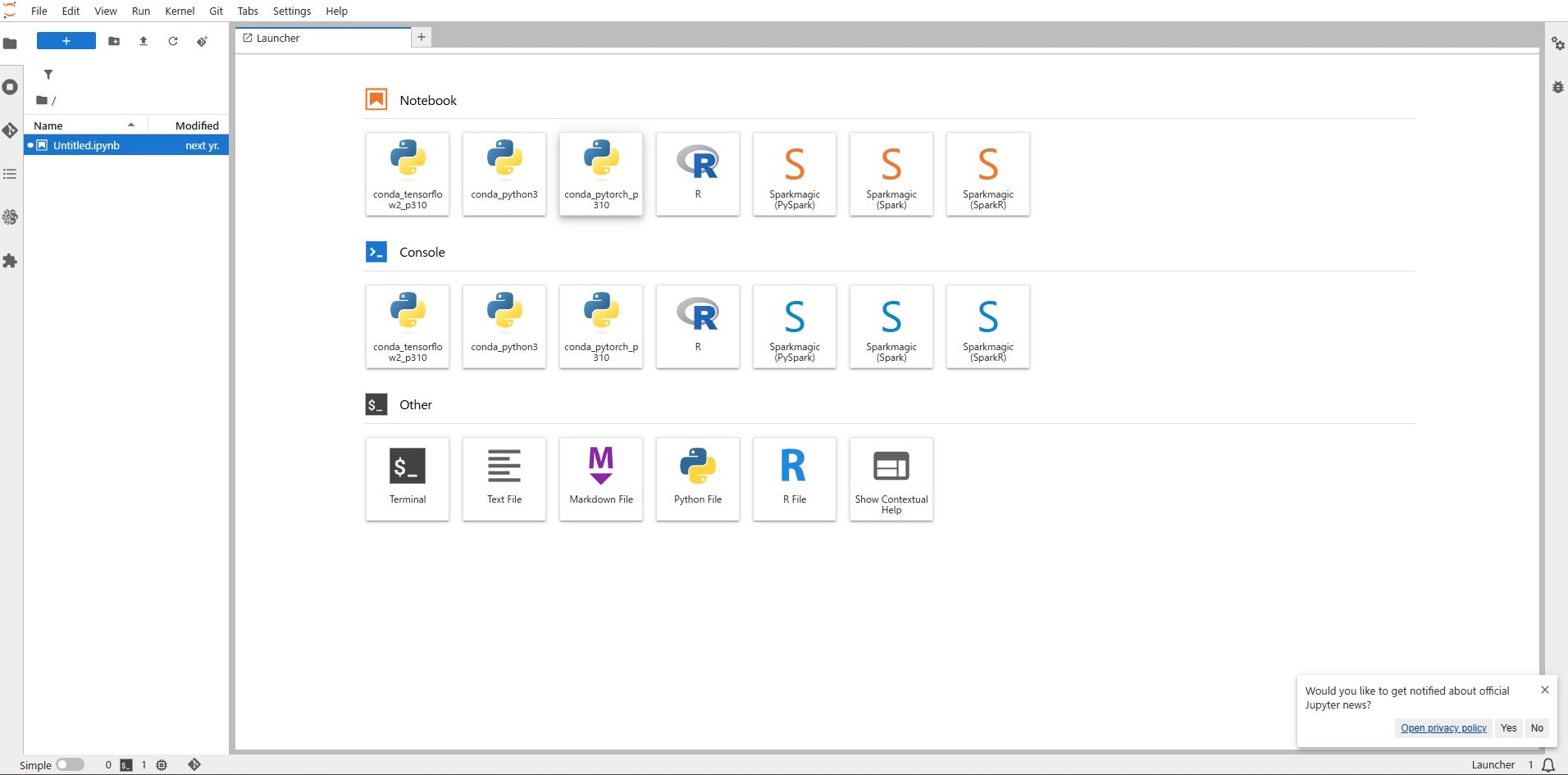

私はNotebookのconda_python3を選択して進めました

Hugging FaceでDeepSeekのモデルを探して

右側のDeployからAmazon Sagemakerを選択

(参考)AWS Inferentia & TrainiumのパターンもHugging Faceのポップアップで別ボタンを選択すれば、コードが表示されますので、先ほどと同様にノートブックに貼り付けで実行することでインスタンスを立ち上げることができました。

紹介されていた本

セッション、ハンズオンを一通り説明していただいたSAの針原さんの著書。(AWS Hero 吉田さんとの共著)

2025年5月末発売。Amazonで予約できます。

移り変わりが激しい生成AIについて書籍化することで情報が陳腐化してしまうことを懸念されていました。

(個人的には1冊にまとまっていた方が体系的に学べるので助かります)

※アフィリエイトはありません

最後に

DeepSeekということで、軽食と共にくじらビール🐳を提供いただきました。

東京・福生で作られているようです。

SAさんたちのセンスの良さに感激。ありがとうございました。

これからも、Startup Loftのイベントを定期的にチェックして参加していきます。