この記事は、MIT人工知能研究所の元所長であり、ルンバなどの製造で知られるiRobot社の共同創業者、ロドニー・ブルックス氏のブログ記事 "What Is It Like to Be a Robot?" の翻訳です。

What Is It Like to Be a Robot?

この記事は、人工知能の能力に関する現在の状況、および比較的短期の間に期待できる発展について説明するもので、連載記事の初回とするつもりである。私は、メディアの中で流行している奇妙な主張、およびAI分野内外の人々を含むAI警告者のグループに対して異議を唱えるつもりだ。この記事では、今後の議論の主要な要素のいくつかを紹介し、また同時にAIシステムが人間とどのように異なっているのかを示すことから始めよう。

記事のタイトルを見て、これはトマス・ネーゲルによる1974年の論文、「コウモリであるとはどのようなことか?」1 へのオマージュであると気付く人もいるかもしれない。最近の2冊の書籍、アレクサンドラ・ホロウィツのイヌに関する2009年の本2、ピーター・ゴドフリー=スミスのタコに関する2016年の本3も、ネーゲルの論文へのオマージュを捧げている。どちらの本にもそれぞれ「What it is like」と「What It's Like」という章があり、イヌであるとは、またはタコであるとはどのようなことかという彼ら自身の疑問に対して肯定的な回答を与えている。

これら3人の著者は皆、対象の動物に何らかのレベルの意識があると想定している。

ネーゲルは心身問題に興味を持っていた。古い、古い哲学的問題であり、古代ギリシャの時代より人々を悩ませてきた問題である。我々の心は、世界に存在する物理的物体とは非常に異なる何かであるようだ。どのようにすれば、心が何であるかを物理学的な観点から理解できるだろうか? (心に物理的実体が存在することを否定する人もいる) そして、通常の物体とはまったく異なるこの心が、どのようにして物理的な物体で構成されているように見える我々の身体や環境とインタラクションするのだろうか?

ネーゲルは言う:

意識がなければ、心身問題はあまり面白くないだろう。意識があると、絶望的であるようだ。

そこで、ネーゲルは意識を、たった今、ある特定の精神状態を備えているとはどのようなことであるかを言う何らかの方法と見なしている。特に、彼はこう述べている:

しかし根本的には、ある生物が意識をともなう心的諸状態をもつのは、その生物であることはそのようにあることであるようなその何かが―しかもその生物にとってそのようにあることであるようなその何かが―存在している場合であり、またその場合だけなのである。

そこで彼はコウモリであるとはどのようなことであるのかを想像しようとする。彼がコウモリを選択したのは、その知覚世界は我々自身のものと非常に異なっており異質であるからだ。特に、夜にはコウモリは「外界を主にソナー、あるいはエコーロケーションによって知覚する」また「コウモリのソナーは、知覚の一形式であることは明らかたが、その操作は似ておらず、我々が主観的に経験あるいは想像する何かと類似していると想定する理由はない。」ネーゲルは、コウモリであるとはどのようなことかを想像することはできないと敗北を認める。外部からコウモリを客観的に観察する手法は、我々みんなが自分自身について持っているような主観的理解には繋がらない。精神状態を備えたロボット、また自身の精神状態を認識するロボットを我々が作ったとしたら、そのようなロボットであるとはどのようなことか我々には想像できないだろうと思う。けれども、それより低いレベルでは、純粋に客観的にロボットであることを想像しうると考えている。そしてそれがこの記事のメインテーマだ。

しかし、最初に、イヌとタコに関するいくつかの疑問について簡単に触れておこう。先に参照した2冊の本の著者、アレクサンドラ・ホロウィッツとピーター・ゴドフリー=スミスが議論している通りに。

ゴドフリー=スミスは、タコとその進化論的な従兄弟であるイカの仲間に魅了されている。生命進化の系統樹の枝において、タコやイカたちと我々または他の哺乳類、鳥類、魚類、恐竜などが共有する最後の祖先は、約6億年前までに遡る。それは小さな扁形動物で、全長はわずか数ミリメートル、おそらく最大でも数千個程度のニューロンを持っていたのみであろう。進化上の分岐後、我々の側は脊椎動物となった。すなわち背骨を持つ動物である。もう一方の側は節足動物を生み出し、そこにはロブスター、アリ、カブト虫などが含まれている。そこから、ミミズ、ナメクジ、カタツムリ、二枚貝、牡蠣、ホタテ貝やイガイといった軟体動物も生まれた。軟体動物の下位のカテゴリが頭足類であり、ここにはゴドフリー=スミスが興味を持つ3種類の動物が含まれている。彼の興味は、これらの動物が示す知能によるものなのだ。

明らかに、タコやイカの知能は、鳥、トカゲや哺乳類とは別に進化した。脊椎動物の脳であれば、かなり異なる種類の動物にさえ人間の脳と進化的に関連を持つ特徴が見られる一方で、これら頭足類の脳には人間の脳との関連がまったく見られない。彼らは分散した脳を持ち、ごく小さな割合のニューロンが脳の中心的な位置を占めるのみであり、大部分のニューロンは触手の中に存在する。触手は生物本体の視野外にある物体を自律的に探索するように見え、化学的・触覚的に物体を感知し、小さな物体や食料を扱ったり捕獲したりできるようだ。しかし、もしもタコが実験環境で眼の視覚を用いて触手を移動させる必要がある (複雑な迷路で、タコの触手が利用可能な化学的シグナルを欠いているなどの) 場合、きわめて長い時間を要する。タコの中枢の脳は、自身の触手に対してせいぜいが監督的なコントロールしかできないようである。彼らは、我々とは非常に異なっているが、後で見るように、彼らが生み出す知的な振る舞いの多くは我々の振る舞いと対応付けられる。彼らの体内が実際に我々とは非常に異なっていたとしてもである。それと同じように、我々のロボットも内部の構造は我々とは非常に異なっているであろう。

ホロウィッツはイヌを研究しており、イヌにとっての世界はどのようなものであるのかを想像するだけではなく、ヤーコプ・フォン・ユクスキュル4のアイデアを取り上げている。ユクスキュルは、1864年から1944年まで生きたバルトドイツの生物学者である。彼は動物のウムヴェルト [Umwelt] について論じた。これは、ドイツ語で"環境"や"周り"を表す言葉である (文字通りには、環世界を意味する)。これは動物が感知し、存在し、行動する環境を意味している。外部の観察者、たとえば人間は、動物自身が見る世界とは非常に異なる形で、世界の中に埋め込まれた動物を見るだろう。これは、我々のロボットについても当てはまる。我々はロボットを人間と似たものとして捉え、ロボットを擬人化するけれども、彼らの知覚、行動と知能はきわめて異なったものとなるだろうし、非常に異なった形で世界とインタラクトするだろう。

私は、フォン・ユクスキュルによる別のコンセプトを常に好んできた。それはメルクヴェルト [Merkwelt] 5 であり、文字通りには「書かれた世界」を表す。生物に対して適用された場合には、生物自身によって知覚される世界を意味する。メルクヴェルトは、特定の生物のウムヴェルトの一部を成す。生物のウムヴェルトはその生物自体、生物が属する世界、生物自身のヴィルクヴェルト [Wirkwelt] (活動世界)、世界に対して生物が及ぼせる効果と、生物が世界を感知する能力であるメルクヴェルトを含んでいる。メルクヴェルトを生物自体から分離することにより、意識に (さほど) 縛られることなく議論できるようになる。

その一方で、動物のメルクヴェルトについての詳細な議論では、正確な情報を知ることが技術的に困難である。我々は動物のウムヴェルトを観察できる、少なくとも、我々自身のメルクヴェルトを用いて。けれども、動物のメルクヴェルトを理解するためには、動物の感覚器官が何を伝えるのかを理解しなければならない--またそれでさえ十分ではない。感覚的な値には、脳内の一部のみに存在し他へ伝達されない値が存在する場合もある。我々は動物の生理学を学び、動物の感覚器官がどのような種類の情報を伝えているのかを推測して、ラボ内で実験環境を設定しその領域で何が感知されるのかの範囲をテストできる。それでも、ある特定の感覚刺激について、動物が気付いていても気にしていないだけなのかどうか (行動主義的な意味で。もしも、我々が意識を考慮しないならば) を知ることは難しい。その後で動物が感覚データを処理する方法を知る必要がある。この記事の後で人間の事例を示すつもりだが、人間がどのように世界を感知するかという我々自身の直感、我々のメルクヴェルトも、しばしば非常に誤っている場合がある。

ロボットについては別の話である。我々がロボットを作るのだ! そのため、どのようなセンサがロボットに搭載されているか、それらのセンサの範囲と、センサ出力のデジタルビットのフリップを発生させる入力は測定可能である。また、ロボットの配線とプログラムをトレースして、機械的、電気的、計算的にロボットのどの部位へとセンサ値が送信されるのかも測定可能である。理論上、ロボットのメルクヴェルトには完全にアクセスできる。動物のメルクヴェルトについて (あるいは、実際には我々自身についてさえ) は、ほとんど何もできることがない。けれども、ロボットに使用される可能性のある新たなAI技術は、ロボットのメルクヴェルトの解釈について新たなレベルの不確実性をもたらす-それらは我々が考えるほどの透明性はない。すぐ後で、完全なウムヴェルトについての問題に戻るとしよう。

この記事で、私はロボットのありうる複数のメルクヴェルト (あるいはメルクヴェルテン) について語りたい。まず最初にいくつかの動物のメルクヴェルトについて議論し、それらが我々人間のメルクヴェルトとどのように異なっているのかを説明し、そしてロボットへと議論を拡張したい。また、ネーゲルのアドバイスを受け入れて、私はこの議論から意識の概念をほとんど除外するつもりである。ネーゲル、ホロウィッツ、ゴドフリー=スミスとは逆に。しかし、しかし、意識は話に忍び込み続けてくる。というのは、意識だけが思考について思考するための唯一の方法であるからだ。そこで私は最初に少しだけ意識について語るつもりであるが、すべりやすい油で被われた哲学的な坂道を無限にすべり落ちていくことは避けようと思う。

動物の意識についてのコメント

意識が何であるかは神秘的な問題である。意識は、宇宙における基本的な性質であるのだと主張する人もいる。ちょうど、質量、エネルギーや時間が基本的性質であるのと同じように。私は、これは考えにくいと思う。というのは、他のあらゆる基本的性質は、何らかの形での相互作用が観察される。ところが、我々はサイコキネシス的な事象の兆候を (映画以外では) まったく観察できない。つまり、意識が、意識を含む身体外の何らかの物体に直接的な影響を与えるような事象である。私は、意識が基本的性質であるという主張に強く懐疑的である。特定の動物がその身体と神経系を含めて統合された場合に生じる創発的な性質であると思う。

それでは、誰が、あるいは何が意識を持つのかを話そう。我々が、意識を持っていると絶対的に確信できるのはただ自分自身についてだけである。我々各々に意識があることは確かだが、他の人にも、ましてや動物にも意識があると確かめることは難しい。けれども、あなたが、読者であるあなただけがこの世界で意識を備えた唯一の人類であるということは、極めてありそうもないように思える。そこで、ほとんどの人は、不承不承ながらも私も意識を持っていなければならないと認めるだろうと思う。ひとたびすべての人間が意識を持っていると認めた場合には、もしも人間だけが意識を持っていると信じたいとしても、我々は段階主義的な議論に直面することになる。人間だけが意識を持ち、ネアンデルタール人はまったく持っていないということは本当にありえるだろうか? 人間はネアンデルタール人と交雑しており、我々の大多数が今日ネアンデルタール人のDNAを保持している。ネアンデルタール人たちは、人間にとっては単なるステップフォードの夫婦たちに過ぎなかったのだろうか? そして、もしもネアンデルタール人が意識を持っていたとしたら、おそらく他の多くのホモ属の種にも意識があっただろう。では、類人猿たちはどうだろうか? このオランウータンの手品に対する反応を見て、この存在が自分自身についての感覚を、主観的な経験を、人類が感じている感覚を一切持っていないということがありうるのかを自問してみてほしい。そこで、私はオランウータンも意識を持っていると認めなければならないと思う。それでは、この議論はどのくらいまで拡張できるだろうか? また、その意識はどのような形だろうか?

タコは何らかの形で意識のようなものを備えているのだろうか? タコは我々とは別に進化し、非常に異なる脳構造を持っているのだ。

タコは、脊椎動物を実験環境で訓練するのと同じように、多くのことについて訓練できる。迷路を解いたり、食料のためにレバーを押したり、2通りの既知の環境を視覚的に認識して適切に反応することができる、など。更に興味深いのは、世界中の多数の異なるラボから報告されたタコの振る舞いについての逸話的な物語であろう。タコは、特定の人に向けて水槽から水を噴き出させると知られており、1回の噴出で半ガロン [約2リットル] もの水を掛けて人間をずぶ濡れにすることもある。ある事例では、特定の人を定常的に攻撃する特定のタコがいて、別の事例ではラボへの新しい訪問者を攻撃するイカもいる。それゆえ、アリとは異なりタコは人間を個人として識別し反応しているということだ。タコは、ある程度のタイムスパンにわたって人間を個人として認識できるようである。しかしそれ以上に、タコは脱出の名人である。タコは水槽の壁をつたってタコのためのものではない食料を盗むことがある。また、少なくともある1つのラボでは、タコは電球に向けて水を噴き出してショートさせることを習得したという。ラボで働く人たちが繰り返し報告するところによると、タコの脱走、盗み、電気の破壊は、事前警告なしに、ちょうど彼らの注意がタコから逸れ、別の方向を向いているときに発生するのだそうだ--どうやらタコは人間の視線方向を推定できるらしい。人が水中でスキューバマスクを着用しているときにも、あるいは陸上において視界が遮られていないときにも。タコと一緒に働く人は、タコに知能があることを観察する。野生環境では、ゴドフリー=スミスはタコの個体を追いかけ、タコが15分間も食料を探して広い範囲をさまよい、そして食事が終わると一直線に自分の縄張りへと戻っていくことを報告している。また、別の実験者からの報告としては、水槽中に捉われたままで居続ける魚とは異なり、捕獲されたタコのあらゆる振る舞いは水槽の限界を試そうとするものであるように見え、周囲の人間たちは、タコは自身が捉われていると知っているように見えると述べている。

けれども、これらすべてのタコの観察は意識の存在を示しているのだろうか?

ネーゲルは、もちろん、意識の定義に苦闘している。コウモリ論文で、彼は意識の主要な要素として主観的経験という用語を考案して問題を解決しようと試みており、次にそのような種類の経験について語っている。主観的経験という用語でネーゲルが意図しているのは、そのような経験をした生物がどのように感じるかである。

外部の者は、対象の生物がとある経験をしたという客観的な現実を観察できるかもしれないが、しかしそのような観察は対象の生物がどのように感じているのかという理解をもたらさない。

我々人間にとっては、他人の経験がどのように感じられるのか、ある程度理解し共感することが可能である。家具が据えられた広い部屋を歩き回ったら自分がどう感じるかを知っており、そのため他の人がどのように感じるかも分かる… ほとんどの場合には。我々は眼が見え、そして他人は盲目であったとしよう。彼らが舌打ち音でエコーロケーションをしている場合には、彼らがどのように感じているか、どのように部屋を体験しているかを知ることはずっと難しい。我々自身の体験からさらに遠ざかるにつれて、他の生物にとって何らかの経験がどのように感じられるのかを想像すること、ましてや知ることは非常に難しくなる。最終的には、その生物が何かしらを感じているのかどうかを客観的に判定することすら困難になる。

ネーゲル、ホロウィッツ、ゴドフリー=スミスはそれぞれ、対象の動物に何らかの形の主観的経験が存在すると主張している。

ゴドフリー=スミスは、痛みを認識しているように見える動物とそうでない動物を区別する。昆虫も深刻な受傷を負うことがあるが、受傷部位が機能を保っているかのように、また傷にまったく気付いていないかのように自身が関与していた行動を何とか続けようとする。対照的に、タコは魚に噛まれたときには飛び跳ねるように逃げ、より深刻な傷には注意を払い、受傷した領域を保護しようとする。ゴドフリー=スミスにとっては、これが痛みに対する認識の閾値である。彼は痛みを引き起こすと想定される化学物質を注射されたゼブラフィッシュが、環境選択の好みを変え、水中に鎮痛薬が含まれた環境を好むことを指摘している。ゼブラフィッシュは痛みを低減するために行動を選択するのだ。

しかし、エピソードを覚えておく能力も存在するだろうか? (エピソード記憶と呼ばれる) 出来事の連続としての過去の経験、その中には自分自身も含まれ、そこで次に何が起こるかを推測する能力もあるのだろうか? あるいは、周囲のメンタルマップを構築し、自分が今どこにいるのか、自分が行きたい場所へ行く方法を計画する能力は? ごく小さな能力の集合全体が合わさって、我々に主観的経験をもたらすのだろうか? そうであるならば、多くの動物もそれらの能力を人間と共有しているように思える。

イヌは、何らかの形のエピソード記憶を保持しているように見える。何年も会っていない他のイヌや人間と再会したときに過去のパターンを繰り返したり、散歩に連れていってもらえるのか、あるいは好みでない場所 (たとえば獣医など) に連れていかれるのかが分かるようだ。またイヌは、友人たる人間の振る舞いを認識でき、人間が世界の中で確立された一連の振る舞いを続けていくにつれて、自身の短期的な未来の感情的な状態がどう変化するかを予測できるようである。たとえばイヌは、友人たる人間が「旅行のための荷造り」とみなせる行動に従事していると気付くかもしれない。そして、自身が孤独な感情状態になることを予期し、その人の行動により不安を感じるかもしれない。

その一方で、あらゆる大型類人猿 (我々人間も含む!) とは異なり、イヌは自身を鏡で見たときそこに自分が写っていると認識しない。つまり、それら類人猿と同じ感覚では自己を認識していないように見える。しかし、イヌは世界のなかで自分が行動の主体性(エージェンシー)を持っていると認識しているのだろうか? 確かにイヌは自分の感情を隠すことがあまり上手ではなく、そのため彼らは明らかに感情を持っているが、人々の前でどのような振る舞いを示すべきかというある種の礼儀の感覚を備えてもいる。私の愛犬は、決してテーブルの上に登ることはない。彼女は、椅子やソファやベットには上がるが、しかしテーブルには上がらない。庭師が私の家の周りで芝生を刈っていたとき、私の愛犬はガラス戸からガラス戸まで走り、非常に怯えて吠え、家の周囲でのそれぞれのループの進捗状況を確認し、次に庭師がどの方向から現れるのかを予期しようとしていた (おそらく、かなりエピソード的な記憶がある!) そしてある日、スティーブが我々に伝えてくれたことによると、私が家を不在にしていて彼が芝生を刈っていたとき、私の愛犬は常時キッチンテーブルの上に登り、スティーブに向かって狂ったように吠え、彼が家の東側から南側へと移動するのを見ていたという。彼女は、我々の前でするべきでないことを知っているが、しかし我々がいないときには彼女の感情は抑圧されず、自分の望みのままに振る舞った。これは主観的な経験であるように私には思える。

全体として、イヌは我々と同じレベルの意識を示していないように見える。つまり、主観的な経験、自己の感覚、我々の人生のエピソードを想起する能力と、未来において我々が感じること、経験することを想像し、何か特定の出来事が起こると予期することである。

私は、これまで人間によって作製されたいかなるAIシステム、いかなるロボットであっても、初等的な意識を持っていたり、あるいは主観的な経験を持っていたり、ましてや自己についての感覚を備えているものは存在しないと確信している。この理由の1つとしては、ほぼ誰もこの問題に取り組んでいないからだ! 2つの理由により、意識を持つロボット、あるいは意識を持つAIシステムの作製に対する助成金は存在しない。まず、ロボットの性能という観点から、ロボットが意識を持っていることが果たして有益なのかという確固たる疑問に対して誰も回答を与えていないから (私は注意深く意義を唱えたい-それは巨大なブレイクスルーとなりうるだろう) であり、次に、誰もどのように意識を作るのかという本当のアイデアを持っていないからだ。

この記事の後半で、私はSLAM問題 (地図の作製に関するもの) を取り上げるつもりだが、その問題は過去30年以上にわたってロボティクス分野で大きな成功を収めている。SLAMはただ1人あるいはただ1つの研究者グループによって解決されたのではない。本当の進歩が始まったのは、全世界の何百人という研究者が共通の定義された問題に取り組み、20年以上にわたって大きく焦点を当てて研究を続けた後である。現時点において、意識を備えたロボット研究にはごく一握りの研究者しかおらず、共通の定義も目的も、進歩へ向けた本当の道のりも存在しないのだ。それだけでは進歩は起こらない。

人間の無意識に関するコメント

上で議論した通り、動物も意識の何らかの側面を示すことは確かだが、動物が我々と同様の生き生きとした経験をしていることを証明する本当の根拠は得られなかった。けれども、我々は優れているとあまりにも傲慢になる前に、人間にとってさえ意識は本当には必要のない余分な贅沢品 (あるいは呪い) であるのかもしれないと思い起こす必要がある。

ゴドフリー=スミスは、見ることはできるものの、見えているという意識的体験を持たない女性の事例を取り上げている。この状況は盲視として知られている。ゴドフリー=スミスは、非常に専門的な書籍『Blindsight』6 で、更に古い患者についての先行事例が報告されていることに気が付いていないように見える。しかし、ゴドフリー=スミスは簡潔なまとめを作っているため、ここでは彼が取り上げた事例に従い続けよう。

この患者はDFと呼ばれた女性であり、1988年に一酸化炭素中毒で脳障害を負った人物である。

事故の結果、DF自身はほとんど盲目であると感じていた。彼女は、視野内の物体の形や配置についての経験をすべて失なった。ただ、あいまいな色の断片だけが残った。にもかかわらず、彼女は周囲の空間の物体に対してかなり効果的に行動できることが判明した。たとえば、DFはさまざまな角度で置かれたポストの口を通して手紙を投函することができた。しかし、彼女は投函口の角度を述べることはできず、指をさしてその位置を示すこともできなかった。主観的な経験について言えば投函口を見ることはできないが、それでも手紙は確実に投函できていたのだ。

ゴドフリー=スミスによれば、DF自身は盲目であると感じていたとしても、彼女は眼の前に置かれた障害物を避けて歩くことができたと報告されている。

人間の脳は、2つの異なる部位を通過する2つの視覚処理ストリームを有するようである。そのうちの1つとして、空間内をナビゲートする (歩行したり、ポストの口に手紙を投函する) 際にリアルタイムで身体を調整するために使用される経路が存在する。DFの脳のその領域は障害を受けていなかったのだ。もう一方の領域、視覚を対象の分類、認識、説明などの高次の認知に使用する領域がDFの脳で障害を受けていた部位であり、それに伴って見るという主観的経験が失われたのである。

我々は皆、無意識のうちに多くのことができると知っている。おそらく、我々が意識している以上に! おそらく、我々が意識しているのは一部分だけで、我々が無意識で行なっていることを説明するストーリーを作り上げているのかもしれない。左右の脳を繋ぐ脳梁が切断された患者のグループが存在しており、それらの患者からは無意識の働きがさらに容易に観察できるが、しかしこの話は別の記事のために取っておこうと思う。

短い脱線

この記事の主題とは別に、私は1つのデータを示したい。私にとって、奇跡とも思えるデータである。地球上で、知能はただ1回だけ進化したのではなく、少なくとも2回は進化したということが分かっている。

扁形動物が生命の2本の枝の分岐点であるという事実、脊椎動物の枝と節足動物と軟体動物に別れた枝の共通の祖先であるという事実は、非常に示唆的である。Notoplana Acticolaのような6億年前の古い扁形動物と最も近縁の種族は、およそ2,000個のニューロンを備えている。これは多く節足動物よりもはるかに少なく (100,000個のニューロンを持つ昆虫は珍しくない)、昆虫は主観的な経験を欠いているように見える。ゆえに、扁形動物が昆虫以上の意識や知能を持っていたということは極めて考えにくい。

すなわち、タコおよび他の頭足類の知能は、鳥や哺乳類の知能の進化とは完全に独立して進化したことを意味している。それでも、たとえ頭足類たちが我々と比較して非常に異質なメルクヴェルトを持っていたとしても、その行動における知能は認識可能である。

知能は、地球上で少なくとも2回進化した!

これまで、ハッブル宇宙望遠鏡を用いて1000億個の銀河が観測されている。ウェッブ宇宙望遠鏡が軌道に乗るとその数は倍増すると予期されているが、しかし今のところは我々の観測に対して保守的になろう。我々自身の銀河系は非常に典型的であり、約1000億個の恒星が存在する。太陽はこのうちの1つでしかない。そこで、我々は10,000,000,000,000,000,000,000個の星があると分かっている、少なくとも。つまり、10^23個である。地球上には7.5x10^18個の砂粒があると推定されている。だから、あらゆる浜辺、あらゆる岩礁に存在するあらゆる砂粒を合わせたよりも1000倍以上の星が宇宙に存在するのだ。

過去20年の間に、人類は銀河系のごく小さな近傍の恒星の中から惑星を探索し始めた。我々は何千もの惑星を発見した。そして、すべての星は少なくとも1つの惑星を備えているようだ。6つのうちの1つが地球サイズの惑星を持っている。今年の2月、NASAのスピッツァー宇宙望遠鏡は、地球からわずか40光年の距離の星を発見し (銀河系の幅は10万光年であるため、相対的に言えばごく近くなのだ)、7つの地球サイズの惑星を備え、またそのうちの3つは地球とだいたい同じ温度である。これは地球のような生命の形態に適している。

私の過去記事を見れば、地球ベースのDNAでさえどれほど柔軟性があるのか、また今では生命システムが必ずしも我々のDNAと同種のものを持つ必要がないということが理解されていると分かるだろう。宇宙にある膨大な数の惑星、あるいは単に我々の近場の銀河系だけでも、膨大な数の地球に似た惑星があるだろうし、それら多数の惑星上で生命へと至る道のりは多数存在するだろう。そして、我々が知る唯一の事例においても、少なくとも2回、知能を持たない生命から知能が生じたのだ。完全に独立して。このすべてが、宇宙に知的生命は豊富に存在するだろうという私の確信を増加させる。少なくとも、タコ、鳥、哺乳類と同程度に知的であり、もしかしたら我々と同じくらい知的かもしれない。意識と、宗教と、神々と、叡智と、領土と、憎悪と、恐怖と、戦争と、慈悲と、諧謔と、愛情と、歴史と、野心と、驚異とを備えた知的生命体が。

宇宙にはたくさんの驚異を見つけられるだろう。もしも我々が観測方法を考案しさえすれば!!!

他の動物のメルクヴェルテン

それでは、タコ、イヌ、そして人間のメルクヴェルテン (ドイツ語でメルクヴェルトの複数形) について語ろう。すべてではないにせよ、以下のタコとイヌに関する話題の多くは、ゴドフリー=スミスとホロウィッツの書籍から引き出されている。これら3つの種を比較することにより、ロボットのメルクヴェルトについて何を考えるべきかを検討しよう。

タコは視覚刺激に対して非常にうまく反応できる。そして逸話からは、人間がタコを見ているときとそうでないときの違いを見分けられるようだ。潜在的な捕食者が自分に注目しているかを理解するという点で進化的な意義があり、ある種のヘビですらこの視覚的スキルを発揮できる。それだけではなく、タコは視覚を要する多数のタスクに訓練することもできる。人間とは異なり、しかし、その訓練はほとんどが眼に固有であるようだ。もしも、一方の眼だけに関連する特徴を見せるタスクでタコを訓練した場合、他方の眼を用いて同じタスクを行うことはできない。一方で人間は脳梁が切断されていない限り、何の苦もなく両目の間でタスクを転移できる。

ゴドフリー=スミスは、1956年の実験を紹介している。視覚的にタコを訓練して、大きな四角形と小さな四角形を識別させ、それぞれの場合において報酬を得るために (またはショックを避けるために…この実験は1956年に実施され、タコが実験動物の取扱規則において"名誉脊椎動物"と宣言されるよりもずっと前のことだ) 適切に行動させる実験である。タコは、四角形が配置された距離に関わらずその大きさを正しく識別できた--小さい四角形がタコの近くに置かれた場合、視野の中では大きく写るが、タコは距離による見かけの大きさを補正し小さな四角を正しく認識する。これは四角形が単なる視覚刺激以上のものであることを示唆する傾向を持つ。実際に、空間中の配置やタコの視点から独立した物体として扱われているようだ。四角形はタコに主観的な体験をもたらしているように思える。この能力は知覚恒常性の保持として知られており、昆虫には見られない場合もある。

また、タコは非常に触覚的でもある。彼らは触手を使って新しい物体を感じ、人間に1本の触手で触れることもよくある。触覚だけではなく、彼らは触手を用いて味や臭いを感じられる、少なくとも特定の分子を感知できると考えられている。一度にあらゆる方向へと向かう8本の触覚的感覚的味覚センサ。これは我々人間のメルクヴェルトとは非常に異なっている。

タコ、あるいは一部のイカについての別の驚くべき特徴は、高い精度で素早く肌の色を変化させる能力である。肌に埋め込まれた多数の異なるメカニズムを使い、すべてを同調させて異なる色とパターンを身体の上で表現する。時として、彼らの肌は映画のスクリーンのように素早く変化することもある。周囲の色とテクスチャを模倣することにより周辺環境に紛れ込むことができ、捕食者と獲物の双方から身を隠すのである。

しかし、面白くなるのはこれからだ。タコとイカは両方とも色盲である! 彼らの眼にはただ1種類の光レセプターしかないため、色を識別できないと考えられている。タコが眼で見た異なる色に対して反応することを示す実験は存在しない。けれども、彼らの肌は色に敏感であり、カモフラージュのために触手や身体の反対側にあるものを表示するようプログラムされている。つまり、タコは色刺激に対する盲視を持っている。しかし、眼を通してではない。彼らは色をベースとした高次の判断を下すことはできないが、身体は色に順応している。

原則として、それは人間と非常に異なるのだろうか? 我々の消化器は食物を消化する、どんな種類の食物が入ってきたかに応じて。そして、どれほど我々が真剣に考えたとしても、食者から何が検出されたのか詳細に認識することはできないし (ごくレアなケースで、食物が何らかの機能不全を発生させて嘔吐するなどの場合を除く)、思考を通して消化速度をコントロールすることもできない。タコと同じように、我々も認知のレベルにまで上がらない自律システムを備えている。

そこで、これらすべてを合わせて、タコのメルクヴェルトを想像できるのかを考えよう。それではタコになってみよう。タコたる我々は水中にいる場合と水の外に出た場合の異なる感覚を知っている。また、水の外を見た場合には、それが水の外であるということが分かる。1つの眼で物を見て、異なる物は異なる眼を使って見る。しかし、それら2つの像は必ずしも1つの完全な世界の像としてまとめられることはない。それでも、もしも世界の中でエピソード的ではない何らかの永続性を持つ物体を見たときには、それらの物体をメンタル的な地図の中に書き込み、そしていずれかの眼でその物体を認識する。また、我々の動作に追随する場所の感覚もある。タコたる我々は、上下逆で物を見ることはほとんどない。身体が何をしているかに関わらず、眼が相対的に上下同じ方向を向くよう回転するからだ。残念ながら、我々が見るものには色がない。日中、水面の近くであったとしても。聞こえるのはかなり低い周波数の音だけだが、周囲で何かが動く音を聞くためにはそれで充分なのだ。鈍い視覚と聴覚とは対照的に、触手を介して伝えられる世界は実に豊かである。我々には8本の触手があり、指令を通してものごとをさせることができる。触手に何をするべきかを正確に伝えていない場合は、触手は勝手に動き回り、触れたものの感覚と臭いを感じられる。我々は触手で水を嗅ぎ、潮流を嗅ぎ、また触手が触れたものの臭いを嗅ぐことができる。他の多数の動物たちが感じているのと同じく、世界における存在の豊かな感覚である。

それではイヌに移ろう。イヌの嗅覚が鋭敏であることは誰もがご存知だろうと思うが、しかし最初に視覚を取り上げよう。

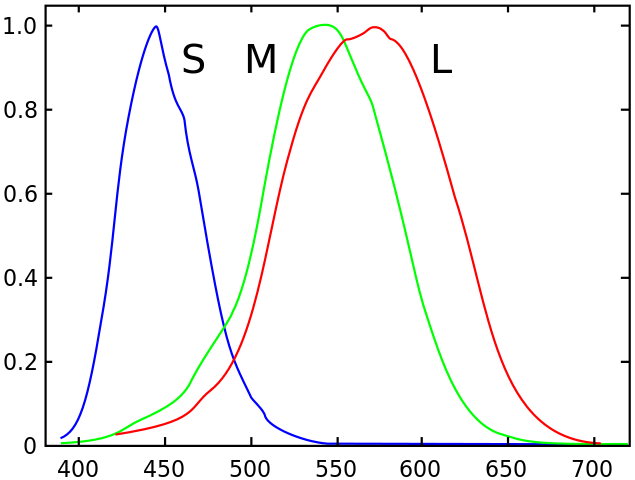

哺乳類の眼には2種類の異なる光の受容体がある。錐体は色に敏感であり、より暗い場所で働く桿体はそうではない。そのため、我々は夜に色の感度を失なうのだ。我々は、多く視覚情報を得るためにさまざまなセンサ要素を使用している。人間には3種類の錐体があり、それぞれが色スペクトラムの異なる位置に敏感である。以下は、ウィキメディアから引用した典型的な人間の色感度プロファイルである。

一番長い波長の受容体は、スペクトラムの赤色の領域を中心とした色に敏感であり (横軸は光の波長をナノメートルで表す)、中間は緑色周辺の波長に、そして短い波長の受容体は青色周辺を中心とする。3つの領域すべてがオーバーラップしており、知覚される色へと到着するまでにはかなりの処理がある - 後で説明しよう。ちょうど、個々人の骨の長さや筋肉の量などに多様性があるように、個々人の錐体も少し異なった形の感度曲線を持ち、そのピーク値も異なる。そのため、おそらく我々が知覚する色もちょっとだけ異なっている。また同様に、おおよそ12%の女性は4つめの錐体を持っていることが分かっている。黄色を中心とした、赤と緑の間にある受容体である。けれども、何かしら差異が生じるほどに色感度が赤から離れているのはごく少数の女性だけである -- そのような少数の女性にとっては、ほとんどの人々よりも豊かな色のパレットが知覚されるだろう。それら少数の人々は、他の人々とは異なった色覚のメルクヴェルトを持つ。

イヌは、その一方で、錯体を2種類しか持たないが多数の桿体を持っている。イヌの夜間視力は人間よりも優れているが、彼らのアキュイティ、つまり高い詳細で物を見分ける能力は我々よりも劣っている。イヌの色感度分布は黄色と青色に中心があり、また最近ではイヌが青の錯体を使って紫外線まで見ていることを示す証拠もある。紫外線とは、我々には完全に不可視の短波長光である。そのため、イヌは確実に色盲ではないが、しかし我々とは完全に異なった色を見ている。我々が物体上に見る色は、多数の異なる素材のブレンドによる異なる波長の光の反射で生じるものである。ある特定の色を示す物体が存在するように、イヌには非常に異なる色が見えるだろう。だから、フロアタイルとシャワータイル、そして壁のペイントが組み合わされた私の家の美しいベージュのバスルームも、犬にとって実際には異なる色の不協和音であるのかもしれない。

私の愛犬には、バスルームやリビングルームがこんなふうに見えているのかどうかは分からない:

我々には穏やかな色のブレンドとして見えているかもしれないが。直接的な感覚体験を超えたところでは、イヌたちが落ち着いた色合いと不快な色合いに対する洗練された好みを持つのかどうかを知るすべはない。

我々がイヌについて理解していることは、イヌは緑と赤を識別できないということ、また異なる電灯のスペクトラムにより、我々自身の認識の中で世界の内に見えるものが変化するということである。青色LEDの街灯を見れば、異なる光源により知覚がどれほど変化するかがわかるだろう。同じことはイヌにも言えるが、イヌたちにはどう感じられるのか理解することは困難である。けれども、イヌは、飼い主がクリスマスのために赤と緑でドレスアップしたところを見たとしても、イヌの意識の中ではそれがお祝いのための服装であるとは考えられないだろう。イヌにとってはすべてが灰色と灰色なのだ。

イヌのメルクヴェルトの大部分は、我々にはほとんど隠されているものの、嗅覚を通したものである。イヌがどのように臭いを嗅ぐか、どのように鼻を物に押し付け、風の香りを捉えるために鼻を空中に持ち上げるか、オシリや股、地面などのあらゆるところに鼻をつけるところを見たことがあるだろう。

ホロウィッツは、イヌの嗅覚は人間の100万倍も優れていると推定している--我々が想像することは難しく、我々のごく貧相な鼻と比べれば圧倒的に感じるだろう。彼女の指摘によれば、イヌにとっては1本の花の花弁ごとに匂いが異なり、ある昆虫がどこに居たかという履歴はイヌのメルクヴェルトの中にすべて存在しているという。さらには、我々のように単に物の臭いを嗅ぐだけではなく、たった数秒の間に臭いがどう変化するかを知り、我々には決して経験できないような時間的情報を得ることもできる。

イヌにとっての世界は臭いで満ちており、数週間前と数秒前の臭いがあり、時間を区別できる。そして、人間や動物や植物の健康と活動に関する情報も備わっている。イヌは、我々が裸でも服を着ていても異なる反応をしないかもしれないが、どこに居たか、何をしてきたか、病気であるか否かを検知し、異なった反応をする - すべて嗅覚を通して。

そして、イヌが気が付かないことであっても我々は視力によって気付けるのと同じように、イヌは我々がまったく気付かないことにも気付くかもしれない。ホロウィッツは、我々が購入する新しいイヌ用ベッドは、イヌにとってはひどい臭いであるかもしれないと指摘する。ちょうど、上記の紫色と黄色のリビングルームが私にとってはひどいものに見えるように。イヌのメルクヴェルトは、我々と非常に異なっている。

ヒトのメルクヴェルト

ロボットについてはこの後すぐに触れよう。しかし、最初に人間のメルクヴェルトについて話しておく必要がある。我々自身の主観的経験では、世界を"あるがままに"知覚しているように感じられる。しかし、コウモリ、タコ、イヌが各々のやり方で世界を知覚していたのと同じく、おそらく我々自身も何らかの特定の"真理"を知覚しているわけではあるまい。

カリフォルニア大学アーヴァイン校のドナルド・ホフマン (かつてMITの博士課程を修了した直後の1983年、彼はAIラボに所属していた) は、我々の知覚世界、我々のメルクヴェルトは、まったく世界の真の姿とは似ていないと長い間主張している。彼の1998年の本、『Visual Intelligence: How We Create What We See』 では、タイトルに彼の意見が明白に示されている。2016年のアトランティック紙の記事およびインタビューで、彼の考え方が非常に簡潔に要約されている。そしてその中からのこの引用が、彼の主張の本当の本質であると思う。

コンピュータのデスクトップの右下隅に、青色で四角のアイコンがあるとしよう--これは、ファイルそのものが青色の四角形で、コンピュータの右下の隅に住んでいるということを意味するのか? もちろん違う。けれども、それらはデスクトップ上に現れた唯一のものである - 色、位置、形状を持つ。それらは人間が利用可能な唯一のカテゴリではあるが、ファイル自体やコンピュータ中の何かについての真実を表してはいない。それが面白いことだ。もしもリアリティの全体像がデスクトップ画面に限定されていれば、コンピュータ内部について真の説明をすることはできない。それでも、デスクトップは有用である。青い四角のアイコンは、私の振る舞いをガイドし、私が知る必要のない複雑なリアリティを隠してくれる。それが鍵になるアイデアだ。進化は、生存が可能となるよう我々の知覚を形作ってきた。知覚は適応的な振る舞いを導く。けれども、そのような "適応的振る舞い" には、我々が知る必要がないものを隠すことも含んでいる。そしてそれがリアリティのほとんどすべてなのだ。たとえ、リアリティがいかなるものであったとしても。

自然界からコンピュータ世界へと進むことにより (我々が最終的にロボットに辿りついた時、この前後運動は本当に面白くなり循環するだろう)、彼が意図する主張について、非常に説得力のある議論を与えている。そこで、我々人間はこの議論をアナロジーにより拡張し、我々が通常住んでいる世界に対して適用する。そして、我々はこれがどうして真実なのだろうかと考え始めるだろう。

私は、また他の多数の人も、人間の知覚、すなわち我々のメルクヴェルトと宇宙のリアリティが分離しているという真実を納得させるために、いわゆる「錯視」が非常に有効であると気付いたのだ。おそらくこの分離を証明するイメージの作成に最も長けているのは、京都の立命館大学の北岡明佳教授であろう。

彼の錯視ページを見れば、動いて見える静止画像、歪んで見える直線、2次元の正方形から作られた波、あるいはらせんのように見える同心円などの錯視画像を見られるだろう。それ以外にも、北岡が作成した錯視画像へのリンクが60個近くもある。

しかし、ここで引用したイチゴの画像がおそらく最も優れている:

我々の視覚系には赤いイチゴが見える。しかし、画像にはそんなものはない。画像の中には赤の画素は存在しないのだ。中央下部のイチゴの画像の一部を引き伸ばしたものがこれである。

もしここでも赤が見えるのであれば、下半分を手で隠してほしい。灰色に見えるだろう。あるいは、この画像をスクリーンの上部までスクロールして、イチゴの画像が眼に入らないようにしてほしい。私にとっては、少なくとも、イチゴの画像を素早くスクロールすると、イチゴの赤色は一時的に、文字の背景色である灰色へと染みこんでいく!

スクリーン上のピクセルは、赤、緑と青の3つの異なる色から構成されている。通常、それぞれがR, G, Bと書かれ、0から255までの範囲の値により表現される。スクリーンや画像の特定の点における、その色の光の強度を表している。0はその色がまったく存在しないことを示し、255は可能な限りの最大強度を意味する。上記のイチゴの画像の734,449個のピクセルのうちでは、赤の画素値が緑および青の画素値をそれぞれ上回っているピクセルは、ただ122個または 0.017%のみであり、その最大のマージンは255のうちのたった6である。ここでは、そのような色を3つ取り上げる。すべて緑や青よりも赤の画素が多いピクセルの色であり、単に引き伸ばして正方形にしただけだ。すべて灰色である!

画像のRGB値は、左から右へ (192, 186, 186) = 0xc0baba, (193, 187, 187) = 0xc1bbbb および (189, 183, 183) = 0xbdb7b7 である。緑や青よりも赤の画素を多く持つピクセルすべてが、個別では灰色に見えるだろう。右側の正方形が、この画像全体の中で最も赤いピクセルを表している。おそらくほんのりとした赤みが見えるかもしれないが、イチゴのような赤さではない。また画像の中のごく一部だけがこのような赤色なのだ。実際には、赤がその色の最小の構成要素ではないピクセルは、たったの1,156個、0.16%にすぎないのだ。どのピクセルでも赤の画素の最大値は195だが、それらすべてで他の色、緑か青のいずれかが赤よりも多い。合計で18色のうち、ここではそのような色を3つ取り上げる。画像の値は、0xc3ffff, 0xc3e5efと0xc3c4beである:

しかし、この画像は我々人間にとって、たぶんちょっと変な光で照らされた赤いイチゴの写真のように見えるだろう。個別に見れば、ピクセルは赤でないにもかかわらず。

我々は、我々自身が世界を感知するメルクヴェルト、我々が感じるメルクヴェルトを備えているが、しかし脳は経験に基いてものごとを解釈する。さまざまに異なる照明条件の下でイチゴを見る可能性があるため、単純に知覚した元の色に依拠しないことには意味がある。実際には、我々はさまざまに異なる手掛かりをたくさん使い、画像中の何らかのコントラストの構造から、灰色と水色の画像全体に対して豊かな赤色のイチゴをマッピングするのである。この場合では、我々の知覚システムは正解を得ている。北岡教授による他の画像の中には、我々の知覚システムがどのように誤るのかを示すものもある。

それでは…コウモリやイヌも、たぶんこのようなことをしているのだろう。おそらく、エコー空間や臭い空間の中で。タコも同様にこのような補正をしている可能性がかなり高い。では、我々のロボットも、世界のなかで本当に効率的であるためには同じことをする必要があるのだろうか?

今日の家庭用ロボットのメルクヴェルト

今日、家庭に広く普及した唯一のロボットは、ロボット掃除機である。私が共同で創業した企業 iRobot社は、初の市場投入ではないけれども、世界に向けたロボットの販売で業界をリードしており、単独で2000万台ものルンバを売り上げた。他の会社も、独自技術を開発した業者および違法コピー業者 (iRobotのツールを用いている場合もある) の両方がマーケットに参入しており、現在全世界でこの種のロボットは5000万台を超えているだろう。

ロボット掃除機の初期バージョンは、極めて限られたセンサしか持たず、極めてシンプルなメルクヴェルトしかなかった。衝突センサ、冗長化された凹凸センサ、赤外線センサ、充電用コンセントには電圧センサを備えていた。衝突センサは、単にロボットが何かにぶつかった際に通知するだけのものだ。凹凸センサ、下方向への赤外線の"レーダー" およびタイヤの落下センサは、床にある穴へとロボットが差し掛かった時に通知する。また、2種類の赤外線ビームを感知する。1つはバーチャルウォールであり、ルンバが掃除する家の家主が、住居の中に「立入禁止線」を設定するためのものである。初期のルンバには、更に2つの内部センサがあった。1つはルンバ自身のバッテリー電圧をチェックするためのものであり、このセンサによりルンバはいつ再充電が必要であるか、あるいは再充電が完了したかを知ることができる。バッテリー電圧が低下した場合には、ルンバは掃除を止め、特別な赤外線のビーコンを探してうろつき、充電ユニットへ戻って休憩する。もう1つのセンサはゴミのタンクが一杯になったときのためであり、こちらのセンサも「ホームで休憩」の行動をトリガする。しかし、最初期のバージョンでは再充電ステーションは存在せず、ルンバは単に行動を停止し、ゴミタンクが一杯であると通知してシャットダウンしてしまうのだった。

ルンバはゴドフリー=スミスの議論における昆虫に似ている。何らかの部品が故障したとしても、たとえば1つのタイヤが壊れたとしても故障に気付いていないかのように単に満足げに行動を続ける。特にこの場合は、その場で回転し続けるだろう。彼らは自分自身という感覚を持たず、また自分が掃除あるいは「食事」をしていることにも気付いていない。エージェンシーに対するいかなる感覚、あるいは内的表現をも持っていない。彼らが大量に餌を食べると、ゴミタンクのセンサは「満腹した」と伝えるかもしれない。しかし、物理的にもソフトウェア的にも、ロボット内の2つの出来事は何らの関係も持っていない。過去の経験に基いた行動の適応は存在しない。2,000個のニューロンを持った現存する扁形動物でさえ、経験に基いて行動を修正する。

物理学はロボットについて語るとき必要になる。物理学の重要な問題が1つあり、これはルンバの清掃に多大な影響を与えている。ルンバは小さくて軽いのだ。そして、これにはいくつかの理由がある。床の上で寝ているイヌや赤子にぶつかっても安全であること、床にルンバを置く時にストレスを与えないようにするなどの理由がある。しかし、これはルンバが多量のバッテリーを搭載できないことを意味し、通常の掃除機と同じように設計されていたとしたら、カーペットから汚れを吸引するために必要な電力300ワットによりバッテリー寿命はほんの数分に制限されてしまうだろう。解決策は、2段階の清掃システムを持つことであった。第一段階は、移動方向に対して垂直な、ルンバの体を横切る相互に逆方向へ回転する2つのブラシである。それが表面近くの汚れを引っ張り、大きな粒子を集めることができる。その後には、空気を吸い込むためのブラシと平行な非常に細い線状のスリットが続く。スリットは非常に細いために、30ワットしか消費せずに300ワットの掃除機と同レベルの吸引力を達成できる。(...)

これら強力なブラシの副作用として、敷物や電源コードがブラシ機構に引き込まれ、その周りに絡まってルンバが動けなくなり、最終的にはモータによる過剰な電力消費によって動作停止してしまうという問題がある。初期のバージョンは昆虫に非常によく似ていて、何か異常事態が発生していると気付かず、行動を変えることもなかった。後のバージョンのルンバは、この問題を解決するために、ブラシに何かが絡まって負荷がかかっていることを認識し、絡みをほどくためにブラシを逆回転させる。それでも、未だ主観的な経験は存在しない。絡まりやすい物のある場所を記憶し、次に同じエリアを進むときにはそこを避けるなどということはできない - 非常に単純な動物でさえ、このレベルの認識を持っている。

ルンバの最初の10年間に起きたもう一つの問題は、ブラシが最終的に毛玉でいっぱいになり、ごみを清掃する効率が低下することであった。ロボットに付属した説明書にもかかわらず、ほとんどの人はめったにブラシを清掃しなかった (誰がそんなことを望むだろう? - そもそも、それが人々がロボット掃除機を買う理由なのだ。汚れ仕事をさせるためである!) 後のバージョンではブラシは自動的に清掃されるが、しかしここでもロボットの動作とメルクヴェルトから得られる他の観測との間には何の関係もない。

ブラシ清掃の問題が解決されるより前に、拾われたごみの量を測定するセンサがルンバ内部に追加された。ある場所に大量のごみがあったならば、ルンバは同じエリアを何度も何度も繰り返し周回するモードとなる。ここでも、この認識はロボットの他の動作とは何も関連がない。

最近では、ルンバに場所の感覚が追加された。上向きのカメラを使用するものである。ロボットが移動するときに視覚的な特徴を記憶し、同時に移動距離の粗い推定値を使うことで (カーペットのケバの方向により、直線の距離計による推定値は10%またはそれ以上の誤差を生じる場合がある) 同じ特徴を二度見たことを認識する。この問題は30年以上にわたって学術的な研究が続けられており、SLAM (Simultaneous Localization And Mapping) として知られている。ルンバに搭載されているのは、視覚ベースのバージョンでありVSLAMとして知られている。ルンバは限られた清掃時間を広げることができるように、作成した地図を使用して時間を費したエリアをチェックするのである。(…)

VSLAMは、ルンバがエピソード記憶を獲得することに近付くものである。しかし、本当のところは一般化されたエピソードではない。ルンバは、他のものごとや発生した事象をその地図へと関連付けられないからだ。鳥や哺乳類やタコが持つ位置感覚よりも、世界の位置に対するコネクションがはるかに弱いようである。

最近のルンバのメルクヴェルト、VSLAM用のカメラによるものなどを考慮すると、何らかの種類の自己感覚をプログラムしたり、何らかの種類の非常に希薄な主観的経験を備えうるかもしれないが、しかし実際のところは存在しないだろう。より複雑なメルクヴェルトを備えた次世代の家庭用ロボットを構築する人々は、主観的な経験を備えたロボットを望むだろうか? あるいはそれが可能であり、望ましいものであるだろうか?考えなければならないことはまだ残っているが、しかしここで家庭用ロボットのメルクヴェルトを推進するであろうテクノロジー市場の力がどこにあるのか、そのようなロボットであるとはどのようなことであるのかを考えよう。

未来の家庭用ロボットのメルクヴェルト

絶対数で言えば、人々の家庭に居るロボット掃除機の台数は知的な動物種よりも既に多い。彼らのメルクヴェルトはそれほど面白くない。しかし、この領域は大きな成長領域になるという信念から、ますますたくさんのスタートアップや大企業が家庭用ロボットの構築を目指して参入している。私もそれを信じており、世界的な人口統計的な逆転がロボット開発を推し進めるだろう、と次の記事で説明する。次世代の家庭用ロボットは、以前のロボットよりもはるかに豊かな素のメルクヴェルトを持つ可能性がある。

新たなメルクヴェルトの大部分をドライブするのは、過去10年間のスマートフォンの成功、それによる特定の種類のセンサ価格と性能への寄与、低消費電力で物理的に小型の計算ユニットだろう。そして、このメルクヴェルトは、我々とは、あるいはイヌ、タコ、またはコウモリとは非常に異なっているかもしれない。この先のいくつかの段落では、このようなロボットであることはどのようなことかを考えるが、これは比較的近縁のタコであるということを考えるよりも非常に難しいかもしれない。

現代のスマートフォンの内部部品、カメラもなく、高価なタッチスクリーンもなく、スピーカーとマイクもなく、高性能のバッテリーもなく、美しく加工された金属製のケースもない基盤は、約100ドルから200ドル程度で購入できるだろう。携帯電話用チップメーカーの最大手2社、サムスンとクアルコムは、携帯電話基盤を1個から販売している。そこでは現代の携帯電話の機能のほぼすべてが100ドルで購入できる。この基盤には、8コアのハイパフォーマンス64ビットプロセッサ、高精細カメラ用の2つのドライバ回路、スクリーン用のGPUとドライバ、写真撮影時に顔へフォーカスするための専用回路、音声処理と音生成のための専用回路、大量のコンピュータメモリ、外部攻撃からコードとデータを保護するための暗号化ハードウェア、Wifi、Bluetoothドライバ、アンテナなどがある。ただし、GPSシステム、モーションセンサ、Apple PayのようなNFC (近距離通信)、携帯電話ネットワークに接続するための電波モジュールなどは存在しない。それらすべてを含めても200ドルには収まるだろう。

今後5年の間に家庭用ロボット製造を検討している人は、このような携帯電話を活用しないことはクレイジーだと思われてしまうだろう。1台200ドルで、家庭用ロボットの内臓を作り上げるための巨大な足がかりを得られるのだから。そこで、これが今後数十年にわたって今後登場する家庭用ロボットのメルクヴェルトを大きくドライブするだろう。今後数年の間に、ディープラーニングのランタイム評価用に大量のシリコンが携帯電話に搭載されたとしても、どうか驚かないでほしい (最近の私のムーアの法則の終わりに関する記事を参照)

携帯電話には搭載されていないものの、家庭用ロボットに追加されるセンサはもちろんあるだろう。そして、それらのセンサはプロセッサへ接続されデータが処理されるため、メルクヴェルトにも追加されるだろう。しかし、ロボットのメルクヴェルトの多くは、カメラやマイク、携帯電話の電波スペクトルに由来するであろう。

近く発売される5G携帯電話向けのチップセットでは、ハイエンドスマートフォン用に合計9種類の異なる無線システムが搭載されるかもしれない。

たとえ100ドル程度にまで削減した電話システムであったとしても、家庭用ロボットはBluetoothデバイスとWifiアクセスポイント、およびWifiを利用するあらゆるデバイスの「臭い」を嗅ぐことができる。私の家の中を見回せば、Wifiプリンター、ラップトップ、タブレット、スマートフォン、Roku [ストリーミングテレビ] デバイスとテレビ (より新しい「スマートTV」は直接Wifiに接続できる) などがある。アクティブなBluetoothデバイスとしては、コンピュータマウス、キーボード、体重計、Fitbits、時計、スピーカー、その他多数のデバイスがある。家庭用ロボットのメルクヴェルトには、これらすべてのデバイスが含まれている。固定された場所にあるデバイスも、人と一緒に移動するデバイスもある。ロボットに備わったカメラで認証される特定の人物との関連付けに利用されるデバイスもあるだろう。しかし、ロボットは頭の後ろにも眼を持っている - ある方向へカメラを向けなくとも、Bluetoothのシグネチャ情報のみから、特定人物が接近していると分かる。このメルクヴェルトに少しの処理を追加すれば、将来の家庭用ロボットは我々とは完全に異なった視界を持つようになるだろう - 我々の通信デバイスによってもたらされる、テクノロジー的な視野である。我々人間にとっては、携帯電話は単なる通信用デバイスであるが、ロボットたちにとっては、信号内の一部の識別情報の確認によって理解される地理的・個人的なタグである。しかし、ロボットを作りプログラムする人によっては、以前見た人を単に識別するだけではなく、人々についてもっと大量の情報を抽出できるようになるかもしれない。ひょっとすると通信内容を聞く能力を備えているかもしれない。

近年、MITのCSAIL (Computer Science and Artificial Intelligence Lab) のディーナ・カタビと学生は、通常のWifi信号をビットパケットのレベルではなく無線の信号強度レベルで処理する実験を行なっている。あらゆる携帯電話もある程度はこのような処理を行なっているが、しかし大抵の場合はパケットおよび何らかのサービス情報品質の取得が目的である。カタビと学生は、無線信号のタイミングが微妙に変化する様子から人間を検出し、また呼吸と心拍数の変化を検出することでその人の感情さえも検出している。この方法では、被験者にいかなるセンサを接続する必要も無いということに注意してほしい - 単に、その人の存在によってWifi信号の挙動が変化する方法を検出するだけである。将来の家庭用ロボットも、人間には決して不可能な方法で我々の情報を直接的に読み取るだろう。これがロボットにとっての主観的な経験であると考えられるかどうかは、処理の出力がどれほど詳細に描写されるか、ロボット中の他の処理に対してどのように受け渡されるかに依存するだろう。

これが、将来の家庭用ロボットが使用する可能性のある最小のチップセットである。スマートフォンが装備するコミュニケーションチャネルを完全に備えたチップセットを利用すれば、ロボットのメルクヴェルトはもっと豊かになるだろう。GPSを使用すれば、屋内でさえおおよそのグローバル座標を取得できる。その上、スマートフォンが利用するあらゆる種類のサービスにアクセスもできる。時刻、日付、その場所またはどこか他の場所の現在の天気予報。ロボットは、年と日付と時刻から外が暗いかを知るだろう。人間と同じように外の明るさや暗さから時刻を知るのではなく。我々人間は異なる方法で情報を取得する。我々が屋内に居るのか屋外に居るのかを知ることができるのは、GPS座標や詳細な地図からではない。明るさをどのように感じるか、空気が循環する方法、そして音がどう反響するかなどから知るのである。それらは我々の主観的経験の一部分である。

余談: もしもロボットが我々の経験する世界をバイパスし、直接的にテクロノジー的な情報にアクセスできるのであれば、ロボットが我々の限界を理解することは難しくなるであろう。もしも彼らが意識を持っていたとしても、我々に対する共感を持たないかもしれない。そこで、もしも巨大なインフラ破壊の事象 (人工衛星への攻撃、核戦争など) が発生した場合、ロボットは我々が最も必要とするときに無能力のままに留まるかもしれない。ロボットを設計するにあたって考慮しなければならない。

電波強度についての話に戻ると、追加の周波数を使い、5Gの無線の複数の周波数帯で異なる信号の到着時刻を比較すれば、信号遅延についての直接的なメルクヴェルトから始めて、周囲の環境を理解できるようになる可能性がある。建物がコンクリートで建築されているか、あるいは木材か、または、近くを大きな金属製の物体が動いているか (トラックやバスなど) が分かるだろう。もしも、家庭用ロボットの製造者がすべてをプログラムすることを決めたら、ロボットたちは (我々にとって) 更に奇妙な、周囲の世界についての超越的な感覚を持つようになるだろう。

ロボットに搭載するカメラについても、見える光の範囲を紫外線や赤外線に拡張することは簡単に選択できる。後者の場合では、ロボットは我々がどこに座っていたかが分かるだろうし、おそらく熱の形跡からどこを歩いたかも分かるだろう。それはまた別の奇妙な超人的感覚であり、我々にはない感覚である。けれども、ロボットたちは我々の家に住み始めたあらゆるデバイスから情報を汲み出すかもしれない。Amazon EchoやGoogle Home、そしてスマートテレビでさえもいつも我々を聞くことができる。ホームロボットは、みんなが読まずに同意する利用規約によって、そして何らかの企業間合意によって、それらのデバイスが聞いたことにアクセスできるようになる。スマート火災報知器のカメラが見たものにもアクセスする。そして、我々が家に帰る直前に車の中で何が起きたのか。どこで電子決済を使ったのか、そしておそらく何を買ったのかも。これらの家庭用ロボットは、ティーンエイジャーの子供を支配する親のように、我々の生活に対する直接的なメルクヴェルトの広がりを持つかもしれない。

だから、家庭用ロボットのセンサ世界、メルクヴェルトは、我々とは非常に異なっているだろう。我々が知らないこともロボットは知っているが、しかし彼らは人間の主観的経験への理解を欠いているかもしれない。ロボットたちが人間と上手に関われるかどうかは、彼らの知覚処理がどれほど我々に寄り添ったものとなるかにかかっている。ロボットのメルクヴェルトに関する思考は、ここでついに極めて不明瞭なものとなる。

ディープラーニングは、過去5年間で最も成功した技術である。それはジェフ・ヒントン (トロント大学およびGoogle) やヤン・ルカン (ニューヨーク大学およびFacebook) といった人々の30年にもわたるハードワークから生じたものである。彼らの研究は音声認識に革命を起こし、そしてそれがAmazon Echo、Google HomeやApple Siriを実現した。

また、画像を分類するシステムを訓練するために、画像に何が写っているのかがラベル付けされた、非常に巨大な画像の訓練セットも使用されている。

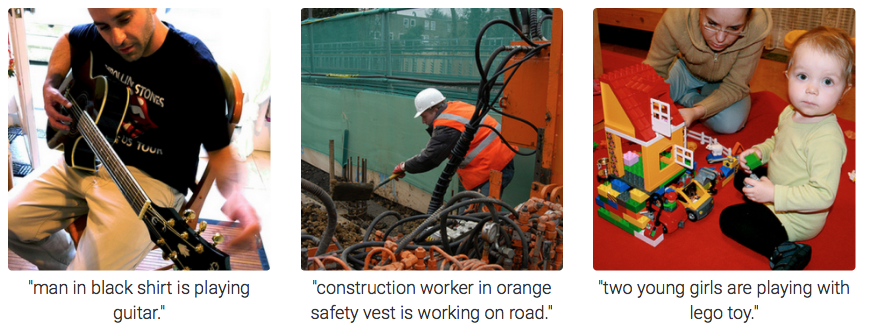

これは、アンドレイ・カーパシーとフェイフェイ・リーによる論文の事例である。画像用に訓練されたネットワークと、自然な英語による説明の生成用に訓練されたネットワークの2つが組み合わされて、これら3枚の画像にラベルを付与することに成功している。

(キャプション) 黒いシャツを着た男性がギターを引いている/オレンジの安全ベストを着た建築作業員が路上で働いている/2人の若い女の子がレゴのおもちゃで遊んでいる

特に優れた例を選択した。プロジェクトページでは著者たちが更に事例を公開しているが、これらほどには正確ではないものもある。けれども、上記の北岡教授の錯視画像が指摘した通り、人間の視覚系が時々奇妙な結果をもたらすのと同じく、ディープラーニングシステムも錯覚を起こすのだ。

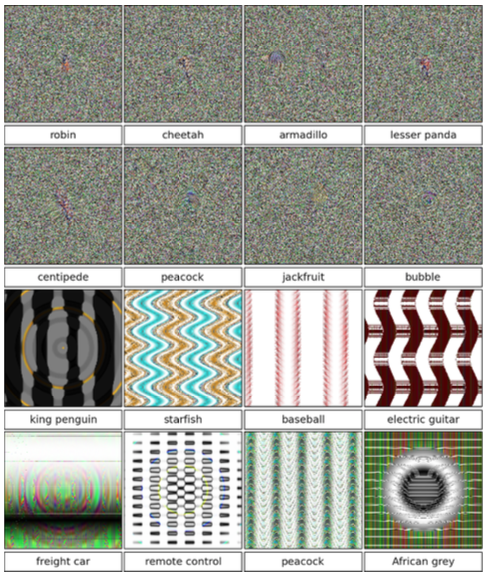

アン・ングウェン、ジェイソン・ヨシンスキー、ジェフ・クランによる論文では、著者らは訓練されたディープラーニングのネットワークを使い、上記のネットワークと同じ画像のデータセットで訓練し、また画像内の主要な物体についてのラベルを生成するネットワークも訓練した。そのネットワークは出力ラベルの"確信度"を与え、優れた事例ではすべての確信度が99%を超えることもある。

しかし、そこで著者たちは邪悪になり、訓練されたネットワークに負荷を掛け始める。最初に、変数として値の範囲が与えられたときにランダムに生成された数式を用いて画像を生成する。これら数式はランダムに「ギター」のラベルをトリガーする場合がある。たとえば、0.0%の確信度よりも少しだけ大きくなるかもしれない-つまり、実際にはネットワークはその画像が「ギター」であるとはそれほど強く信じていない。単にゼロよりも少しだけ大きい可能性があるというだけだ。多数の画像がごく小さな可能性を生むだろう。ここで著者たちは進化的コンピューティングのアイデアを適用する。2つの数式を取って「交配」させ、複数世代のたくさんの子ども数式を作成するのだ。生物的システムと同じく、子孫はそれぞれの親から何らかのDNAを受け継いでいる。

たとえば、2つの親数式が $(x+y) * (x^3 -y^3)$ と $ \sin^2x+\cos y $であったとする。この2つから作られる子は、たとえば $(x+\sin^2) * (x^3 - y^2)$ や $(\cos y + y) + (x^3 -(\cos y)^2) $ といったものがあるだろう。ほとんどの子数式で「ギター」のスコアは悪化するだろう。しかし時として、訓練されたネットワークの "ギター性" を刺激する親の一部が組み合わされて、より良いスコアを得られる場合がある。進化的アルゴリズムは次世代の親となる優れた子孫を選択する。数百、あるいは数千世代の後には、本当に高い「ギター」のスコアを得られる数式が進化するかもしれない。問題は、それらの画像が我々にギターらしく見えるかである。

これが生成された画像とラベルであり、すべてのスコアは99.6%よりも高い。

注意、これらはたまたま高いスコアを記録した純粋にランダムな画像ではない。これら画像が意図する効果を持つように、膨大な量の計算時間が "繁殖"のために使われている。

上8個はランダムなノイズのように見えるかもしれない。しかし、これらは合成され、注意深く選択された画像であり、画像識別器の特定のラベルをトリガーするものである。下の画像は少しだけ幾何学的な形をしており、その中には (たとえば、野球のボール) では、そのラベルの何らかの本質が見て取れるかもしれない (「野球ボール性」は、野球ボールの縫い目のように見える)

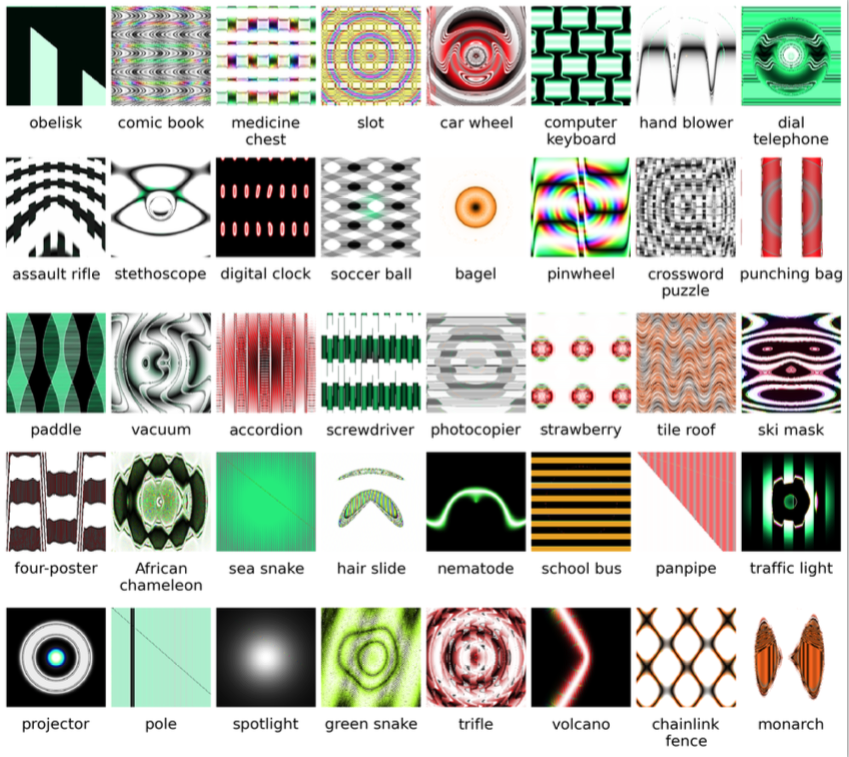

以下は論文からの別の生成画像とラベルのセットである。このデータセットでは、平均スコアは99.12%である。著者たちは、多数の結果の中から、人間の視覚系には何らかのラベルの本質が見える事例を選択している。

私のお気に入りは、「スクールバス」である。アメリカのスクールバス [訳注: Google画像検索の「school bus」の結果を参照] を見慣れてた人であれば、その本質が表現されていると理解できると思う。実際のところ、これらすべての画像がラベルの本質をいくらか表現している。けれども、普通の能力がある人であれば、これらの画像がラベルの物体を表現したものであると99%の確信度で間違えることはないだろうと思う。我々は、これらすべてが合成画像だと即座に理解できるだろう。

だから…あらゆるロボットは、我々とはまったく異なる錯視の対象となるだろう。ロボットたちは、我々が見えない微妙なものを見るかもしれない。そして我々もロボットたちには見えない微妙なものを見るだろう。

人間とロボットの関係

我々と家庭用ロボットは、共通の家で異なったメルクヴェルトを持つだろう。ロボットヘルパーのメルクヴェルトを理解すれば、ロボットたちができるはずのこと、ロボットたちに何を委任し託すべきか、ロボットを使う上でプライバシーのどの面を諦めなければならないかなどについて、現実的な見通しを持てるようになる。人間のメルクヴェルトについての妥当なモデルをロボットの中に作り込められれば、ロボットたちは我々の知識や行動を予期できるようになり、我々とスムーズにインタラクションできるだろう。

我々のロボットは、自己の感覚、主観的経験、それらの主観的経験と混ぜられたエピソード記憶や何らかの形の意識を持つかもしれないし、持たないかもしれない (たぶん、長期的には持つようになるだろう)。ちょうど、我々がイヌにも何らかの形の意識があると考えるように。最初の数世代の家庭用ロボット (我々のロボット掃除機は第一世代である) の振る舞いと我々とのインタラクションでは、哺乳類的であるよりは昆虫的になるだろう。

おそらく、主観的経験と意識的な経験をロボットに植えつけるための方法の研究を多くの人が開始するにつれて、我々とロボットたちは互いに共感を持つようになるだろう。あるいは、我々とロボットはタコとスキューバダイバーのような関係に常に留まるのかもしれない。一方は、他方の世界の中で多少きまり悪い思いをしており、相手の世界のディテールには気付かず、二者はお互いを認識しているものの、本当には相互に関わり合ってはいない。

-

原注1:Thomas Nagel, “What Is It Like to Be a Bat?”, Philosophical Review, Vol 83, No. 4, (Oct 1974), pp. 435-450. この論文はいくつかの論文集で再販されており、私自身が持っている論文のコピーはそのような論文集から30年以上前にゼロックスした版である。オリジナルはJSTOR上で入手可能であり、大学図書館で購入するか15ドルを支払えば入手できる。しかし、世界中の多数の大学が講義のためにこの論文を公開しており、検索エンジンから発見可能なサイト上で発見できる。たとえば、ここではワーウィック大学のサイトやブリティッシュコロンビア大学のサイトなどがある。 ↩

-

原注2:Alexandra Horowitz, “Inside of a Dog: What Dogs See, Smell, and Know”, Scribner, New York, 2009. ↩

-

原注3:Peter Godfrey-Smith, “Other Minds: the Octopus, the Sea, and the Deep Origins of Consciousness”, Farrar, Strauss and Giroux, New York, 2016. ↩

-

原注4:Jakob von Uexküll, “Umwelt und Innenwelt der Tiere”, Springer, Berlin, 1921. ↩

-

原注5:この記事を書くためにメルクヴェルトという語の起源をチェックしていたところ、ウィキペディアによれば、私自身がこの単語を英語に借用した人間であるということを知り驚いた。私は1986年にMIT AIラボのメモでこの単語を最初に使用し、その後の公開文献では1991年のAIジャーナルに最終的に掲載された論文で使用している (もともとは1987年に書かれた論文である) ↩

-

原注6:Lawrence Weiskrantz, “Blindsight”, Oxford University Press, Oxford, United Kingdom, 1986. ↩