2024/11月、突然noobaiという凄まじい性能の画像生成モデルが登場しました

詳しくはこの記事

https://ascii.jp/elem/000/004/238/4238227/

noobaiの真骨頂はv-pred対応モデルを使った画像生成です

noobai vpredモデルは現在も鋭意開発中ですが、今の開発中モデルでも従来のものを完全に過去にする凄まじい性能を誇っています

簡単に言うと今までより破綻が少なく色も正しく出力されます

実際に使ってみると格段に性能の差を感じます!

これまでのモデル(Epsilon-Prediction)にはできないものだそうです

以下chatGPTより引用

しかし、ε予測にはいくつかの課題があるんだ。例えば、ノイズの多い初期段階では、画像の構造情報が失われやすく、生成結果が不安定になることがあるんだよ。また、詳細な部分の表現が難しく、生成品質に限界が生じることもあるんだ。

noobaiには従来型のepsilon-predictionのモデルもあるんですが、

この記事ではv-pred対応版を使うことを想定します

最初に

まずはnoobai v-pred対応版のモデルを入手してきてください

ReForgeの入手, セットアップ

最近はforgeではなくstable-diffusion-webui-reForge(通称ReForge)というWebUIが使われているようで、こちらはv-predの生成に対応しています

これを適当なところでgit cloneしてください

終わったらdevブランチに変更します❗️忘れないように

その後、

webui-user.bat

を実行してください。セットアップが始まり必要なパッケージがどんどんインストールされていきます。

モデルの配置

セットアップが終わって http://127.0.0.1:7860/ が開けるようになったらモデルを配置します

\stable-diffusion-webui-reForge\models\Stable-diffusion

に最初にDLしてきたv-pred対応モデルを設置します

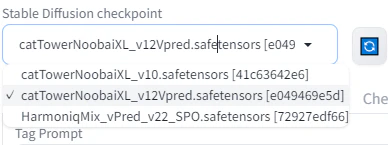

設置後に webuiのほうにある

Stable Diffusion checkpointの更新ボタンを押すと認識されるので

プルダウンから選択してください

プロンプトなどの設定

プロンプトは今まで通り好きなものをいれてください

解像度も困ったら1024x1024にしとくと良いと思います

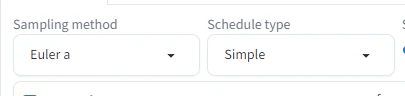

sampling methodを Euler a にします

Schedule typeを Simple にします

v-predの設定

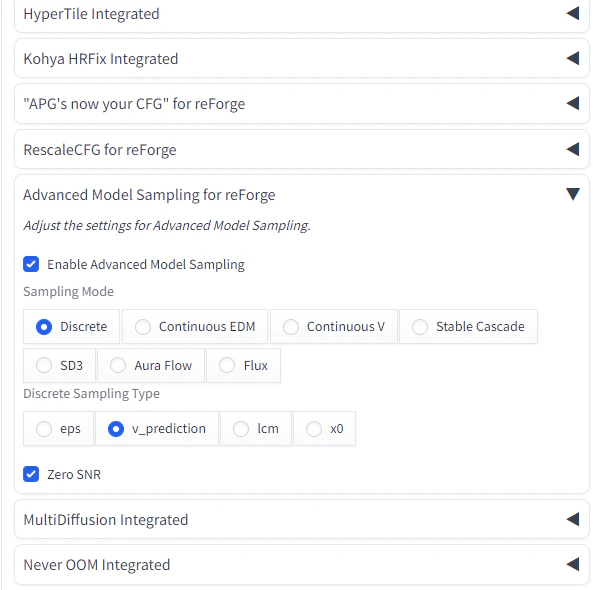

Advanced Model Sampling for reForge を以下のように設定してください

終わり

あとはGenerateボタンを実行するだけです!

ベストなCFG Scaleなどは使ってるモデルによると思います