株式会社NTTデータ Databricksビジネス推進室の nttd-inoutk です。

2023年9月頃より、DatabricksとSalesforceの両社は、戦略的協業や連携機能に関する多数のアナウンスを実施してきました。

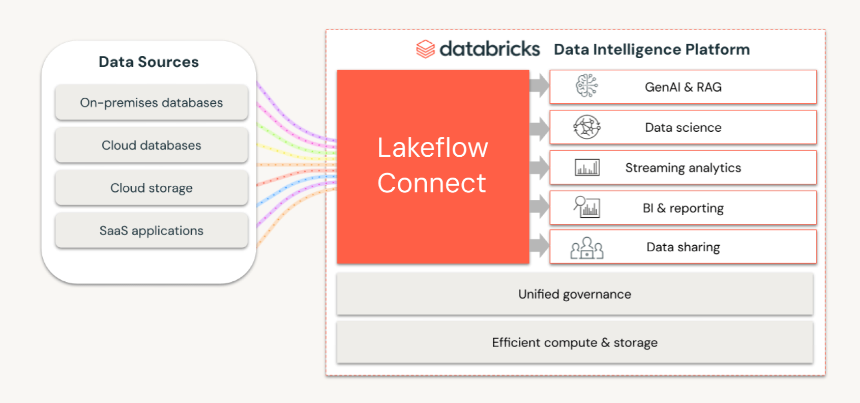

CRMソリューションであり、営業・マーケティング・カスタマーサービスなどの様々なデータが格納されるSalesforceと、データの加工や分析、AI活用の優れたプラットフォームであるDatabricksと、その両者を組み合わせて活用することで、インサイトの獲得、業務や顧客に提供するサービスの改善によってより優れた顧客体験に繋がり、企業価値の大幅な向上に貢献できます。

今回、本記事を含む3記事にわたってその概要をご紹介します。

#1 Lakeflow Connectを使ってSalesforce Sales CloudのデータをDatabricksに取り込む(本記事)

#2 PythonCDPコネクタを使ってSalesforce Data CloudのデータをDatabricksから参照する

#3 Model Bulderを使ってSalesforce Data CloudからDatabricksで構築したモデルを呼び出す

はじめに

Databricks×Salesforceの直近最大のアップデートは、Databricksが2025年2月にパブリックプレビューを開始した機能である Lakeflow Connect(フルマネージドのデータ取り込みコネクタ)を利用することで、わずか数ステップの操作のみでSalesforce Sales CloudからDatabricksのDelta Lakeにデータを取り込めるようになったことです。

従来は、Databricksのクラスターにユーザーが用意した外部システム接続用のコネクタをインストールしたり、外部のETLツールを利用してデータを連携したりしていたところ、フルマネージドの機能として提供されたことでその手間が削減され、基盤設定も簡易になりました。

2025年3月現在、Lakeflow Connectの接続可能として、Salesforce Sales Cloud および Workday Reports が Public Preview 、ServiceNow および SQL Server が Gated Public Preview のステータスでラインナップされています。

本記事では、Lakeflow ConnectによるSalesforce Sales CloudからDatabricksへのデータロードを実践します。

Lakeflow Connectの実践

以下の手順に従って実践します。

Salesforce接続情報の追加

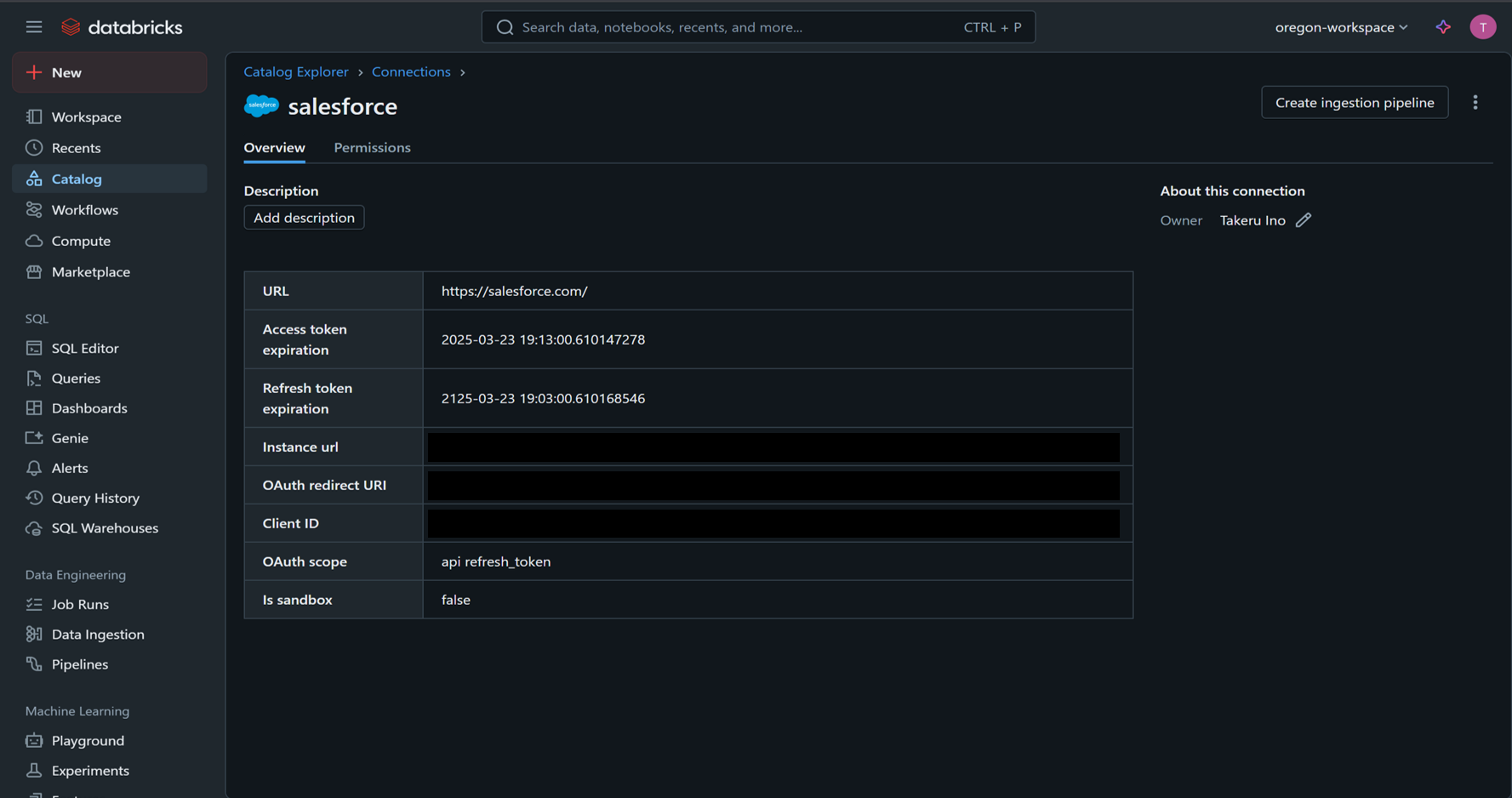

APIアクセス権を持ち、Databricksへの取り込みを実施したいすべてのオブジェクトに対してアクセス可能なSalesforceのユーザーを用意のうえで、そのユーザーの認証情報をDatabricksに登録します。

Catalog > External locations > Connections > Create connection に移動し、Connection type に Salesforce を選択、Salesforceの認証画面に遷移後認証が完了すると以下のように接続情報の追加が完了します。

連携パイプラインの作成・実行

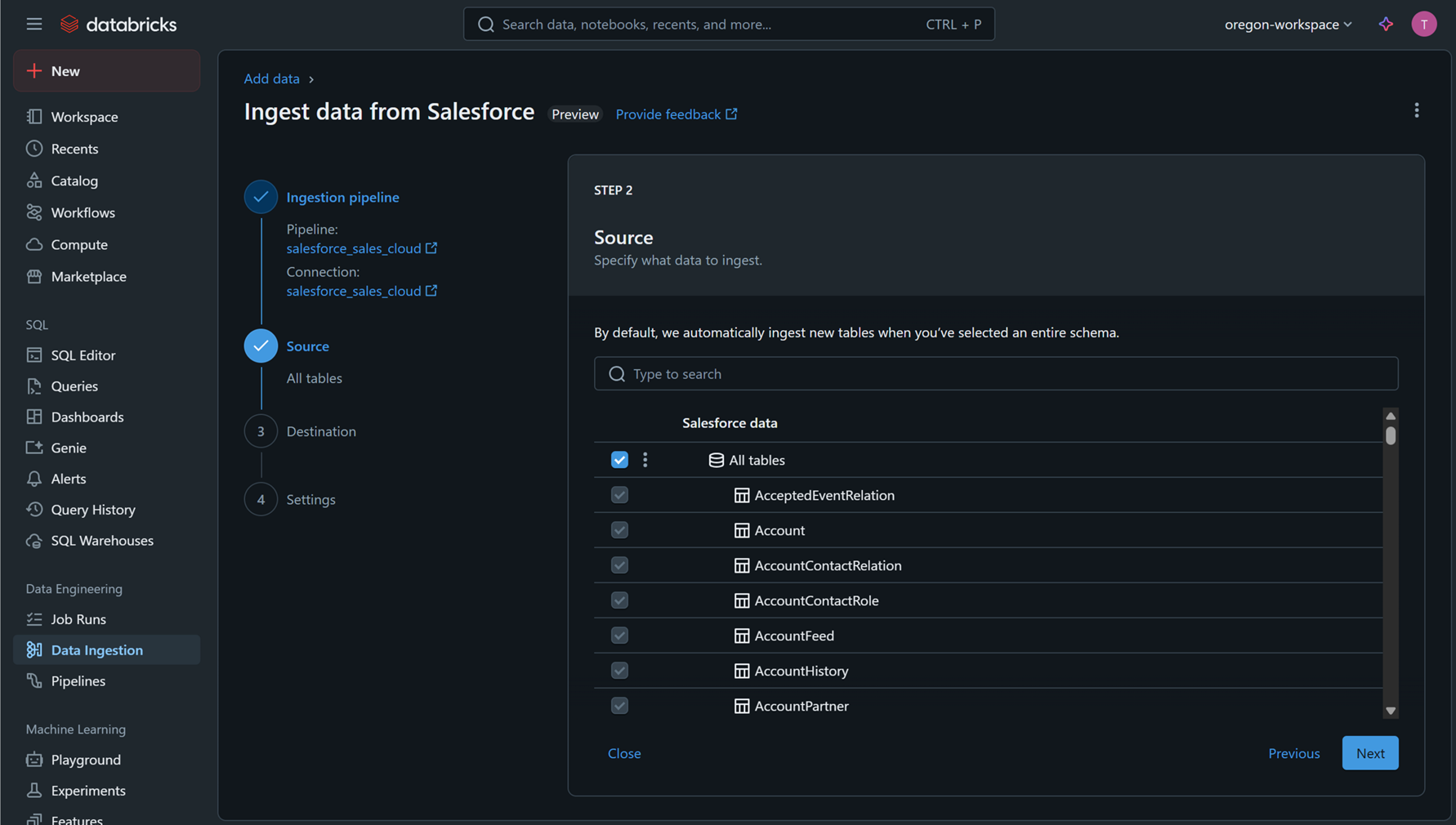

Add data page > Databricks connectors から Salesforce を選択してパイプラインを構築します。

Event Log Locationとしてカタログ・スキーマの指定が必要ですが、実際のテーブルの配置先は後続で別途指定するため、こちらはあくまでログ配置用のスキーマであることにご注意ください。

Connectionには先の手順で作成したSales Cloud接続用の接続情報を利用します。

こちらの画面で連携対象のテーブルを指定します。「All Tables」を指定すると現存するもの・将来的に追加されるものも含めてすべてのテーブルが連携されるため、必要最低限に連携対象を絞りたい場合は明示的にテーブルを選択します。ここではAll Tablesを選択して進めます。

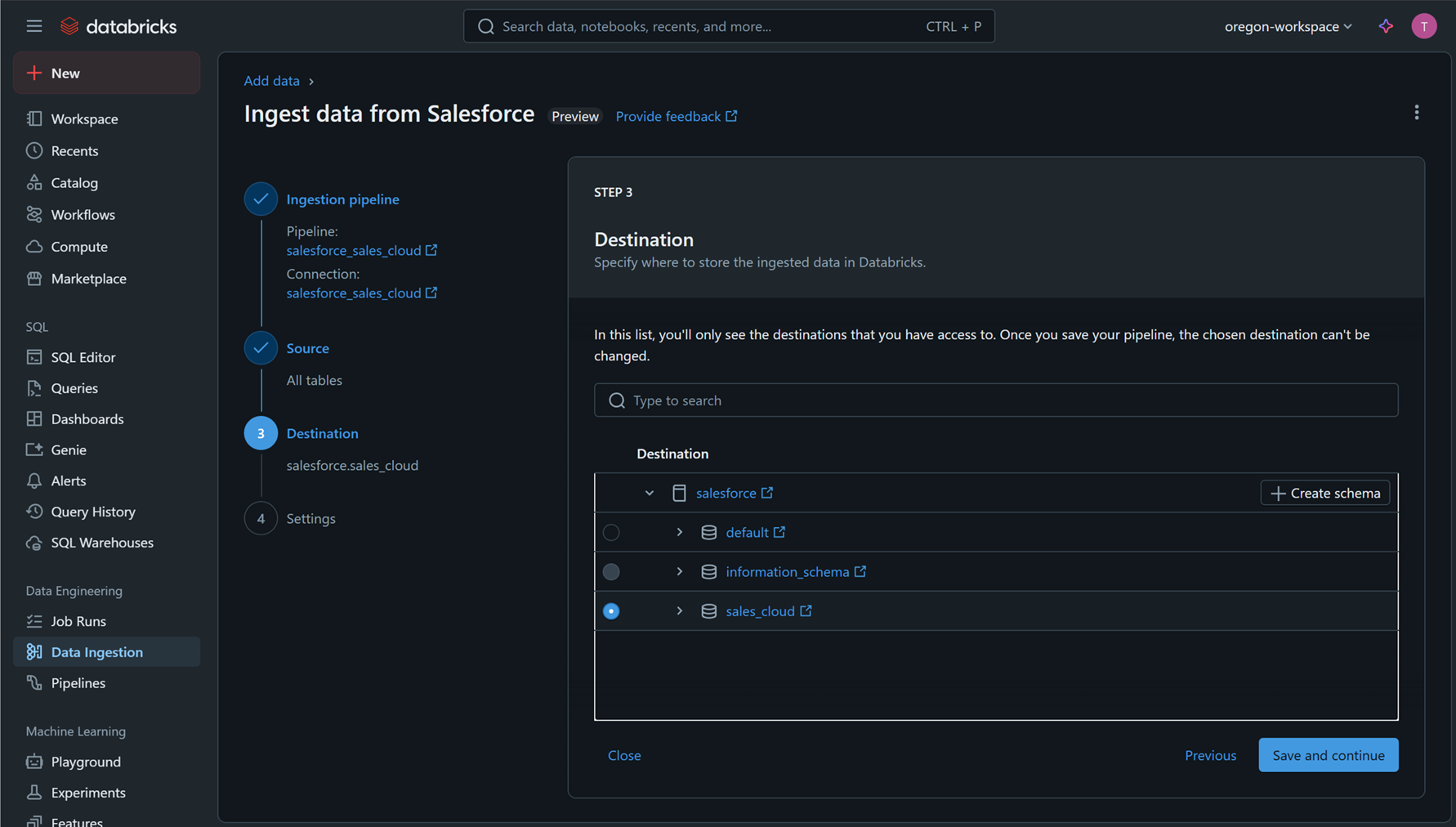

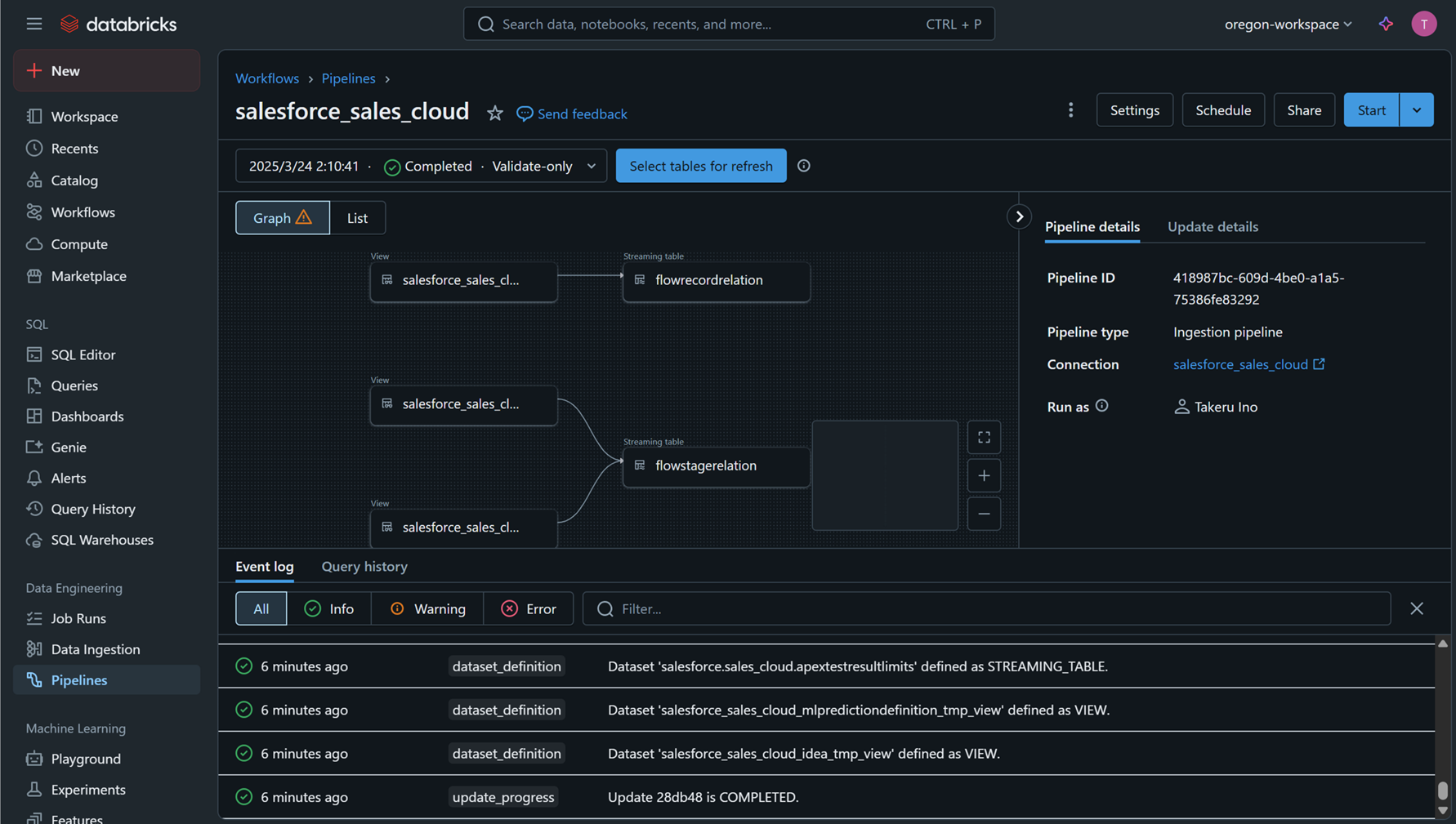

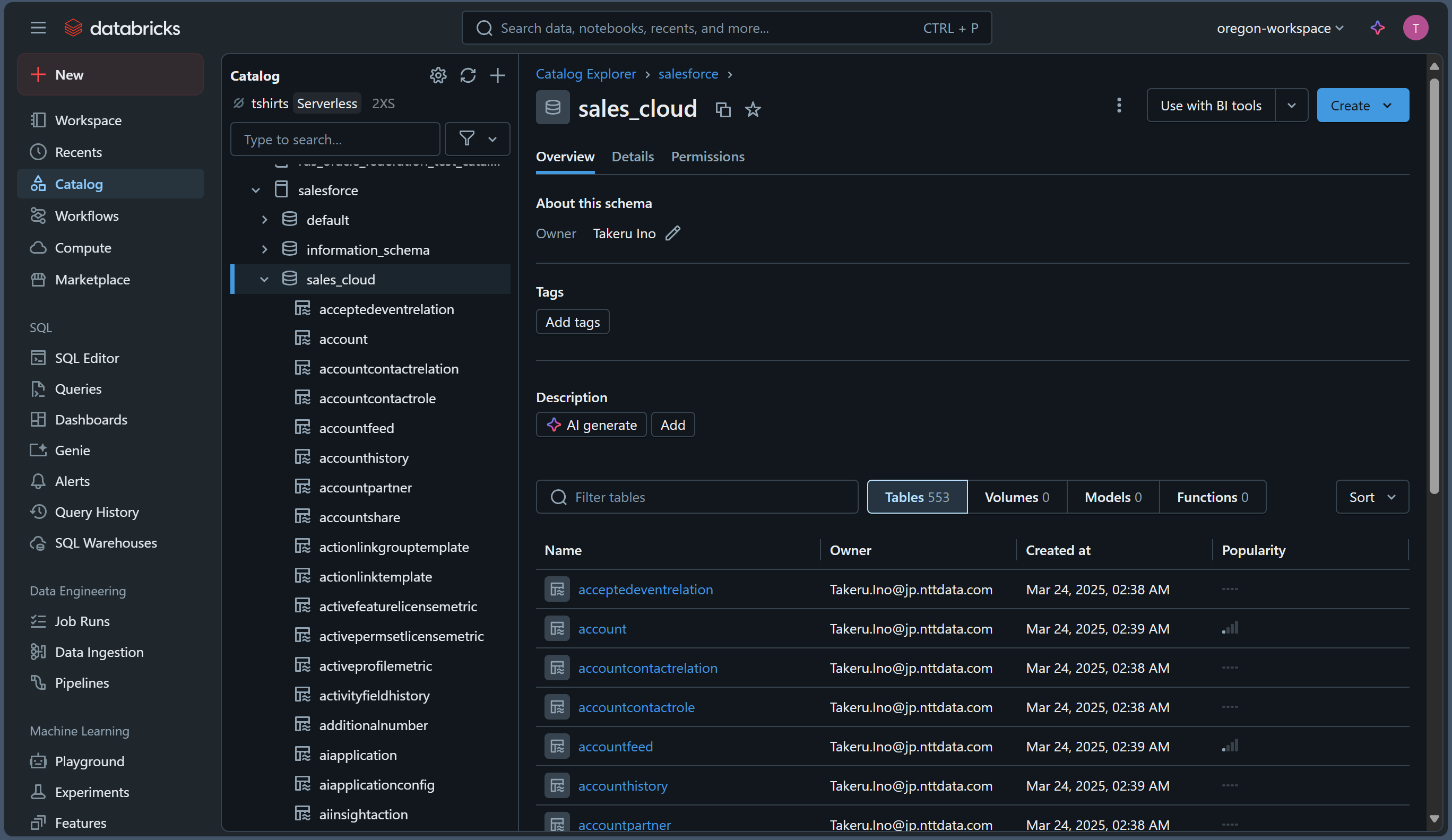

そして、テーブルを格納するカタログ・スキーマを選択します。ここまで実施すると、パイプラインの作成が可能となり、作成と定義の確認のためのValidate Onlyの実行が走ります。(私の手元では完了まで10分程度かかりました)

テーブル更新スケジュールの設定や通知の設定を実施後、初回のパイプライン実行をすることでDatabricks上へのデータ連携が完了します。今回の検証では552テーブル+1テーブル(EventLogFile)が作成されました。

おわりに

このように、Lakehouse Conenctの登場によりSaaSアプリケーションからのデータ連携は格段にやりやすくなりました。サーバレスコンピュートの利用が必須であるため、企業によってはネットワーク周りの考慮が必要になる場合もありますが、是非本機能を活用して開発作業の効率化を推進してください。

仲間募集

NTTデータ テクノロジーコンサルティング事業本部 では、以下の職種を募集しています。

1. クラウド技術を活用したデータ分析プラットフォームの開発・構築(ITアーキテクト/クラウドエンジニア)

クラウド/プラットフォーム技術の知見に基づき、DWH、BI、ETL領域におけるソリューション開発を推進します。

https://enterprise-aiiot.nttdata.com/recruitment/career_sp/cloud_engineer

2. データサイエンス領域(データサイエンティスト/データアナリスト)

データ活用/情報処理/AI/BI/統計学などの情報科学を活用し、よりデータサイエンスの観点から、データ分析プロジェクトのリーダーとしてお客様のDX/デジタルサクセスを推進します。

https://enterprise-aiiot.nttdata.com/recruitment/career_sp/datascientist

3.お客様のAI活用の成功を推進するAIサクセスマネージャー

DataRobotをはじめとしたAIソリューションやサービスを使って、

お客様のAIプロジェクトを成功させ、ビジネス価値を創出するための活動を実施し、

お客様内でのAI活用を拡大、NTTデータが提供するAIソリューションの利用継続を推進していただく人材を募集しています。

https://nttdata.jposting.net/u/job.phtml?job_code=804

4.DX/デジタルサクセスを推進するデータサイエンティスト《管理職/管理職候補》

データ分析プロジェクトのリーダとして、正確な課題の把握、適切な評価指標の設定、分析計画策定や適切な分析手法や技術の評価・選定といったデータ活用の具現化、高度化を行い分析結果の見える化・お客様の納得感醸成を行うことで、ビジネス成果・価値を出すアクションへとつなげることができるデータサイエンティスト人材を募集しています。ソリューション紹介

Trusted Data Foundationについて

~データ資産を分析活用するための環境をオールインワンで提供するソリューション~

https://www.nttdata.com/jp/ja/lineup/tdf/

最新のクラウド技術を採用して弊社が独自に設計したリファレンスアーキテクチャ(Datalake+DWH+AI/BI)を顧客要件に合わせてカスタマイズして提供します。

可視化、機械学習、DeepLearningなどデータ資産を分析活用するための環境がオールインワンで用意されており、これまでとは別次元の量と質のデータを用いてアジリティ高くDX推進を実現できます。

TDFⓇ-AM(Trusted Data Foundation - Analytics Managed Service)について

~データ活用基盤の段階的な拡張支援(Quick Start) と保守運用のマネジメント(Analytics Managed)をご提供することでお客様のDXを成功に導く、データ活用プラットフォームサービス~

https://www.nttdata.com/jp/ja/lineup/tdf_am/

TDFⓇ-AMは、データ活用をQuickに始めることができ、データ活用の成熟度に応じて段階的に環境を拡張します。プラットフォームの保守運用はNTTデータが一括で実施し、お客様は成果創出に専念することが可能です。また、日々最新のテクノロジーをキャッチアップし、常に活用しやすい環境を提供します。なお、ご要望に応じて上流のコンサルティングフェーズからAI/BIなどのデータ活用支援に至るまで、End to Endで課題解決に向けて伴走することも可能です。

NTTデータとDatabricksについて

NTTデータは、お客様企業のデジタル変革・DXの成功に向けて、「databricks」のソリューションの提供に加え、情報活用戦略の立案から、AI技術の活用も含めたアナリティクス、分析基盤構築・運用、分析業務のアウトソースまで、ワンストップの支援を提供いたします。NTTデータとTableauについて

ビジュアル分析プラットフォームのTableauと2014年にパートナー契約を締結し、自社の経営ダッシュボード基盤への採用や独自のコンピテンシーセンターの設置などの取り組みを進めてきました。さらに2019年度にはSalesforceとワンストップでのサービスを提供開始するなど、積極的にビジネスを展開しています。

これまでPartner of the Year, Japanを4年連続で受賞しており、2021年にはアジア太平洋地域で最もビジネスに貢献したパートナーとして表彰されました。

また、2020年度からは、Tableauを活用したデータ活用促進のコンサルティングや導入サービスの他、AI活用やデータマネジメント整備など、お客さまの企業全体のデータ活用民主化を成功させるためのノウハウ・方法論を体系化した「デジタルサクセス」プログラムを提供開始しています。

https://www.nttdata.com/jp/ja/lineup/tableau/

NTTデータとAlteryxについて

Alteryx導入の豊富な実績を持つNTTデータは、最高位にあたるAlteryx Premiumパートナーとしてお客さまをご支援します。

導入時のプロフェッショナル支援など独自メニューを整備し、特定の業種によらない多くのお客さまに、Alteryxを活用したサービスの強化・拡充を提供します。

NTTデータとDataRobotについて

NTTデータはDataRobot社と戦略的資本業務提携を行い、経験豊富なデータサイエンティストがAI・データ活用を起点にお客様のビジネスにおける価値創出をご支援します。

NTTデータとInformaticaについて

データ連携や処理方式を専門領域として10年以上取り組んできたプロ集団であるNTTデータは、データマネジメント領域でグローバルでの高い評価を得ているInformatica社とパートナーシップを結び、サービス強化を推進しています。

https://www.nttdata.com/jp/ja/lineup/informatica/

NTTデータとSnowflakeについて

NTTデータではこれまでも、独自ノウハウに基づき、ビッグデータ・AIなど領域に係る市場競争力のあるさまざまなソリューションパートナーとともにエコシステムを形成し、お客さまのビジネス変革を導いてきました。

Snowflakeは、これら先端テクノロジーとのエコシステムの形成に強みがあり、NTTデータはこれらを組み合わせることでお客さまに最適なインテグレーションをご提供いたします。