環境メモ

⭐️Mac OS Mojave バージョン10.14

⭐️Xcode11.2

⭐️iPhone7(IOS 12.2)

↓↓実際に動かした動画です。

https://twitter.com/nonnonkapibara/status/1213543031627907073

💡機械学習💡

— non (@nonnonkapibara) January 4, 2020

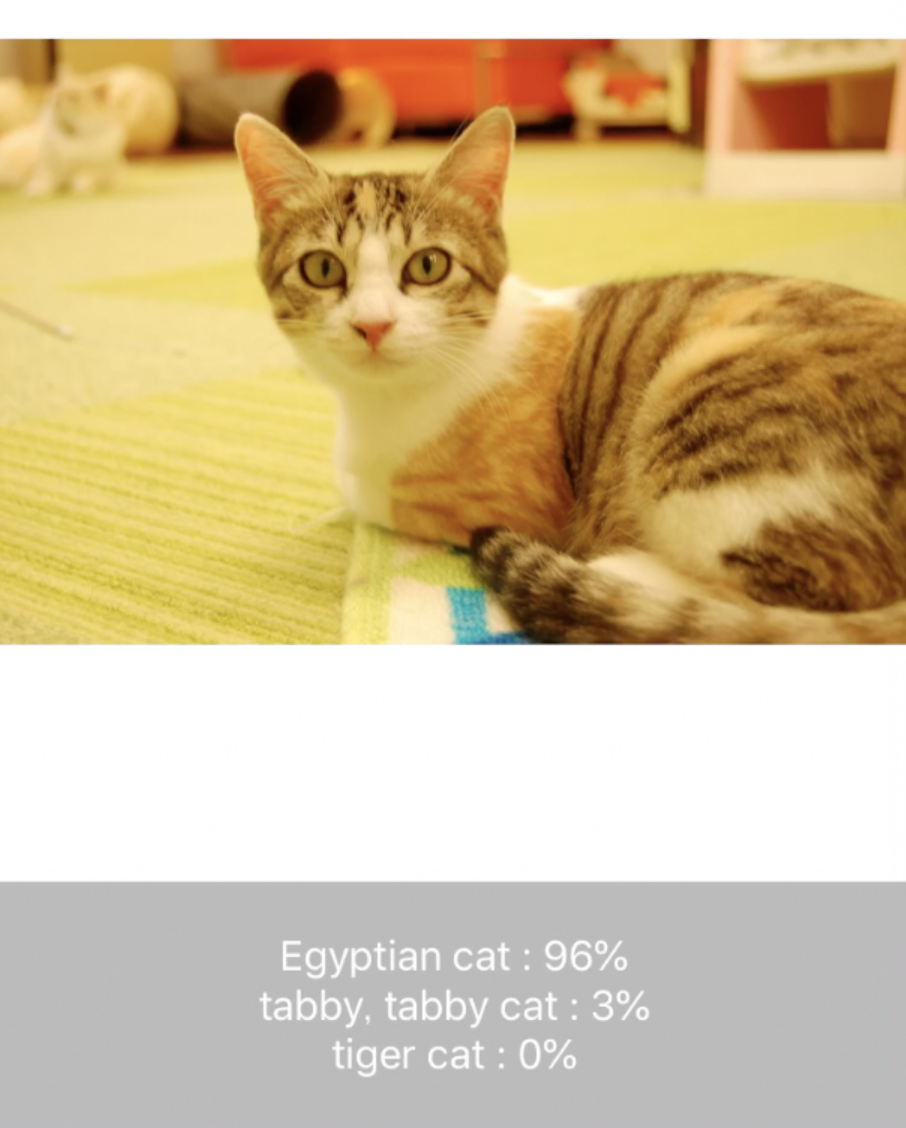

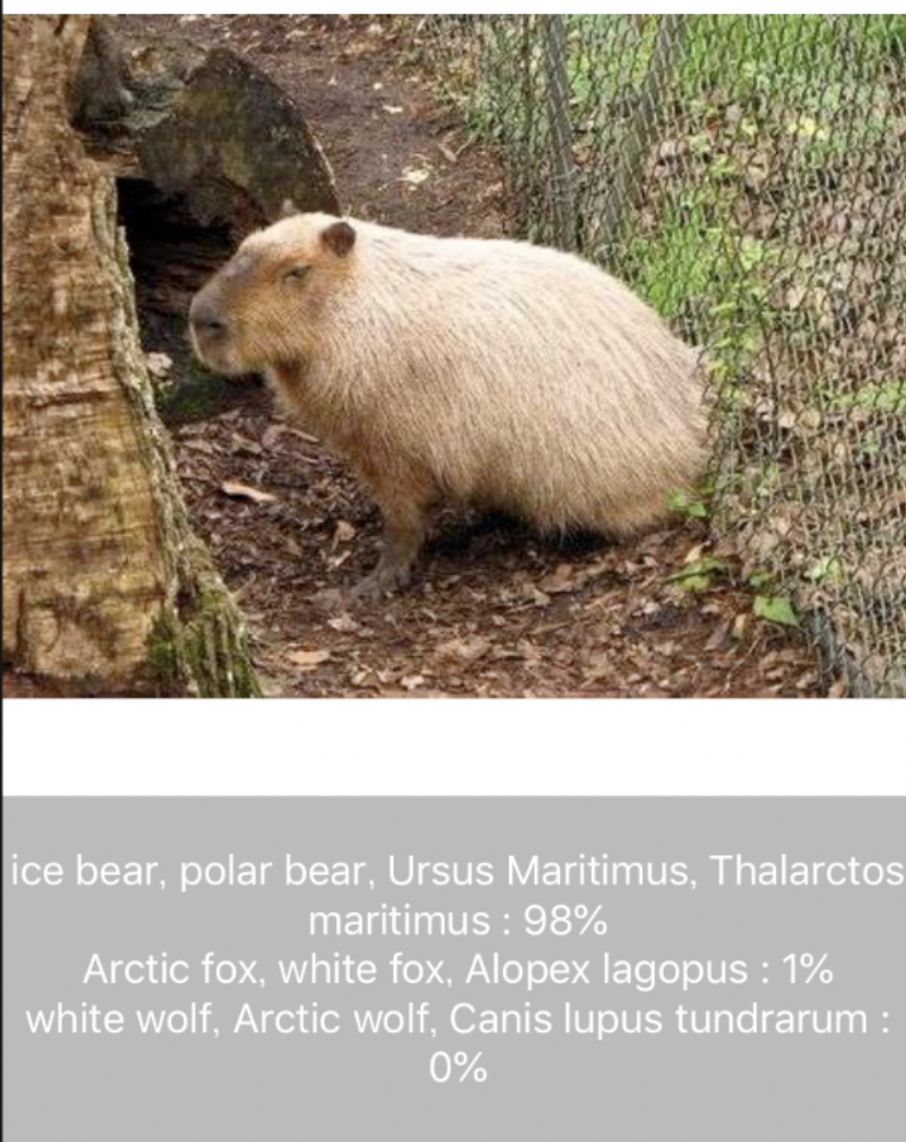

📲iPhoneで🐧カメラロールから😺動物の画像を分類して、何の動物かを推測してみた😍

Appleが提供している学習済みのCore MLモデルを試してみたよぉ😊#CoreMLモデル #Xcodehttps://t.co/oN4VANQoOk pic.twitter.com/1Ip586HniD

Core MLとは

Appleが提供している学習済みのモデル。機械学習の「推論」を行うことができるフレームワーク。

iPhoneやiPadなどApple製品で利用できます。

試したこと

iPhoneで、カメラロールから、動物の画像を分類して、何の動物かを推測してみた。

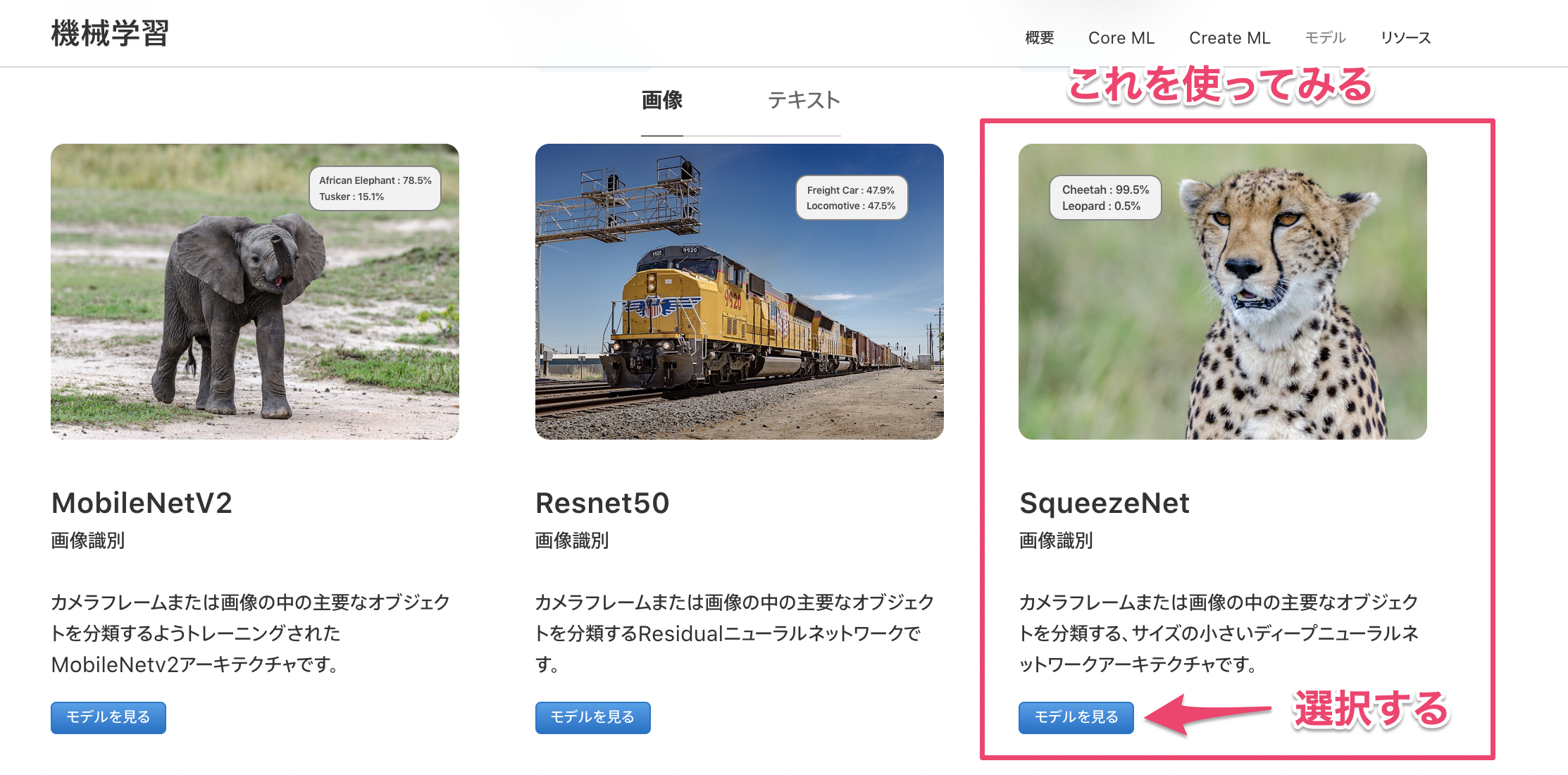

Core MLモデルを入手する

Appleが提供している学習済みのCore MLモデルを入手する

https://developer.apple.com/jp/machine-learning/models/

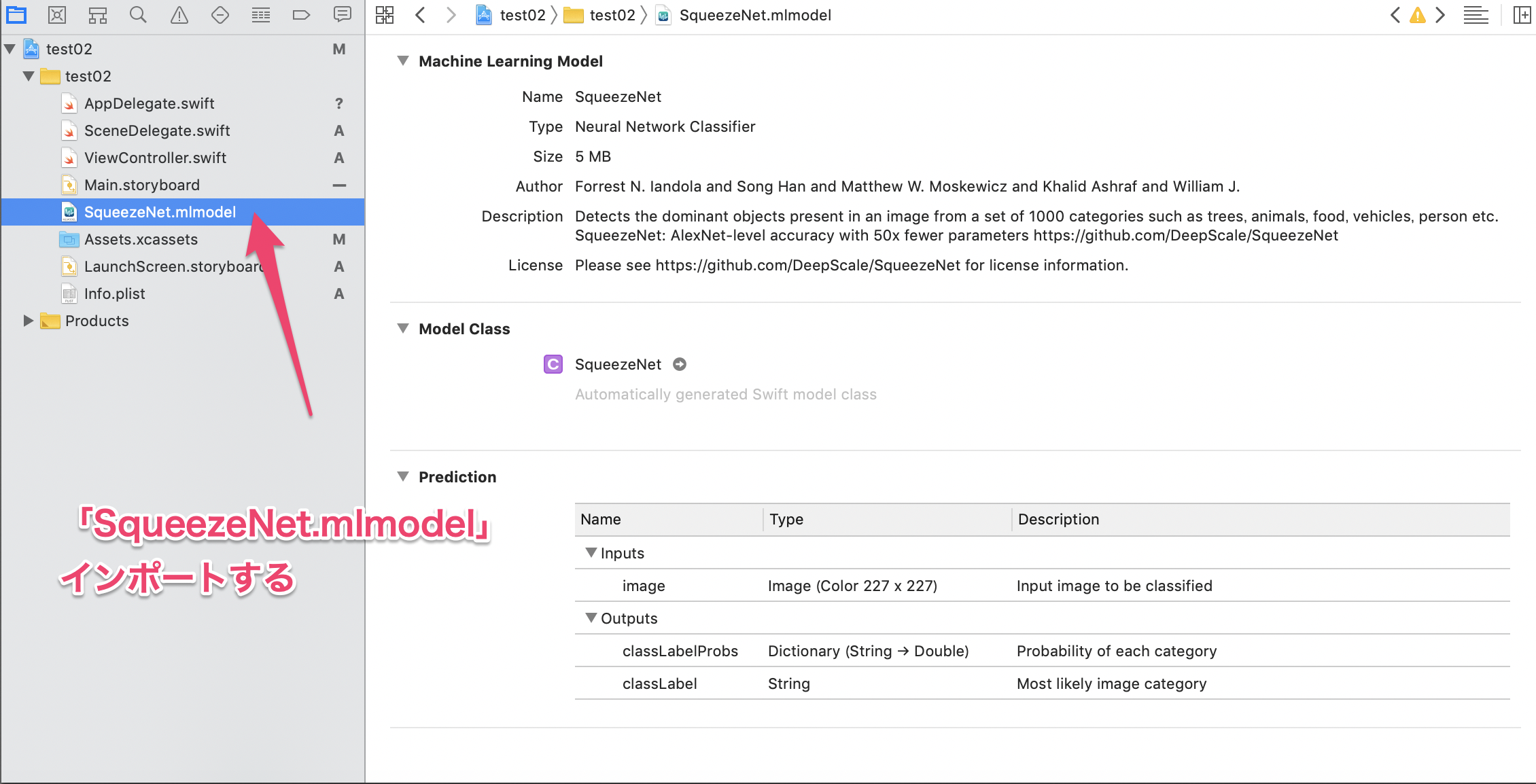

今回は、「SqueezeNet.mlmodel」を使ってみました。

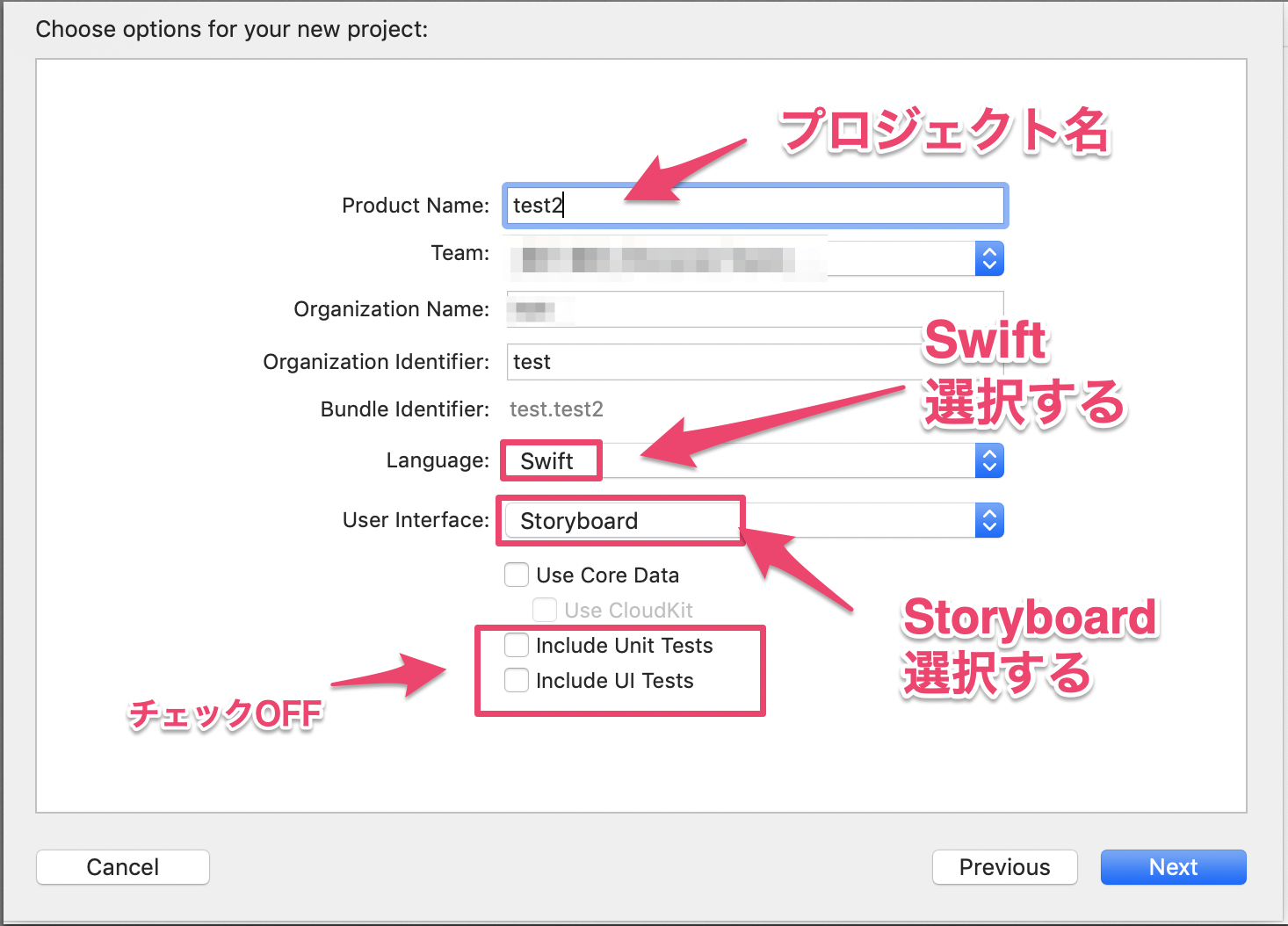

Xcodeで新規プロジェクト

今回は、こんな感じで、カメラロールから画像を参照するプロジェクトを作成

Xcodeに、「SqueezeNet.mlmodel」をインポートする

コーディングで、モデルを定義すればOK

var model = try! VNCoreMLModel(for: SqueezeNet().model)

※コーディングの量が多かったので、割愛してます。