Aidemy 2020/10/28

はじめに

こんにちは、んがょぺです!バリバリの文系ですが、AIの可能性に興味を持ったのがきっかけで、AI特化型スクール「Aidemy」に通い、勉強しています。ここで得られた知識を皆さんと共有したいと思い、Qiitaでまとめています。以前のまとめ記事も多くの方に読んでいただけてとても嬉しいです。ありがとうございます!

今回は、教師あり学習の二つ目の投稿になります。どうぞよろしくお願いします。

*本記事は「Aidemy」での学習内容を「自分の言葉で」まとめたものになります。表現の間違いや勘違いを含む可能性があります。ご了承ください。

今回学ぶこと

・モデルの汎化について

モデルの汎化

(復習)汎化とは

・回帰分析での予測は関数に基づいたものであるが、実際の価格変動には幅があり、入力データが同じでも結果が異なることもままある。

・このような前提のもとで、モデルが過去のデータを信頼しすぎると予測が破綻してしまうことになる。これを過学習と言い、過学習を防ぐことを汎化という。

正則化

・線形回帰における汎化の手段として、__正則化__というものが用いられる。正則化とは、モデルの複雑性にペナルティを設け、モデルを一般化しようとする__ことである。

・正則化には「L1正則化」と「L2正則化」__の2種類がある。

・L1正則化とは、__予測に対する影響が小さいであろうデータの係数を0に近づける__ことで、余分な情報を削減して正則化を行う。

・L2正則化とは、係数の大きさに制限を設けることで、過学習を防いで正則化を行う。

ラッソ回帰

・__ラッソ回帰__とは、L1正則化を使う回帰モデルを指す。

・L1正則化は、余分な情報が多い時に高い効果があるので、例えば__データ数(行数)に対するパラメータ数(列数)が多いとき__などにラッソ回帰が使われる。

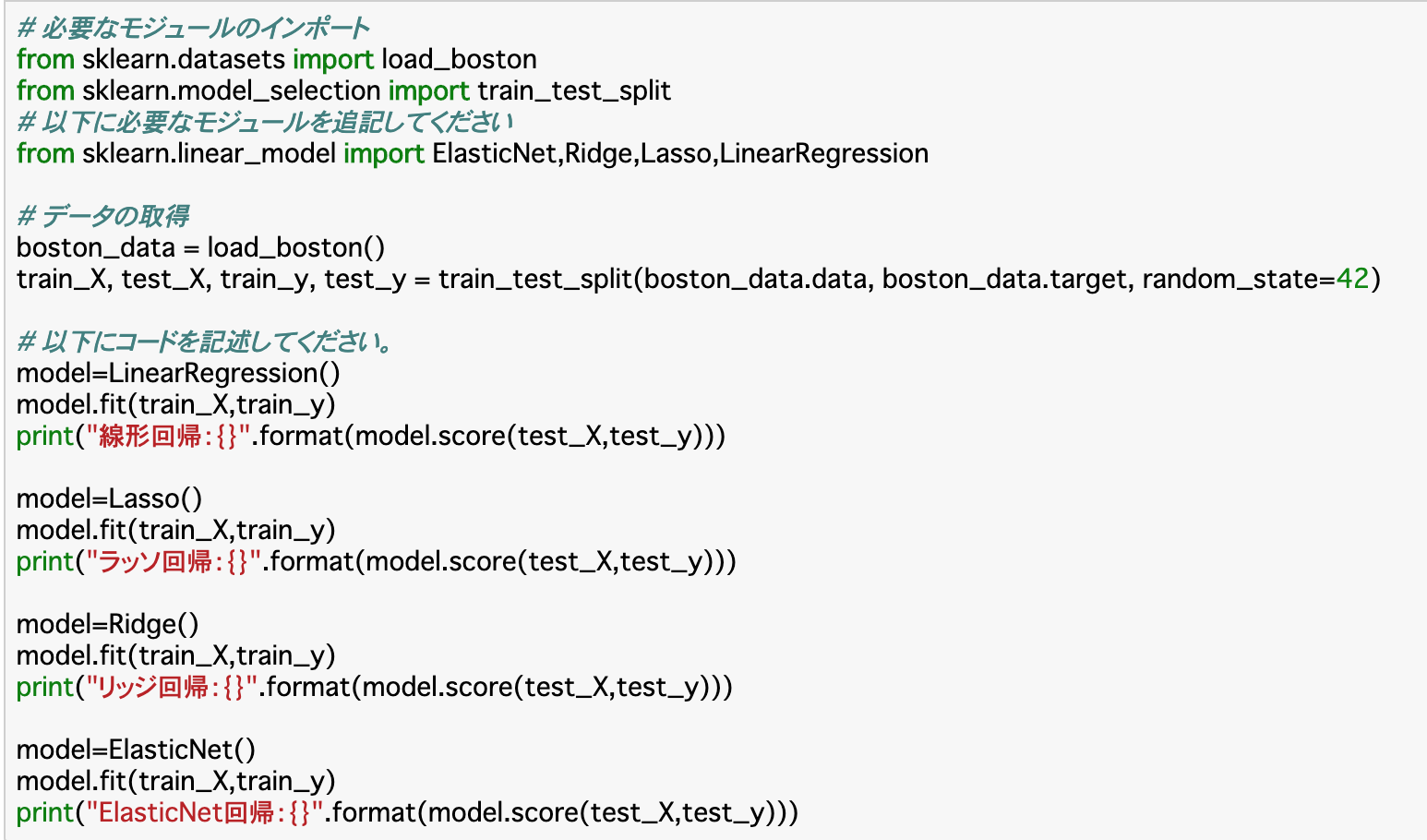

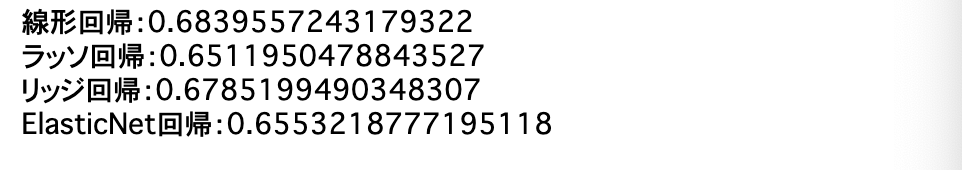

・ラッソ回帰の使い方は、__model=Lasso()__のようにすれば良い。

リッジ回帰

・__リッジ回帰__とは、L2正則化を使う回帰モデルを指す。

・L2正則化は、係数の範囲に上限ができるため、汎化されやすい。

・リッジ回帰の使い方は、__model=Ridge()__のようにすれば良い。

ElasticNet回帰

・__ElasticNet回帰__とは、L1正則化とL2正則化を組み合わせて使う回帰モデルを指す。

・L1正則化の__情報を取捨選択してくれる点__と、L2正則化の__汎化されやすい点__を持つので、メリットが大きい。

・ElasticNet回帰の使い方は、__model=ElasticNet()とすれば良い。

・また、引数に「l1_ratio=0.3」__などのように指定すれば、L1正則化とL2正則化の割合を指定できる。

まとめ

・線形回帰における汎化の手段には、正則化__がある。

・正則化には__L1正則化とL2正則化__があり、前者を使った回帰が__ラッソ回帰、後者が__リッジ回帰__、両方を使った回帰が__ElasticNet回帰__と呼ばれる。

今回は以上です。最後まで読んでいただき、ありがとうございました。