敵対生成モデルに対してリアルに攻撃する系の話。

ざっくりしか読んでないですのでツッコミなど歓迎です。

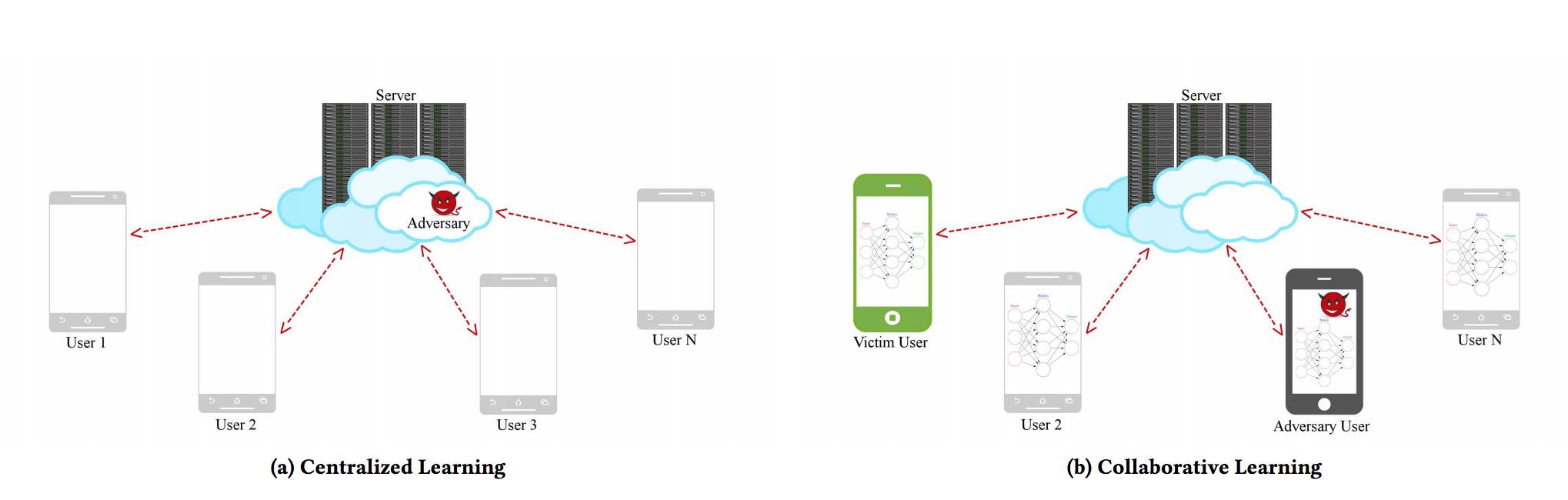

図aのモデルが中央サーバーにある場合は悪意を持ったユーザーは中央サーバーに入ってゴニョゴニョする必要があります。

図bの場合はモデル携帯などに分散されてて、パラメータのみ中央サーバーにある構成の場合。

そもそもこんな構成のシステムってどのくらいあるのだろうか。確かにリアルタイムで学習結果が適応される場合は困る。

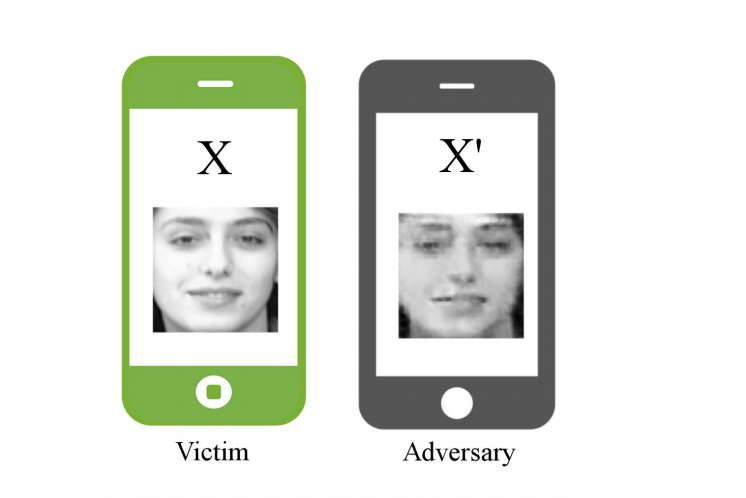

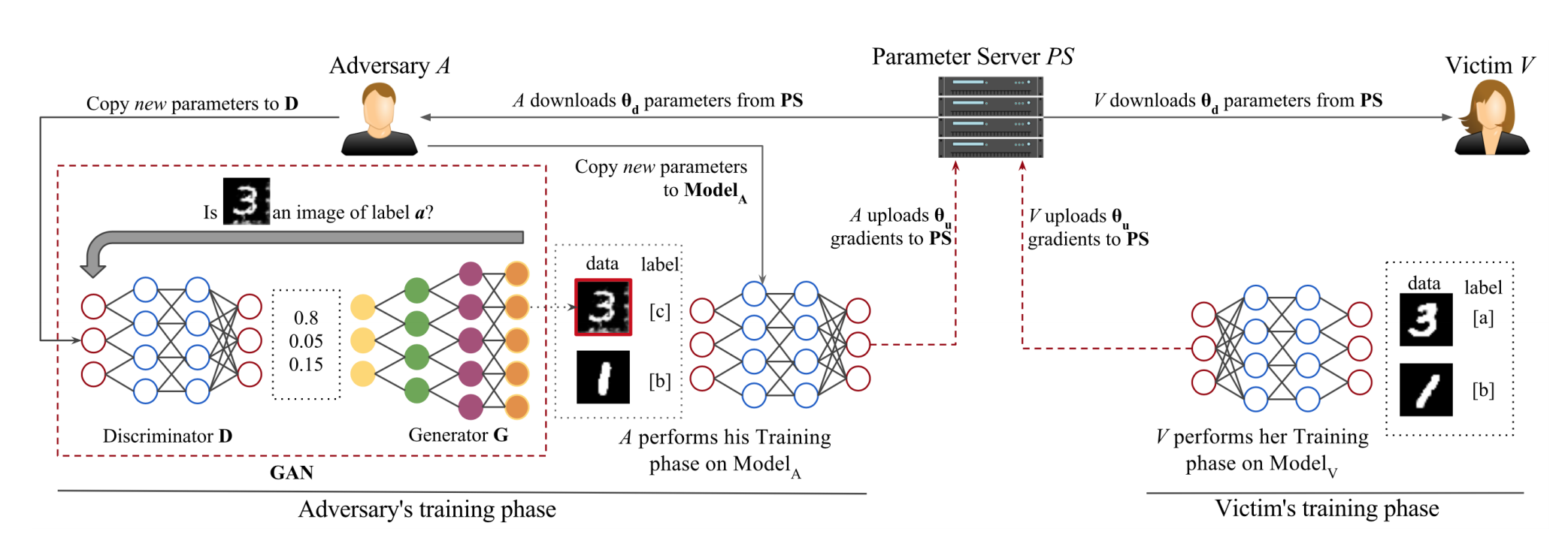

GANの深層学習に対する攻撃。 左が攻撃者。右は一般ユーザー。端末で学習したパラメータ値をサーバーに返してる。

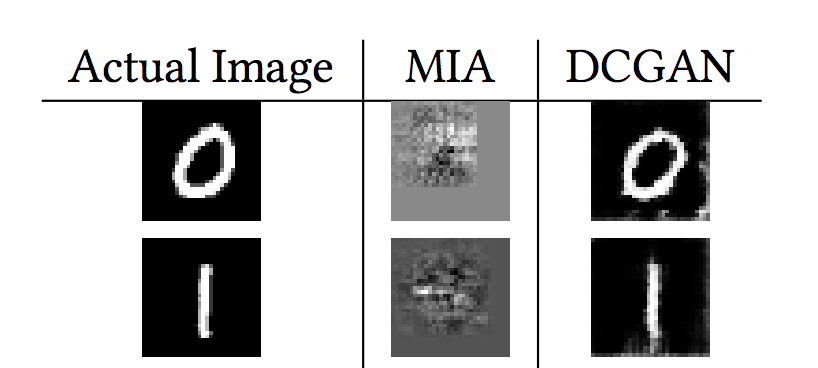

MNISTデータセットで訓練されたCNNでmodel inversion attack(MIA)とgenerative adversarial network (DCGAN)を実行した場合の結果。 DCGANはうまくいってるが、MIAはよくない。