Instance Normalization: The Missing Ingredient for Fast Stylization

Instance NormはBatch NormのBatch Size=1の時と等価である。 Instance Normはスタイル変換という2枚の画像を組み合わせて、両方の画像の特徴を合わせた画像を生成するタスクで使われている。計算式

[pytorch引用](https://pytorch.org/docs/stable/generated/torch.nn.InstanceNorm2d.html)数式通り平均からの差分をとり、標準偏差で割っています。

標準偏差で割る事でデータの分散の影響を受けにくくなる。

結果

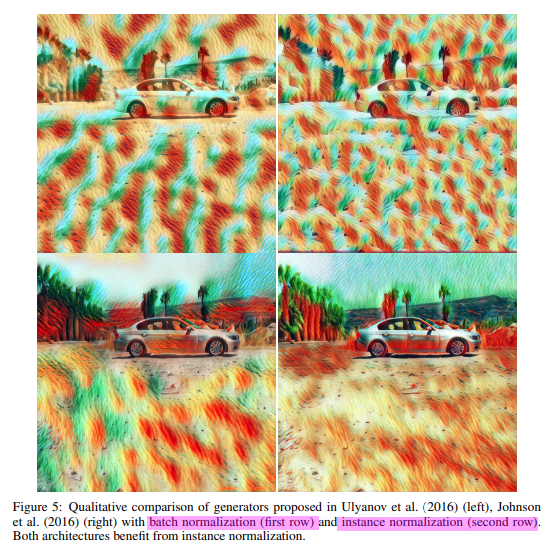

左下の画像(zero pad)より右下の画像(zero pad + instance norm)の方が、入力の画像の特徴を壊さずstylization出来ている

Batch NormよりInstance Normの方が良くstylizationされている