odeling Human Perception of 3D Scenes(Yildiz, 2018)

Q:この論文の概要を教えてください

A:

この論文は、コンピュータグラフィックスにおける人間の3Dシーンの知覚モデリングに関する調査論文です。人間の視覚的注意メカニズム、3D形状の視覚的品質知覚、材質認識の3つの主要な側面に焦点を当て、人工知能と機械学習の手法を用いた最新の研究成果をレビューしています。特に、深層学習を用いた視覚的注意予測や、様々な特徴量と回帰モデルを用いた3Dメッシュの品質評価、そして材質認識における深層学習の応用について詳しく論じており、今後の研究方向についても提案しています。

Q:AIによる3Dシーンの知覚モデル化における現状を説明せよ。

A:

AIによる3Dシーンの知覚モデル化の現状について、資料と会話履歴に基づき説明します。この分野は、人間の視覚知覚をコンピュータで再現し、よりリアルな3Dコンテンツの生成を目指す上で重要な役割を果たします。

1. 視覚的注意(Visual Attention)のモデル化

-

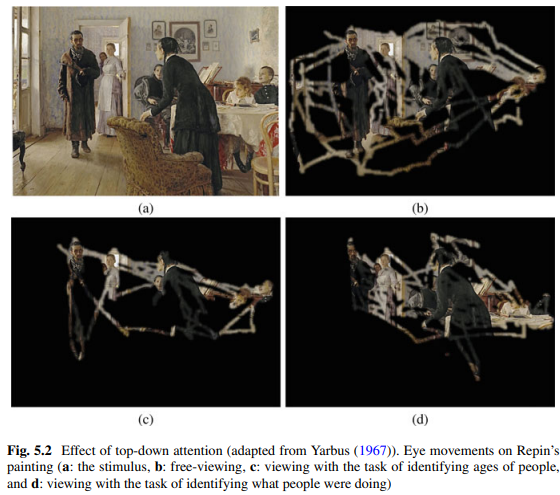

視覚的注意のメカニズム: 人間の視覚システムは、複雑なシーンの中で目立つ部分に注意を向け、認知負荷を軽減します。このメカニズムは、**ボトムアップ(刺激駆動型)とトップダウン(タスク駆動型)**の2つの要素から構成されます。

- ボトムアップ注意: 色、強度、方向、動きなどの視覚的特性に基づいて、シーンの顕著な領域を識別します。初期の研究では、これらの低レベル特徴を抽出し、組み合わせる認知的なアプローチが用いられました。

- トップダウン注意: タスク、目標、経験、意味的な領域など、観察者に依存する要素によって影響を受けます。モデル化が難しく、研究例は少ないです。

-

AIによる視覚的注意のモデル化:

- ディープラーニングの利用: 従来の低レベル特徴に基づくアプローチの欠点を補うため、ディープニューラルネットワークが導入され、顔やテキストなどの高レベル特徴を内部的にエンコードできるようになりました。

-

モデルの例:

- Mr-CNN: 異なる解像度で訓練された複数のCNNを使用します。

- SALICON: 事前学習済みのCNNを、顕著性評価指標に基づいてファインチューニングします。

- DeepGaze I/II: AlexNetやVGGの特徴を利用して顕著性分布を生成します。

- DeepFix: 空間不変性の問題を解決するために、位置バイアスのある畳み込み層を含む全畳み込みニューラルネットワーク(FCN)を使用します。

- SalGAN: 生成的敵対ネットワーク(GAN)を用いて、顕著性マップを予測し、それが正解データと区別できないようにします。

- DVA: 複数の層で監視を行う多段階顕著性予測を提供します。

- 損失関数: 平均二乗誤差、AUC、KLダイバージェンスなどのさまざまなメトリクスが使用され、これらのメトリクスは予測された注意マップの異なる側面を捉えます。

- 動的な視覚的注意予測: 初期のアプローチでは、個々のフレームを処理してから、時間情報を統合するためにプーリング操作を行いました。最近の研究では、エンドツーエンドのネットワークアーキテクチャが好まれており、例えば、空間情報と時間情報をそれぞれエンコードする2つのCNNを組み合わせる手法などが提案されています。

- 3Dにおける視覚的注意: 初期の研究では、2Dと同様に、中心周辺操作を用いて低レベル情報を抽出していました。最近では、ディープラーニングを利用したメッシュ顕著性検出フレームワークや、点群に対する顕著性検出モデルも提案されています。しかし、3Dデータセットの不足が課題となっています。

2. 3D形状の視覚的品質評価(Visual Quality Perception of 3D Shapes)のモデル化

- 3Dモデルの歪み: 3Dメッシュモデルは、簡略化、透かし、圧縮などの幾何学的変更によって歪みが生じる可能性があり、その歪みを定量化するための指標が必要です。

-

品質メトリクスの種類:

- フルリファレンス(FR)メトリクス: 参照モデルと歪んだモデルの距離を測定します。

- ノーリファレンス(NR)メトリクス: 参照モデルなしで品質を直接測定します。

- 幾何学的メトリクス: 人間の知覚を考慮せず、純粋に幾何学的な特性に基づきます。

- 知覚的品質メトリクス: 人間の視覚システム(HVS)の応答を推定します。

-

AIによる品質評価:

- フルリファレンス: 多重線形回帰やSVRを用いて、メッシュ記述子の重みを最適化したり、複数の品質メトリクスを融合したりします。

- ノーリファレンス: SVRやCNNを用いて、顕著性マップ、粗さ、二面角などの特徴量を学習します。

- ディープラーニング: CNNを用いて2Dパッチ画像から特徴量を抽出したり、VGG, AlexNet, ResNetなどの事前学習モデルを利用したりします。

- 評価方法: メトリクスの出力と人間が評価したスコアとの相関を計算して評価します。

-

課題:

- 既存のメトリクスは、人間レベルの性能にはまだ及ばない。

- モーションやアニメーションが知覚される品質に影響を与えるため、動的メッシュへの対応が必要。

- 材質や照明特性も品質の知覚に影響を与えるため、これらの要素を考慮する必要がある。

- データセットの不足。

- タスク依存の品質評価や美的品質の評価に関する研究が不足している。

3. 材料認識(Visual Material Perception and Recognition)のモデル化

- 人間の材料認識: 人間の視覚システムは、材料を迅速かつ正確に識別する能力に優れており、その特性(湿り具合、熟度、古さなど)も判断できます。

-

材料の表現:

- 双方向反射率分布関数(BRDF): 光が表面でどのように反射するかを定義する関数です。

- 双方向テクスチャ関数(BTF): 空間的に変化する材料特性を表現するために、BRDFにテクスチャ座標を追加したものです。

-

AIによる材料認識:

- SVM分類器: 初期の研究では、SVMを用いて材料を分類する試みが行われました。

- 画像統計: 画像の歪度、パーセンタイル、標準偏差などの統計量を組み合わせて、表面アルベドを推定する手法が提案されています。

- ディープラーニング: 近年では、ディープラーニングを用いた手法が提案されており、材料の類似性を測定したり、画像パッチから材料属性空間を生成したりするシステムが開発されています。

-

課題:

- 実世界の複雑な環境における材料認識は依然として課題である。

- 視点依存の要因が材料認識にどのように影響するかについての研究が不足している。

- 材料情報を他のアプリケーション(3D再構成、オブジェクト認識など)に利用する研究も重要である。

これらの研究を通じて、AIによる3Dシーンの知覚モデル化は進歩を続けていますが、人間レベルの知覚を実現するためには、さらなる研究開発が必要とされています。特に、ディープラーニングの活用、動的シーンへの対応、知覚的な要素の組み込み、多様なデータセットの構築が重要な今後の研究課題となります。

Q:材料認識におけるAIと人間の知覚の比較、将来展望は?

A:

資料に基づいて、AIによる材料認識と人間の知覚の比較、そして将来展望について説明します。

AIによる材料認識と人間の知覚の比較

- 人間の材料知覚: 人間の視覚システムは、物体が何でできているかをほぼ瞬時に理解する能力に長けており、紙、金属、木材などの材料を認識できるだけでなく、表面の湿り具合、果物の熟度、本の古さといった微細な特性も識別できます。また、画像の一部だけでも材料を認識できることが多いとされています。

-

AIによる材料認識:

- 初期の研究では、SVM分類器を用いて、黒のマット、黒の光沢、クロム、灰色の光沢、白のマット、白の光沢の6つの材料カテゴリーを認識する試みがありました。このシステムは、平均、分散、歪度などの属性を使用して、コンピューターで生成されたテスト画像に対して94%の精度を達成しました。

- 画像統計を線形に組み合わせることで、人間の知覚に近い精度で表面アルベドを推定するシステムが開発されています。

- 実世界の材料を分類する試みも行われており、色、ジェット、SIFTなどの画像特徴を使用するAugmented LDA法では、Flickr Material Databaseの10カテゴリーの材料に対して44.6%の分類精度を達成しました。SVMベースの分類器では、同じ画像特徴を用いて57.1%の精度を達成しましたが、人間の材料分類精度84.9%には及ばないことが示されています。

- 視覚的および意味的特性を利用した材料分類の研究も行われており、グロス感、透明度、色彩、粗さ、硬さ、冷たさ、脆さ、自然さ、美しさなどの9つの特性に基づいて、k平均クラスタリングにより90%以上の精度で材料分類が可能であることが示されています。

- 最近では、深層学習を用いた手法が提案されており、材料の外観の類似性を測定するシステムや、画像パッチから材料属性空間を生成するシステムなどが開発されています。

-

比較:

- 人間は、材料の識別と特性の判断を迅速かつ正確に行うことができます。

- AIは、特定の状況下では高い精度を達成できますが、実世界の複雑な環境では、人間の能力にはまだ及ばないことが多いです。特に、人間が容易に認識できる微妙な材料の違いを、AIが認識することは依然として課題です。

- AIモデルは、人間の視覚システムを模倣しようとする傾向があり、結果として、人間が犯す可能性のある体系的なエラーを再現することさえあります。

将来展望

-

材料認識の精度向上:

- 深層学習の進歩により、材料認識の精度は向上していますが、特に複雑な実世界の環境における課題は残されています。

- 新たな技術、アーキテクチャ、パラメータの研究が依然として必要とされています。

-

視点依存要因の影響:

- 材料、特に光沢の認識は、視点に大きく影響されます。

- 運動、両眼視、調節といった要素が、材料の認識にどのように影響するかについての研究が進められています。

- 複数の視点からの情報や、異なる焦点で捉えられた情報を組み合わせて材料を推論する方法が研究されています。

-

応用分野の拡大:

- 材料認識の技術は、3D再構成、オブジェクト認識、コンピュータグラフィックスなどのさまざまな分野に応用できる可能性があります。

- 材料の特性を考慮した3D再構成方法や、材料の知識がオブジェクト認識に与える影響などが研究されています。

- また、材料の外観から魚の鮮度や表面の滑りやすさなどの情報を抽出する技術も研究されています。

-

データセットの拡充:

- 材料認識の研究を促進するためには、高品質で多様な材料データセットが必要です。

- 現在利用可能なデータセット(MERL、CUReT、FMDなど)をさらに拡充し、現実世界の複雑な条件に対応できるデータセットを構築する必要があります。

- 人間が体系的に間違いを犯すような画像セットをAIがどのように認識するかといった研究も重要です。

これらの研究を通して、AIによる材料認識はさらに進化し、人間の視覚システムに匹敵する能力を獲得することが期待されます。

Q:3次元シーンの視覚的注意メカニズムのAIモデル化における課題を論ぜよ。

A:

3次元シーンにおける視覚的注意メカニズムのAIモデル化における課題について、資料に基づき考察します。

1. 視覚的注意のモデル化における基本的な課題

- 人間の視覚システムは、複雑な環境において、目立つ点や物体に注意を向けるメカニズムを利用して、シーンの重要な部分を迅速に分析します。このメカニズムは、認知的な負担を軽減する役割を果たします。

- 視覚的注意は、主に以下の二つの要素から構成されると考えられています:

- ボトムアップ(刺激駆動型)成分: 色、強度、向き、動きなどの視覚的特性から計算され、シーンの顕著な領域を特定するのに役立ちます。これは、**顕著性(saliency)**とも呼ばれます。初期の研究では、色や向きなどの特徴マップを抽出し、それらを組み合わせて顕著性マップを作成していました。

- トップダウン(タスク駆動型)成分: タスク、目標、過去の経験、意味的領域などによって影響を受けます。これは、観察者に依存するため、モデル化が難しく、コンピュータグラフィックスの分野ではあまり研究されていません。

- 従来の視覚的注意モデルの主な欠点は、低レベルの特徴量に基づいており、顔、テキスト、物体の部分などの高レベルの特徴量を抽出できないことです。しかし、深層ニューラルネットワークは、このような意味的情報を内部に符号化することで、この問題を解決する可能性があります。

2. AIによる視覚的注意モデル化の現状と課題

- 深層学習は、視覚的注意の計算モデル化に新たな時代を開き、人間の知覚と深層ニューラルネットワークのアーキテクチャとの間の密接な一致が明らかになっています。

- 深層学習を用いた顕著性予測に関する最近の研究では、古典的な手法と比較して、深層モデルが予測性能を大幅に向上させることが示されています。

-

深層学習モデルの例:

- Mr-CNN: 異なる解像度で学習された3つのCNNを使用。

- SALICON: 事前学習済みのCNNを、顕著性評価メトリクスに基づいて微調整。

- DeepGaze I, II: AlexNetやVGGの特徴量を利用した顕著性分布生成。

- DeepFix: 空間不変性の問題を解決するための位置バイアス畳み込み層を含む全畳み込みニューラルネットワーク(FCN)。

- SalGAN: 顕著性マップを生成するネットワークと、それが正解データか予測データかを判別するネットワークを含む敵対的生成ネットワーク(GAN)。

- DVA: 多層での教師あり学習により多段階の顕著性予測を行う深層視覚注意モデル。

- これらのモデルの学習に使用される損失関数も重要な要素であり、平均二乗誤差、AUC、Kullback-Leibler(KL)ダイバージェンスなど、さまざまなメトリクスが使用されています。

- 視覚的注意モデルの多くは、ボトムアップ成分に焦点を当てていますが、深層学習を使用することで、顔やテキストなどの高レベルの特徴も暗黙的に符号化し、トップダウンの視覚的注意にもある程度対応しています。

3. 3次元シーンにおける視覚的注意の課題

- 2次元の視覚的注意予測モデルの研究は多数ありますが、3次元の視覚的注意に関する研究は非常に少ないです。

-

3次元データセットの構築の困難さ:

- 3次元メッシュデータに人間の視線注視のアノテーションを付けるには、手間と時間がかかるため、大規模なデータセットの作成が困難です。

- 既存のデータセットは、サンプル数が少ないか、合成データが多く、現実世界の複雑なシーンを網羅していません。

- 2次元の注視データを3次元にマッピングする際の課題も、3次元視覚的注意の研究を妨げています。

-

3次元視覚的注意モデルの例:

- 初期の研究では、2次元の場合と同様に、中心周辺演算を用いて低レベルの特徴量を抽出していました。

- 最近では、深層学習を用いたメッシュ顕著性検出フレームワークも提案されています。

- 点群に対する顕著性検出モデルも提案されています。

- 時間的要素の欠如: 視覚的注意の研究では、時間的側面が十分に考慮されていません。アニメーションや動きは、注意マップに大きな影響を与える可能性があります。

4. 今後の研究の方向性

- 深層学習を用いた視覚的注意モデルは、人間レベルのパフォーマンスにはまだ達しておらず、新しい技術、アーキテクチャ、パラメータの研究が必要です。

- トップダウンの視覚的注意に関する研究は、ボトムアップモデルと比較して非常に限られています。

- **3次元形状(三角形メッシュ、点群、仮想環境など)**における視覚的注意のモデル化が強く推奨されます。

- 2次元と3次元の両方で、時間的側面を考慮した研究が必要です。

- 大規模で高品質なデータセットの構築が重要であり、特に動画やメッシュの顕著性に関するデータセットの構築が急務です。

- 視覚的注意の予測方法の評価には、さまざまなメトリクスが使用されており、より包括的なメトリクスと評価技術を検討する必要があります。

- 提案された方法の使用を示す以上の応用例が少ないため、レンダリングツールや商用モデリング製品への統合を検討する必要があります。

要するに、3次元シーンの視覚的注意メカニズムのAIモデル化には、データセットの不足、トップダウン注意のモデル化の困難さ、時間的要素の考慮の欠如など、多くの課題が残されています。今後の研究では、これらの課題を克服し、より人間に近い視覚的注意モデルを開発することが期待されます。

Q:視覚的注意メカニズムのモデル化における深層学習の貢献を論ぜよ。

A:

視覚的注意メカニズムのモデル化における深層学習の貢献について、資料に基づいて説明します。

深層学習は、従来の視覚的注意モデルが抱えていた課題を克服し、より人間らしい注意メカニズムのモデル化を可能にしました。具体的には、以下の点が挙げられます。

-

高レベル特徴の抽出: 従来のモデルは、色、強度、方向などの低レベルの特徴に基づいて注意を計算していました。しかし、深層学習モデル、特に**畳み込みニューラルネットワーク(CNN)**を用いることで、顔、テキスト、オブジェクトの一部など、注意において重要な役割を果たす高レベルの特徴を抽出できるようになりました。

- このことは、深層学習モデルが、視覚注意において重要であることが知られている意味的情報を内部的にエンコードできることを示しています。

- 例えば、Mr-CNN, SALICON, DeepGaze, DeepFix, SalGAN, DVAなどの様々な深層学習アーキテクチャが、視覚的注意予測に利用されています。

-

人間の視覚野との整合性: 深層学習モデルのアーキテクチャは、人間の視覚野の構造と密接な関係があることが神経科学とコンピュータビジョンの研究で明らかになっています。

- この発見は、深層学習が人間の注意メカニズムをより正確にモデル化できることを示唆しています。

-

トップダウン注意への対応: 従来のモデルは、主にボトムアップ(刺激駆動型)の注意に焦点を当てていましたが、深層学習モデルは高レベルの特徴を暗黙的にエンコードするため、トップダウン(タスク駆動型)の注意もある程度扱うことができます。

- トップダウン注意は、タスク、目標、経験など、観察者に依存するためモデル化が難しいとされていましたが、深層学習によってそのモデル化の可能性が広がりました。

- 例えば、トップダウンとボトムアップの要素を反復的に組み込むことで、より高度な注意メカニズムをモデル化する試みも行われています。

-

動的視覚的注意の予測: 従来のモデルは静止画像に焦点を当てていましたが、深層学習モデルは時間的な要素を考慮した動画における注意予測も可能にしました。

- 例えば、2ストリームの空間時間的注意ネットワークや、光フローを使用しない効率的なモデル、LSTMネットワークなどが提案されています。

-

3D視覚的注意への応用: 深層学習は、3Dメッシュの注意予測においても活用されています。

- 初期の3Dメッシュ注意モデルは、2Dと同様にセンターサラウンド演算を使用していましたが、近年では深層学習が利用されています。

- 3Dデータセットの不足が課題となっていますが、弱教師あり学習や、3Dオブジェクトの分類知識をメッシュ注意に転移する手法などが提案されています。

-

予測性能の向上: 深層学習モデルは、従来のモデルと比較して、注意予測の性能を大幅に向上させています。

- 例えば、深層学習を用いた顕著性予測に関する最近の調査では、深層モデルが従来のモデルと比較して予測性能を大幅に向上させていることが示されています。

このように、深層学習は、視覚的注意メカニズムのモデル化において、高レベル特徴の抽出、人間の視覚野との整合性、トップダウン注意への対応、動的視覚的注意の予測、3D視覚的注意への応用、予測性能の向上など、多岐にわたる貢献をしています。ただし、現在の深層学習モデルは、まだ人間のレベルには達しておらず、さらなる研究が必要とされています。

Q:視覚的注意のモデル化におけるトップダウンとボトムアップアプローチの違いを説明せよ。

A:

視覚的注意のモデリングにおけるトップダウンアプローチとボトムアップアプローチの違いについて、資料に基づいて説明します。

視覚的注意のメカニズムは、一般的に**ボトムアップ(刺激駆動型)とトップダウン(タスク駆動型)**の2つの要素から構成されると考えられています。

-

ボトムアップ注意: これは、純粋に刺激によって駆動される注意であり、シーンの視覚的な特性(色、強度、方向、動きなど)から計算されます。このタイプの注意は、シーンの顕著な領域を特定するのに役立ちます。

- ボトムアップ注意は、しばしば**顕著性(saliency)**とも呼ばれます。

- 初期の研究では、色や方向などの複数の特徴マップを抽出し、センターサラウンド演算を使用してそれらを組み合わせるという認知的なアプローチが用いられていました。

- これらの研究では、画像内のどの点が注意を引く可能性が高いかを示す顕著性マップが作成されました。

-

トップダウン注意: これは、タスク、目標、以前の経験、意味的な領域などによって影響を受ける注意です。トップダウン注意は、観察者に大きく依存するため、モデル化が難しく、コンピュータグラフィックスではあまり研究されていません。

- 視覚的注意は、観察者の意図や知識によっても変化することがわかっています。例えば、同じ絵を見ても、年齢を特定するタスクと、何をしているかを特定するタスクでは、注視点が異なります。

- トップダウン注意は、ボトムアップ注意とは異なり、観察者の内部状態に依存します。

深層学習は、これらのアプローチを組み合わせることで、より高度な視覚的注意モデルを構築するのに役立っています。

- 深層学習モデルは、低レベルの特徴だけでなく、高レベルの特徴(顔、テキスト、オブジェクトの一部など)も暗黙的にエンコードできるため、トップダウン注意の要素をある程度扱うことができます。

- トップダウンとボトムアップの要素を反復的に組み込むことで、より高度な注意メカニズムをモデル化する試みも行われています。

しかし、トップダウン注意のモデリングは、ボトムアップ注意のモデリングよりも難しいため、研究が限られているのが現状です。

要するに、ボトムアップ注意は刺激によって自動的に引き起こされる注意であるのに対し、トップダウン注意はタスクや目標など、観察者の内部状態に依存する注意であるという点が、両者の最も大きな違いです。

Q:3Dメッシュの視覚的品質評価におけるフルリファレンス手法のAI応用を説明せよ。

A:

3Dメッシュの視覚的品質評価におけるフルリファレンス手法のAI応用について、資料に基づき説明します。

フルリファレンス(FR)手法は、参照となる元のメッシュモデル(歪みのないモデル)が存在する場合に、その参照モデルと歪みのあるモデルを比較して品質を評価する手法です。AI技術は、このフルリファレンス手法において、メッシュの特徴量抽出、歪み量の定量化、品質スコアの予測などのタスクに利用されています。

AIを用いたフルリファレンス3Dメッシュ品質評価の具体的な応用例:

-

多重線形回帰による特徴量重み付け最適化:

- 初期の研究では、曲率値、二面角、幾何学的ラプラシアンなどのメッシュ記述子を用いて、多重線形回帰によって、これらの記述子の重みを最適化し、メッシュの品質を評価していました。

- この手法は、複数のメッシュ特徴量を組み合わせて、品質をより正確に推定することを目指しています。

-

サポートベクター回帰 (SVR) によるメトリック融合:

- 既存の複数のフルリファレンス品質メトリックを組み合わせることで、人間の観察結果との相関を向上させる試みがあります。

- SVRモデルは、これらのメトリックを融合し、よりロバストな品質評価を実現するために使用されています。

-

メッシュ特徴量に基づく距離学習:

- 曲率、粗さなどのメッシュ記述子のヒストグラム統計量を用いて、メッシュの特徴ベクトルを構築し、それらの特徴ベクトル間の重み付きユークリッド距離を計算します。

- この重みは、クラウドソーシング実験で収集された人間の品質評価データに基づいて、Sequential Quadratic Programming (SQP) を用いて学習され、人間の知覚に合わせたメッシュの歪みを定量化します。

-

畳み込みニューラルネットワーク (CNN) による特徴量抽出と品質予測:

- メッシュを異なる視点から2D画像として投影し、その画像から小さなパッチを切り出し、それらをCNNに入力して特徴ベクトルを抽出します。

- 参照メッシュと歪みのあるメッシュの特徴ベクトル間のKullback-Leiblerダイバージェンスを計算し、品質スコアとして出力します。

- このアプローチは、CNNが自動的にメッシュの重要な特徴を学習し、品質評価を行う能力を利用しています。

-

空間プーリング戦略:

- メッシュの歪み分布を計算し、その分布の統計記述子(平均、標準偏差、最大値、最小値、四分位数など)を特徴量として抽出します。

- TPDMメトリックを用いて局所的な歪み分布を計算し、それらの統計記述子と人間の主観的な品質スコアを組み合わせて、SVRモデルを訓練します。

- この手法は、メッシュ全体の歪み分布を考慮に入れることで、品質評価の精度向上を目指します。

これらの研究は、AI技術を用いることで、メッシュの複雑な幾何学的特徴を捉え、人間の知覚に合わせたより正確な品質評価を実現しようとしています。

これらの手法は、メッシュの歪みの定量化や、人間の主観的な評価との相関性向上に貢献しており、3Dモデルの品質管理やレンダリング技術の向上に役立つことが期待されます。

資料には、これらのAI手法に関する具体的な実験結果や、利用されているデータセットについても言及されています。

今後の研究では、これらの技術をさらに発展させ、人間の知覚に近い品質評価モデルを構築することが重要となるでしょう。