この文書の説明

AI応用システムの安全性・信頼性を確保する新世代ソフトウェア工学の確立(科学技術振興機構 研究開発戦略センター)の概要です

本文

AIソフトウェア工学とは

- 従来の演繹型システムとは異なる帰納型システムの安全性・信頼性を確保できる方法論・技術体系である

AIソフトウェア工学に対する二つのアプローチ

- 1:実践から得られる知見の体系化⇒産業界を中心に自ずと進んでいく

- 2:理論・原理に関わる学術研究のアプローチ⇒本書のターゲット

重要な技術的課題(詳細はドキュメント参照)

- 1:機械学習自体の品質保証

- 2:全体システムとしての安全性確保

- 3:ブラックボックス問題への対策

- 4:問題を効率よく解く工学的な枠組み

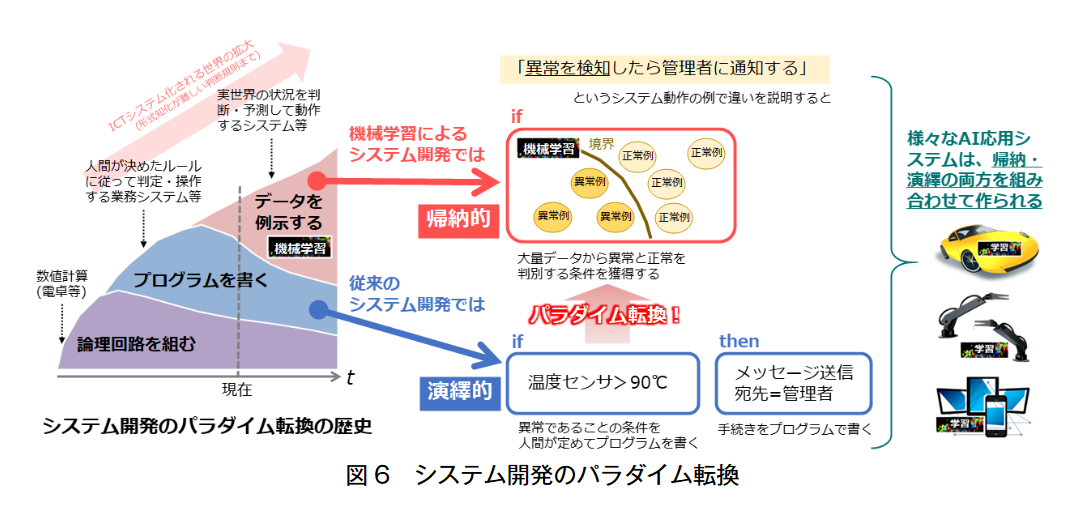

システム開発のパラダイム転換

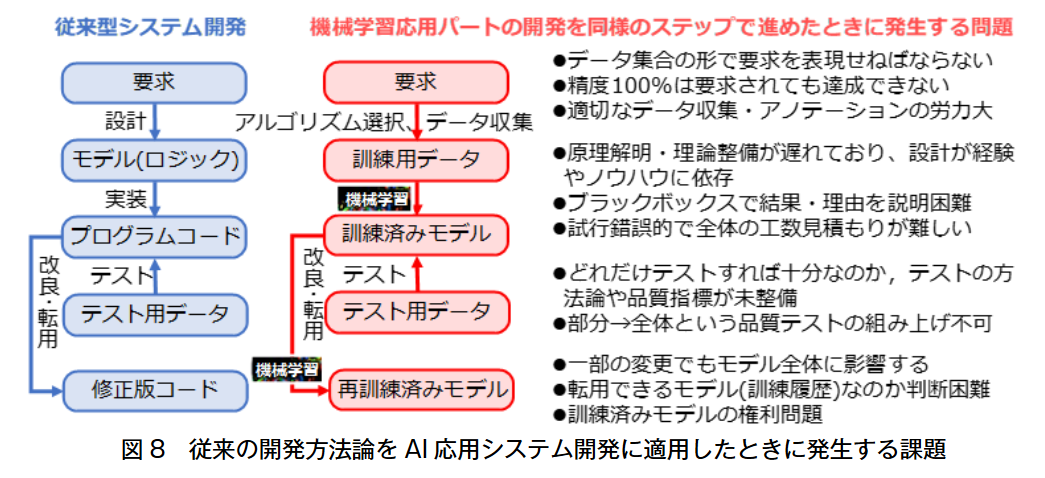

従来の考え方が通用しなくなる例(産業課題)

- V字モデル(ウォーターフォール開発)

- システムの機能(仕様)が、抽象度の高いレベル(上位)から具体的なレベル(下位)へと階層的に分解できることを想定している

- しかし、機械学習のCACE(Change Anything Change Everything)という性質によりその想定が成り立たない

システム安全性が脅かされる例(社会課題)

- Adversarial Examples 攻撃

- 人間には判別できないがAIには影響を与えるようなデータを使って誤認識を意図的に起こさせる行為(adversarial attack などで検索すると出ます)

- Microsoft Tay 公開停止

- 悪意のある者が学習に関与することで不適切なシステムが出来上がる例

- 訓練データに潜む差別・偏見

- 訓練データを作る段階で作業者の差別・偏見が含まれてしまうこと

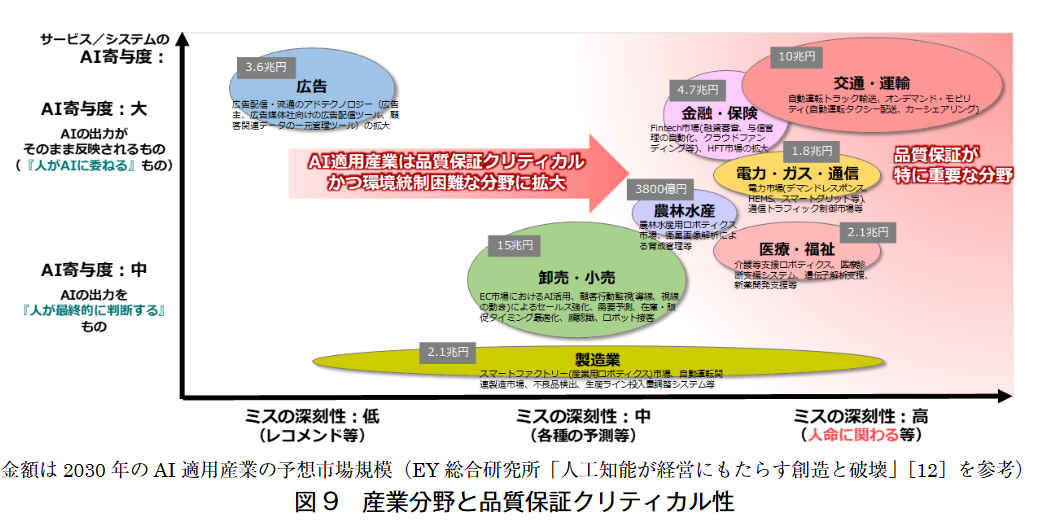

AI適用産業における品質保証の重要性

- 主に「ミスの深刻性」「AI寄与度」「環境統制困難性」の三要素が重要な観点

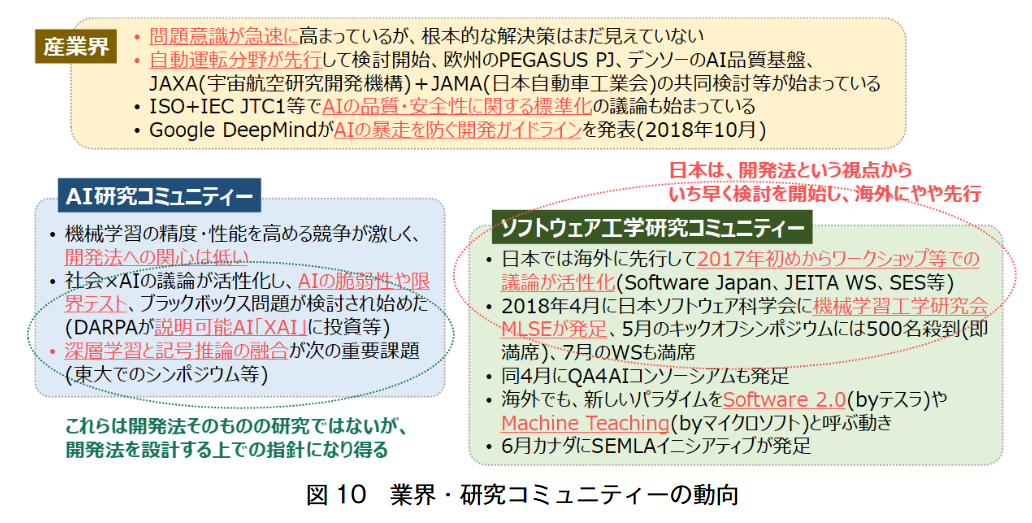

業界・研究コミュニティの動向

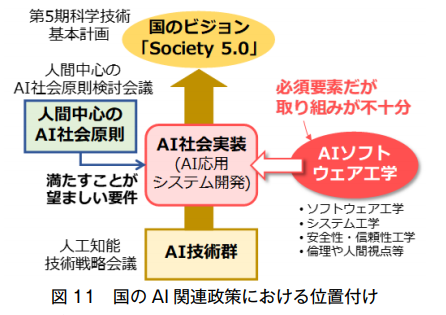

日本のAI戦略・政策との関連

- 日本が掲げる「Society5.0」を成し遂げる為に二つの政策がある

- 「人間中心のAI社会原則検討会議」:AIの社会的・経済的・倫理的・法的な課題を含むAIへの要請を検討

- 「人工知能技術戦略会議」:AI技術そのものの研究開発を推進

- AI応用システムをどのように作れば良いかというソフトウェア工学的な観点の開発方法論・技術体系の研究開発を推進する為の政策が必要である

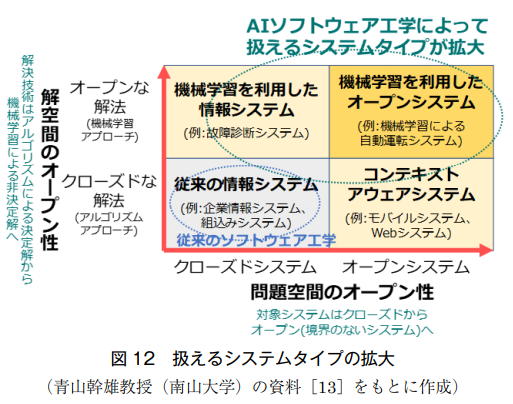

AIソフトウェア工学の進歩による科学技術上の効果

- 新しい学問分野の創出

- 既存のソフトウェア工学を拡張する

具体的な研究開発課題

- AIソフトウェア工学の体系化

- データ集合に着目した機械学習の品質(精度・公平性等)の理論やテスト手法

- 従来型と機械学習型の混在システムの全体としての安全性評価法やリカバリー処理設計法

- システム動作の解釈性向上(事故発生時の原因理解や設計時・利用時の動作予測の容易化)

- 「機械学習(ボトムアップ)と記号推論(トップダウン)を統合した効率的な問題解法

※第4章は省略