はじめに

今回はdeveloper.nvidia.com/blogに投稿されている、Generative AI Sparks Life into Virtual Characters with NVIDIA ACE for Gamesという記事の単純な翻訳および、周辺情報の纏め記事です。

今回もあくまで個人的な備忘録として纏めておりますので、この記事でご興味が出た!という方はぜひ本家の記事をご参照下さい。

[ただの翻訳] Generative AI Sparks Life into Virtual Characters with NVIDIA ACE for Games

Generative AI 技術は、ゲームの構想、制作、プレイの方法に革命をもたらしています。ゲーム開発者は、これらの技術が制作中の2Dおよび3Dコンテンツ作成パイプラインにどのような影響を与えるかを探求しています。感嘆すべき事の1つは、以前のソリューションでは不可能だったランタイムでのゲーム体験を作成できる能力です。

非プレイヤーキャラクター(NPC)の作成は、ゲームがより洗練されるにつれて進化してきました。事前に録音された台詞の数は増え、プレイヤーがNPCと対話するオプションの数も増え、顔のアニメーションもよりリアルになりました。

しかし、プレイヤーとNPCの相互コミュニケーションについては依然として事務処理的であり、スクリプト的であり、対話は短くすぐに尽きてしまい、物語を前進させるだけの役割しか果たしません。今では、Generative AI を使用することで、NPCをより知的にすることができます。会話スキルを向上させ、時間の経過とともに進化する持続的な個性を作り出し、プレイヤーに特有のダイナミックな応答を可能にします。

COMPUTEX 2023で、NVIDIAはゲーム向けのNVIDIA Avatar Cloud Engine (ACE)の未来を発表しました。NVIDIA ACE for Gamesは、AIによる自然言語インタラクションを介してNPCに知性をもたらすカスタムAIモデルの鋳造サービスであり、ゲームやソフトウェアにおいて、開発者はミドルウェア、ツール、ゲームの制作と展開にNVIDIA ACE for Gamesを利用することができます。

開発者はNVIDIA ACE for Gamesを使用して、ソフトウェアやゲームにカスタマイズされた音声、会話、アニメーションAIモデルを構築して展開することができます。

AI基盤モデルの最新のブレークスルーでNPCを生成する

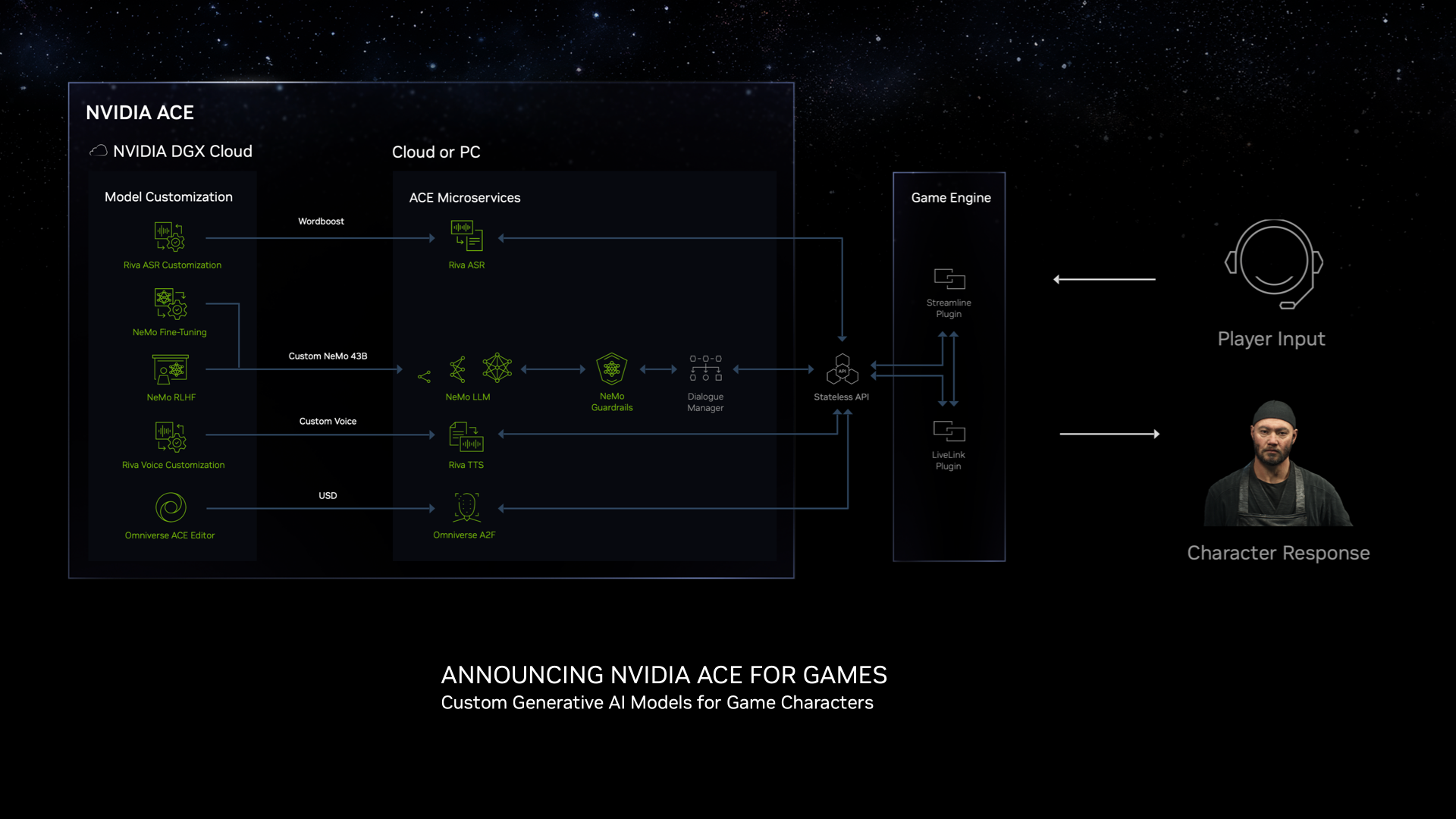

図1: NVIDIA ACE for Gamesを使用してクラウドやPCを通じてLLMをカスタマイズして展開し、インテリジェントなNPCを生成

※Tech Blog:Generative AI Sparks Life into Virtual Characters with NVIDIA ACE for Gamesより引用

(ACEの構成要素である)最適化されたAI基盤モデルには、以下のものが含まれます。

-

NVIDIA NeMo:

- 基盤言語モデルとモデルカスタマイズツールを提供し、ゲームキャラクター向けにモデルをさらに調整できます。必要に応じて、モデルはエンドツーエンドで統合されるか、任意の組み合わせで統合されます。このカスタマイズ可能な大規模言語モデル(LLM)は、ゲームの世界に適合する特定のキャラクターの背景や個性を実現します。

-

NVIDIA Riva:

- 自動音声認識(ASR)およびテキスト音声変換(TTS)の機能を提供し、NVIDIA NeMoとのライブスピーチ会話を可能にします。

-

NVIDIA Omniverse Audio2Face:

- 音声ソースのみの入力からゲームキャラクターの表情豊かな顔のアニメーションを即座に作成します。Audio2FaceにはUnreal Engine 5向けのOmniverseコネクタが備わっており、MetaHumanキャラクターに直接的に顔のアニメーションを追加できます。

NeMoモデルの調整技術を使用することで、NPCに生命を吹き込むことができます。まず、ベース言語モデルが指示に従って役割プレイのタスクを実行できるように、行動複製を使用します。NPCの振る舞いを期待に合わせるために、将来的には人間のフィードバックによる強化学習(RLHF)を適用して、開発プロセス中にデザイナーからリアルタイムのフィードバックを受け取ることができます。

NPCが完全に整列したら、最後のステップとしてNeMo Guardrailsを適用します。これにより、NPCに対してプログラム可能なルールが追加されます。このツールキットは、正確で適切かつトピックに沿ったセキュアなゲームキャラクターの構築を支援します。NeMo Guardrailsは、LLMパワードアプリケーションを開発するためのツールキットであるLangChainをネイティブでサポートしています。

NVIDIAは、あらゆる規模のミドルウェア、ツール、ゲーム開発者向けに、柔軟な展開方法を提供しています。NVIDIA ACE for Gamesを実現するニューラルネットワークは、サイズ、パフォーマンス、品質のトレードオフを様々に考慮し、様々な機能に対して最適化されています。

ACE for Gamesファウンドリーサービスは、ゲーム用のモデルを微調整し、NVIDIA DGX Cloud、GeForce RTX PC、またはオンプレミスを通じてリアルタイムインフレンシング用にデプロイするのに役立ちます。また、展開前にモデルの品質をリアルタイムで検証し、パフォーマンスとレイテンシーをテストして特定の基準を満たすことを確認することができます。

ゲーム用エンドツーエンドのアバターソリューションの構築

NVIDIAは、ACE for Gamesを活用してNPCを構築する方法を示すために、ゲームや仮想世界でAIキャラクターを作成および展開するプラットフォームを構築しているスタートアップ企業 Convaiと提携しました。Convaiは、ACEモジュールを最適化して統合するためにNVIDIAと協力しました。

Convaiの創業者兼CEOであるPurnendu Mukherjee氏は、「NVIDIA ACE for Gamesを使用することで、Convaiのツールは低レイテンシと高品質を実現し、ほとんどの開発者が費用効果の高い方法でAI非プレイヤーキャラクターを利用できるようになります」と述べています。

Convaiは、音声からテキストへの変換やテキストから音声への変換の機能にNVIDIA Rivaを使用し、会話を駆動するLLMにはNVIDIA NeMoを使用し、音声入力からAIによる顔のアニメーションにはAudio2Faceを使用しました。

上記の動画では、これらのモジュールがConvaiのサービスプラットフォームにシームレスに統合され、Unreal Engine 5とMetaHumanに供給され、没入型のNPC Jinを生み出すために使用されました。NVIDIA Lightspeed Studiosのアートチームによって作成されたラーメン店のシーンは、NVIDIA RTX Branch of Unreal Engine 5(NvRTX 5.1)で実行されます。シーンは、光線追跡による照明と影にRTX Direct Illumination(RTXDI)を使用してレンダリングされ、最大のパフォーマンスを提供するためにNVIDIA DLSS3も活用されています。

既存のNVIDIAの生成AI技術は、既にゲーム開発において次のような方法で使用されています:

ヨーロッパを代表するゲーム開発会社の一つであるGSC Game Worldは、今後のゲーム『S.T.A.L.K.E.R. 2: Heart of Chornobyl』でAudio2Faceを採用しています。

インディーゲーム開発者であるFallen Leafも、火星を舞台にしたサードパーソンのサイファイスリラーゲーム『Fort Solis』でキャラクターの顔のアニメーションにAudio2Faceを使用しています。

Charisma.aiなどの生成AIに特化した企業も、会話エンジン内でアニメーションを活用するためにAudio2Faceを利用しています。

NVIDIA ACE for Games、将来の開発動向、および早期アクセスプログラムについて詳しく知るためには、こちらから購読してください。機能、ユースケース、統合に関する詳細については、Convaiを参照してください。NVIDIA RTXとAI技術をゲームに統合する方法についての詳細については、NVIDIA Game Development Resourcesを参照してください。

(翻訳終わり)

所感・補足

NVIDIA ACEについては、https://www.nvidia.com/en-us/on-demand/session/gtcspring23-S51676が解説セッションになっており、概要把握に良さそうです。

本セッション内で「NVIDIA ACE is a suite of real time AI-solutions for end-to-end development of interactive avatars」と説明がされています。また、SIMPLE WORKFLOW #2 (3D avatar from audio input)およびUnified Compute Framework (UCF)の説明がセッション中にありますが、これはComputexでのデモの理解の助けになりそうです。

関連情報