AzureのComputer Vision APIは、普通、写真など実在のものを判定するために使うのでしょうが、それをSecond Life仮想空間の映像に使ったらちゃんと判定してくれるのか、という疑問が湧き、やってみることにしました。

結果だけであれば、画像をSecond Lifeからダウンロードして、Postmanなどを使えば、普通にできます。今回は、LSL(Second Lifeのスクリプト言語)を使って、仮想空間内でスクリーンショット画像を判定するもの(「このSSに何写ってる?」判定機)を作ってみました。日本語にはまだ対応していないので、Translator Text APIで翻訳した結果を返すようにしました。

結果

2017年12月現在、Computer Vision APIから返す結果(英語)はだいたい合っていますが、Translator Text APIから返す結果(日本語)がじわじわ来るものとなっています。

人物編

木の隣に立っている人(person standing next to a tree)

ほぼ完璧です。

水の体の前に立っている男 (a man standing in front of a body of water)

「体」が余計でした残念。英語は合っています。

画像のポーズは女 (a woman posing for a picture)

日本語訳が残念。英語(ポーズを取っている女)は合っています。

場所編

木の床の部屋(a room with a wooden floor)

教室とは判定できないみたいだけど、間違いではない。

建物の表示(a view of a building)

判定を投げ出した感はあるものの、間違いではない。

建物の内側(the inside of a building)

微妙に露天風呂なのですが... 右下のネコは無視。

水のプールで泳いでいる犬(a dog swimming in a pool of water)

逆に、いないはずの動物が出てきたパターン。魚はいましたが、犬はいませんでした。

その他

フォレスト内のツリー(a tree in a forest)

床板のテクスチャなのですが...

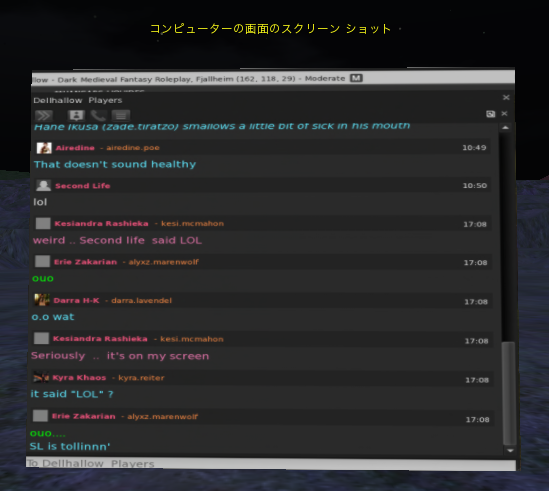

コンピューターの画面のスクリーン ショット (a screenshot of a computer screen)

合っている。完璧。

まあ、そもそも、今までのは全部スクリーンショットだったんだけどね。。

「このSSに何写ってる?」判定機の使い方

以下、Second Lifeで簡単なスクリプトなら作った(使った)ことのある前提で説明します。

-

「Computer Vision API」の無料試用に申し込みます。

-

「Translator Text API」の無料試用に申し込みます。

-

適当なオブジェクトの中にスクリプトを作成し、Gistの内容で上書きします。

-

ここを変更してくださいを、キーやエンドポイントの情報で書き換えて、保存します。 -

判定したいスクリーンショット(SS)を

Ctrl+ ドラッグ でオブジェクトに入れます。オブジェクトの縁が赤くなったのを確認してからマウスを離しましょう。 -

オブジェクトにタッチすると、判定が開始されます。

- チャットとフローティングテキストで、解析結果が表示されます。

- オブジェクトの所有者がフルパーミッション(他の人の場合、次の所有者の権限がフルパーミッション)となるSSを入れたら、オブジェクトのどこか一面にSSが表示されます。

- 2枚以上同時に入れた場合、フローティングテキストとSS表示は、どれか1枚のみとなります。

判定機の実装の仕組み

判定機のスクリプトのうち、コグニティブAPIを呼び出す箇所を中心に説明します。Gistに掲載したスクリプトを確認しながら読んでください。なお、このセクションは、LSL(Linden Scripting Language)をある程度ご存知であることを前提として書かれていますので、その他の方はざらざらっと眺める程度で。

examine()関数 - Computer Vision APIのコール

オブジェクトにドロップされたスクリーンショット(SS)のURLを、Computer Vision APIのAnalyze Imageに渡して、判定してもらっています。

以下のURLで、Second Life仮想空間内にテクスチャとして保存されたSSが取得できます。公式には公開されていませんが、知っている人は知っているSecond Lifeの仕様です。URLの最後は1でも3でもいいですが、2が一番大きなサイズで取得できる感じなので、それを使っています。

http://secondlife.com/app/image/<SSのUUID>/2

llHTTPRequest()のHTTP_BODY_MAXLENGTHの値は、念のために最大の16834に設定してあります。今回は、visualFeatures=Descriptionで絞り込んであるので、ほぼその心配はないはずですが...

関数の全体は、こんな感じです。

examine(string invName)

{

string pictureUUID = llGetInventoryKey(invName);

string url = ENDPOINT_FOR_COMPUTER_VISION + "/analyze?visualFeatures=Description";

list parameters = [

HTTP_METHOD, "POST",

HTTP_MIMETYPE, "application/json",

HTTP_BODY_MAXLENGTH, 16384,

HTTP_CUSTOM_HEADER, "Ocp-Apim-Subscription-Key", KEY_FOR_COMPUTER_VISION

];

string body = "{\"url\":\"http://secondlife.com/app/image/" + pictureUUID + "/2\"}";

key requestId = llHTTPRequest(url, parameters, body);

analyzeImageRequests += [requestId, invName];

}

http_response() 1回目

ステータスが200の場合、レスポンス本文にJSONが入ります。レスポンスにJSONが入る場合は、llJsonGetValue()を有効活用しましょう。LSL仕様では分かりづらい説明となっていますが、第2引数で、識別子を順番に書けば、階層を辿れます。

Analyze Imageの仕様を確認します。descriptionの中にcaptionsがあり、その中にはリストがあり、リストの要素の中にtextがあって、そこに画像のキャプションが含まれます。つまり、キャプションを取得するには、以下のようにします。0はリストの先頭、という意味です。

string caption = llJsonGetValue(body, ["description", "captions", 0, "text"]);

しかし、2017年12月現在は、英語と中国語にしか対応していません。デフォルトでは、captionに英語の文章が入ってきます。英語が苦手な方に対応するために、この文章を日本語化する必要があります。そこで、Translator Text APIの出番です。

translate()関数 - Translator Text APIのコール

Translator Text APIの/Translateの仕様に沿ってリクエストを生成して送信します。キャプションの中に、半角空白が含まれているため、一応llEscapeURL()でURLエスケープしていますが、やらなくても同じ結果が取得できていますので、どっちでもいいかもしれません。

関数の全体は、こんな感じです。

translate(string invName, string caption)

{

string url = "https://api.microsofttranslator.com/V2/Http.svc/Translate?appid&text=" + llEscapeURL(caption) + "&to=ja";

list parameters = [

HTTP_METHOD, "GET",

HTTP_MIMETYPE, "text/plain;charset=utf-8",

HTTP_BODY_MAXLENGTH, 16384,

HTTP_CUSTOM_HEADER, "Ocp-Apim-Subscription-Key", KEY_FOR_TRANSLATOR_TEXT

];

key requestId = llHTTPRequest(url, parameters, "");

translateRequests += [requestId, invName];

}

http_response() 2回目

ステータスが200の場合、レスポンス本文にXMLが入ります。JSONで返してもらうようにすることができません。LSLは標準のXMLパーサーが無いので大変です。

まず、返ってくるXMLの内容を確認します。このような感じで返されることが分かります。

<string xmlns="http://schemas.microsoft.com/2003/10/Serialization/">">目当ての文字列</string>

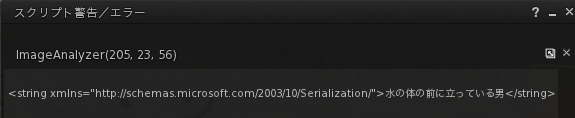

llOwnerSay()やllSay()などで、レスポンス本文を普通にチャットで発言させようとしても、うまくいきません。肝心の文字列の部分が一部表示されなかったり、全く表示されなかったりします。

原因はどうやら、http://...のURLの部分にあるようです。URLが開始されると、ダブルコーテーションの存在にも関わらず、残り全部をURLだと解釈してしまい、このようになってしまいます。デバッグチャネル(DEBUG_CHANNEL)にllSay()させれば、ちゃんと全体を確認できます。

開始タグの>の後から、終了タグの<の前までを抜き出して、チャットさせます。

integer start_pos = llSubStringIndex(body, ">");

string work = llDeleteSubString(body, 0, start_pos);

integer end_pos = llSubStringIndex(work, "<");

string translatedText = llGetSubString(work, 0, end_pos - 1);

llSay(0, "「" + invName + "」には 「" + translatedText + "」が写っているようです。");