概要

Jumping through Local Minima: Quantization in the Loss Landscape of Vision Transformers

- 概要:Eval-Q. ViTの量子化の鋭敏さの改善

- 研究機関:ARM

- 新規性:ViTの量子化の特性に、量子化スケール対精度やロスの鋭敏さがあることを指摘し、対策

- キモ:Contrastiveロスを入れてロスを滑らかにし、進化的アルゴリズムで最適化する。

Unified Data-Free Compression: Pruning and Quantization without Fine-Tuning

- 概要:UDFC. データ無し枝刈り、量子化

- 新規性:データ無し枝刈りと量子化を同時にする

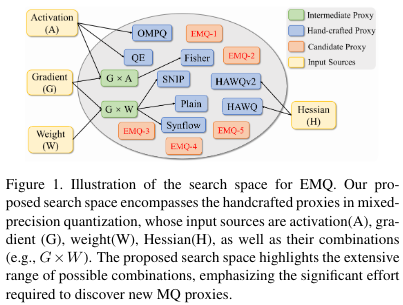

EMQ: Evolving Training-free Proxies for Automated Mixed Precision Quantization

DenseShift : Towards Accurate and Efficient Low-Bit Power-of-Two Quantization

- 概要:Shift Network (かけ算の代わりにビット演算を使う)の精度改善

- 研究機関:Huawei

- 新規性:低ビットShift Networkの精度改善

- キモ:ゼロ重みは結果に寄与しないので、ゼロが起こらないようシフトする仕組みを入れた。(2)式、Fig. 3.

EQ-Net: Elastic Quantization Neural Networks

- 概要:どのようなデバイスでも精度の良いDNNの探索。

- 新規性:NVIDIAやQualcommで量子化方法が違うことを指摘し、どのような用途でも精度の良いDNNを探索する。Fig. 1.

- キモ:(3)式でどのような条件にも合わせて最適化。量子化条件をMLPで精度を予測してGAで探索。

-

画像や数式は論文から引用しています。 ↩