概要

Fire Together Wire Together: A Dynamic Pruning Approach with Self-Supervised Mask Prediction

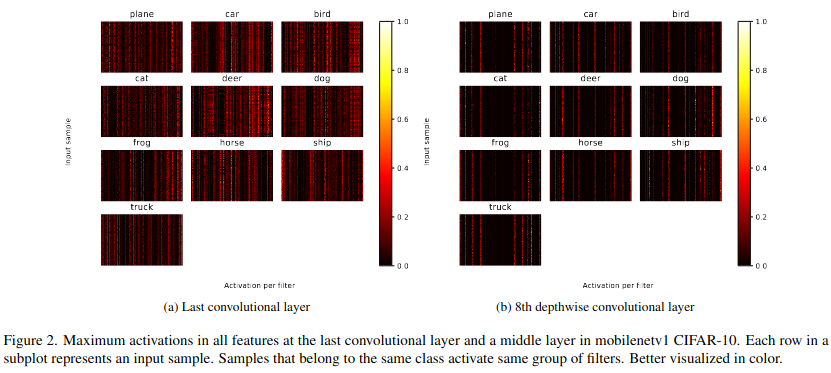

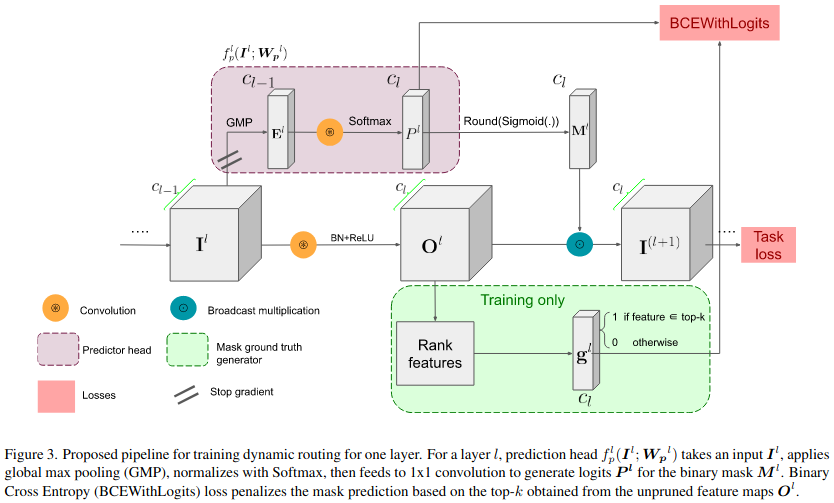

概要:Dynamic Pruning (サンプル毎に、サブネットワークを切り替えて推論する) の手法

新規性:マスクをself-supervisedで学習できる方法を提案した。画像ではなく、クラスで使うチャネル(マスク)が変わっている。

キモ:マスクのロス関数 BCEWithLogits。

評価:VGG, ResNet, MobileNet, CIFAR, ImageNetで評価した。

When to Prune? A Policy towards Early Structural Pruning

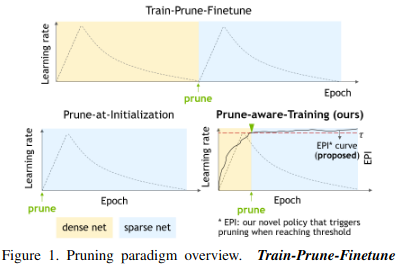

概要:Prune-aware-Training (PoT). 高速な枝刈り学習

研究機関:NVIDIA

新規性:学習の序盤に刈ることで、高速・高精度に学習できる。従来のTrain-Prune-Finetuneは2回学習が必要だし、Prune-at-initializationは精度が落ちる課題があった。

キモ:学習してネットワークが代わらなくなったら(EPI$\sim 1$)1回だけ刈る。

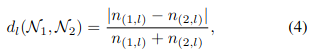

$n_{(k, l)}$はニューロン数

評価:MobileNet, ResNet等で実験した。

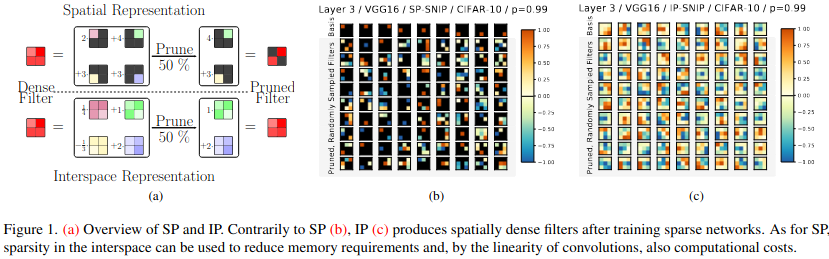

Interspace Pruning: Using Adaptive Filter Representations to Improve Training of Sparse CNNs

概要:枝刈り学習

新規性:枝刈り学習で、特徴をInterspace representationで表して学習することで表現力を上げる。

キモ:特徴を、ある空間の線形結合でモデル化する。

評価:VGG, ResNet, CIFAR, ImageNetなどで評価した。

-

画像や数式は論文から引用しています。 ↩