はじめに

生成AIについて学習をするため Amazon Bedrock を試してみました。

今回は Anthoropic 社の Clude 3 Haiku を試したいと思います。

基盤モデルの有効化

今回は Claude を利用するためバージニアで作業を行います。

-

AWSマネジメントコンソール > Amazon Bedrockをクリックします。 -

使用開始をクリックします。

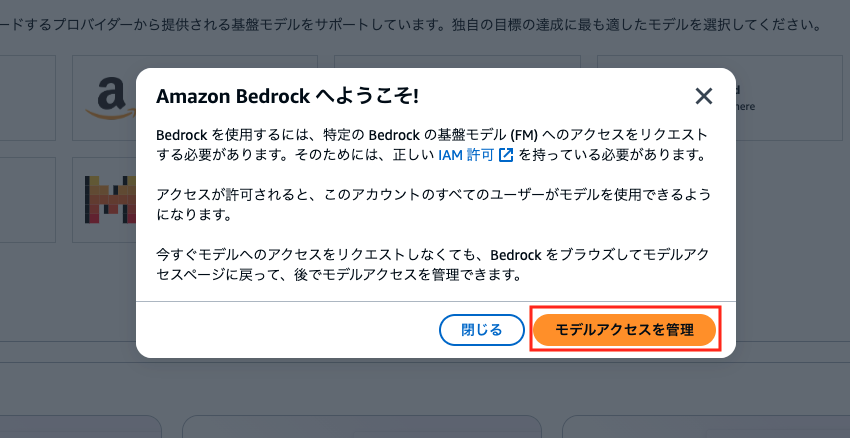

初めての場合は以下のようなポップアップが現れるため [ モデルアクセス管理 ] をクリックします。

もし、表示されない場合は左下にある [ モデルアクセス ] をクリックします。

- 対象となるベースモデルの [ リクエスト可能 > モデルアクセスをリクエスト ] をクリックします。

- Use case details で会社情報などが求められるため入力し、 [ Next ] をクリックします。

- 確認画面になるので、今回使いたい Claude 3 Haiku 指定されていることを確認し [ Submit ] をクリックします。

しばらくして アクセスが付与されました となればOKです。作業した際は有効になるまで数分かかりました。

チャットを試してみる

有効化できたので実際に試してみます。

基盤モデルの適用

-

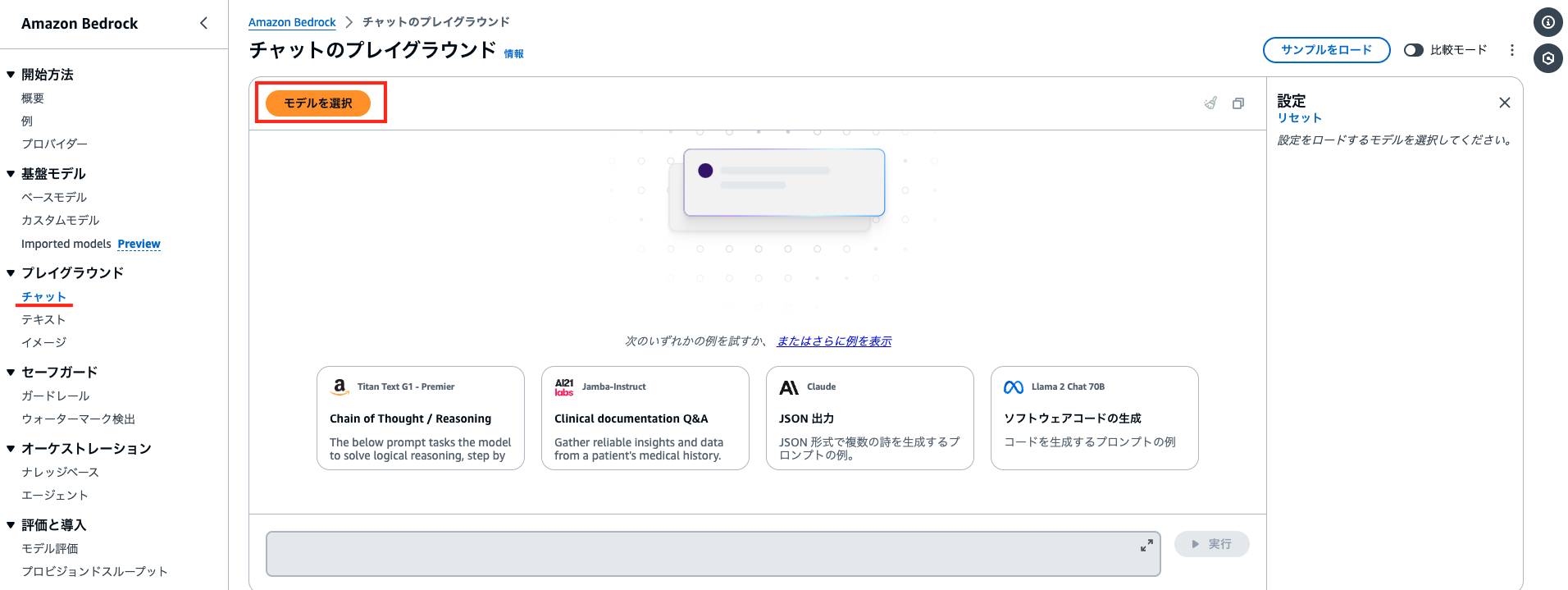

Amazon Bedrock > プレイグラウンド > チャットから [ モデルを選択 ] クリックします。

- モデルを選択 で [ Anthoropic > Cloude 3 Haiku ] を選択し [ 適用 ] をクリックします。

質問してみる

テキストが入力できるようになるので質問したい内容を入力し [ ▶️ 実行 ] をクリックします。

今回は 「日本で一番高い山はなんですか?」 というシンプルな質問をしてみました。

すると以下の内容を Claude が回答してくれました。

また、モデルメトリクス というチャットに関わる情報についても確認できます。

| メトリクス | 説明 |

|---|---|

| レイテンシー | オンデマンド消費モデルに基づいて、FM(基盤モデル) がシーケンス内の各トークンを生成するために使用する時間量。 |

| 入力トークン数 | 推論中に FM(基盤モデル) が使用した入力トークンの数。 |

| 出力トークン数 | FM(基盤モデル) による回答で生成されたトークンの数。 |

| コスト | オンデマンド消費モデルに基づく、入力と出力の処理にかかる推定コスト。 |

今回の質問では レイテンシー が 2256 ms、 入力トークン数 が 22、 出力トークン数 が 179 と出ています。

なぜか コスト の表示がないのですが、無料利用枠は無いためもしかしたら費用が低すぎて表示できないのかもしれません。

それでは、引き続き質問してみます。

前の質問の返答を受けて追加で質問する感じで聞いてみました。

Bedrock も前のやりとりの内容を引き継いだ返答をしてくれています。

今度は質問ではなくお礼を言ってみます。

ここもちゃんと今までのやり取りを受けての返答です。

頭の部分は違和感ありますが、そのあとはとても丁寧な返答です。

おわりに

今回は初めてというこでとりあえずどんな感じかを試してみました。

もう少し色々触れてみたらそれも記事にしていきたいと思います。

参考