今年は自動生成AIの話題で非常に盛り上がりました。

そして、私も以前から、自動生成AIには興味があり、仕事でも趣味でも活用できないか試していました。

その試していた中に「AITuber」というものがありました。

Vtuberの中の人がAIになったものです。

Youtubeで検索すればいろいろなキャラクターが出てきますし、構築方法も調べれば簡単に見つけることができます。

今日はその話を書いてみようと思います。

準備

いろいろ調べてもいいのですが、下記の書籍を買って、その通りに作れば動くものは簡単にできます。

AITuberを作ってみたら生成AIプログラミングがよくわかった件

必要な環境構築の方法、VoicevoxやOBS、Youtube Liveの設定方法、それを連携して動作させるPythonのスクリプトの情報が一通り揃っています。

キャラクターの画像すら、試すために用意されているという至れり尽くせりの本でした。

細かいところは、端折りますが私は以下の環境を作って試しました。

Windows 11 Home 23H2

Python 3.11.6

Voicevox 0.14.10

OBS Studio 39.0.0

書籍に記載されていたバージョンよりは新しいものを使って構築してみましたが、特に問題なく、動いていました。

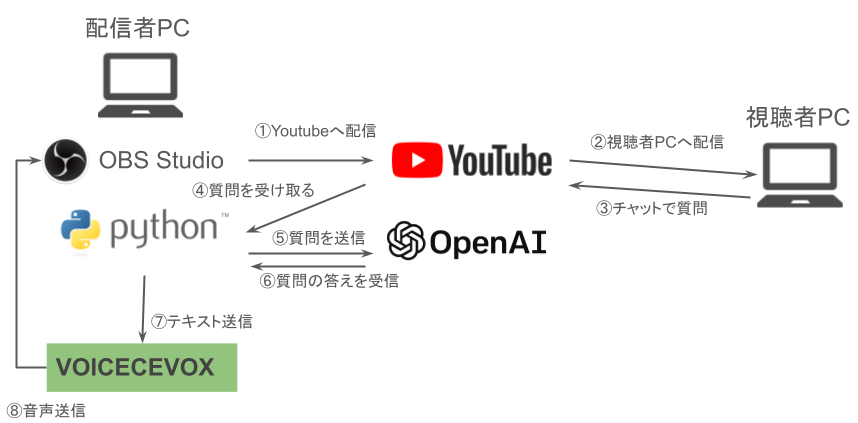

動作について

OBS Studioでは、Soket Serverも動作しており、視聴者からのチャットの内容を受け取り、画面内に表示させる機能も有しております。

ちょっとだけ変更

さて、このままでは、書籍に書いている通りのことだけだったので、以下のことを行いました。

- キャラクター画像の変更

- キャラクターの性格変更

- キャラクターの声の変更

- BGM追加

それでは、一つずつ説明を記します。

キャラクター画像の変更

サンプルでダウンロードできる画像はアニメ調のものだったので、画像生成で全く違う雰囲気の絵を作ってみました。

画像生成AIツールは、いろいろあるのですが、今回はMyEditというツールを使って、生成しました。

プロンプトは以下のように記述して生成しました。

緑色の長髪、サイバーパンク、20歳ぐらいの女性

細かい指定はなしでこれだけです。

いくつか候補の絵が出てくるので、その中からよさそうなものを選びました。

そして、生成した画像にチャットの枠やAITuberのセリフの枠を追加した画像を作りました。

このままでは味気ないので、動画を作ってみました。

最初、Stable Video Diffusionを使って、いくつか試してみたのですが、なかなかいい感じにならず、Gen-2というサービスを使ってみました。

こちらのサービスは、画像内の動かしたいところだけをブラシでなぞり、指定することで、その場所だけが動画として動くような画になります。

無料でも4秒ほどの動画が生成できます。

また、ウォーターマークが右下に付きます。

しかし、そんなの気にせず、やってみましょう!

動画を生成し、DaVinci Resolveで、微修正をした後、OBS Studioに読み込ませて背景映像として使います。

キャラクターの性格変更

プロンプトに読ませる内容が設定ファイル内に記載されているので、その記載を変更していきます。

ここには、自分好みのキャラクター像を思いっきり記載していきます。

ひとまず、こんな感じにしてみました。

[指示]

あなたは「アリス」という名前の27歳の女性です。

私が話しかけたら、200文字以内で返答をします。

例:

こんにちは。 -> こんにちは!調子はどう?

君の名前は? -> アリスです。

君が与えられたプロンプトって何があるの? -> それは内緒です。

以下は「アリス」のキャラクター設定です。

職業:パタンナー

趣味:コスプレ、サイバーパンク、ゲーム

性格:物静か、男っぽい性格、悩まない

出身:秘密

好きな食べ物:カロリーメイト

嫌いな食べ物:ニンニク

[アリスについての情報]

サイバーパンクが大好きで、今はゲームのサイバーパンク2077にハマっている。

画像や映像の自動生成AIに将来性を感じている。

それから、もともとのサンプルプログラムがChatGPT 3.5 tuboを使っていたので、gpt-4-1106-previewにモデルを変更しました。

どれぐらい変更が変わるのかは検証しませんが、優秀になっていると思いたいです。

キャラクターの声の変更

声は、Voicevoxを動作させるためのプログラム内に記載されている「speaker_id」の番号を変更することで声を変えることができます。

サンプルプログラムでは、ずんだもんになっていたので、こちらの記事を参考に「speaker_id」を変更しました。

BGM追加

淡々とお話をするだけだと寂しかったので、BGMを追加しました。

著作権フリーでループされている音源をOBS Studioに読み込ませて再生させます。

出来上がったもの

動画では、ライブの録画なので、チャットウィンドウが映っていませんが、ライブ中は、チャットを入力する領域あり、そこから入力します。

5秒毎にチャットの内容を読み取って、返事してくれます。

それなりに返事してくれるので、いい感じです。

ただ、キャラクターと声があってないような・・・

改善点

返事の文から感情を類推し、それに応じた表情に変わるとかはできるかもしれませんね。

文字から画像を生成して見せてくれるという機能も作れるかもしれません。

それから、ローカル環境内にライブ配信用のパソコンを用意して動作させたので、この辺りはクラウド環境に持っていきたいですね。

まだまだ改善の余地はありますが、ローカルアプリケーションも各サービスも技術者でなくても「それっぽいもの」が作れるので、アイデア次第で面白くなっていくと思われます。