Amazon Bedrock が、Anthropic Claude Sonnet 4 と OpenAI GPT-OSS モデルのバッチ推論をサポート

Amazon Bedrockで、Anthropic Claude Sonnet 4およびOpenAI GPT-OSS(120Bと20B)モデル向けのバッチ推論が利用可能になりました。複数の推論リクエストを非同期で処理できるようになり、大規模データセットでのパフォーマンスが向上し、通常のオンデマンド推論価格の半額で利用できます。

バッチ推論のメリット

・複数の推論リクエストを非同期で処理可能

・大規模データセットの処理性能が向上

・オンデマンド推論の50%の価格で利用可能

・高スループット最適化済み(従来モデルより高速)

主なユースケース

・ドキュメントや顧客フィードバックの分析

・マーケティングコピーや商品説明などの大量生成

・プロンプトや出力の大規模評価

・ナレッジベースやアーカイブの自動要約

・サポートチケットやメールの大量分類

TwelveLabs の Pegasus 1.2 モデルが 米国東部(バージニア北部)およびアジアパシフィック(ソウル)で利用可能に

TwelveLabs の Pegasus 1.2 モデルが米国東部(バージニア北部)およびアジアパシフィック(ソウル)の AWS リージョンで新たに利用可能になりました

Pegasus 1.2 の主な特長

-

長時間動画への対応

最大 1時間(2GBまで) の動画を処理可能

長時間動画でも高精度な理解と要約が可能 -

マルチモーダル解析

映像と音声を同時に解析し、文脈に沿ったテキスト生成を実現

質問応答、要約、キーフレーズ抽出、タイトル生成などに対応 -

高速な応答性能

GPT-4oやGemini 1.5 Proと比較しても、長尺動画での応答速度が優れている -

低コスト・高効率

商用利用に最適化された価格設計

一度処理した動画はキャッシュされ、再分析時に高速・低コスト化される -

Amazon Bedrockとの統合

Bedrock経由で利用可能(モデルID:twelvelabs.pegasus-1-2-v1:0) 2

入力形式は動画(base64またはS3 URI)、出力はテキスト

最大出力トークン数:4096、温度調整やJSON形式の構造化出力も可能

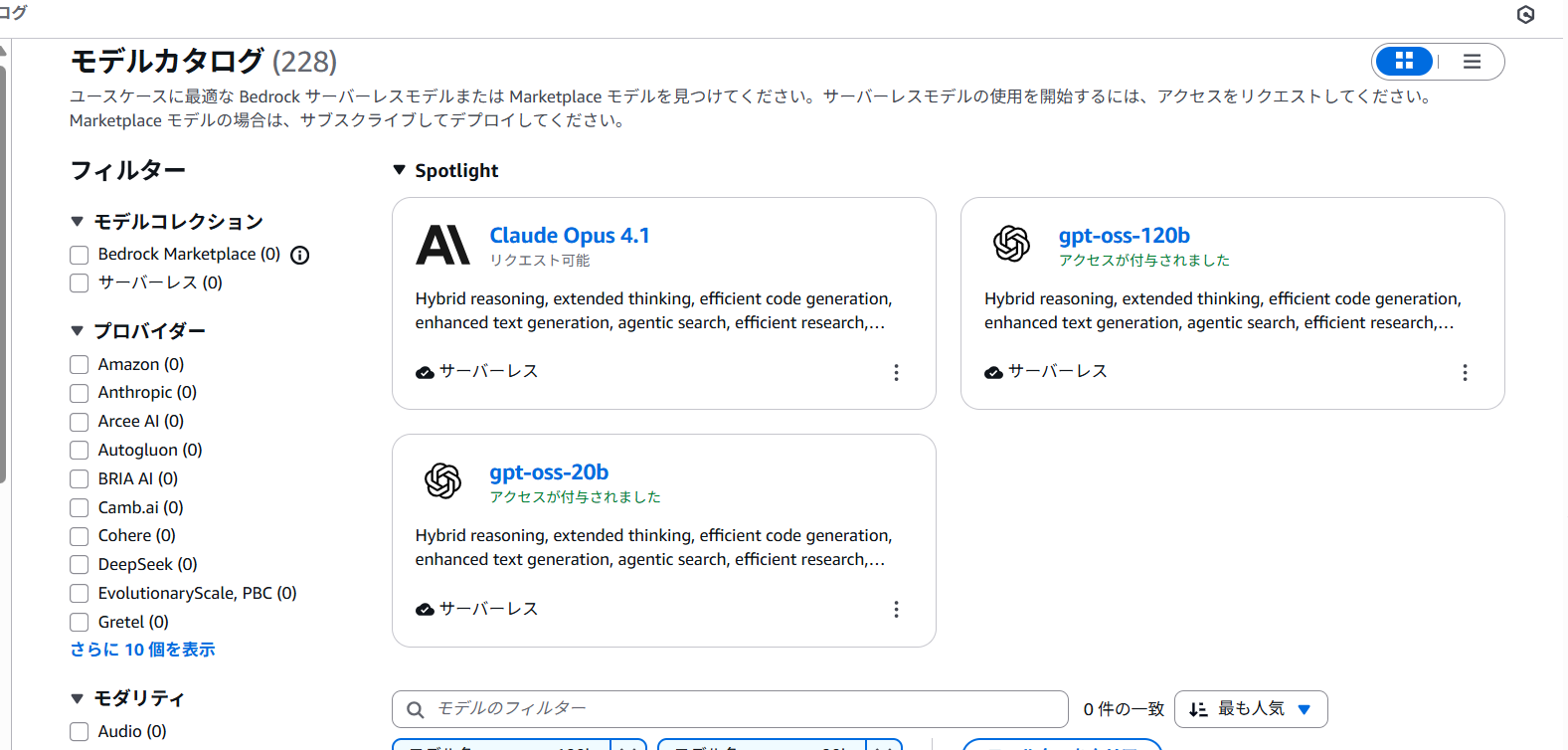

Amazon Bedrock で OpenAI のオープンウェイトモデルへのアクセスが簡素化

Amazon Bedrock で OpenAI のオープンウェイトモデル(gpt-oss-120b と gpt-oss-20b)へのアクセスが大幅に簡素化されました。これまで必要だったモデルアクセスの明示的な有効化作業が不要となり、すべての Bedrock ユーザーが自動的にこれらのモデルを利用できるようになりました。

ユーザーは Amazon Bedrock Console のプレイグラウンドや AWS SDK のAPI を通じて、モデルがすぐに利用可能。

Amazon CloudWatch の自然言語クエリ結果要約とクエリ生成機能が対応リージョンを拡大

Amazon CloudWatch Logs Insightsの自然言語クエリ結果要約機能が、東京リージョンを含むアジアパシフィック、ヨーロッパ、南米など15の新しいAWSリージョンで利用可能になりました。

Amazon CloudWatch Logs Insights の自然言語クエリ結果要約機能

ユーザーが英語などの自然言語でログデータに関する質問を入力すると、CloudWatch がその内容を理解し、適切なクエリを自動生成・実行し、結果をわかりやすく要約して表示する機能です

AWS Neuron SDK 2.25.0 が一般提供開始

AWS Neuron SDK 2.25.0が一般提供を開始し、AWS InferentiaとTrainium インスタンスにおける推論ワークロードとパフォーマンス監視機能が改善されました。

AWS Neuron SDK 2.25.0の機能

- チャンクアテンション(Chunk Attention)

長いシーケンスの処理に対応

メモリ効率を改善し、大規模言語モデル(LLM)推論の性能向上に貢献 - コンテキスト並列 & データ並列のサポート

モデルの並列処理がより柔軟に

分散推論・トレーニングの効率化 - パフォーマンス監視機能の強化

neuron-ls と neuron-monitor API がアップデート

ノードアフィニティやデバイス使用率など、詳細なリソース情報の取得が可能 - 自動エイリアシング(ベータ)

高速テンソル操作を実現する新機能

メモリ使用量の最適化と処理速度の向上 - 分散サービング機能の改善(ベータ)

複数ノードにまたがる推論処理の安定性とスケーラビリティが向上 - AMI & Deep Learning Containers のアップグレード

最新SDKに対応した環境がすぐに利用可能

Amazon Bedrock で Anthropic Claude モデル向けの Count Tokens API が利用可能に

Amazon Bedrock において、推論実行前にプロンプトや入力データのトークン数を事前に確認できる Count Tokens API が利用可能になりました。

アップデートのメリット

・コスト予測が可能:トークン数に基づいて推論コストを事前に見積もれる。

・使用量の管理:トークン制限を超えないようにプロンプトを最適化できる。

・スロットリング回避:予期せぬ制限に引っかからないように調整できる。

・コンテキスト長の制限に対応:モデルの最大トークン数を超えないように設計できる。

Amazon SageMaker Unified Studio でプロジェクトにS3ファイル共有オプションを追加

Amazon SageMaker Unified Studio で、プロジェクト内のファイル保存と共有方法が大幅に簡素化されました。従来の Git リポジトリ(GitHub、GitLab、Bitbucket Cloud)に加えて、Amazon S3 バケットを使用したファイル共有オプションが新たに追加され、S3 がデフォルトオプションとして設定されています。