自然言語処理(NLP)分野における2021年の私的注目トピックをまとめてみました。ざっくりですが、2022年動向予想も付けておきます。

※他にも重要なトピックがあるよ... などコメントがありましたら、是非、コメントをお願いします。

※以下の図表は対応する論文や記事からの引用です。

※以下のイベントに参加中。もし参考になりましたら、LGTM よろしくお願いします(^_^)

Zero-Shot/Few-Shot Learning

2021年に最も多くの話題を提供したのは、GPT-3で注目を集めたZero-Shot/Few-Shot Learningではないでしょうか。Zero-Shot/Few-Shot Learningでは、大量データで教師なし学習をした後、数件の教師ありデータの例示により推論を行います。同一のモデルで様々な推論を行えるという汎用性の高さが特長です。2021年は、Zero-Shot/Few-Shot Learningの改良や応用に関する論文が多数発表されました。特に、以下が注目されていたと思います。

-

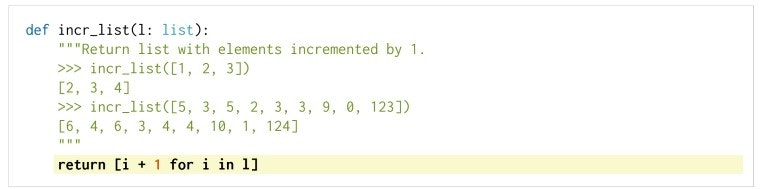

GitHub Copilot & Codex: Evaluating Large Language Models Trained on Code

Codexは仕様を記述した文書からプログラムを生成するモデルです。GitHub上のプロトタイプ機能GitHub Copilotとして既に利用可能です。最初に出力したプログラムが正しい確率は約29%、10回プログラムを出力してその中に正しいプログラムが含まれる確率は約47%と報告されています。言語モデルGPT-3を、下図のような仕様テキストとコードのペアでファインチューニングすることにより、学習を行っています。

-

GPT-J-6B [hugging face site]

GPT-3は注目を集めていますが、コードは公開されていません。APIを通じて利用はできますが有料です。そこで、オープンソースコミュニティによりGPT-J-6Bが開発されました。GPT-J-6Bは、GPT-3とほぼ同じアーキテクチャを持ち、GPT-3の同等規模モデルとほぼ同じ精度を出せます。コードも公開されており、無料で使えます。

マルチモーダルモデル

2021年はマルチモーダルモデル(テキスト、画像、動画、音声など複数種類のデータを統合して学習・推論を行うモデル)も多くの注目を集めました。2017年、attentionモジュールを組み合わせた学習モデルによりNLPの精度が大きく向上しました。2020年にはattentionが画像認識でも有効であることが実証されました。2021年は、attentionが動画やマルチモーダルでも有効であることが実証された年になりました。以下が注目を集めていました。

-

Zero-Shot Text-to-Image Generation from OpenAI(DALL-E)

テキストから画像を生成するモデルです。以下が生成例です。

-

VATT: Transformers for Multimodal Self-Supervised Learning from Raw Video, Audio and Text

動画、画像、音声、テキストを入力とする汎用性の高い推論モデルです。行動認識、音声イベント分類、テキストによる動画検索などで高い予測精度を実現しました。

会話モデル(チャットボット)

チャットボットなどに利用される会話モデルは、改良が続けられ、実用性が向上してきているようです。以下のGoogleのデモが注目を集めました。

-

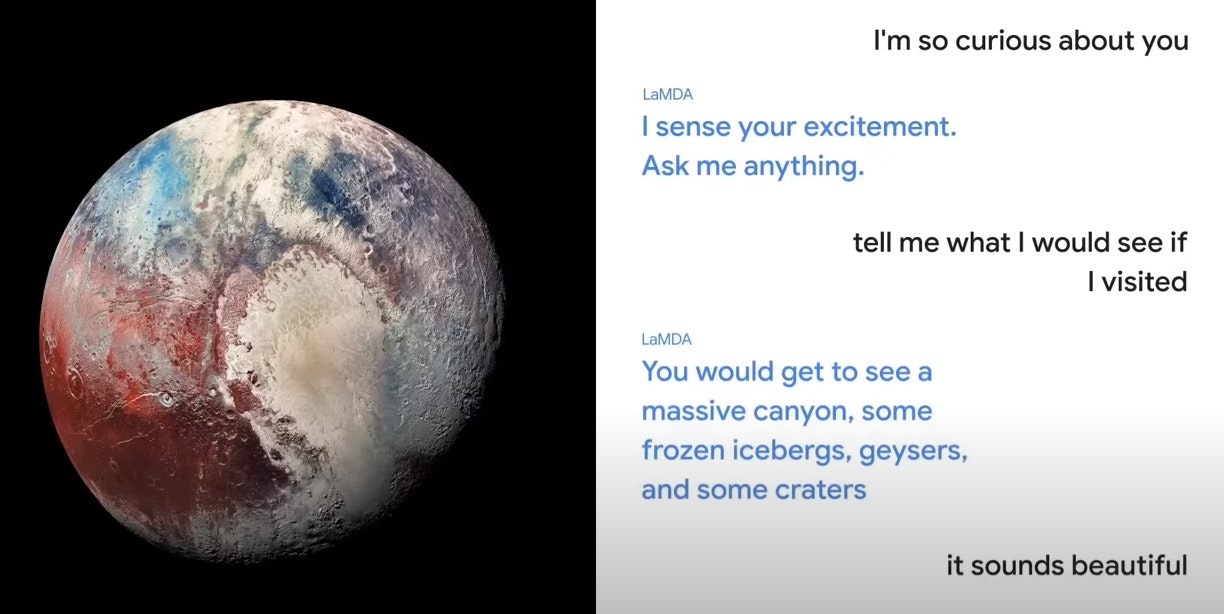

LaMDA(Language Model for Dialogue Applications)

LaMDAは、会話のトピックの連続性や、会話内容の具体性を高めるように最適化された言語モデルです。LaMDAが冥王星のふりをして、人間の質問に流暢に答える [デモ動画] はとても印象的です。

ベンチマーク

Browse State-of-the-Artによると、2021年は、特定のべンチマークの記録を多少更新するようなモデルは散見されましたが、多数のベンチマークの記録をまとめて大幅に更新する大スターのような言語モデルは登場しなかったと言えるでしょう。巨大化した言語モデルの改善点を評価したり、問題点を発見するには、今あるベンチマークは単純で簡単すぎるのかもしれません。少なくとも、新しいベンチマークが必要と考える研究者は多かったようです。

-

FLEX: Unifying Evaluation for Few-Shot NLP

Few-shot NLPをターゲットにした新しいベンチマークを提案しています。 -

The GEM Benchmark: Natural Language Generation, its Evaluation and Metrics

言語生成モデル(NLG)をターゲットにした新しいベンチマーク、および、データの収集・管理体制の構築を提案しています。

AI倫理への関心の広がり

2021年は、AI倫理への関心が社会に広がった年でもあったと思います。以下のようなニュースが関心を集めました。

-

The Chatbot Problem

チャットボットが殺人や自殺を勧めたり差別的発言をしていること、自律的殺人兵器が実用化され実戦投入されていることをとりあげています。 -

グーグルのAI倫理研究者は、なぜ解雇されたのか?

巨大化したNLPモデルに対しコストと環境負荷の観点から問題提起をした論文 On the Dangers of Stochastic Parrots: Can Language Models Be Too Big?の著者二人を、グーグルが解雇しました。グーグルは、論文発表を理由とする解雇ではないとしていますが、AI倫理問題に神経質になっている経営陣が過剰反応したのではないかという見方もでており、数名の著名な研究者がグーグルからの資金援助を拒否するなど、批判が広がりました。

(まとめに代えて)2022年の動向予想

チャットボットの高度化が徐々に進み、マルチモーダルモデルの応用の試行がそろそろ増え始めるのではないでしょうか。AI倫理の問題は、これからもつきあい続けることになるのだろうと思います。

リファレンス

2021年のNLP注目トピックをもっと探してみたいという方には、以下の記事をお薦めします。

- TOP NATURAL LANGUAGE PROCESSING (NLP) TRENDS AND PREDICTIONS FOR 2022

- A 2021 NLP Retrospective

- 2021: A Year Full of Amazing AI papers - A Review

- State of AI Report 2021

- Stanford University 2021 AI INDEX REPORT

- NeurIPS 2021—10 papers you shouldn’t miss

- AAAI 2021: Top Research Papers With Business Applications

以下は、本記事で紹介した論文や記事のリストです。

- GitHub Copilot & Codex: Evaluating Large Language Models Trained on Code

- GPT-J-6B

- GPT-J-6B hugging face site

- Zero-Shot Text-to-Image Generation from OpenAI(DALL-E)

- VATT: Transformers for Multimodal Self-Supervised Learning from Raw Video, Audio and Text

- LaMDA(Language Model for Dialogue Applications)

- LaMDA デモ動画

- Browse State-of-the-Art NLP

- FLEX: Unifying Evaluation for Few-Shot NLP

- The GEM Benchmark: Natural Language Generation, its Evaluation and Metrics

- The Chatbot Problem

- グーグルのAI倫理研究者は、なぜ解雇されたのか?

- On the Dangers of Stochastic Parrots: Can Language Models Be Too Big?