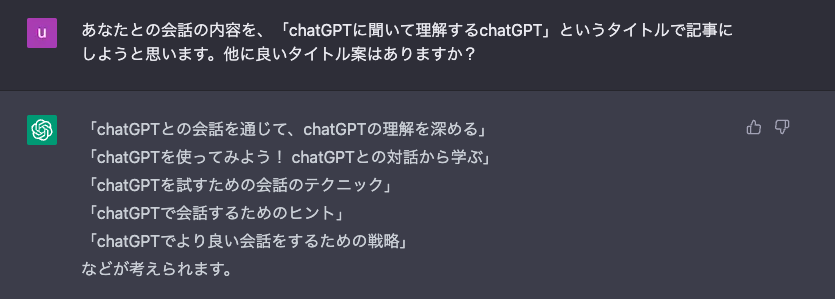

これは何?

最近話題のchatGPTについて、「chatGPTに対して、chatGPTのことを質問する」という形式で理解を深めてみようという試みです。

https://openai.com/blog/chatgpt/

大前提として、chatGPTは質問に対して正しい情報を返すことを保証するものではないので、記載されている内容に一部誤りが含まれる可能性はあります。

この記事の記法について

ここから先、chatGPTとの対話内容を載せていきますが、質問、回答は以下のルールに沿って書いていきます。

質問は、H5で記載

回答は引用で記載

普通の字体の部分は、僕の感想とか補足とかです。

前置きはこのくらいにして、早速chatGPTについて、chatGPTに聞いてみましょう。

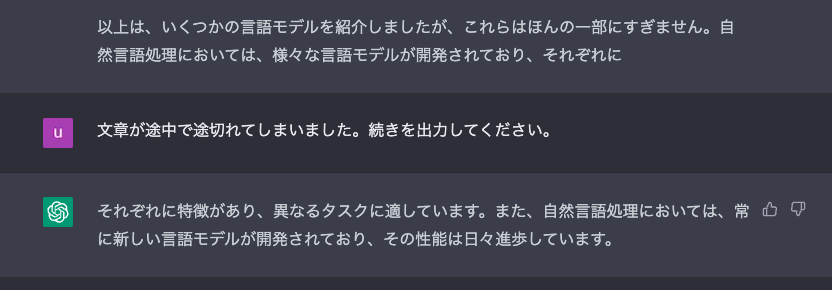

また、chatGPTとの対話において、回答が途中で途切れてしまうことがあります。その際は以下のように続きを促しています。

この場合は、追加の回答部分まで含めて1つの回答として記載しています。

とりあえず、chatGPTとは何かを聞いてみる

chatGPTとはなにか教えてください。

chatGPTは、自然言語生成モデルです。chatGPTは、GPT-3(Generative Pre-training Transformer 3)という大規模な言語モデルを基にしています。GPT-3は、自然言語を理解し、新しい文章を生成することができるモデルです。 chatGPTは、GPT-3を使用して、会話や対話システムを構築することができるようになっています。

chatGPTは、自然言語を入力として受け取り、それに基づいて人間のように返信を生成することができます。これにより、人間との会話のような対話を可能にするアプリケーションやサービスを構築することができます。

例えば、chatGPTを使用して、人間のように自然に会話するバーチャルアシスタントを作成することができます。また、chatGPTを使用して、自然言語を入力として受け取り、それをもとに新しい文章を生成することで、文章の自動生成システムを構築することもできます。

この返答から、より理解を深めるためには

- モデルについて

- 実用例について

の質問をいくつかしてみるのが良さそうです。

モデルについて聞いてみる

GPT-3(Generative Pre-training Transformer 3)とはどんなモデルか教えてください。

GPT-3(Generative Pre-training Transformer 3)は、大規模な自然言語生成モデルです。GPT-3は、自然言語を理解し、新しい文章を生成することができるモデルです。GPT-3は、Transformerという深層学習モデルを基にしています。Transformerは、自然言語処理タスク向けに設計されたニューラルネットワークであり、大規模なテキストコーパスを使用して学習されます。

GPT-3は、自然言語を入力として受け取り、それをもとに新しい文章を生成することができます。GPT-3は、自然言語を理解する能力を持っているため、自然でリズムのある文章を生成することができます。また、GPT-3は、自然言語を入力として受け取り、それをもとに様々なタスクを実行することもできます。例えば、文章の意味を理解し、それに基づいて質問に答えることや、文章をサマリーすること、文章を翻訳することなどができます。

GPT-3は、様々なアプリケーションやサービスに使用されています。例えば、文章生成システムや自然言語対話システム、自然言語翻訳システムなどがあります。また、GPT-3を使用したアプリケーションやサービスは、非常に多岐にわたり、日常生活においても様々な形で活用されています。

ちょっと気になったので、GPT-3の基となっているTransformerについて聞いてみましょう。

Transformerという深層学習モデルの特徴を端的に教えてください。

Transformerは、深層学習モデルの一種であり、自然言語処理タスクや音声認識タスクなどに用いられています。Transformerは、以下の特徴を持っています。

並列処理が可能: Transformerは、入力を並列処理することができるため、処理スピードが高く、より大規模なデータを処理することができます。

位置情報を考慮する: Transformerは、単語の順番や位置情報を考慮することができるため、文章の意味をより正確に理解することができます。

レイヤーを持たない: Transformerは、通常の深層学習モデルと異なり、レイヤーを持たないため、処理がスムーズで、学習が高速です。

多層パーセプトロンを持たない: Transformerは、多層パーセプトロンを持たないため、計算が軽量で、処理スピードが高く、学習が高速です。また、多層パーセプトロンを持たないことで、過学習を起こす可能性が低くなります。

Transformerは、上記の特徴を持ちながらも、自然言語処理タスクや音声認識タスクなどで、人間並みの精度を発揮することができるため、近年、注目を集めています。

なるほど。僕は機械学習や深層学習についてはあまり詳しくないですが、理解を深めたい時はとりあえず「レイヤー」「パーセプトロン」あたりのキーワードをうまく拾って調べていくといいんでしょうか。

ベースの深層学習モデルについてはこれくらいにしておいて、GPT-3と並ぶ他のモデルとしてどんなものがあるか聞いてみます。

GPT-3以外に、どんな言語モデルがあるのか教えてください。

自然言語処理において、様々な言語モデルが開発されています。以下に、いくつかの言語モデルを紹介します。

BERT(Bidirectional Encoder Representations from Transformers): BERTは、自然言語を理解する能力を持った言語モデルです。BERTは、Transformerを基にしています。BERTは、大規模なテキストコーパスを使用して学習され、自然言語を理解し、文章の意味を抽出することができます。

XLNet(eXtra Large Neural Net): XLNetは、自然言語を理解する能力を持った言語モデルです。XLNetは、Transformerを基にしています。>XLNetは、大規模なテキストコーパスを使用して学習され、自然言語を理解し、文章の意味を抽出することができます。XLNetは、BERTよりもさらに大規模なモデルであるため、より自然でリズムのある文章を生成することができます。

RoBERTa(Robustly Optimized BERT): RoBERTaは、BERTを改良した言語モデルです。RoBERTaは、BERTよりもさらに大規模なモデルであり、自然言語を理解する能力がさらに向上しています。

ELMo(Embeddings from Language Models): ELMoは、自然言語を理解する能力を持った言語モデルです。ELMoは、文章内での単語の意味を抽出することができます。

以上は、いくつかの言語モデルを紹介しましたが、これらはほんの一部にすぎません。自然言語処理においては、様々な言語モデルが開発されており、それぞれに特徴があり、異なるタスクに適しています。また、自然言語処理においては、常に新しい言語モデルが開発されており、その性能は日々進歩しています。

BERTなど、いくつか聞いたことのあるものが出てきました。GPT-3同様、Transformerをベースにしたモデルが他にもいくつかあるようですね。

その上で、GPT-3の特徴や、苦手分野を聞いてみましょう。

GPT-3が他の言語モデルと特に異なる点を教えてください。

GPT-3は、自然言語処理において、非常に大規模な言語モデルです。GPT-3は、17億のトランスポート層を持つモデルであり、他の言語モデルに比べて、より大規模なテキストコーパスを使用して学習されています。

GPT-3は、自然言語を理解し、新しい文章を生成することができるモデルであり、自然でリズムのある文章を生成することができます。また、GPT-3は、自然言語を入力として受け取り、それをもとに様々なタスクを実行することもできます。例えば、文章の意味を理解し、それに基づいて質問に答えることや、文章をサマリーすること、文章を翻訳することなどができます。

GPT-3は、他の言語モデルと比べて、自然言語を理解する能力が高く、また、大規模なテキストコーパスを使用して学習されているため、より自然でリズムのある文章を生成することができます。また、GPT-3は、様々なアプリケーションやサービスに使用されており、非常に多岐にわたり、日常生活においても様々な形で活用されています。

GPT-3が苦手とするタスクを端的に教えてください

GPT-3は、自然言語を理解し、新しい文章を生成することができる大規模な言語モデルです。GPT-3は、自然言語を入力として受け取り、それをもとに様々なタスクを実行することができます。

ただし、GPT-3は、自然言語を理解する能力が高いものの、すべてのタスクにおいて最適であるわけではありません。GPT-3は、特に次のようなタスクでは、苦手とされることがあります。

数学的な計算や論理的推論: GPT-3は、自然言語を理解する能力があるものの、数学的な計算や論理的推論のタスクでは、人間並みの精度を発揮しないことがあります。

具体的な指示や手順を追うタスク: GPT-3は、自然言語を理解する能力があるものの、具体的な指示や手順を追うタスクでは、人間並みの精度を発揮しないことがあります。GPT-3は、文章の意味を理解することができるものの、具体的な指示や手順を実行することには、限界があるためです。

語彙や文法の誤りを検出するタスク: GPT-3は、自然言語を理解する能力があるものの、語彙や文法の誤りを検出するタスクでは、人間並みの精度を発揮しないことがあります。GPT-3は、自然言語を理解することができるものの、語彙や文法に関する知識が限定的であるためです。

以上は、GPT-3が苦手とされるタスクを紹介しましたが、これらはあくまで一般的な傾向であり、すべてのタスクにおいてGPT-3が苦手であるというわけではありません。また、GPT-3は、日々進歩しており、今後もより良い精度を発揮するようになるでしょう。

また、GPT-3は、大規模なテキストコーパスを使用して学習されているため、自然言語を理解する能力が高く、新しい文章を生成することができるモデルです。そのため、文章生成や自然言語対話システムなどを構築する場合には、特に有効です。

最後に強みを押し出してくるのちょっとウケるな

モデルについてはこれくらいにしておいて、ここからはchatGPTの具体的な実用例について聞いてみます。

chatGPTの実用例について聞いてみる

chatGPTの実用例をいくつか教えてください

ChatGPTは、自然言語生成タスクに使用される大規模なトランスフォーマー モデルです。自然言語処理タスクを自動化するために、自然言語を入力として受け取り、自然言語を出力として生成することができます。

ChatGPTを使用するいくつかの例を以下に示します。

チャットボット: ChatGPTを使用すると、自然言語を入力として受け取り、自然言語を出力として生成することができるため、自然な会話をするチャットボットを作成することができます。

メッセージの生成: ChatGPTを使用すると、特定のテンプレートを使用してメッセージを生成することができます。たとえば、自動化された電子メールを生成したり、自然な言語での挨拶や感謝の手紙を生成することができます。

テキストサマリーの生成: ChatGPTを使用すると、長い文章や記事から要約を生成することができます。これにより、大量のテキストをより簡潔に概要を把握することができます。

テキスト生成ゲーム: ChatGPTを使用すると、自然言語を使用したテキスト生成ゲームを作成することができます。たとえば、プレイヤーが入力したフレーズを使用して、新しいフレーズを生成するゲームを作成することができます。

chatGPTを利用したチャットボットを構築したいです。pythonで簡単なサンプルコードを提示してください。

Pythonを使用して、ChatGPTを使用した簡単なチャットボットを構築する方法を示します。

まず、必要なPythonモジュールをインポートします。

import openai import re次に、OpenAI APIキーを使用して、ChatGPTをインスタンス化します。

openai.api_key = "YOUR_API_KEY" model_engine = "text-davinci-002"次に、チャットボットとの会話を処理するための関数を定義します。この関数は、入力されたテキストを受け取り、ChatGPTを使用して応答を生成します。

def generate_response(input_text): prompt = (f"User: {input_text}\n" "Bot:") completions = openai.Completion.create(engine=model_engine, prompt=prompt, max_tokens=1024, n=1,stop=None,temperature=0.5) message = completions.choices[0].text message = re.sub('User: ', '', message) return message最後に、チャットボットと会話するためのメインループを定義します。このループでは、ユーザーからの入力を受け取り、それを使用して応答を生成します。

while True: user_input = input("You: ") if user_input == "exit": break response = generate_response(user_input) print(f"Bot: {response}")これで、Pythonを使用してChatGPTを使用した簡単なチャットボットが構築できました。このコードは、お使いの環境で実行できるように、必要なモジュールをインストールして、OpenAI APIキーを正しく設定する必要があります。

すげえ。実際に教えてもらったコードを簡単に動かしてみました

You: こんにちは!

Bot: こんにちは!

You: chatGPTについて簡単に教えてください

Bot:

chatGPTは、GPT-2モデルを使用したチャットボットです。GPT-2モデルは、大規模なテキストコーパスを学習して生成したもので、自然言語処理タスクに非常に優れています。このモデルを使用することで、chatGPTは、自然な会話をすることができるようになりました。

どうやら、GPT-2モデル版のサンプルコードを教えてくれたらしいです。

GPT-3を使いたい場合は、 model_engine=text-davinci-003 として使ってみましょう。

chatGPTの利用のコツを聞いてみる

最後に、chatGPTをうまく利用するためのポイントとか、注意点とかを聞いて終わろうかなと思います。

chatGPTに質問をする際に、より適切な回答を得るためのポイントを端的に教えてください。

ChatGPTは、自然言語生成タスクに使用される大規模なトランスフォーマー モデルです。質問をする際に、より適切な回答を得るためには、次のポイントを押さえることが重要です。

明確で具体的な質問をする: ChatGPTは、明確で具体的な質問に対してより適切な回答を生成することができます。抽象的な質問や、複数の解釈ができる質問に対しては、より正確な回答を得ることが困難です。

必要な情報をすべて含める: ChatGPTは、入力として与えられた情報をもとに回答を生成します。質問をする際には、必要な情報をすべて含めることで、より適切な回答を得ることができます。

質問を分割する: 複雑な質問や、複数の質問を一度にすることは、より適切な回答を得ることが困難です。複雑な質問は、複数の分割された質問に分けることで、より正確な回答を得ることができます。

情報が含まれる範囲を明確にする: ChatGPTは、入力として与えられた情報をもとに回答を生成します。質問をする際には、回答を求める情報が含まれる範囲を明確にすることで、より適切な回答を得ることができます。

こう見ると日本語と相性悪そうですけどね。でもこれだけ自然に日本語の会話が成立するのはすごいなあ。

というか日本語でプロンプトエンジニアリングするの大変そう。

chatGPTから得た回答を解釈する際に、気をつけるポイントを端的に教えてください。

ChatGPTは、自然言語生成タスクに使用される大規模なトランスフォーマー モデルです。ChatGPTから得た回答を解釈する際には、次のポイントを気をつけることが重要です。

回答が正確であることを確認する: ChatGPTは、入力として与えられた情報をもとに回答を生成するため、正確であるとは限りません。回答を解釈する前に、その内容が正確であることを確認することが重要です。

回答が抽象的である場合は、具体的に解釈する: ChatGPTは、抽象的な質問に対しても回答を生成することができます。このような回答を解釈する際には、具体的な意味を求めるようにすることが重要です。

回答が複数の解釈ができる場合は、質問を再確認する: ChatGPTは、複数の解釈ができる質問に対しても回答を生成することができます。このような回答を解釈する際には、質問を再確認し、正確な意味を確認することが重要です。

回答が省略されている場合は、補足する: ChatGPTは、入力として与えられた情報をもとに回答を生成するため、必要な情報が省略されることがあります。このような場合には、回答を補足することで、正確な意味を理解することができます。

まあやっぱり何よりも一番最初の「回答が正確であることを確認する」が大事ですね。なんでもそうですが。

気づき

色々質問しながら感じたこととしては、とりあえずよくわからないものを調べる際に、

情報の正確性はともかくとして、関連語がたくさん出てくるので調べ物のきっかけとして使うのは良さそうです。

あと、結構それらしいサンプルコードも提示してくれるので、とりあえず叩きを作るのには良さそう。

学習の性質上、質問と関連してよく出てくるものを提示してくる感じだと思うので、正確性はともかくとして、足がかりにする使い方が一旦現実的なラインかな?と思いました。