LSD-SLAM: Large-Scale Direct Monocular SLAM(2014)

ソースコード:tum-vision/lsd_slam

Abstract

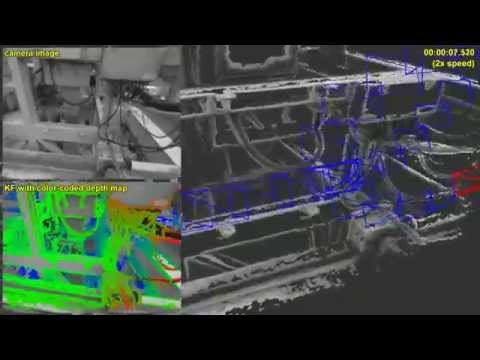

わたしたちは,現在最先端の手法とは対照的な,大規模で一貫した環境のマップを構築することを可能にするダイレクト(特徴点レス)単眼SLAMアルゴリズムを提示する.ダイレクトなイメージアライメントに基づいて高い精度で姿勢推定し,準高密度な深度マップに紐づけられたキーフレームのポーズグラフとして3D環境をリアルタイムに復元する.これらは,多数の画素間のベースラインステレオ法による比較をフィルタリングすることで得られる.明示的にスケールドリフトを認識する方式は,シーンの縮尺が大きく変動する難易度の高いシーケンスでも動作することを可能にする.3D相対相似変換で動作するこれまでにないダイレクトトラッキング方式とノイズのある深度値の影響をトラッキングの際に考慮する洗練された確率論的解法が,目的を達成するために主要な要因となる新方法である.その結果ダイレクト単眼SLAMシステムはCPUを用いてリアルタイムで動作する.

We propose a direct (feature-less) monocular SLAM algorithm which, in contrast to current state-of-the-art regarding direct methods, allows to build large-scale, consistent maps of the environment. Along with highly accurate pose estimation based on direct image alignment, the 3D environment is reconstructed in real-time as pose-graph of keyframes with associated semi-dense depth maps. These are obtained by filtering over a large number of pixelwise small-baseline stereo comparisons. The explicitly scale-drift aware formulation allows the approach to operate on challenging sequences including large variations in scene scale. Major enablers are two key novelties: a novel direct tracking method which operates on sim, thereby explicitly detecting scale-drift, and an elegant probabilistic solution to include the effect of noisy depth values into tracking. The resulting direct monocular SLAM system runs in real-time on a CPU.

ORB-SLAM: a Versatile and AccurateMonocular SLAM System(2015)

ソースコード:raulmur/ORB_SLAM

Abstract

本論文では,小規模および大規模,室内および室外環境でリアルタイムに動作する特徴点ベースの単眼システム,ORB-SLAMを提示する.このシステムは激しい乱雑な動きに対してロバストで,ワイドベースラインのループクロージングと再局所化を可能にし,そして完全に自動的に初期化を行う.近年の優れたアルゴリズムをもとに,わたしたちは,SLAMの全ての工程(トラッキング,マッピング,再局所化そしてループクロージング)で同じ特徴点を用いるこれまでにないシステムを新たに設計した.復元の点およびキーフレームを選別する適者生存戦略(A survival of the fittest strategy)は優れたロバスト性に繋がり,シーンの内容が変化した時にのみ成長する簡潔で追跡可能なマップを生成し,長時間のオペレーションを可能にする.わたしたちはもっとも一般的なデータセットから選んだ27個のシーケンスによる網羅的な評価を提示する.ORBSLAMは,他の最先端の単眼SLAMアプローチでは前例のない性能を獲得する.コミュニティの利益のために,わたしたちはソースコードを公開する.

This paper presents ORB-SLAM, a feature-based monocular SLAM system that operates in real time, in small and large, indoor and outdoor environments. The system is robust to severe motion clutter, allows wide baseline loop closing and relocalization, and includes full automatic initialization. Building on excellent algorithms of recent years, we designed from scratch a novel system that uses the same features for all SLAM tasks: tracking, mapping, relocalization, and loop closing. A survival of the fittest strategy that selects the points and keyframes of the reconstruction leads to excellent robustness and generates a compact and trackable map that only grows if the scene content changes, allowing lifelong operation. We present an exhaustive evaluation in 27 sequences from the most popular datasets. ORBSLAM achieves unprecedented performance with respect to other state-of-the art monocular SLAM approaches. For the benefit of the community, we make the source code public.

CNN-SLAM: Real-time dense monocular SLAM with learned depth prediction(2017)

ソースコード:-

Abstract

畳み込みニューラルネットワーク(CNN)による深度推定の最近の進歩を考慮して,本論文では,正確で密な単眼復元のために,ディープニューラルネットワークから予測された深度マップをどのように展開するか調査する.わたしたちは,ダイレクト単眼SLAMから得られた深度測定値と,CNNが予測した高密度深度マップを自然に融合させる方法を提示する.わたしたちの融合スキームは,単眼SLAMが失敗する傾向にある場所の深度推定(例えば,テクスチャの低い領域に沿って,逆もまた然り)で優位である.わたしたちは,復元の絶対尺度を推定するための深度推定の使用を実証し,したがって,単眼SLAMの主な限界の一つを克服する.最後にわたしたちは,ひとつのフレームから得られたセマンティックラベルと高密度のSLAMを効率的に融合し,ひとつのビューからセマンティック的に一貫したシーンを復元するフレームワークを提示する.ふたつのベンチマークのデータセットによる評価結果は,わたしたちのアプローチのロバスト性と精度を示す.

Given the recent advances in depth prediction from Convolutional Neural Networks (CNNs), this paper investigates how predicted depth maps from a deep neural network can be deployed for accurate and dense monocular reconstruction. We propose a method where CNN-predicted dense depth maps are naturally fused together with depth measurements obtained from direct monocular SLAM. Our fusion scheme privileges depth prediction in image locations where monocular SLAM approaches tend to fail, e.g. along low-textured regions, and vice-versa. We demonstrate the use of depth prediction for estimating the absolute scale of the reconstruction, hence overcoming one of the major limitations of monocular SLAM. Finally, we propose a framework to efficiently fuse semantic labels, obtained from a single frame, with dense SLAM, yielding semantically coherent scene reconstruction from a single view. Evaluation results on two benchmark datasets show the robustness and accuracy of our approach.