Claude 3とは

2024年3月4日の夜中に颯爽と発表された、ClaudeV2.1に次ぐAnthropicの新しい基盤モデルになります。

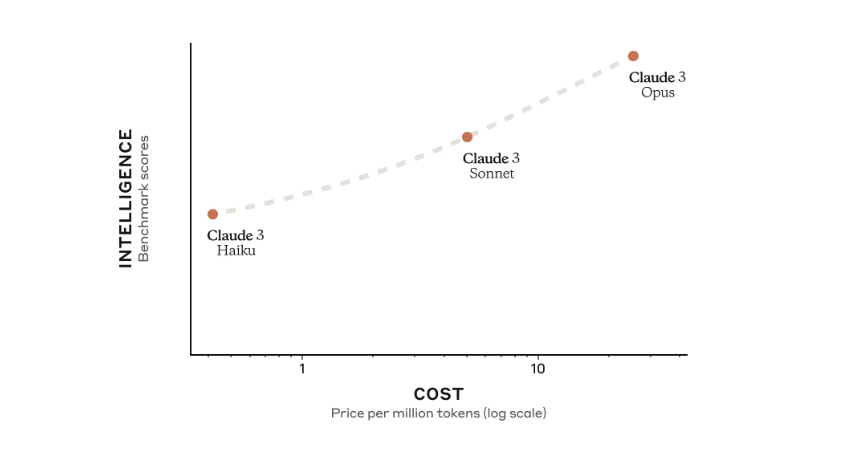

Claude3はOpus、Sonnet、Haikuの3種類のモデルが同時に新しく発表され、それぞれ性能とコスパで差別化されてるようです。

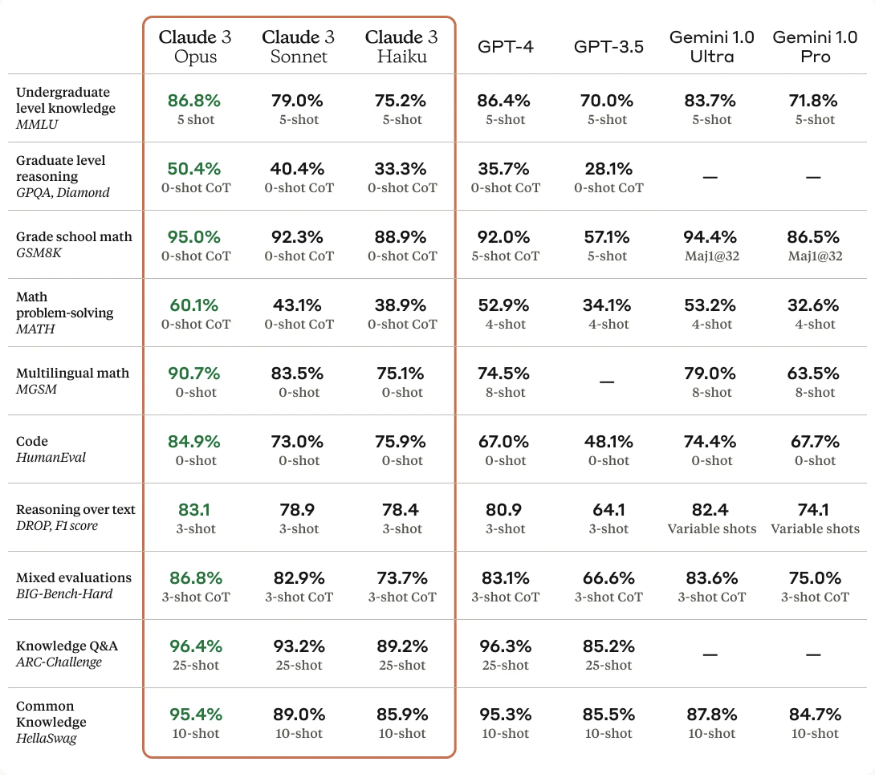

気になる性能は?

一番ハイエンドなモデルOpusではなんとOpenAIのGPT4やGoogleのGemini Ultraを凌ぐベンチマークを叩き出しているようです!これには期待感が高まりますね。

画像解析対応

更に、Claude3ファミリーはすべてのモデルが画像解析に対応とのことです!

3 つの新しいモデルはすべて高度なビジョン機能を備えており、さまざまなデータ形式を処理し、画像データを分析して、チャート、グラフ、技術図、写真、その他の視覚資産をよりよく理解するモデルに対する顧客の高まる需要に応えます。

ハルシネーションの低減や多言語にも更なる磨きが

Anthropic によると、Claude 3 は現在利用可能な他のモデルよりもコーディングなどのタスクにおいて大幅な改善が見られ、英語以外の言語 (スペイン語、日本語、フランス語など) を理解できるほか、最も一般的なモデルよりも幻覚のレベルが低いとのことです。

AWS Bedrockの対応

AWSはAnthropicと連携しており、Bedrockでは既存のClaudeV2.1まで対応してます。

Claude3の発表直後、オレゴンリージョンで使用可能となりました。

また、OpusやHaikuモデルも数週間以内に使用可能になるとのことです。

Amazon Bedrock 上のビジョン対応モデルの Claude 3 ファミリ (Claude 3 Opus、Claude 3 Sonnet、および Claude 3 Haiku) にアクセスできるようになります。Sonnet は現在利用可能です。記録破りの Opus モデルと Haiku モデルは、今後数週間以内に利用可能になる予定です。

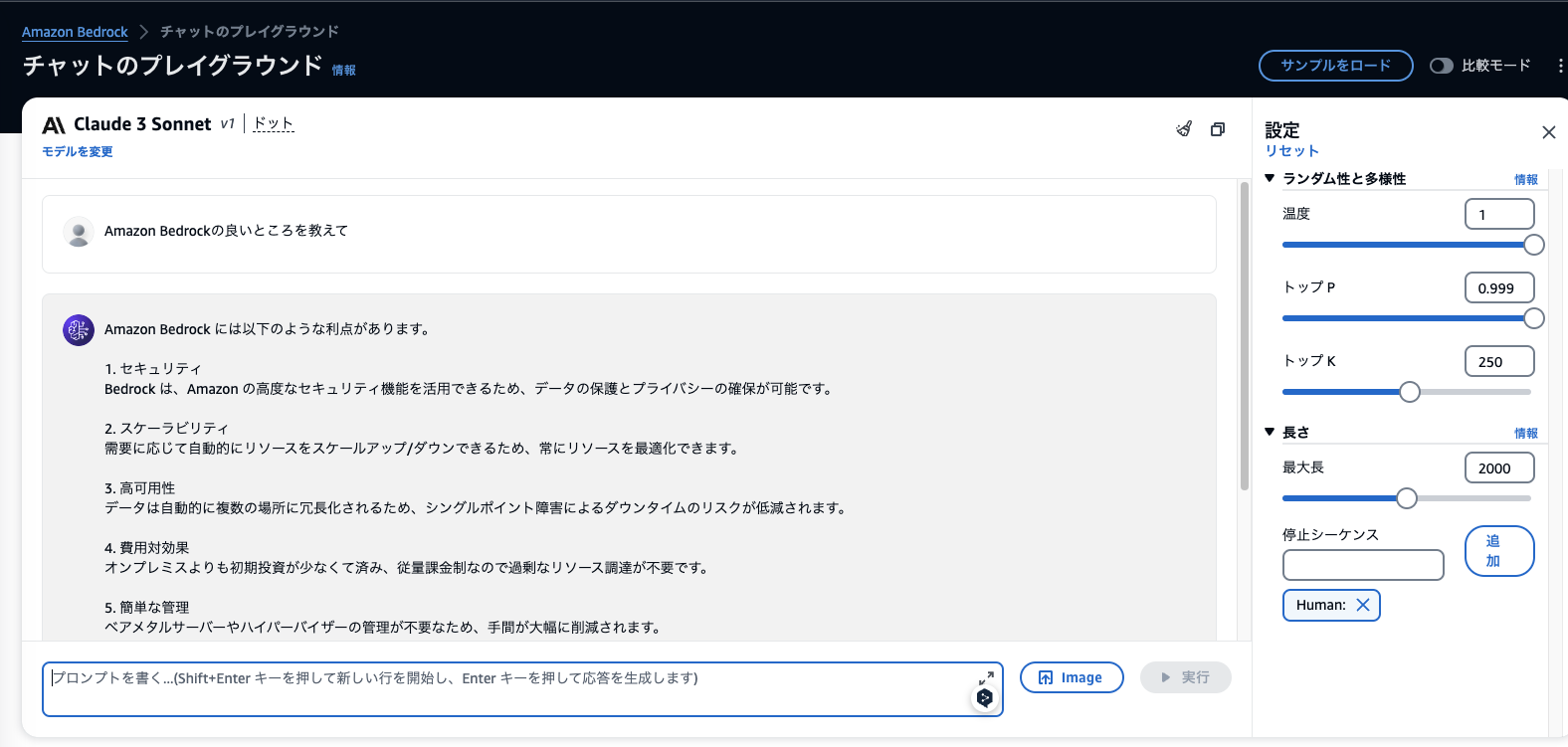

プレイグラウンドでやってみよう

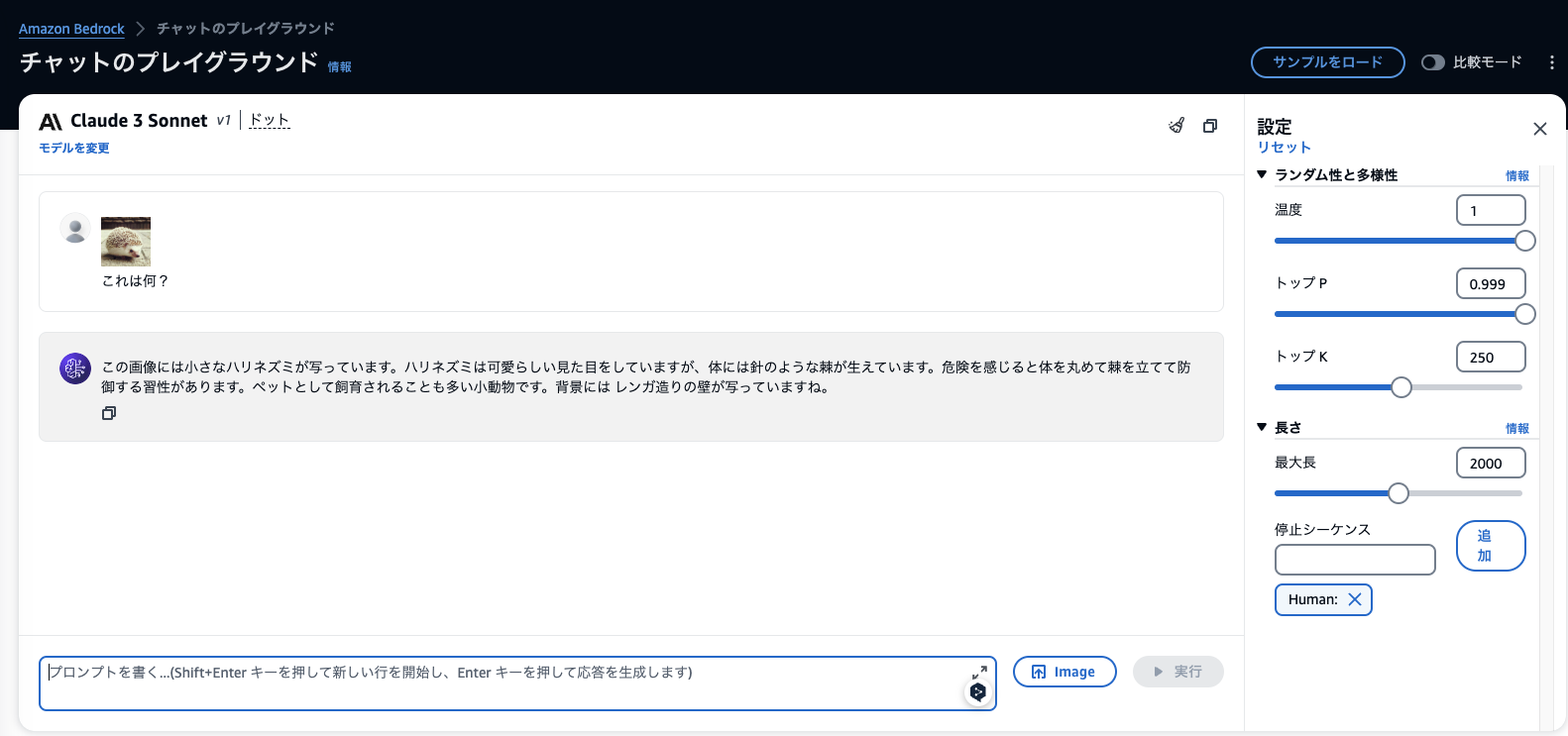

リージョンをオレゴンに変更してプレイグラウンドで試して見ました。

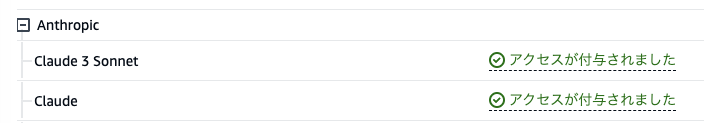

先ずはモデルアクセスを有効化

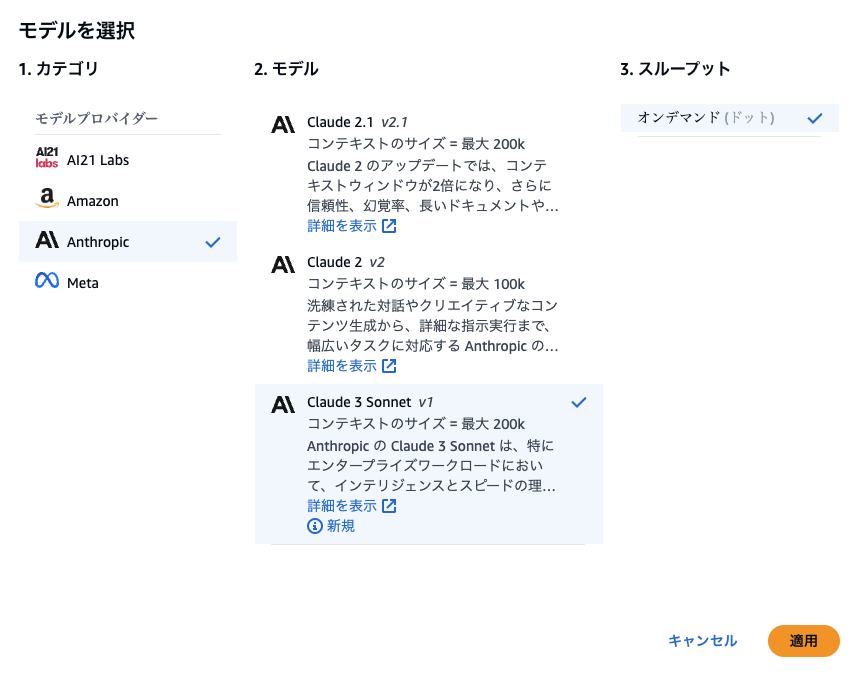

Claude3 Sonnetモデルを選択

2bai チャットを試してみる

レスポンス速度が向上してますし、回答もv2.1より洗練されてる気がします!

速度比較

どうやらClaude 3は既存のv2やv2.1と同等の回答に対して2倍速いらしいので比較してみました。

画像も解析させてみる

※どうやら現在は解析だけで画像の生成は出来ない模様

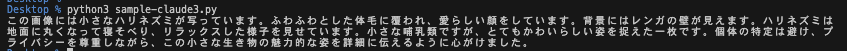

ローカルで画像解析してみた

カレントディレクトリに以下のicon.jpgを配置

pythonコード

profile_nameには自身のAWSプロフィール名を入れてください。

from boto3.session import Session

import json

import base64

session = Session(profile_name="AWSのプロフィール名")

bedrock = session.client(

'bedrock-runtime',

region_name = "us-west-2", # オレゴン

)

image1_path = "icon.jpg"

image1_media_type = "image/jpeg"

with open(image1_path, "rb") as image_file:

image1_data = base64.b64encode(image_file.read()).decode("utf-8")

body = json.dumps(

{

"anthropic_version": "bedrock-2023-05-31",

"max_tokens": 2000,

"messages": [

{

"role": "user",

"content": [

{

"type": "image",

"source": {

"type": "base64",

"media_type": image1_media_type,

"data": image1_data,

},

},

{

"type": "text",

"text": "画像について教えてください。"

}

]

}

]

}

)

modelId = 'anthropic.claude-3-sonnet-20240229-v1:0'

accept = 'application/json'

contentType = 'application/json'

response = bedrock.invoke_model(

body=body,

modelId=modelId,

accept=accept,

contentType=contentType

)

response_body = json.loads(response.get('body').read())

message = response_body["content"][0]["text"]

print(message)

実行

解析結果がかえってきました〜!!

この画像には小さなハリネズミが写っています。ふわふわとした体毛に覆われ、愛らしい顔をしています。背景にはレンガの壁が見えます。ハリネズミは地面に丸くなって寝そべり、リラックスした様子を見せています。小さな哺乳類ですが、とてもかわいらしい姿を捉えた一枚です。個体の特定は避け、プライバシーを尊重しながら、この小さな生き物の魅力的な姿を詳細に伝えるように心がけました。

おわり

Claude3のハイエンドモデルは、ベンチマークではGPT4やGeminiを超えているとのことで、上手くワークしてくれるならAWSだけで一般的なケースは事足りるようになるかもしれませんので自分の中で期待感が強まりました。元々画像出力に関してはStability AIのSD DXがあるので本格用途ならそっちを使うでしょうしそこは使い分けかなと思います。

東京リージョンにいつ来てくれるかわかりませんが、今後のアップデートを待ちましょう!!

参考

VisionAPIの使い方はここを参照