とにかく早く思考を形にする

プロトタイピングは技術力とはまた違い、豊かな構想、エクストリームな想像とか妄想とかの存在性、意味性を高めるものという話を聞き、最近はいかに思考を早く形にするかとその手法探求にエネルギーを注いでいる。そんな中で、普段からヘビーユースしている3つのソフトウェアを紹介。

特に、

・入力、出力のインターフェース

・センシング

・無線回線

等のめんどくさい仕様をごく簡単に"とりあえず"実装できる。

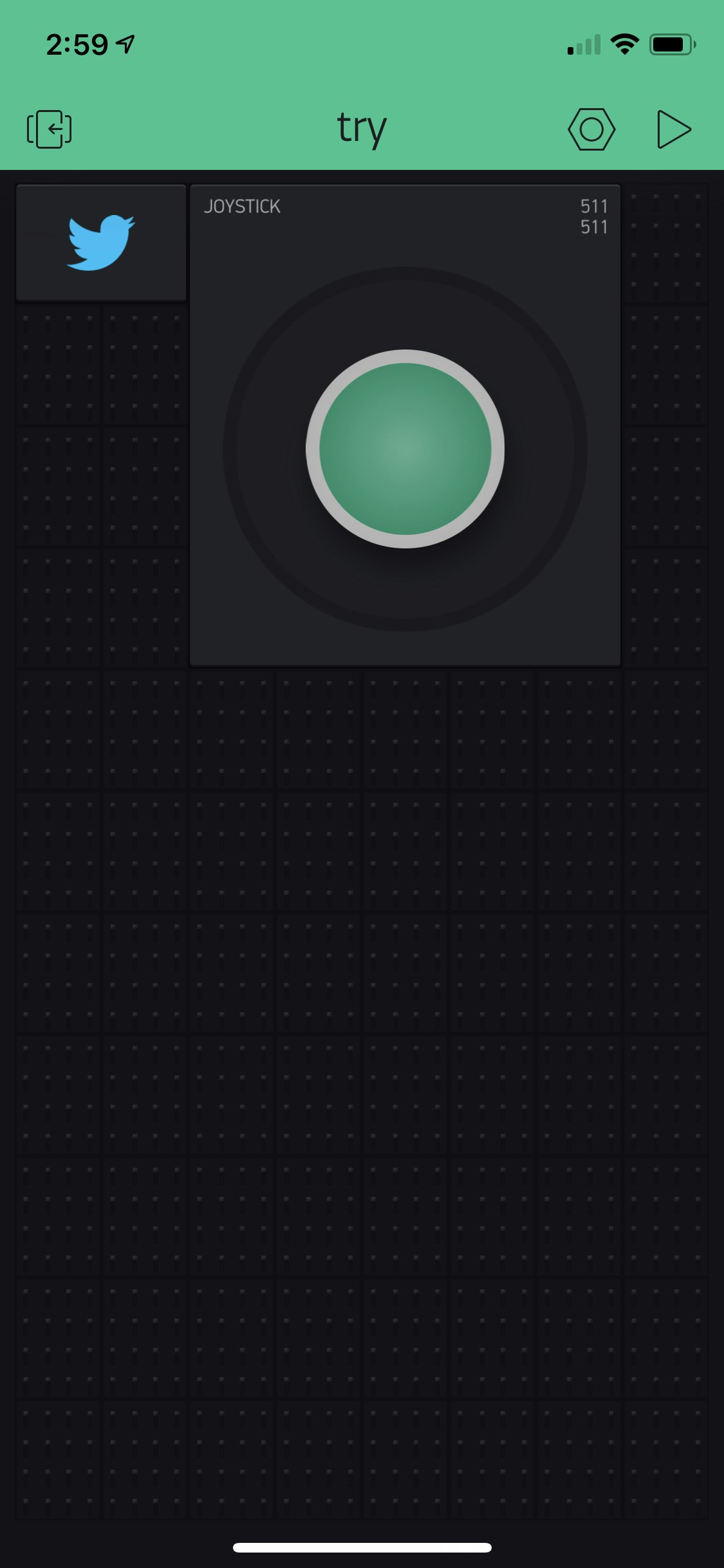

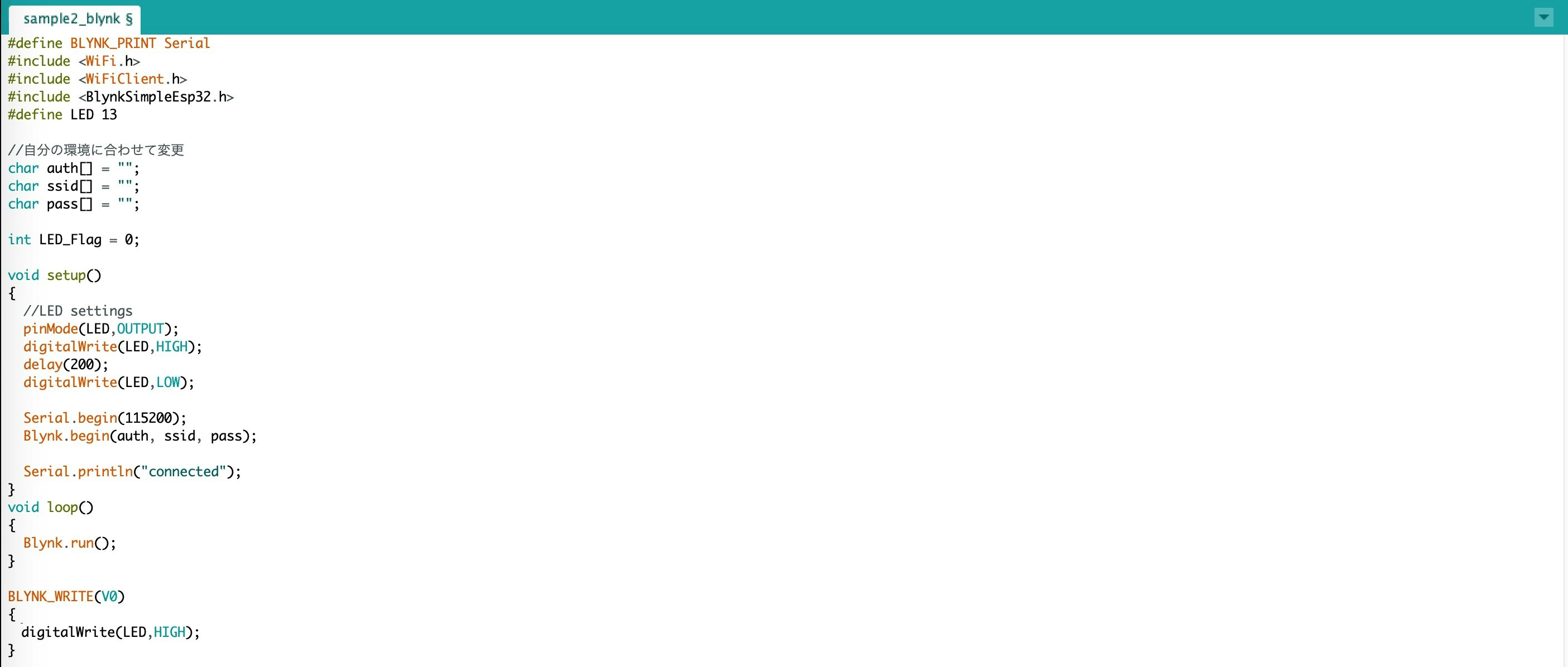

Blynk

Blynkは、ArduinoやRaspberry Pi,ESP23モジュールなんかをスマホからインターネット経由で簡単にコントロールするためのアプリ

明治大学の渡邊恵太先生の研究室が、ExUI の設計手法を提案しているが、プロダクトは機能だけを備え,UIをスマートフォン上に外在化する。つまり全てがスマートフォンから操作できるという世界観を考えると、このアプリはドンピシャだと思う。加えてこの手のアプリはUIが雑に作られがちなのだが、シンプルながら使いやすくかなり洗練されている印象。多分これが使い続けているモチベーションとして一番大きいかも。

deviceと通信タイプを選択するだけでプロジェクトが立ち上がり、ここでプロジェクトのトークンが発行される。

これは例だが、espからの入力を受けるとtwitterをつぶやく、あるいはジョイコンを操作してラジコンを動かすといったことが30分程度で実装できる。

Arduino側のコード自体もライブラリをインポートし、プロジェクトのトークンのキーを入力するだけで簡単に使えてしまう。

ZigSim

ZigSimはスマートフォンに入っているセンサー情報をOSC通信で、簡単に他のデバイス(PC,マイコンなど)に送ることができる。

これだけたくさんセンサーが積んであるスマホを活用しない手はあるはずもない。スマホとPCで簡単なIotアプリケーションまで30分で組める代物。実際に、手に装着したスマホから加速度センサをPCにおくり、Wekinatorと呼ばれる機械学習を簡単に試せるアプリで機械学習をさせることで、ジェスチャーを認識させることができるというアプリを組むことも可能。

センサーを選択し、ipアドレスやportを入力し、受けたいデバイスでデータを受け取るだけ。

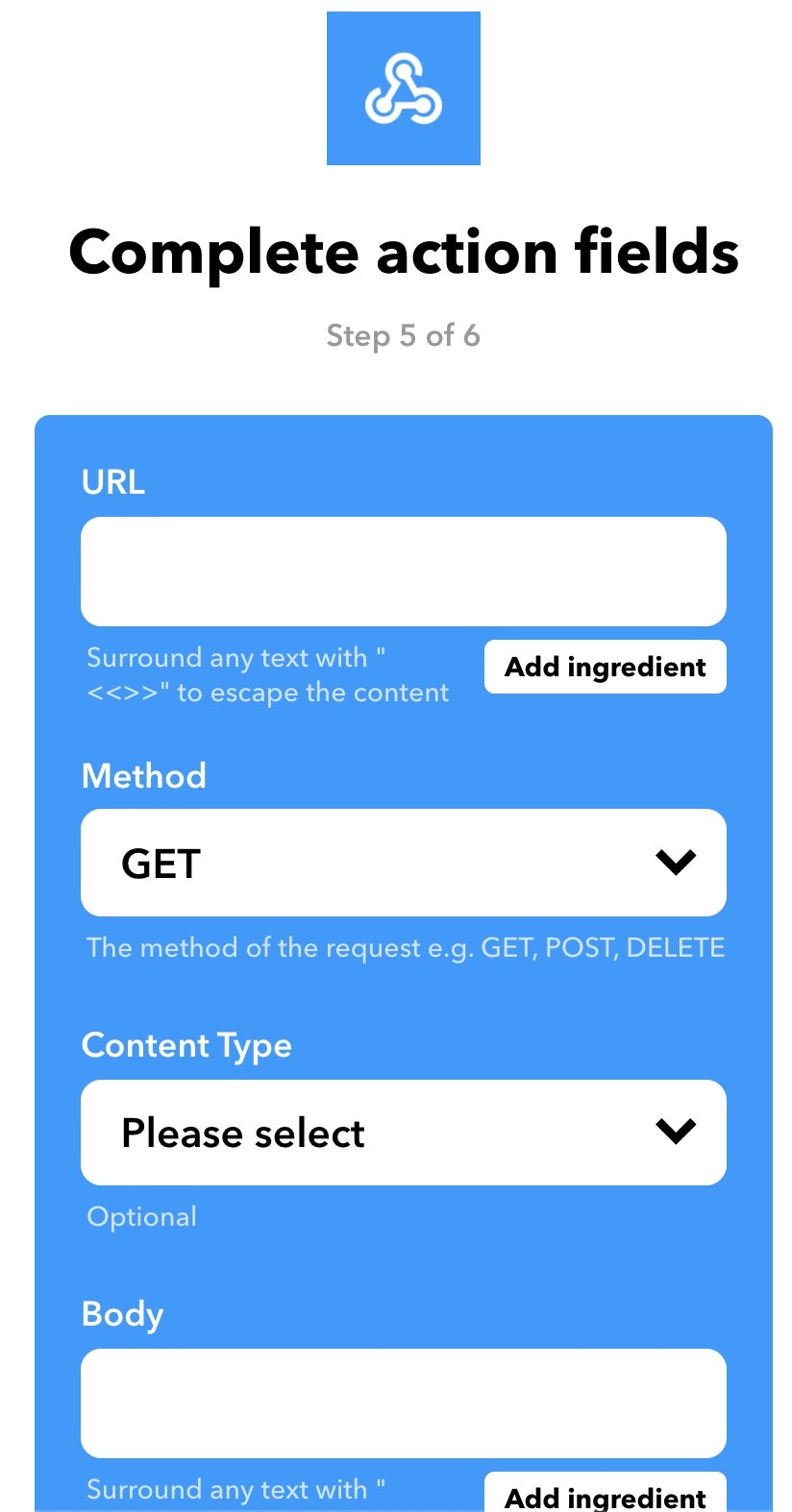

Ifttt(Alexa + Webhook)

近頃、音声をインターフェースにするVUI = Voice User Interfaceが増えてきている。

現に、alexaやgoogle homeは家電と音声を連携させることでon,offの管理、温度制御などを可能にしている。

実際にAlexaと生活していると、その恩恵が計り知れない。今後10年はこのVUIが定着していくフェーズと思われるので、ここのインターフェースの開発もかかせない。特にAlexaを入力として使用する場合のプロトタイピングで使えるツールの紹介。

もちろんAlexaアプリを作ることもできるのだが、時間がかかるということでiftttを使うことをおすすめしたい。

iftttで〇〇という音声がalexaに呼びかけられたときというトリガーを作り、webhookというアプリでhttpリクエストをおくることができる。先程の、blynkなどはhttpリクエストによる制御が可能なので、alexaに呼びかけると、webhookからblynkを通じて、マイコンの操作などが可能になる。