はじめに

SRA Advent Calendar 2022の19日目です。

関西事業部の南部です。

可能な限り誕生日の本日(12/19)に記事を書くようにして早6年。46歳になりました。

今回は、チームで取り組み、事業部の技術発表会で発表した内容を中心にお届けします。

デジタルツインとは

メタバースと共に様々なところで聞こえてくるようになったので、ご存じの方も多いでしょうが、少しだけ説明すると、

「デジタルツイン(Digital Twin)」とは、「デジタル空間上の双子」を意味し、

現実世界の機器や設備の状態を仮想空間のモデルに即時に反映し、仮想空間上に再現する技術のことです。

一般的なデジタル空間上でのシミュレーションとデジタルツインとの特徴の違いは次の2点です。

- 現実世界との連動している

- リアルタイム性が高い

⇒ 従来のシミュレーションに比べて、早くより精度の高い結果を得ることができます。

ちょっとWebで検索するだけでいろいろな活用例が見つかります。

Y:やったこと

デモ内容

-

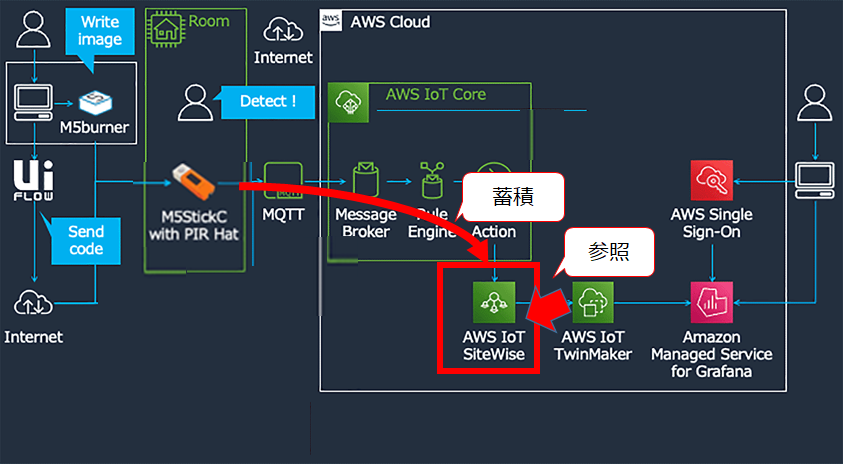

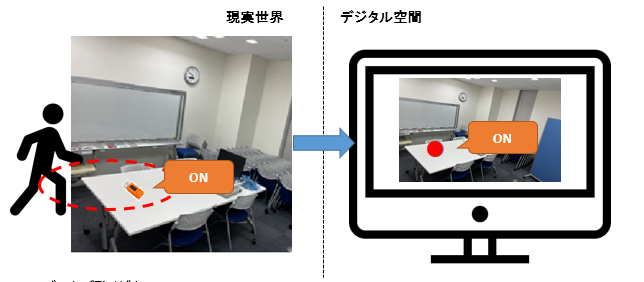

会議室をデジタルツインしてみた

会議室に設置した人感センサーがONになるとデジタル空間上のセンサーがリアルタイムでONになる

⇒ 現実世界をオペレーターがデジタルツイン上で監視するイメージ

-

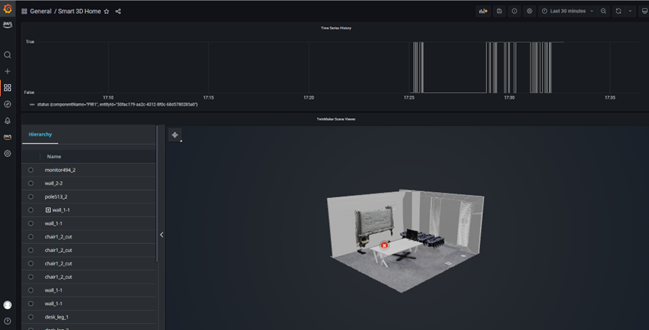

デモ動画

人を検知していない状態(センサ青)

↓

人を検知(センサ赤)

↓

人を検知しなくなった(センサ青)というデモです。リアルタイム性が高いはずが、なんだかもっさりとしたデモになってしまった。

作成工程

-

3Dモデル作成

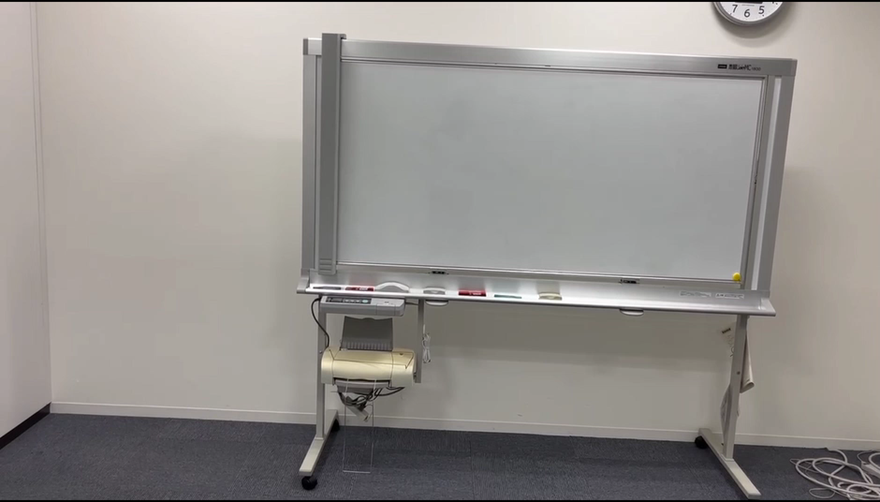

会議室の3Dモデルを作成する。今回は、CAD等を使用せずに動画や写真から作成した。-

3Dモデル用データ収集

- 対象物の動画を撮影する(使用機材: iPhone)

- 対象物を部屋の中心に配置し、1~2分ほどの動画を撮影する

- 対象物以外のものを映さないよう注意しながら撮影する

- 撮影する距離感は一定に保つ

-

画像切り出し (Screentogif)

- 撮影した動画から必要な枚数の画像を撮影する

- 動画に対して1秒当たりの撮影枚数を指定できるので、数秒の動画で大量の画像を用意することが可能

-

3Dモデル作成 (Meshroom)

- Meshroomを実行するためにはNVIDIAのGPUが必須

→AWSで構築できる仮想サーバーEC2(Elastic Compute Cloud)で要件を満たした仮想サーバーを構築することが可能(g4.dn系)

- Meshroomを実行するためにはNVIDIAのGPUが必須

-

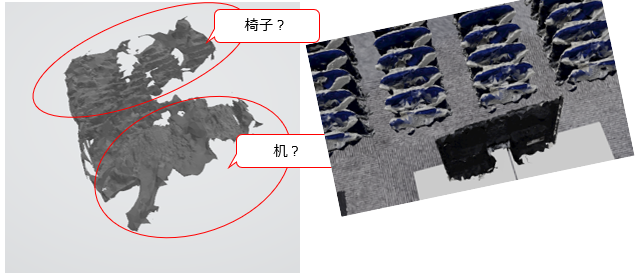

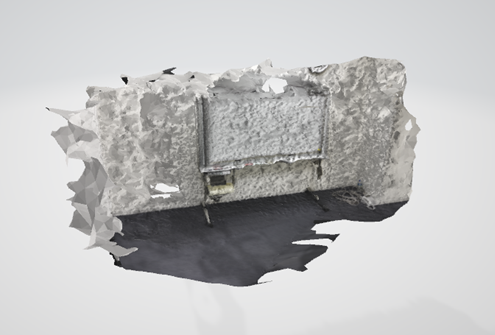

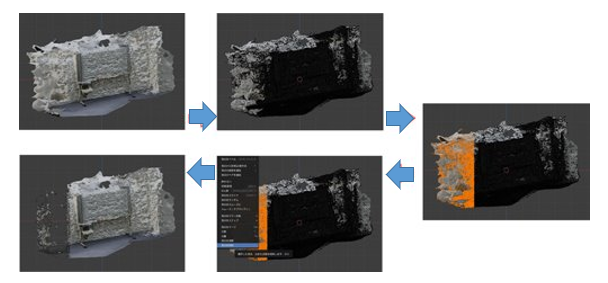

対象切り出し (blender)

- 不要な部分(頂点や背景)の削除を行う

- 切り出し結果

-

-

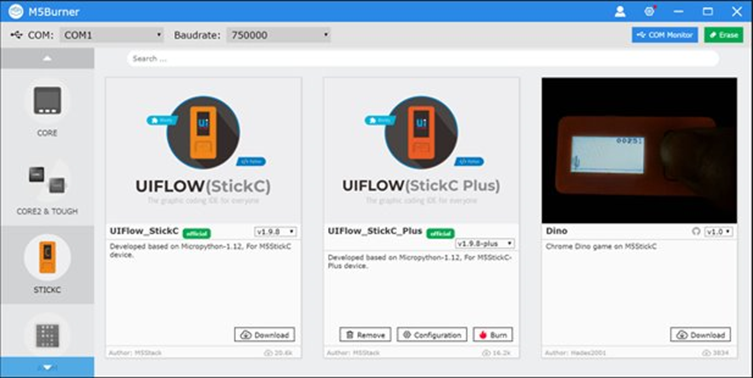

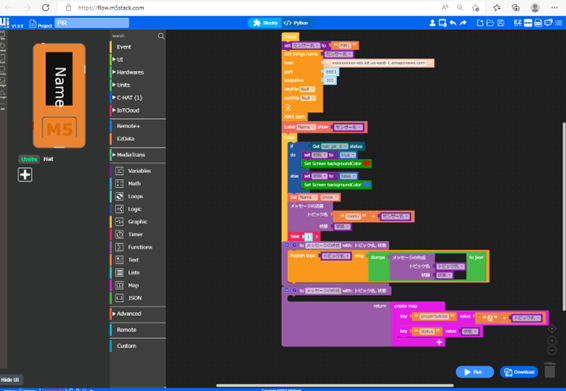

情報入力デバイス準備

現実世界情報を取得するデバイスを用意する。 -

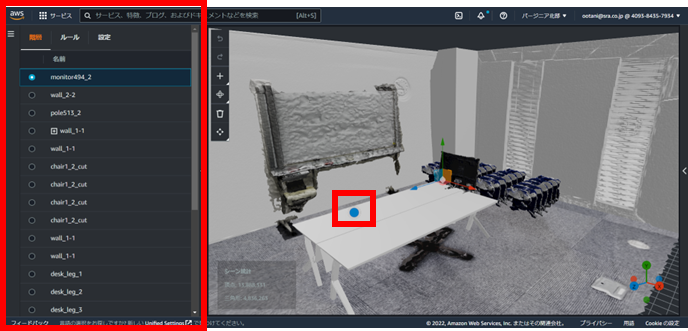

デジタルツイン作成

AWS IoT TwinMaker を使用した。

W:わかったこと

デジタルツイン作成

- 作業はAWSコンソール上の操作で完結するので簡単だった

- 多くのクラウドサービスを利用する必要があった

⇒ カスタマイズのためにはIoT関連のサービスについて知識が多く必要だと感じた - 本来早いはずの現実情報の反映速度が遅かった

⇒ 調査、改善する必要がある

3Dモデル作成

- 写真から3Dモデルが手軽に作成できるが、簡単に利用してみるレベルだと結果はかなり悪かった(粗かった)

⇒ デジタルツインを利用した高精度なシミュレータ作成時には、より正確な3Dモデルの作成が必要であると感じた

情報入力デバイス準備

- デバイスの実装のお手ごろ感が新鮮だった

⇒ マイコンをPCに接続しweb上でプログラミング後、そのまま動作確認とソフト書き込みを行うことができる

T:次にすること

画像認識とデジタルツインを組み合わせて何かサービスを検討してみようかと考えています。

さいごに

目指したものと実際に出来たものに差はあったが、業務では創作出来ないものを実際に作るという体験が出来たのは良かった。

また実際に動作するものでデモを実施出来たため、技術発表会の参加者によりデジタルツインがどういうものか伝えることが出来たのはよかった。

これで終わりではなく、これをスタートとして、またチームで取り組んで行きたいと思います。