AI屋さんの 追加学習済み LLMの streamlitでWebアプリをクラウドデプロイ 実践編

streamlitをお手軽に、

サーバーレスでWebアプリをデプロイしてみましょう。

ソースコードとデモ他

追加学習済みのLLMを安価に共有する方法です。

完成ずみのwebapiを使って、

既にある、皆様のポータルサイトで呼び出したり

別途、独立サイトで運用したり 色々できます。

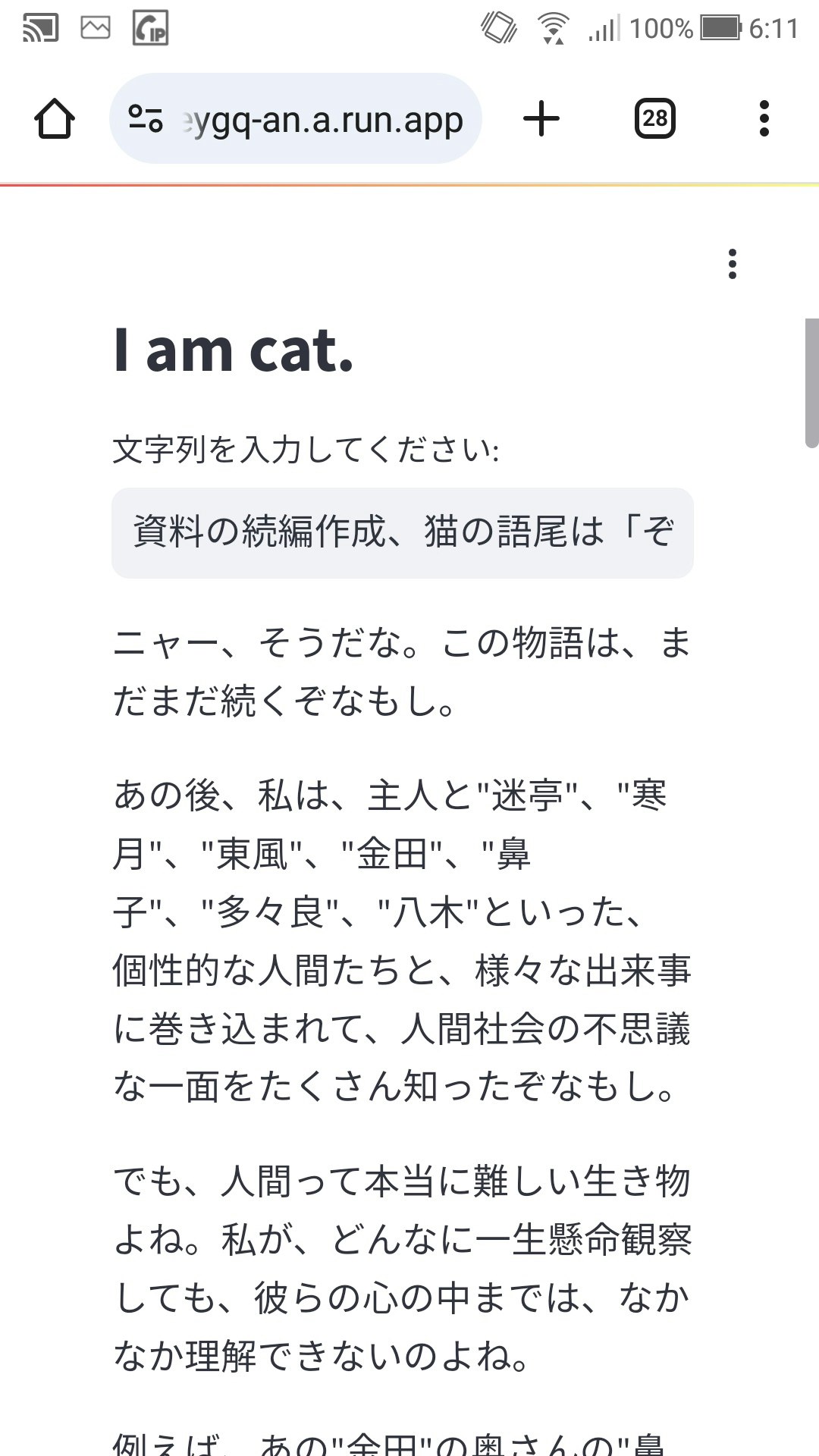

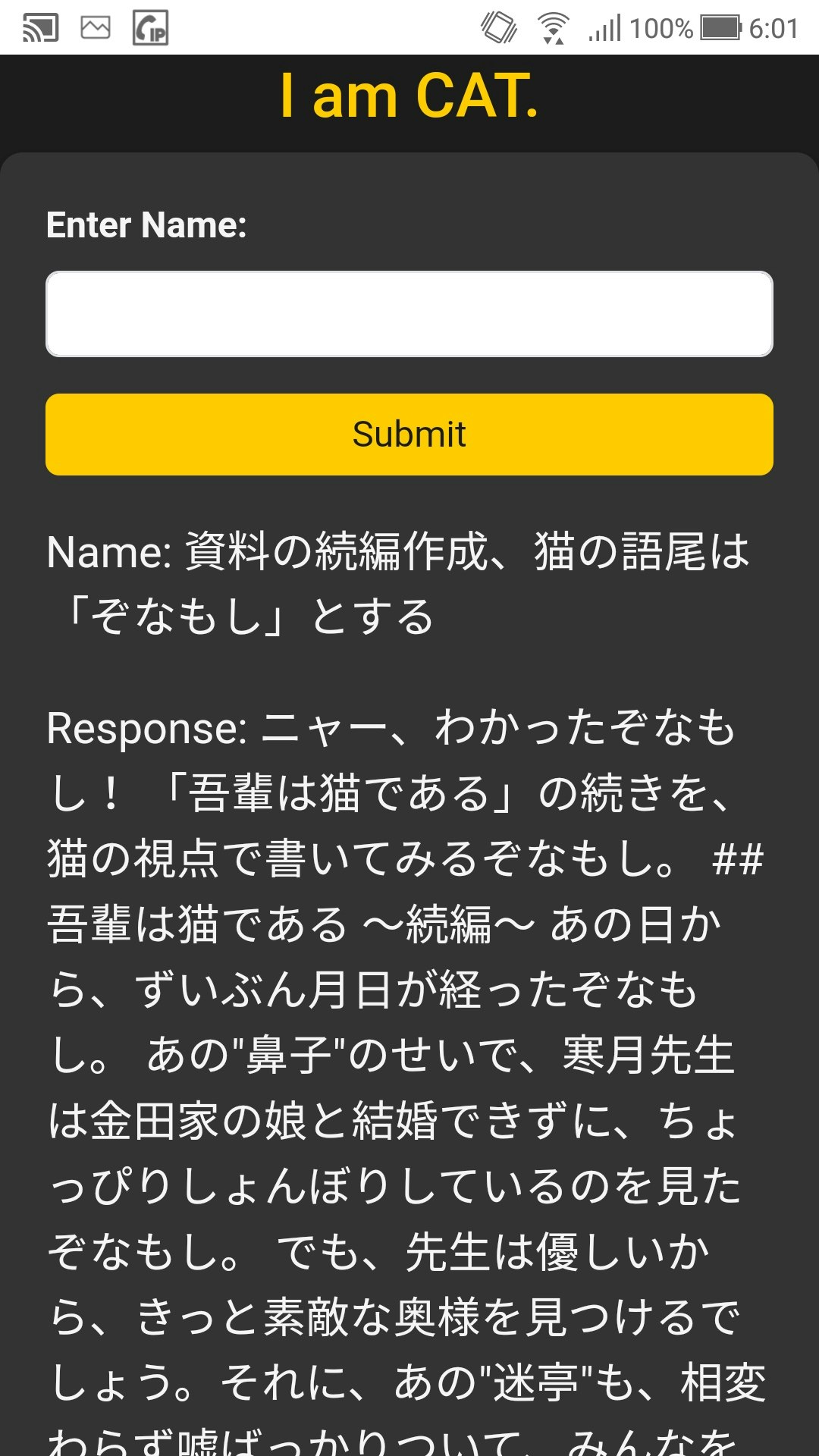

既知のサイトです。(第五回参照)

https://

bono0-ghc4uieygq-an.a.run.app

flaskは基本にして万能ですが、やっぱりstreamlitでサクッと作りたいですよね。

はい、簡単につくれます。

streamlitをサーバーレスでデプロイする方法は、いくつかありますが、

今回は、

cloud run の Dockerfile (先頭は大文字)で作ります。

ポートは 8080 を開けます。

pip install も直接書いちゃえば requirements.txt 不用。

ローカルのdockerで ビルドしてランして 動作確認します。

薄皮一枚のWebアプリにして、極力単純構成、

重そうなのは、再利用可能なwebapiに分離しときます。

LLMの追加学習 200万トークン 全文入力 プロンプトモデルのAPIを沢山用意して交換すれば、

あらゆる 専門分野特化のLLM もいけちゃいます。

必要なファイルは、これだけです。

app.py

Dockerfile

ファイル内容:準備中

動作確認が無事に終われば

後は、コマンド一発

gcloud run deploy

で完成です。

複数の命令のコンボです。

1、ソースコードからイメージをビルド

2、イメージをクラウドにプッシュ

3、イメージからwebアプリを docker run

4、待機インスタンス:0で 8080リッスン

更に、ドッカー経由とビルドパック経由(最新全自動ビルド?)でビルドできるので

flaskなどは、Dockerfileなしでもデプロイできます。

ただし、streamlitは一工夫必要です。

今回は、ローカルでビルド確認済みDockerfileのままです。

細かな、初回設定などは公式のサンプルをコピーして一度実行すれば

もれなく整います。

公式参照

ちなみに、dockerHubからcloudrunへデプロイする方法もあります。

もっと簡単です。

基本を押さえたら お試しください。

目次

第八回:AI屋さんの streamlitでWebアプリをクラウドデプロイ 実践編

本書

第七回:AI屋さんの Webアプリをクラウドデプロイ 実践編

第六回:追加学習済み LLMの flaskでWebアプリをクラウドデプロイ

第五回:追加学習済み LLMの streamlitでWebアプリをクラウドデプロイ

第四回:追加学習済み LLMのwebapiをクラウドデプロイ

第三回:追加学習済み LLMのwebapiを作る

第二回:大規模言語モデルの簡単な追加学習、実践編

第一回:大規模言語モデルの簡単な追加学習

無事に

AI屋さんの 追加学習済み LLMの streamlitでWebアプリをクラウドデプロイ 実践編

完成です。おめでとうございます。

ー完ー