Data-Efficient Contrastive Self-supervised Learning: Most Beneficial Examples for Supervised Learning Contribute the Least

1. 背景

自己教師あり学習(SSL)は、大量のラベルなし訓練データから高品質な表現を学習する手法であるが、経験的には、「SSLに最も貢献するサブセットは、教師あり学習に最も貢献しないものであることを発見」した論文。

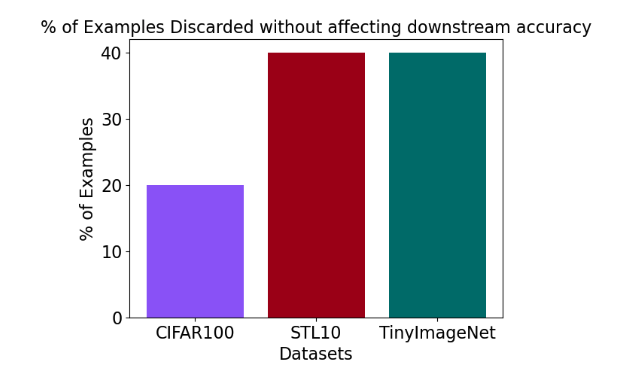

- CIFAR100では20%のデータを除いても下流タスクの精度に影響しなかった

- STL10では40%, TinyImageNetでは40%抜いても影響しなかった

- ImageNetなどは現在検証中とのこと

BibteX

@InProceedings{pmlr-v202-joshi23b,

title = {Data-Efficient Contrastive Self-supervised Learning: Most Beneficial Examples for Supervised Learning Contribute the Least},

author = {Joshi, Siddharth and Mirzasoleiman, Baharan},

booktitle = {Proceedings of the 40th International Conference on Machine Learning},

pages = {15356--15370},

year = {2023},

editor = {Krause, Andreas and Brunskill, Emma and Cho, Kyunghyun and Engelhardt, Barbara and Sabato, Sivan and Scarlett, Jonathan},

volume = {202},

series = {Proceedings of Machine Learning Research},

month = {23--29 Jul},

publisher = {PMLR},

pdf = {https://proceedings.mlr.press/v202/joshi23b/joshi23b.pdf},

url = {https://proceedings.mlr.press/v202/joshi23b.html},

}

そもそもなぜ自己教師学習(SSL)が必要なの?

ICML 2023 Data-Efficient Contrastive Self-Supervised Learning, youtubeより引用

高品質のラベルを大規模データに対して与えるのは高コストである。データは増える一方ですが、アノテーションが追いつかないという課題に対して、自己教師あり学習は重宝する

自己教師あり学習(SSL)の課題

- 自己教師あり学習(SSL)は、教師あり学習と比べて~20xの計算コストを必要とする

- SSLのためのサンプルの価値を定量化することが難しい(ある学習画像を入れたことでモデルの改善にどう繋がったかが把握しづらい)

2. 本研究の手法〜対照的な自己教師あり学習とは〜

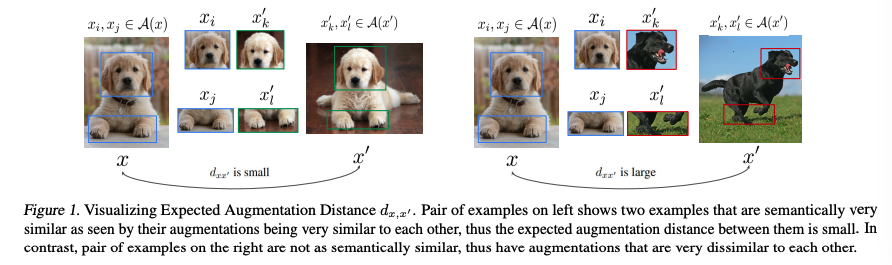

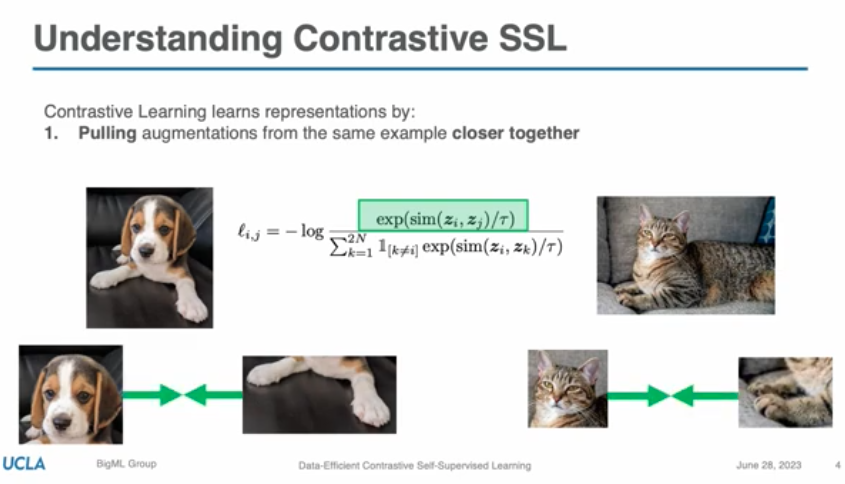

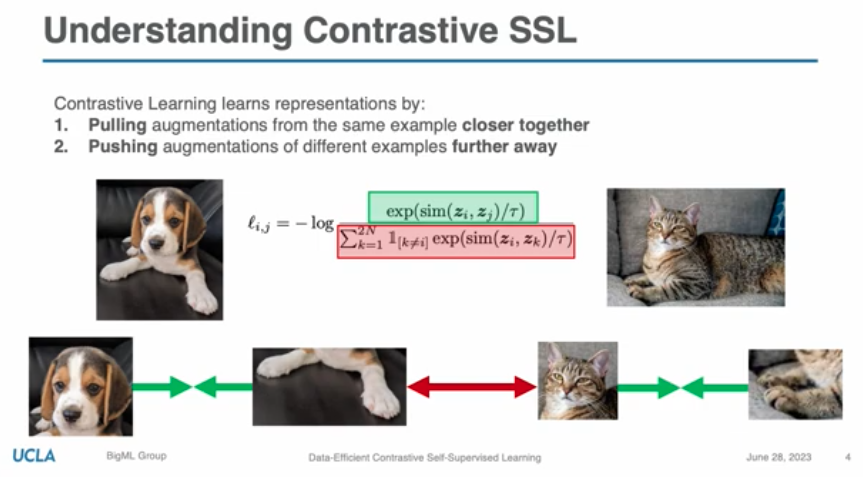

対照的な自己教師あり学習(Contrastive Self-Supervised Learning)は、ラベルなしデータから有用な特徴を学習する手法。データの異なるビュー間での類似性を最大化し、異なるデータポイント間での類似性を最小化することに焦点を当てています。このアプローチは、高品質なデータ表現を生成し、下流の教師ありタスクの性能を向上させることができます。

本研究の手法の流れ

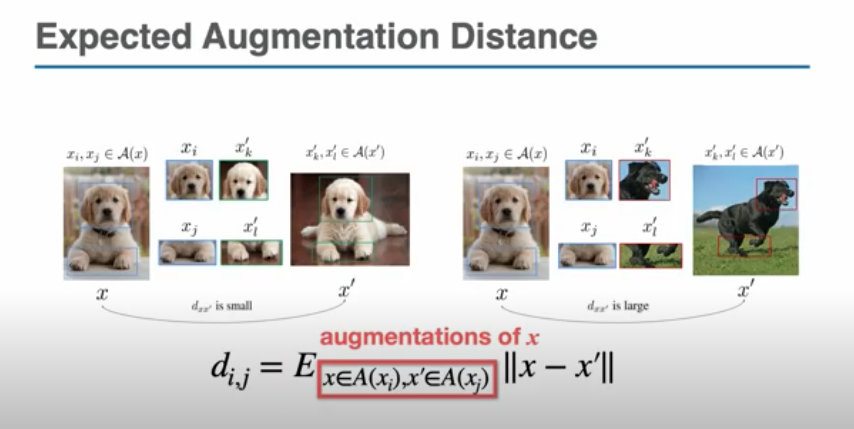

同じサンプルに対するAugmentationは近い距離となるように計算

異なるサンプルに対するAugmentationは遠い距離となるように計算

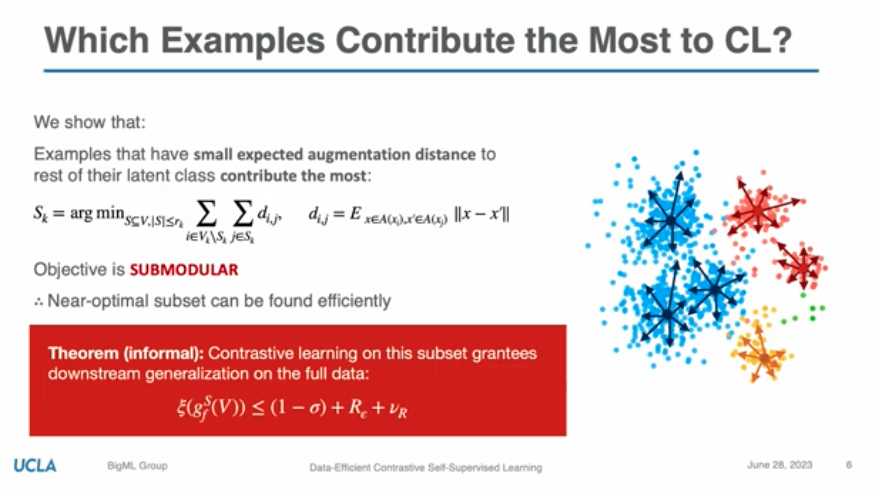

どのサンプルが最も対照学習(CL)に貢献しているのか

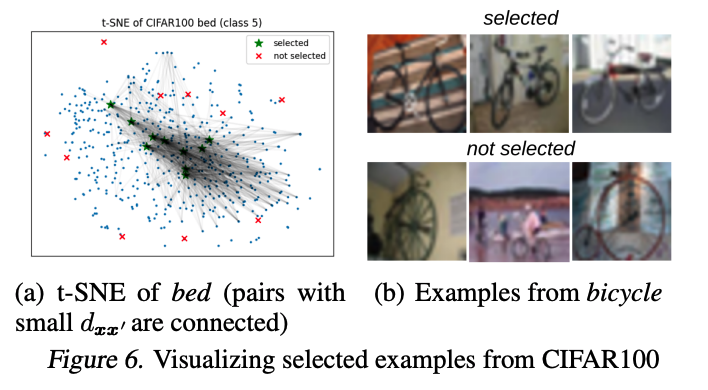

- 同じクラスに属するサンプル同士の距離を計算する

- t-SNE形式でマッピングした際に最も

3. 結論

対照的な自己教師あり学習(SSL)と教師あり学習との間の興味深い関係を示された。忘れられやすい(すなわち、学習中に正しく分類された後に誤分類されることが多い)サンプルは、教師あり学習において最も有益である一方、対照的なSSLにおいては最も重要ではないことが示された。逆に、忘れられにくい(すなわち、一度学習すると誤分類されることが少ない)サンプルは、対照的なSSLにおいて非常に重要であり、ランダムなベースラインを大幅に上回り、小さなサブセットにおいてSAS(サンプル選択戦略)と同等の性能を達成可能。この発見は、SSLと教師あり学習で重要なデータのサブセットが異なることを示した。

- SSLで最も重要なサンプルは、教師あり学習で最も貢献が少ないサンプルあることが示された

- この発見は、SSLのためのデータ選択戦略の開発に役立つ

4. 参考文献