はじめに

この記事は、AI RC Car Advent Calendar 2019 20日目の記事です。

ある飲みの席で、「面白いものがあるんですよ!」という魅惑の一言をいただき、

はじまった私のDonkey Carライフ。

走るようになるまでの流れや、Maker Faire Tokyoや走行会などを経て、

少しずつブラッシュアップしたところを書き留めます。

★セットアップ方法やソフト的な部分などは、イベント・走行会での生の声や、以下のサイトを参考にさせていただきました。

基本的にはこちらのサイトの情報で、走らせることができています。

・FBグループ AIでRCカーを走らせよう!

↑イベント情報、新ネタ、Q&A等々。まずはここから。

・FaBo DonkeyCar Docs

↑キットを使用したセットアップ、走らせるまでの流れなど。

・DonkeyCar Docsサイト

↑DonkeyCarをラズパイからJetson nanoに変更する際に、特にセットアップでお世話になりました。

・FaBo Store(日本)

↑キット、車体や部品入手ならこちら。

First Donkey Car

Tesla?Waymo?DeepRacer?自動運転といえば、そんなイメージしかなかった私には、DonkeyCarの敷居の低さ(シンプルさ)と楽しさは衝撃的でした。

やることといえば、

1.教師データーの取得(ラジコンを走らせる)

2.人が走らせた際の画像・ステアリング・スロットル値をもとに、学習データーを作成(ここが肝)

3.学習済みデーターを使って自動走行

の3ステップ。

この中に単純ではあるが、「畳み込みニューラルネットワーク」などの機械学習の基礎要素が隠れている。深く考えずに肌感覚でテクノロジーを味わえる・流れを知れるところに、大きな魅力があると思っています。

まずは、入門キットを買って走行会に参加しました。

テキストエディタすら普段の生活に全く出てこない日常を過ごしているので、流れ通りにやるのも精いっぱい。1回目では、走らせるところまでたどり着けませんでした・・・。

予習(基礎的なところで、各種ツールの操作・学習の流れ・wifi周り(wpa_supplicant)・myconfig.pyの内容・各学習モデルの特徴など)を行い、2回目の走行会で初めて自動走行を実現出来ました。

良くも悪くも操縦者の癖を反映して走るところに、ワクワク感と愛おしさ(?)を感じ、はじめてから3ヶ月でどっぷり沼にハマってしまいました。

Donkeyくん バージョンアップの軌跡

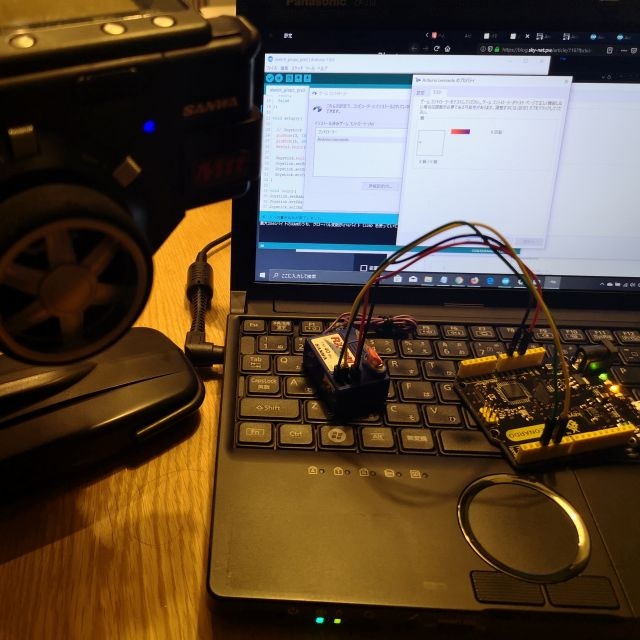

コントローラーのプロポ化

Maker Faire Tokyoに参加する際に、会場内参加者の大量なWi-Fi機器の影響で干渉が起き、同じ2.4Ghz帯で通信しているコントローラー(F710)がノーコンになる可能性が出てきたため、FM帯を使用する古いラジコン用プロポを準備し、挑むことにしました。

Arduinoって・・・万能!

走行会やFBグループにて情報をいただき、プロポ->受信機で送られてきた信号(PWM)をArduino leonard(同様にHID機能があるMicroでも可)を使ってUSBジョイスティック化する方向で動きました。

「?」の連続でしたが、諸先生方に聞いたりトライ&エラーを経て、めちゃくちゃなスケッチかもしれませんが、なんとか信号の認識に成功。

(後に、教えていただいたサーボのレスポンスアップ技、「pulseIn」から「Pin Change Interrupt」をつかったスケッチに変更。サーボの動きがスムーズに。)

Maker Faire Tokyo開場後しばらくして・・・F710コントローラーの動作が怪しく…。

プロポ化はテスト走行する余裕もなかったので、まずは王道のUSBコントローラーF710で

チャレンジ。

始めの頃は問題はなかったが、徐々にコントローラーの挙動が怪しくなってきました。教える(ラジコンを走らせる)ことができなければ、自動運転もままならないので、FMプロポに変更。誤作動も無くプロポの使いやすさも相まって、安定の走行に。

Jetson Nanoの活用

colaboratoryでの学習ができません!

コントローラー問題が解決したのも束の間。学習のために使うGoogleの仮想マシン上Python実行環境「Google Colaboratory」への接続が不安定になり、エラーを吐き出す状態に。

(のちに伺った情報だと、参加者が一斉に学習を進めたことで、同一IPよりColaboratoryへの

アクセスが増加したため、帯域が絞られたのではないかという状況)

次なる方針として、学習も含めてスタンドアローン化できないかと考えるようになりました。

以下理由で、Jetson Nanoの採用を検討しました。

・Raspberry Piより余力があるので、高速走行に耐えられるのではないか。

・スタンドアローンで学習が完結できると、環境(ネットワーク・クラウド)に左右されない。

打倒!Jetracer

Maker Faire Tokyoで快走していた、Nvidia謹製「Jetracer」のスムーズな走りが頭から離れず、あんなふうに走らせたい・・・という気持ちが強くなりました。

方針として、「ハードはJetracerベースで、あわよくば同ハードでDonkeyも楽しみたい」という方向になりました。

(Jetracerとdonkey carでは学習の仕方が異なるため、どちらも楽しみたく)

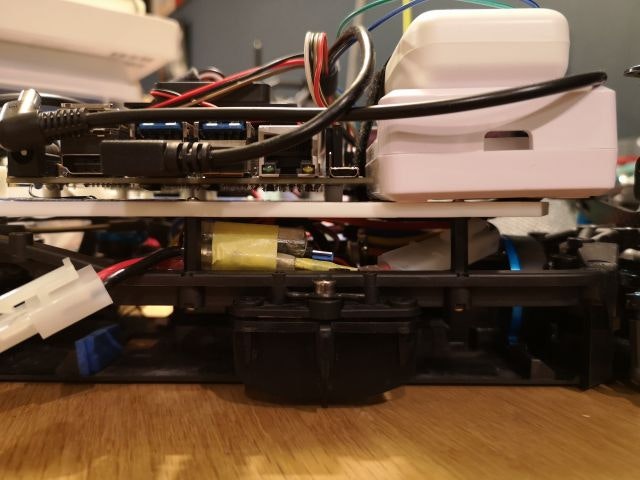

TAMIYA 1/10シャーシの活用

GitHubのJetRacer docsではタミヤTT02なのだが、手に入ったのがタミヤTB05というシャーシ。

ちょうど良くシャーシの一部が、3Dプリンターで作るベースボード(Jetracer用)と、穴の位置調整だけでネジ止めできそうだったので、そのままTB05を使うことに。

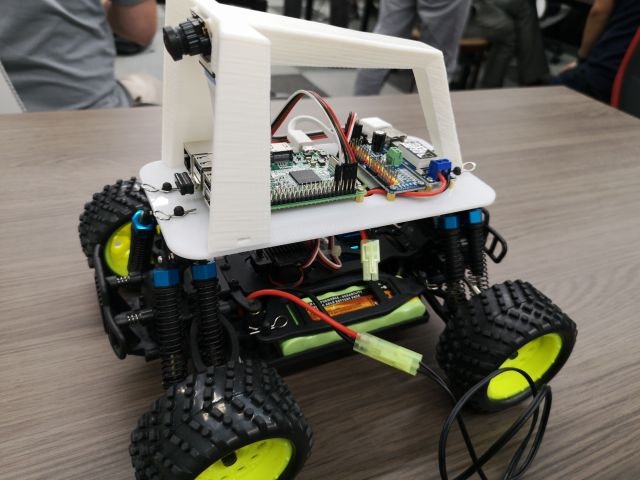

試作機(2号機)

とりあえず、操作しやすいようにアクリル板に全部乗せてみました。

手始めに使い慣れたdonkey carのシステムとJetson Nanoの組み合わせで。

DonkeyCar Docsのサイト通りにインストールしたところ、とりあえず挙動は正常の様子。自動運転も安定していて、好印象。だが・・・。

やっぱりボディをつけたい!

ロールバーがついたDonkeyくん1号機はなんとなく“ずんぐりむっくり”でよい感じだが、2号機は重さも含めてイマイチ感が残る。

走行会に参加されていたNSXボディのAIカーがかっこよくて・・・。

そうだ、ボディをつけよう。

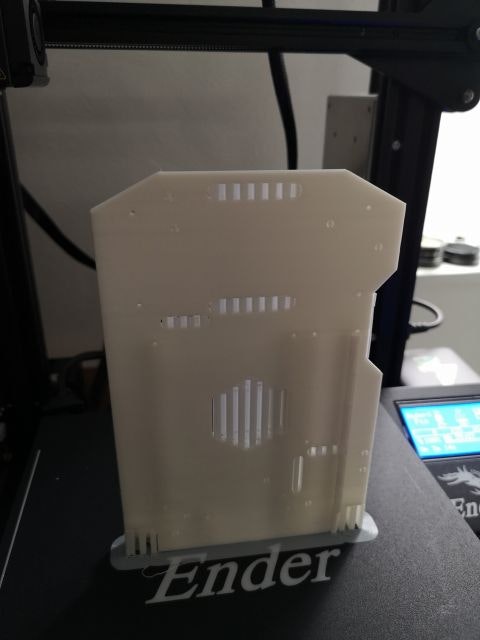

3Dプリンターってすごい!

3D出力サービスをいろいろ見てみたが、いかんせんお高い。

プリンターを買って作ったほうが後々安く上がりそうだったので、評判の良い安めのプリンターを導入。ホットベッドの高さ調整が大変だったり、周囲の温度変化に弱かったりとポイントはいっぱいあるものの、比較的スムーズに出力できました。

(ソフトの使い方は0から勉強しつつ・・・)

形あるもの、なんでも作れちゃいますね。3Dプリンターって。

本当に凄い。

・カメラステー(ボディとうまく合わせられるよう作成)

ボディをつけたことで、カメラケーブルの脱着が必須になってしまったため、フラットケーブルをHDMIに変換する基板を採用。少しは脱着に強くなったはず。

・CSI to HDMI Cable Extension Module ←Amazon等で買えます。

緊急停止させたい!

スピードアップを目指すと、怖いのがドンキーくんにありがちな大暴走。

せっかく多チャンネルプロポを使うので、ボタンを割り当てて緊急停止ができるようにすることに。

Jetracerで使用するサーボ マルチプレクサーを使い、ESCへの信号をプロポでダイレクトにカット(接続されているマスターと無接続のスレーブをプロポの信号で切替)できるように配線を行いました。反射神経さえ鍛えれば、マシンを壊さずに済むかもしれません。

学習をJetson Nanoで行ってみる。

・Jetson Nanoでの学習

そのままでは学習が最後まで完走できなかったので、myconfig.pyを2行変更。

BATCH_SIZE = 64

CACHE_IMAGES = False

その後、10W(MAXN)モードで学習開始。

# 10Wモードに(走行中は5Wモードに)

sudo nvpmodel -m 0

# <指定タブ>

python ~/mycar/manage.py train --tub <tub folder names comma separated> --model ./models/mypilot.h5

# <全タブ>

python ~/mycar/manage.py train --model ~/mycar/models/mypilot.h5

・稼働状況を見たいときは・・・。

メモリーやGPU使用率など稼働状況を見る際は、jetson-statsを事前にインストール。

# jetson-statsのインストール

sudo -H pip3 install jetson-stats

# 学習中に別窓でこちらを実行

sudo jtop

・学習結果はmodelsフォルダーに保存されるので、あとは走るだけ。

# 5Wモードに変更

sudo nvpmodel -m 1

# 自動走行

python manage.py drive --model ~/mycar/models/mypilot.h5

プログラム起動後、ブラウザで

IPアドレス:8887で車両にアクセス

画面の

model & pilot→Local Pilot (d)を選ぶと自動走行開始。

model & pilot→User (d)を選ぶと自動走行停止。

その後、CTRL+cでDonkeyCarを停止。

nanoで学習を行うと10000レコードで1時間かかったりと問題はあるが、とりあえずは安定して走る状態なので、次の課題としてソフト面でのアプローチ(他の機械学習モデルや各種センサー活用や最適化)、ロボットアーム装着などに挑戦してみたいと思います。

ドンキーカー通じて、現在まで学べたこと。

・3Dプリンターの使い方(CAD・ツール・プリンター本体など)

・Arduinoの使い方。

・機械学習の入り口知識

・世界と日本のAIに対する関心度の差

・ラジコンの操縦

・散財する楽しさ

さいごに

2019年は折角面白いものに出会えたので、これから深く掘って見たいと思います。

とりあえず、なんとなくでも走ってしまう懐の深いDonkeyくん。

走行会で機械学習を肌で感じましょう!