はじめに

今回記事作成者のE資格受験勉強のために記事を作成しています

間違いなどありましたらコメントにてご指摘いただけると幸いです。

目的

E資格のシラバスの内容の用語について理解を深める。

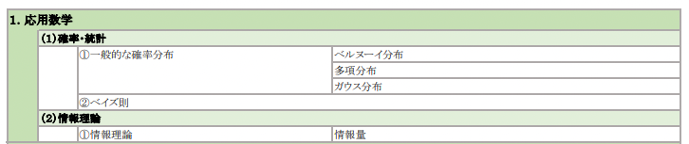

E資格のシラバスの内容

1. 応用数学

(1) 確率・統計

① 一般的な確率分布

ベルヌーイ分布

ベルヌーイ分布とは、「成功か失敗か」「表か裏か」「勝ちか負けか」のように2種類のみの結果しか得られないような実験、試行(ベルヌーイ試行)の結果を0と1で表した分布を指します。

1である確率がpであるとき0である確率は1-pとなる、非常にシンプルな確率分布です。

ベルヌーイ分布の確率関数は、P(X=x)=(P^x)*((1ーP)^(1ーx))で与えられ、その期待値はp, 分散はp(1-p)である。

参考URL

多項分布

多項分布とは、結果がたくさんある試行において用いられる確率分布です(つまりベルヌーイ試行とは異なる訳ですが、互いに独立した試行であるという前提に変化はありません)。そういった試行の具体例としてはサイコロ投げが挙げられます。

参考URL:

ガウス分布

ガウス分布は正規分布ともいう。

正規分布とは統計・統計学を理解する上で一番大切な確率分布です。その名前(正規分布 normal distribution)からもわかる通り、”normal”な、「ありふれた」「通常の」確率分布です。名前の所以は、自然界や人間の行動・性質など様々な現象に対して、よく当てはまるところから来ています。そして、そのグラフは、下図のように左右対称な曲線になります。

参考URL:

② ベイズ則

ベイズの定理は、

ある事象に関連する可能性のある条件についての事前の知識に基づいて、その事象の確率を記述するものである。

参考URL:

参考書籍

史上最強図解 これならわかる!ベイズ統計学【電子書籍】[ 涌井良幸 ]

(2) 情報理論

① 情報理論

情報量

以下の2つの要請を満たす「情報量」を定義しましょう。

1:発生する確率が低いこと(珍しいこと)が分かった時のほうが、情報量が多い

2:情報量は足し算で増えていく。

この条件を満たす情報量は以下のように定義できます。あることが分かった際の「そのことの情報量」を自己情報量と呼びます。

自己情報量:i(x)=−log2P(x)

ここでP(x)は、「あることが起こる確率」を表します。

情報エントロピー = 平均情報量

参考URL:

その他の用語

確率変数

確率変数とは、ある値を取る確率が存在する変数のことである。

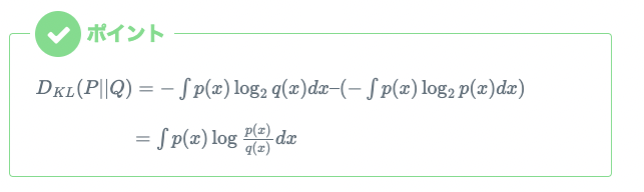

KLダイバージェンス

KLダイバージェンスは、p(x),q(x)の確率がどのくらい近似しているかをみている。

全く同じであればKLダイバージェンスは0になる

KLダイバージェンスと相対エントロピーは同等の値である

KLダイバージェンスは、二つの確率分布の違いを数量化したもの

ある確率分布Qがターゲットの確率分布Pをどのくらい忠実に近似しているかを数値として表している。

計算方法は、交差エントロピーから情報エントロピーを引くだけ

KLダイバージェンス計算式

参考URL:

シャノンエントロピー

平均情報量のこと

シャノンエントロピー

H(x)=−∑P(x)log(P(x))