iOSのLiDARセンサーを用いたサンプルコード集をGitHubに公開したので紹介します。

本記事の執筆時点でGitHubで91スターを頂いています!

TokyoYoshida/ExampleOfiOSLiDAR

👆よさそうだと思った方はスターをお願いします⭐

例えば、こんなサンプルが入っています。

The GitHub repository of sample code using iOS LiDAR sensors, including 3D scanning, got 40 stars in a day!

— TokyoYoshida (@jugemjugemjugem) February 19, 2021

iOSのLiDARセンサーを用いたサンプルコードのGitHubリポジトリが1日で40スターも取った!

The repository is here.https://t.co/FHASFV4Zfs#iOS #LiDAR #AR #ARKit pic.twitter.com/lfCq1T9yBg

iPad Pro/iPhone 12 ProにLiDARが搭載されたとき、いつかは現実世界をスキャンしてみたいと思っていたかたもいらっしゃると思いますが、このサンプルを使えば簡単に実現できてしまいます。

ビルド方法

XCodeでExampleOfiOSLiDAR.xcodeprojを開いてビルドして、iPhone 12 Pro/Pro MAXかLiDARセンサーを搭載したiPad Proにインストールします。

サンプル一覧

Depth Map

深度情報を画像にしたものです。スクリーンショットは静止画ですがリアルタイムに動作します。

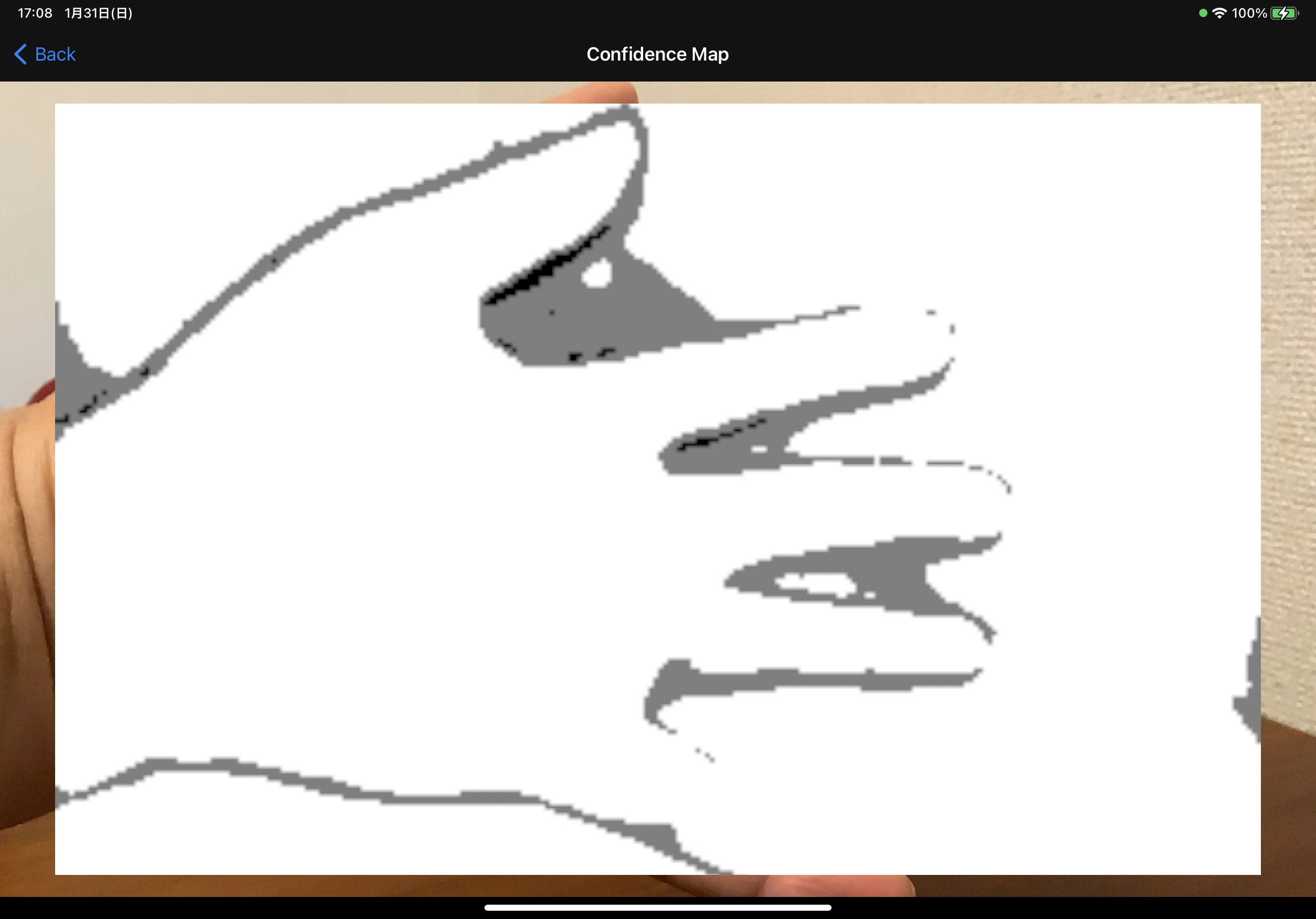

Confidence Map

深度情報の信頼度を画像にしたものです。リアルタイムに動作します。

Collision

現実世界に、仮想的なオブジェクトがぶつかったときの判定をします。

Export

現実世界のオブジェクトをスキャンして、.objファイルにエクスポートします。

エクスポートしたファイルはXcode,Macのプレビューなどで閲覧したり、Blenderで編集できます。

👇

👇

Scan with Texture

現実世界のオブジェクトをカラースキャンします。こちらは、サンプルアプリ内でのみ閲覧できます。

最後に

LiDARセンサーはなかなかおもしろい技術なので、これからも追っていきたいと思っています。作品やサンプルができたら、Twitterで発信していきますのでフォローをお願いします🙏

Twitter

https://twitter.com/jugemjugemjugem

Note こちらはiOS開発、AR、機械学習などについては発信しています。

https://note.com/tokyoyoshida