はじめに

こんにちは、株式会社ジールの@Suguru-Terouchiです。

三が日は子供の胃腸炎をもらって腹痛と高熱で寝込んでました。

気を取り直して、2023年も頑張っていきましょう。

さて、前回まで基礎編として機械学習の3つの手法を学んできました。

今回から実践編に入っていきたいと思いますが、まだそこまで仕事モードに入れていないので、

準備運動も兼ねて、第4.5回としてゆるっとAI/機械学習ことはじめしていきたいと思います。

サクッと触れるAI/機械学習

前回、AWSのDeepRacerというサービスをご紹介させて頂きましたが、

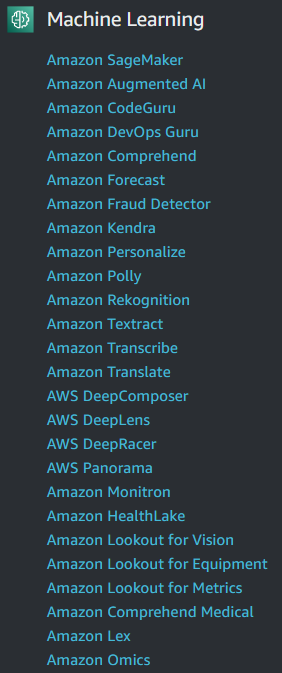

それ以外にもAWSで提供されているAI/機械学習サービスはいっぱいあります。

どれくらいあるかというとこれくらいある。(執筆時点で26サービス)

一つ一つ紹介していると2023年が終わってしまいそうなので、いくつか摘んでいきます。

Amazon Comprehend

公式サイトより引用:https://aws.amazon.com/jp/comprehend/features/

Amazon Comprehend は、機械学習を使用してテキストから洞察を見つける自然言語処理 (NLP) サービスです。

簡単にいうと入力されたテキスト(文字列)を分析して色々な結果を返してくれるサービスですね、

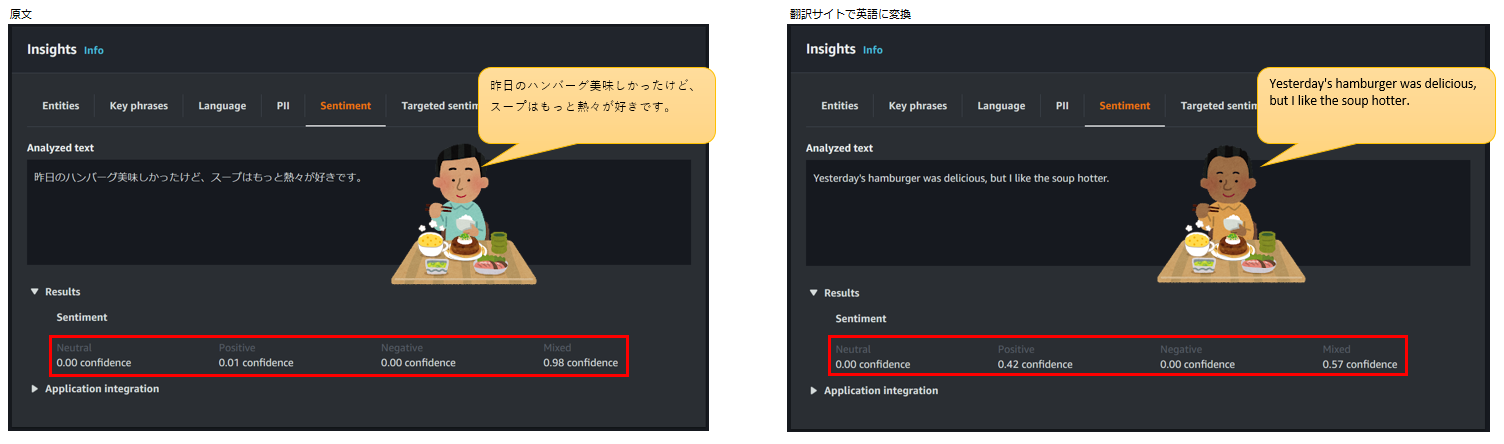

機能の一つに感情分析というのがあるので、早速やってみましょう。

感情分析の結果として、赤枠部分にある「Neutral」(中立的)、「Positive」(肯定的)、「Negative」(否定的)、「Mixed」(混在)の4つの要素とスコアが表示されています。

最初日本語でやってみたのですが、ほぼ「Mixed」(混在)になってしまったので、翻訳サイトの力を借りて英語でも試してみたところなんとなくイメージしていた結果が返ってきました。

この結果の違いは日本人がシャイということではなく、日本語に対応してからまだ日が浅いことと、日本語という文字列が分析側から見ると複雑ということがありそうです。

Amazon Polly

公式サイトより引用:https://aws.amazon.com/jp/polly/

Amazon Polly は深層学習技術を使用し、人間の声のような音声を合成します。そのため、記事を音声に変換することができます。

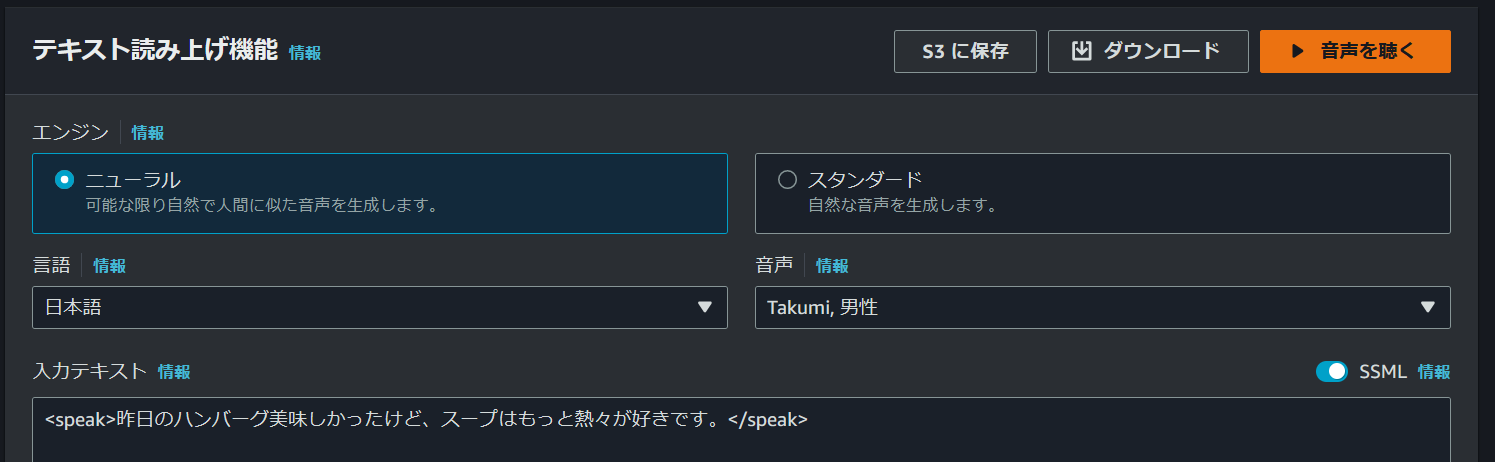

簡単にいうと入力されたテキスト(文字列)を分析して音声データを返してくれるサービスですね、早速やってみましょう。

オレンジ色のボタンの「▶ 音声を聴く」で入力したテキストを流暢に読み上げてくれました。

特にニューラルを選択した時の音声は全く片言感がありませんでした!(残念ながら音声データは貼り付けられなかったので試せる環境がある方は是非やってみてください。

設定も自然な読み上げ(ニューラル)と機械的な読み上げ(スタンダード)があり、

言語により音声の種類(画像だとTakumiさん)が変わったりするのが面白いと思いました。

ただ、これをどう活用するのかイメージ沸かなかったので調べてみたのですが、ニュースサイトを運営している企業などの事例が出てきました。確かに毎日変わる記事の読み上げデータに活かせるとなるとメリット大きそうです。

Amazon Rekognition

公式サイトより引用:https://aws.amazon.com/jp/rekognition/

Amazon Rekognition は、事前トレーニングされたカスタマイズ可能なコンピュータビジョン (CV) 機能を提供して、画像と動画から情報とインサイトを抽出します。

これはこれまで学習してきた画像分析に相当するサービスですね、一口に画像分析といっても色々ありそうです。

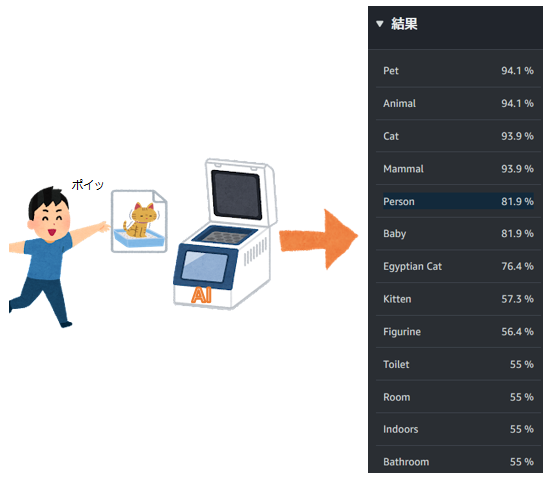

入力する画像のことも考えて今回は「ラベル検出」をやってみましょう。

ちょっと画像の解像度があまり良くないせいか「Person」とか「Baby」が入ってきてしまっていますが、

9割以上のスコアを出しているものに異論はなく、個人的には「Toilet」が出てきたことに驚きを隠せませんでした。

おわりに

いかがでしたでしょうか。

これまで基礎を学んできましたが、もうここまで学習済みのモデルを使ったサービスが提供されているんですね。

次回は今度こそ、実践編として今回あえてスルーしたAmazon SageMakerに触れていきたいと思います。