この記事は MIXI DEVELOPERS Advent Calendar 2022 23 日目の記事です。

はじめに

こんにちは!

株式会社MIXIのデザイン部署にて、Creative Directorをやっています。Sound Designerでもあります。非エンジニアですが、ゲーム制作の現場ではTechnical Sound DesignerとしてUnreal Engineに触れる機会が多かったこともあり、その延長で最近ではUnrealを使ったVirtual Productionにも少し手を出しています。

デザイン部署のノンゲーム分野におけるUnreal Engine活用事例は、「MIXIにおける、デザイン職独自の評価指針をつくった狙いについて」の記事で軽く掲載されています。

概要

今回の記事は、Unreal Engine 5.1でMIDIデバイスを使えるようにする方法を紹介します。具体的には、MIDI対応のフィジカル・コントローラーをUE5で使えるようにします。実験的実装になるので、ノンゲーム領域で使うことをオススメします。

- 環境

- Unreal Engine 5.1(UE4.27でも確認済み)

- Windows PC

元々はせっかくUnrealを使ったVirtual Productionをやるなら、BGMや効果音の再生、音量の調整などのオーディオ処理もUnreal Engine側でやりたいなというのが出発点です。ある程度Unreal側で自動でBGMや音量調整などを出来るようにした上で、MIDIフィジカル・コントローラーを使って人間の手で微調整したり、臨機応変に介入できる仕組みを考えています。

Unreal Engine 5のMIDIの扱いに関する公式ドキュメントはこちらです。

セットアップ

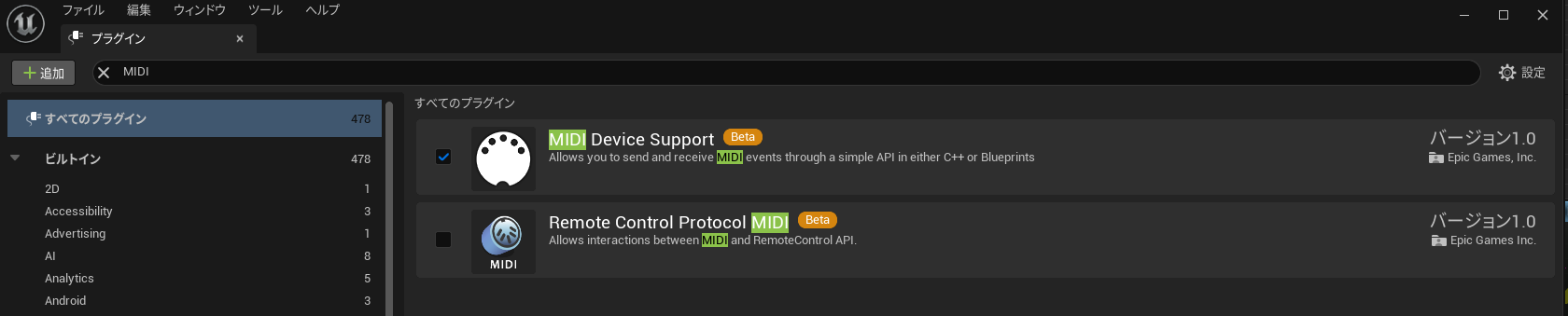

プラグインの、MIDI Device Supportをアクティブにします。繰り返しになりますが、Betaプラグインですので、ノンゲーム領域で比較的融通が効く環境で使用することを推奨します。

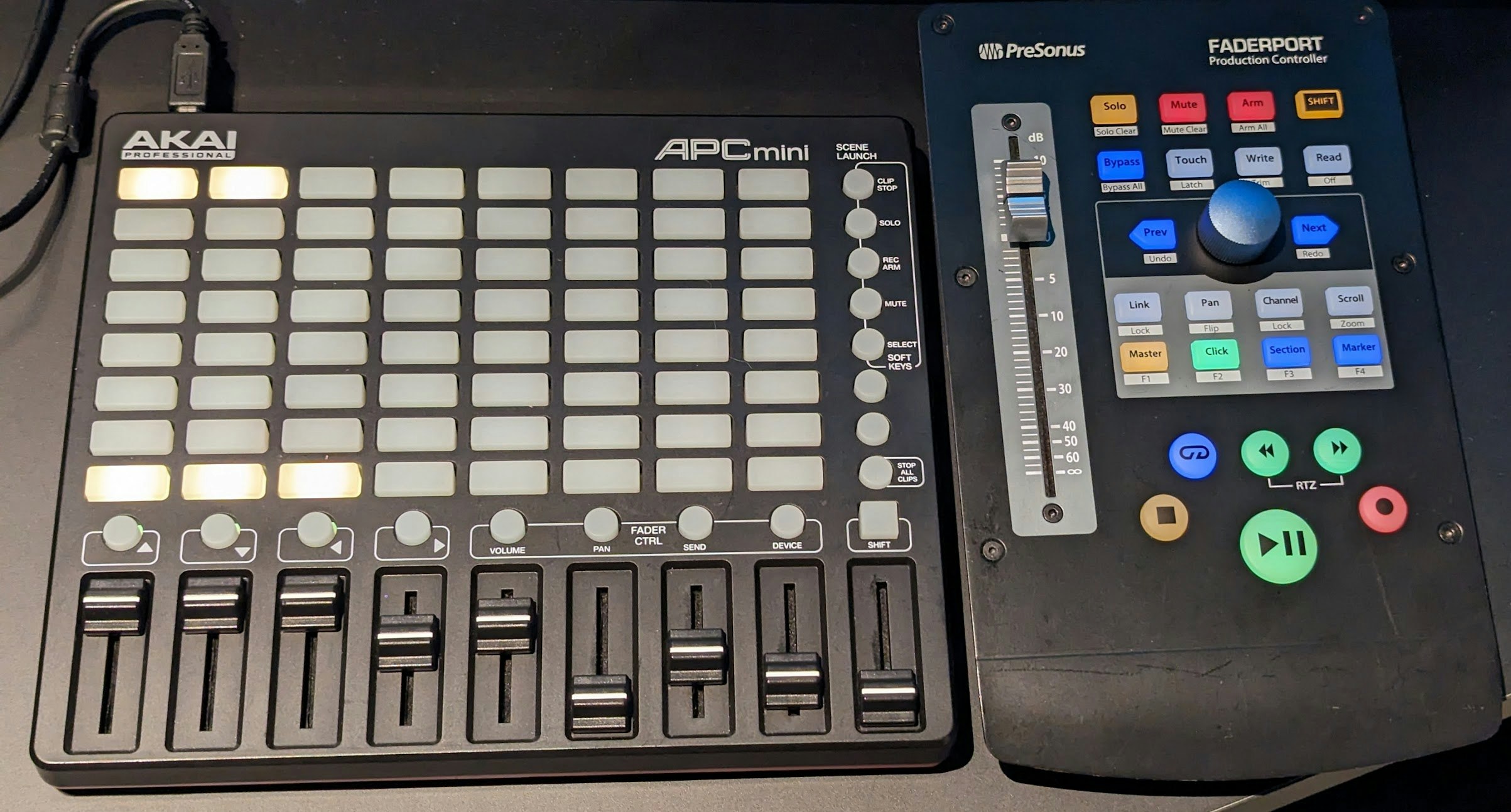

使用したMIDIデバイス

今回、使用するMIDIデバイスは「AKAI APC mini」(左)と「PreSonus FADERPORT2」(右)です。APC miniは、マトリックス状にパッド(ボタン)が並んでいるのが特徴で、FADERPORT2は、フェーダー(スライダー)が、モーター駆動のムービング・フェーダーになっているのが特徴です。

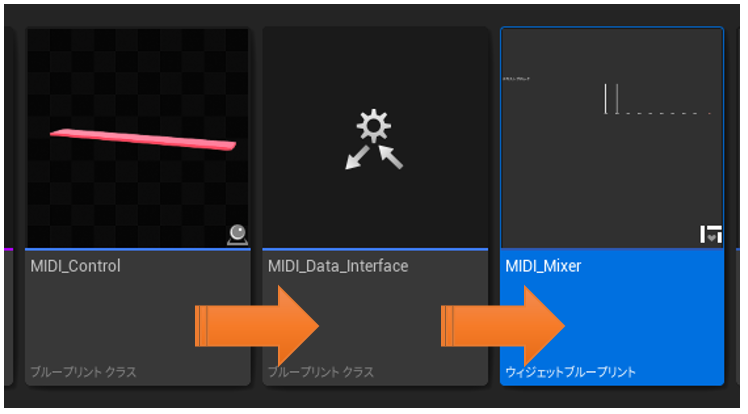

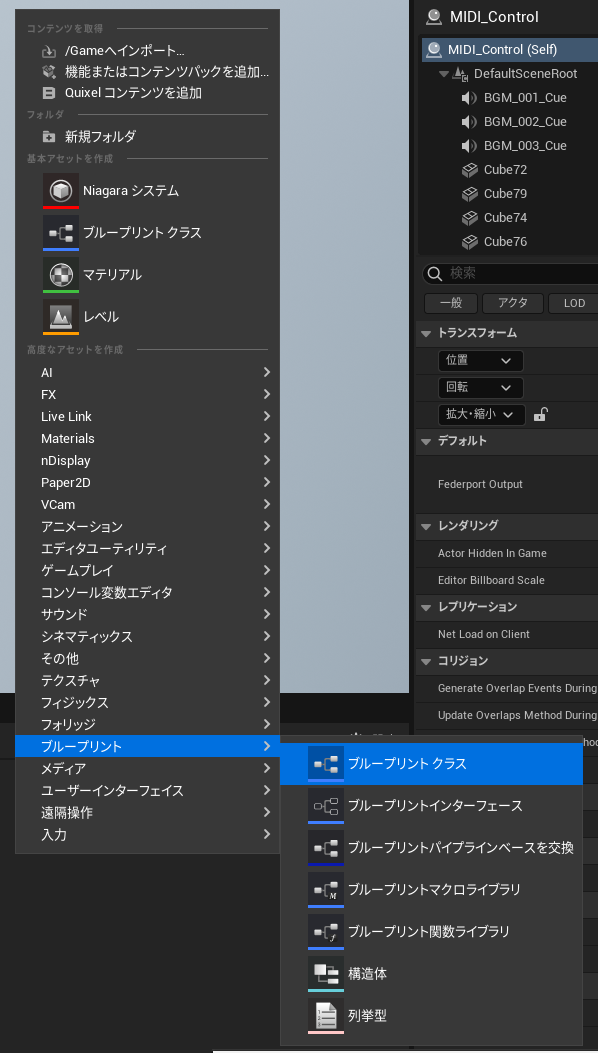

Blueprintクラスの作成と、レベルへの配置

移植性なども考えてBlueprintクラスを新規作成して実装していきます。名前は任意ですが「MIDI_Control」という名前にしました。

PCに接続されているMIDI機器の状況を確認する

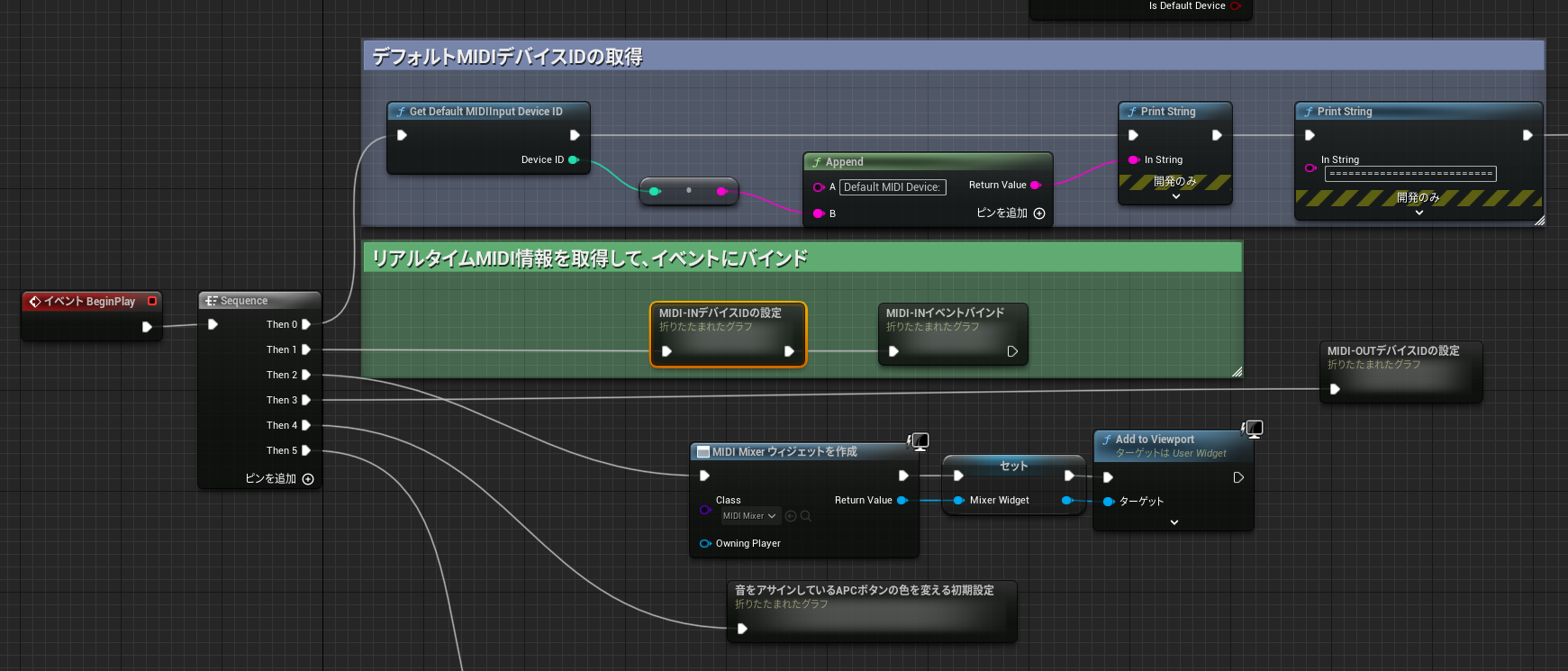

セットアップで作った「MIDI_Control」に、Blueprintで実装していきます。

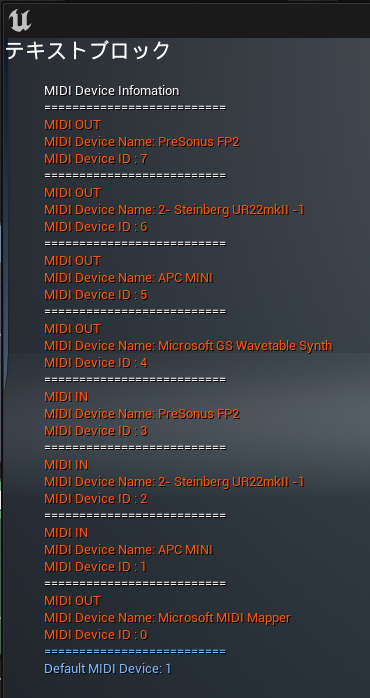

まず状況を把握するために、Print Stringを使ってMIDIデバイスの情報を確認したいと思います。パソコンには、「AKAI APC mini」「PreSonus FADERPORT2」に加えて、MIDI入出力機能を備えたオーディオ・インターフェイス「Steinberg UR-22mk2」の3つのMIDIデバイスが接続されています。今回UR-22mk2は使用しません。

Blueprintを使って下記のようなDebug表示を実装していきたいと思います。

MIDIデバイス情報をBlueprintで表示する

これらの表示はPrint Stringを使った、とても簡単な実装になっています。

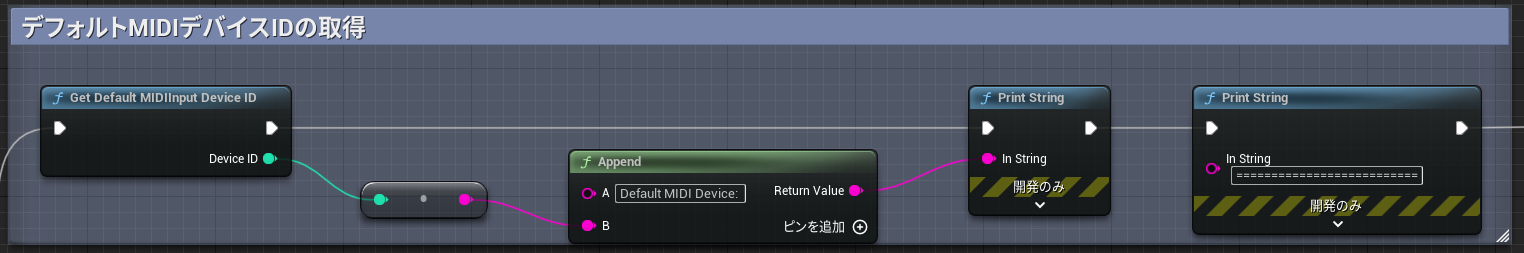

下記は「Get Default MIDI Input Device ID」ノードを使って、デフォルトMIDIデバイスのIDを表示しています。

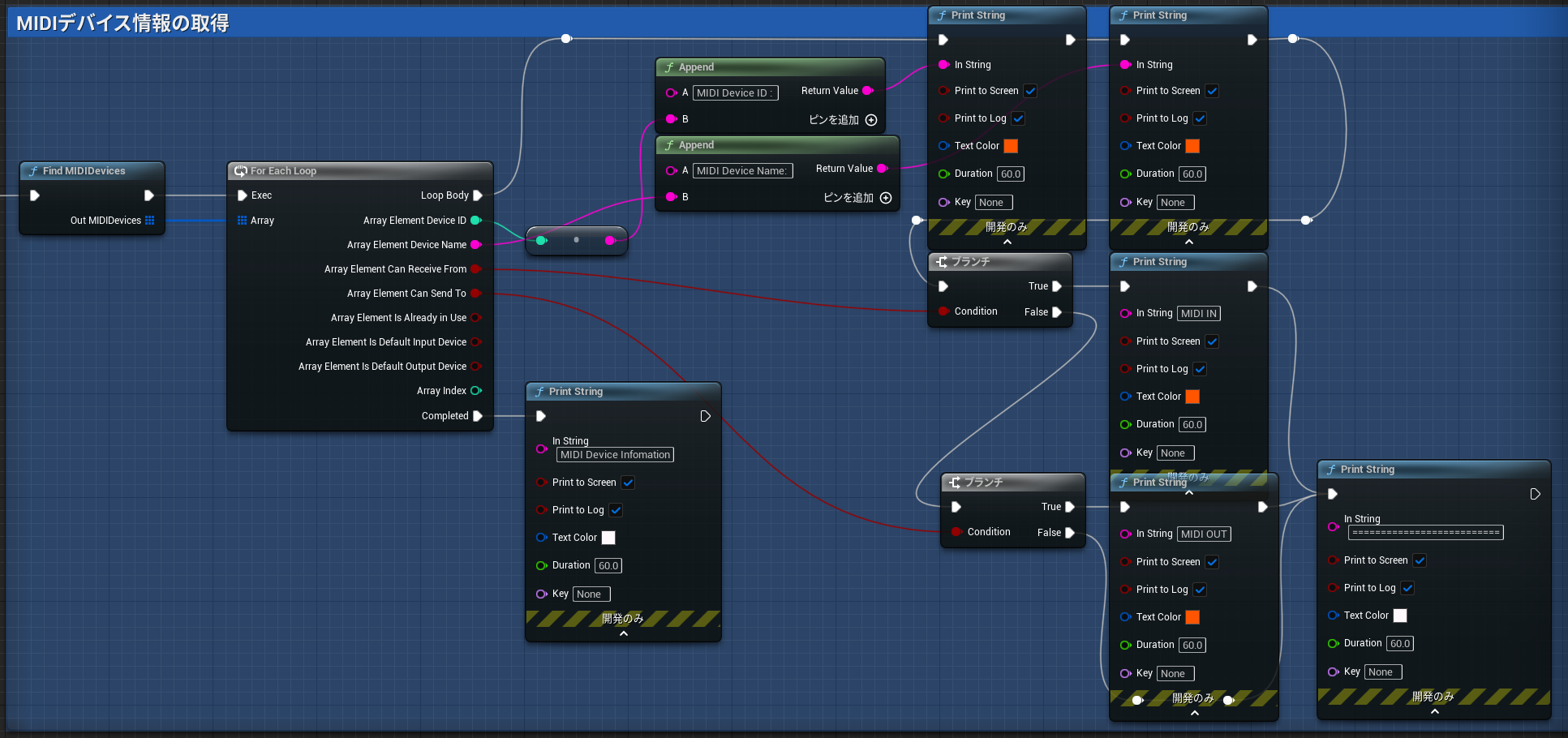

次に接続されているすべてのMIDIデバイスの情報を表示します。「Find MIDI Device」を使います。「Find MIDI Device」は構造体になっているので、「For Each Loop」を使って要素を取り出しつつ、順番にPrint Stringを使って表示することにしました。

MIDIデバイスは、MIDI Input、MIDI Outputで異なるDevice IDが割り振られるようです。「Array Element Can Receive From」と「Array Element Can Send To」のBool値で、そのMIDI Device IDがINとして使えるか、OUTとして使えるかを判別することができます。Receiveじゃないってことは、Sendであると言えそうですが、ここでは念のために両方の値を参照してブランチしています。

これで、どのDevice IDがどのMIDI機材か、またInかOutかということがわかりました。このDebug表示するフロー自体は必須ではありませんが、状況を確認できるので実装してみました。

MIDIデバイスを変数に格納

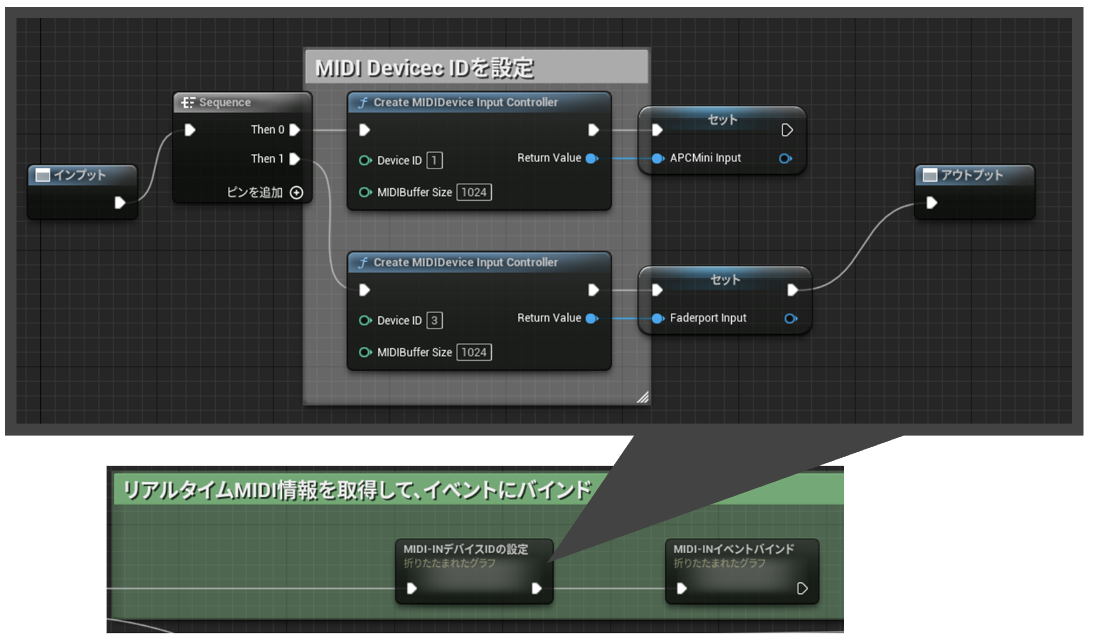

では、「AKAI APC Mini」と「Faderport」をUnrealで使えるようにしていきたいと思います。その為には、各MIDIデバイス用のObject変数を作成します。先ほど調べたDevice IDを使います。

MIDI Inputの設定

「Create MIDIDevice Input Controller」ノードの、Deveice ID項目に先ほど調べた番号を入力します。

TIPS

Blueprintではノードを折りたたむことができます。折りたたむ、マクロ化、関数化というのもありますが、今回は単に見た目をすっきりさせたいという理由で折りたたんでいます。

⇒ https://docs.unrealengine.com/4.27/ja/ProgrammingAndScripting/Blueprints/BP_HowTo/CollapsingGraphs/

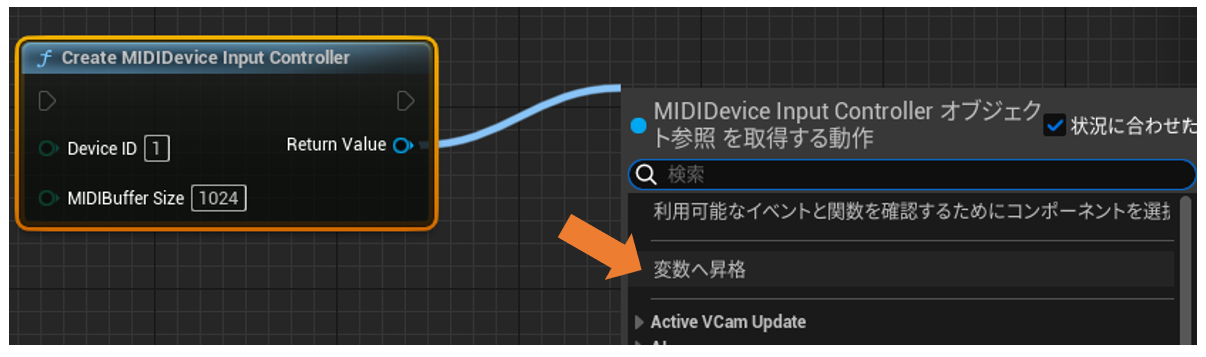

変数は「Create MIDIDevice Input Controller」のReturnValueから線を引っ張ってきて、変数へ昇格させます。

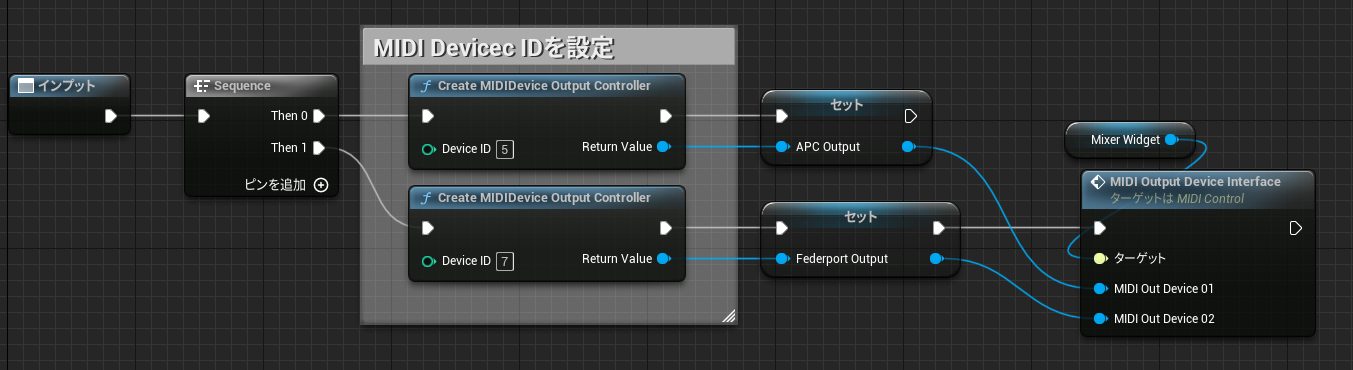

MIDI Outputの設定

Inputと同じですが、Outputは「Create MIDIDevice Output Controller」を使用します。

補足

一旦、ここでは上記のスクリーンショットにある「MIDIOutput Device Interface」は無視してください。後述する「Blueprint Interfaceについて」で軽く触れます。

MIDI信号を、イベントにバインドする

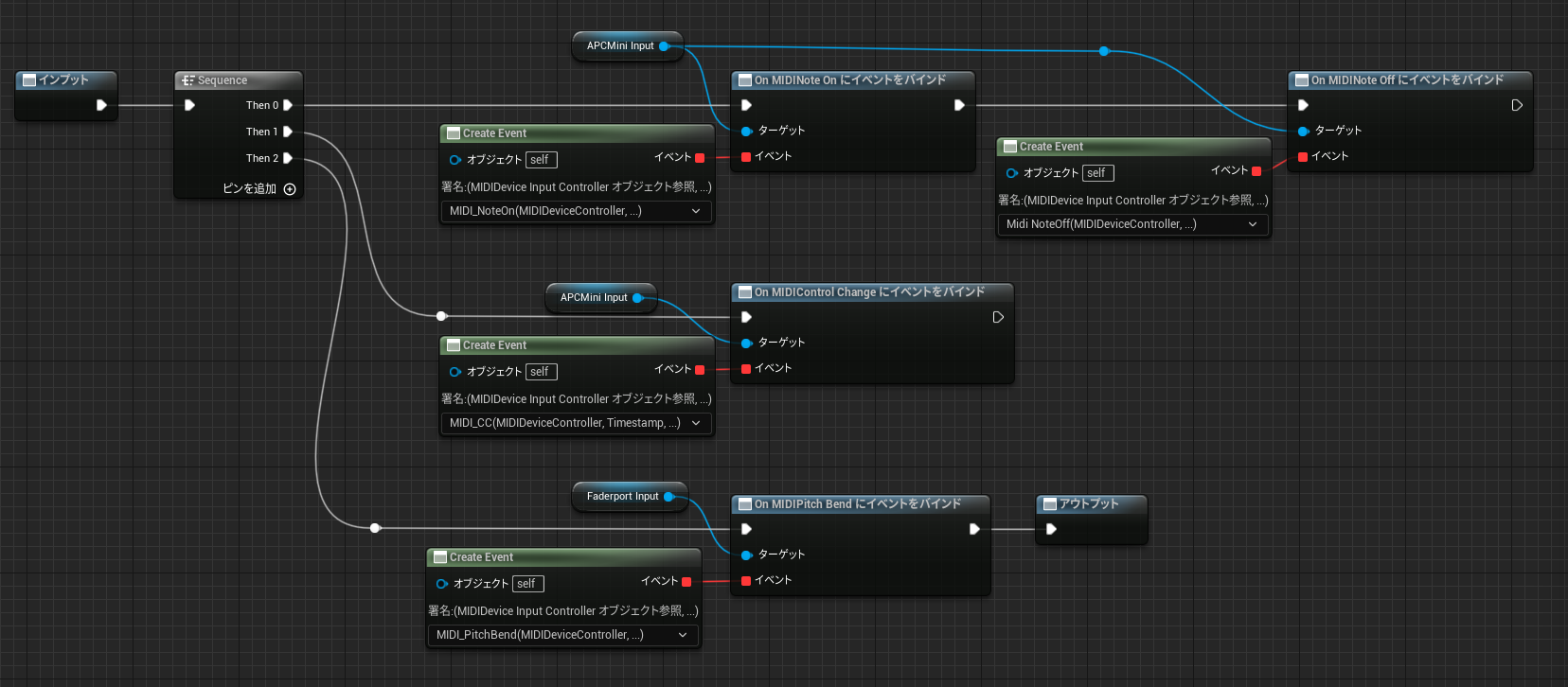

MIDIデバイスから、MIDI信号が来た時にイベントが実行されるようにバインドします。ここではMIDI信号の仕様やフォーマットについては割愛します1。今回、使用するAPC miniでは、パッド部分がNote情報、スライダー部分はControl Change(略してCCと良く言われます)を使っています。

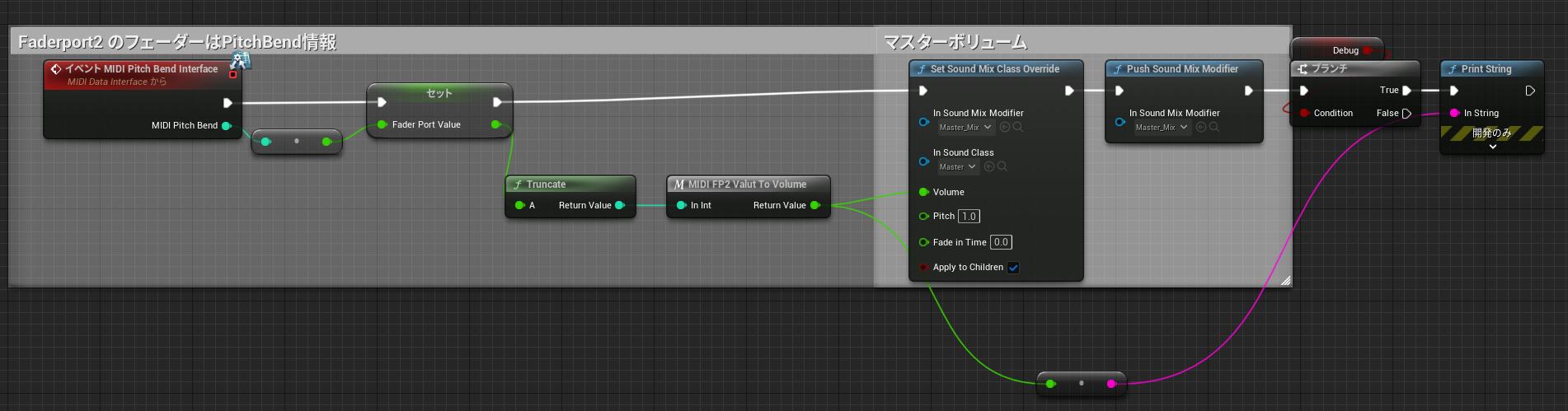

Faderportは、Pitch Bend情報を使用しています。CCが8bitで0-127の128段階しか扱えないのに対して、Pitch Bendはより細かく音程を滑らかに表現できるように、2バイトの情報になっており-8,192~8,191の16,384段階扱うことができます。Faderportは、これを実際にはピッチ(音程)ではなく音量制御で利用しています。

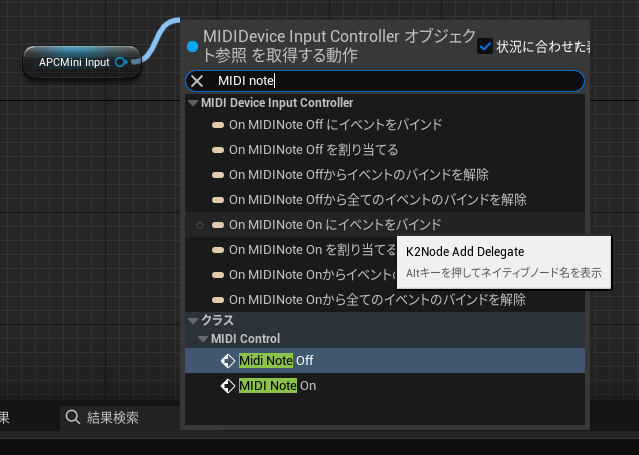

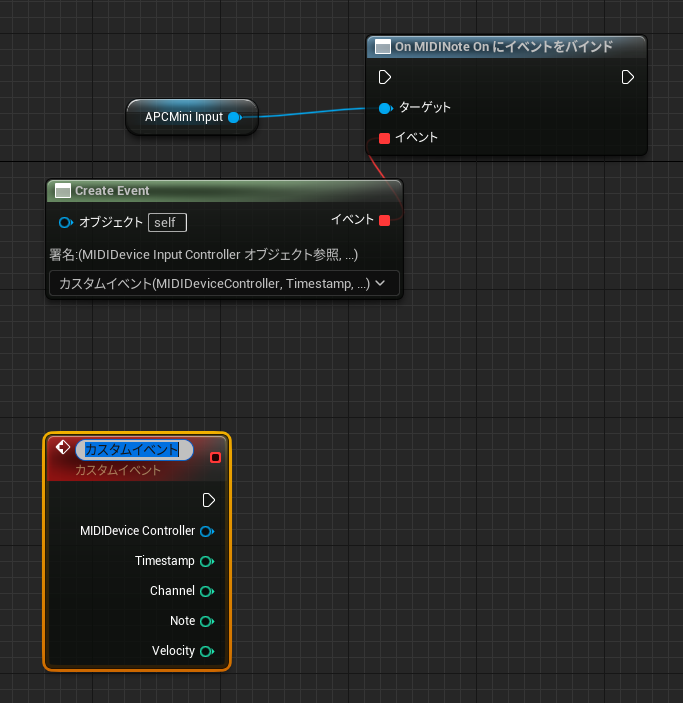

イベントをバインドする

前の工程で作ったMIDIデバイスの変数を配置し、そこから線を引っ張ってきて「On MIDINote onにイベントをバインド」を選択します。ちなみに、カスタムイベントを即座に作って直接結びたいときは、「On MIDINote onを割り当てる」を選択すると、カスタムイベントも同時に作成されます。処理の違いまでは判らないのですが、今回は「On MIDINote onにイベントをバインド」の方法でやりたいと思います。

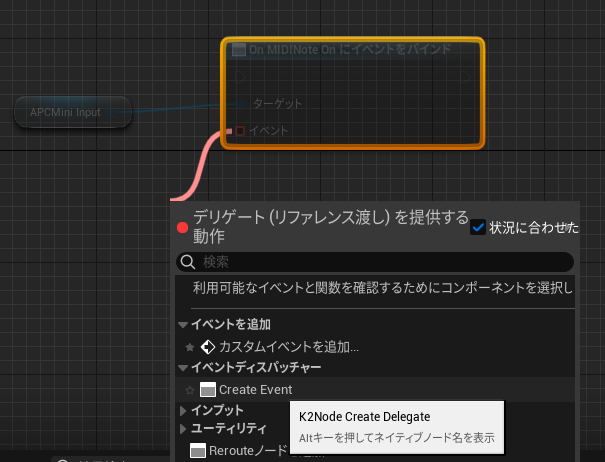

赤い四角の□イベントコネクタから線を引っ張ってきて、「Create Event」を選択します。

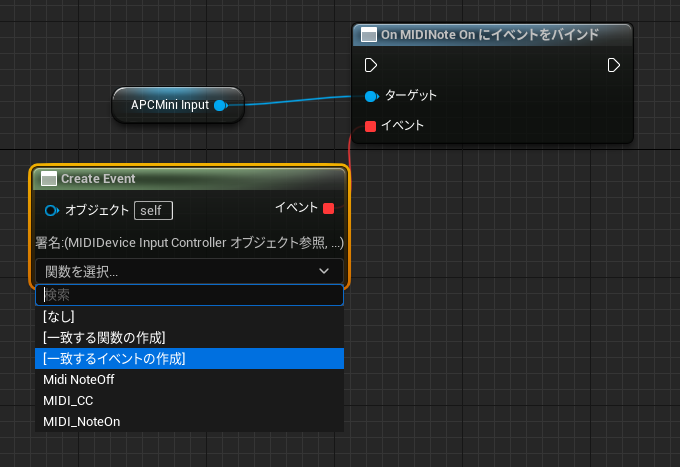

次にCreate Eventから「一致するイベントの作成」を行います。

するとカスタムイベントが作成されます。このカスタムイベントからはTimestamp、Channel、Note、Velocityの項目があります、カスタムイベントの名前は任意で付けることができます。今回は、わかりやすく「MIDI_APC_NoteOn」にしています。

これで、MIDIデバイスからNote On信号が来たときにカスタムイベントが実行されます。

TIPS

ちなみにVelocityは速度をイメージしますが、音楽制作では打鍵した時の強弱を意味します。鍵盤が押し込まれる速度を、鍵盤を打鍵する時の強弱情報として扱っていると捉えていただければと思います。

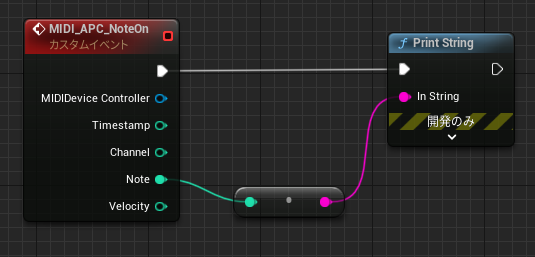

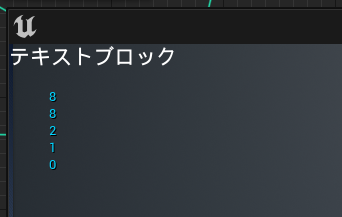

確認

確認のために、下記のようなシンプルなBlueprintを実装してみます。APCのパッドを叩くと、Noteナンバーを表示するという実装です。

ここまでできれば、あとはこれを応用して様々なことができます。UE5でMIDIデバイスを使えるようにする方法は以上となります。UE4.27でも全く同じ方法で可能です。

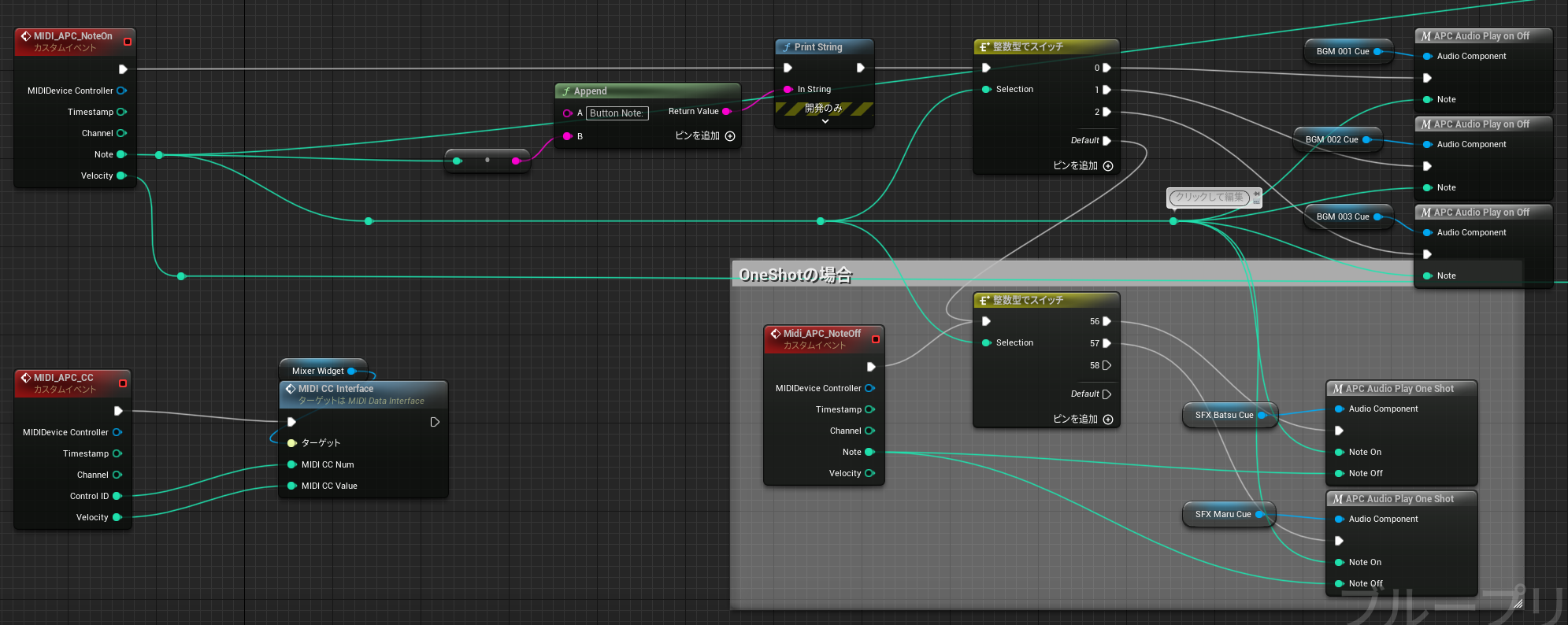

Appendix. 使用例

使用例として、効果音やBGMを再生したり、音量を変更したりすることが出来ます。また、Unreal Engine側からMIDI信号をMIDIデバイス側に送ることも可能なので、パッドの光やムービングフェーダーといった、フィジカル・コントローラー側をUnreal Engine側から制御することも可能です。

下記の動画はその一例です。

概要

Noteの値は整数なので、「整数でスイッチ」ノードを使って音を鳴らし分けています。ちなみに下記の「APC Audio PlayOnOff」と「APC Audio PlayOneShot」はマクロで、APCMiniの音の制御と、パネルの光り方の処理をマクロ化したものです。再生したいSound Cueと、Note On/Offの値を入力してやると動作するように実装にしてます。

Note Offはパッド(鍵盤2)から指を離した時に送られるMIDI信号なので、パッドを押してる間は緑に、ボタンを離すと元の黄色に戻るといった制御が可能です3。これらを使って、BGMのように一度押すと再生を開始し、もう一度押すと再生を停止するタイプと、効果音のように押したら1回だけ再生、または押してる間だけ再生されるといった、オルタネイト(ラッチ)/モーメンタリ(アンラッチ)制御が可能です。

Blueprint Interfaceについて

「MIDI CC Interface」というノードがありますが、こちらは元から用意されておらず、Unreal EngineのBlueprint Interfaceを使っています。名前も私が適当に付けたものです。

このBlueprint Interfaceを使うと、別のBlueprintと値のやり取りができます。今回は、ミキサーのようなスライダーを実装した「MIDI_Mixer」というWidget Blueprint(UMG)に、MIDI信号を渡しています。「MIDI_Mixer」も、私が適当につけた名前です。

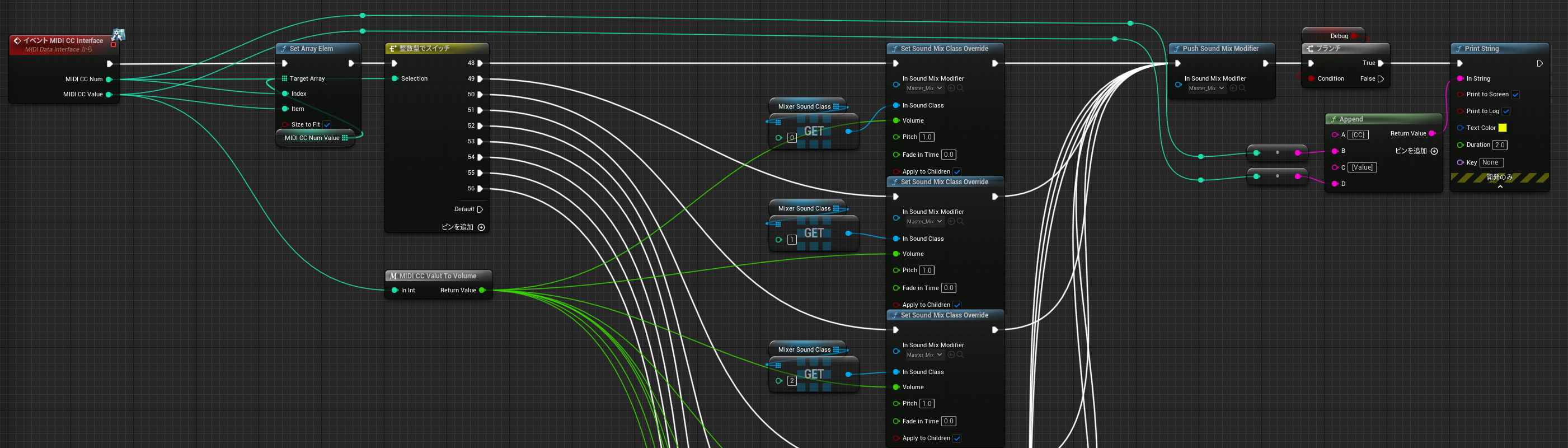

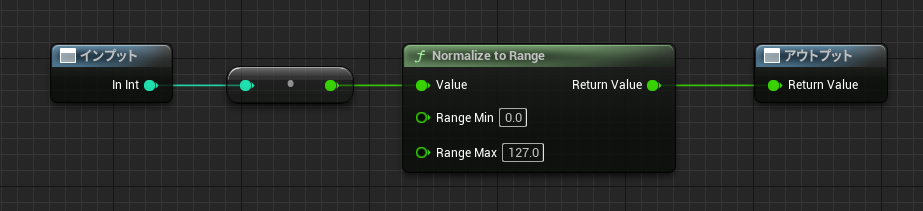

MIDI_Mixer(Widget Blueprint)で実装しているボリューム制御

「MIDI_Mixer」に渡されたControl Changeの値は、Sound Mix Class でボリュームを制御しています。また同じ値を使用してUMGのスライダーの値も更新しています。

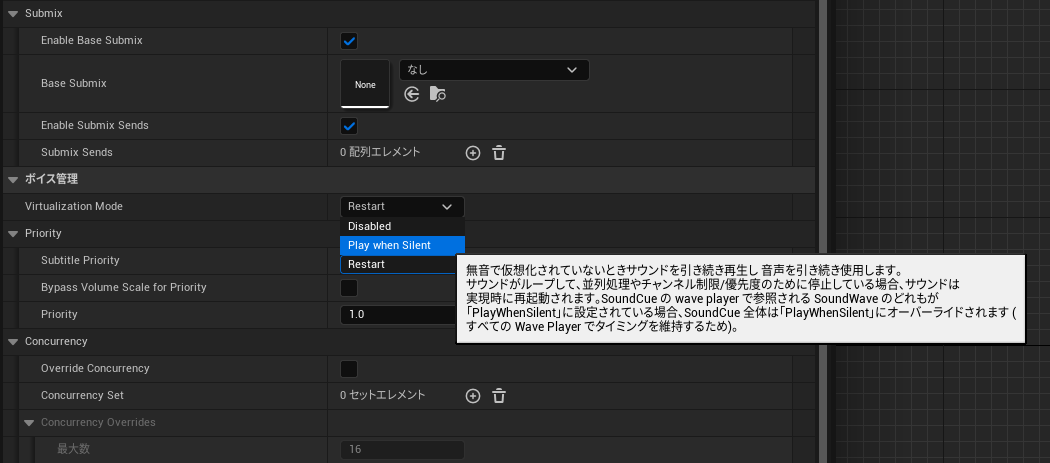

TIPS

Unreal EngineではVolumeを完全にゼロにすると再生中の音を停止してしまいます。何が起こるかというと、フェーダーを下げきると再生されていた音が停止され、再びフェーダーを上げてもBGMが聞こえてきません。音量をゼロにしても流れ続けてほしい場合は、Sound Cueのボイス管理の設定で「Play when Silent」に変更しておきます。

さいごに

MIDI信号は、Unreal Engineに入った段階で音に関するものだけでなく、如何様にも活用できます。例えばVirtual Productionでスライドを切り替えたり、ギミックを発動させたりと用途は様々です。現在、私はキーボード・ショートカットとStream Deckを駆使していますが、MIDIデバイスはNoteやChannel4といった整数であれやこれやとフローに落とし込んで扱えるのが、一つ面白いところかなと思います。

1982年に誕生したMIDIは、そもそも異なる楽器同士を繋いで演奏するためのに作られたプロトコルで、良い意味で枯れた技術です。ユニークなMIDI入力デバイスも多数あります。これらを使って、音楽や演奏に合わせたリニアな表現や、インタラクティブな表現も手軽試すことが出来ると思います。単に機能性だけでなく、なにかおもしろい事に使えないかなーってな感じで遊んでみるのもよいのではないでしょうか。

今回は割愛しましたが、特定のオブジェクト制御するにはRemote Control機能を使うともっと簡単に実装できます。それは、また機会があれば書いてみたいと思います。

-

M I D I 1.0 規格書 - 音楽電子事業協会

https://amei.or.jp/midistandardcommittee/MIDI1.0.pdf ↩ -

APCminiは打楽器の演奏に向いたパッド型のMIDIデバイスですが、最も一般的なMIDIデバイスはMIDIキーボードです。そして、Note情報は鍵盤のド・ド♯、レ、レ♯、ミ、ファ……といった感じに、音階を整数で示したものになります。 ↩

-

製品ごとのMIDI信号の扱いは、製品マニュアルの巻末に記載されている場合が多く、一般には「MIDIマッピング」と呼ばれます。ですが、AKAI APCminiはAbleton Liveという音楽制作ソフトとセットで使用する前提のMIDIデバイスなせいか、既に公式サイトからはMIDIマッピング情報が入手できません。「AKAI APC MIDI Mapping」でGoogleやYouTubeを検索すると見つかると思います。 ↩

-

MIDIはChannelが、16 Channelあります。16 Channelを扱えるMIDIデバイスのことを「マルチティンバー」と呼んだりします。マルチティンバー音源は1台で16種類の楽器を個別に扱えます。例えば、Channel 1にはピアノ、Channel 2はギター、Channel 3はベースといった感じで使えます。 ↩