Level4.機械学習講座(理論と実践)

4-7.サポートベクターマシン(SVM)

4-7-1.サポートベクターマシンとは

●2クラス分類のための機械学習手法

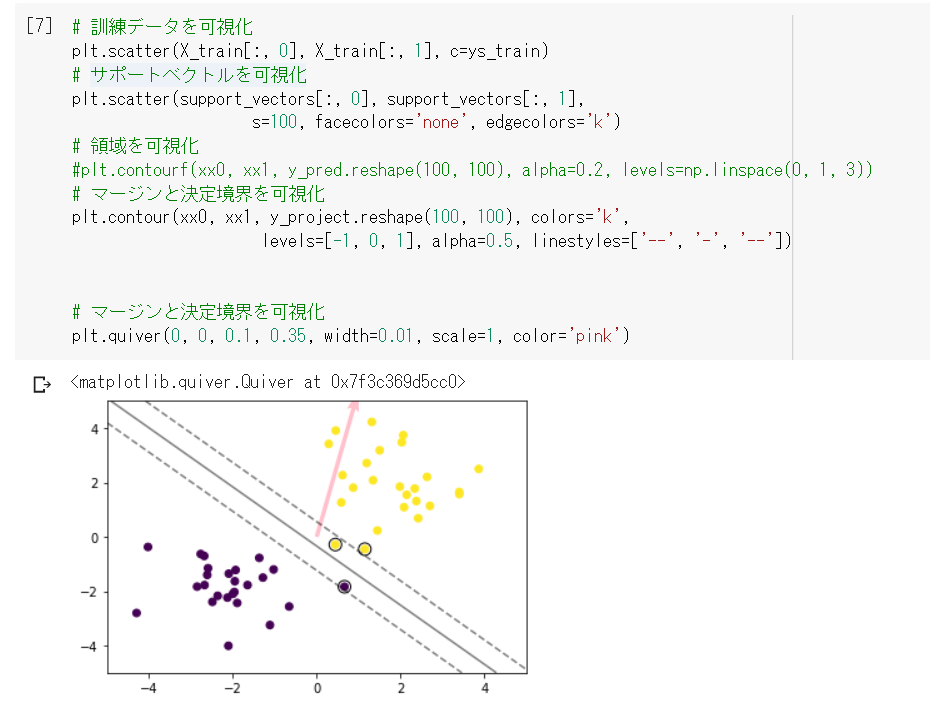

●線形判別関数と最も近いデータ点の距離を“マージン”と呼ぶ。

マージンが最大となる線形判別関数を求める。

●サポートベクター

分離超平面を構成する学習データは、サポートベクターだけで残りのデータは不要である。

●ソフトマージンSVM

サンプルを分離できない時、誤差を許容し、誤差に対してペナルティを与える。

線形分離できない場合でも対応し、パラメータCの大小で決定境界が変化する。

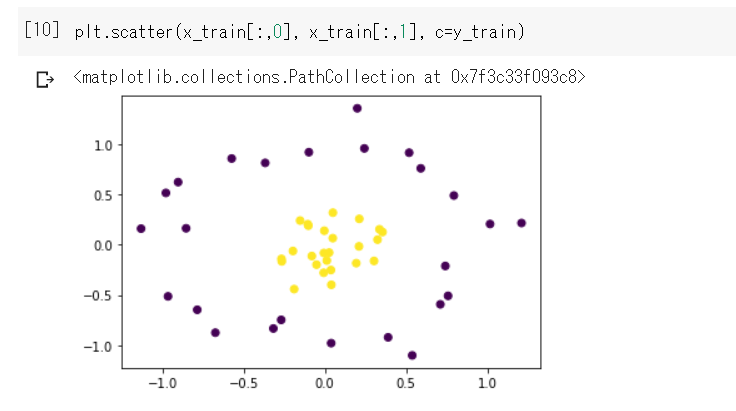

●非線形分離

線形分離できない時、特徴空間に写像し、その空間で線形分離する。

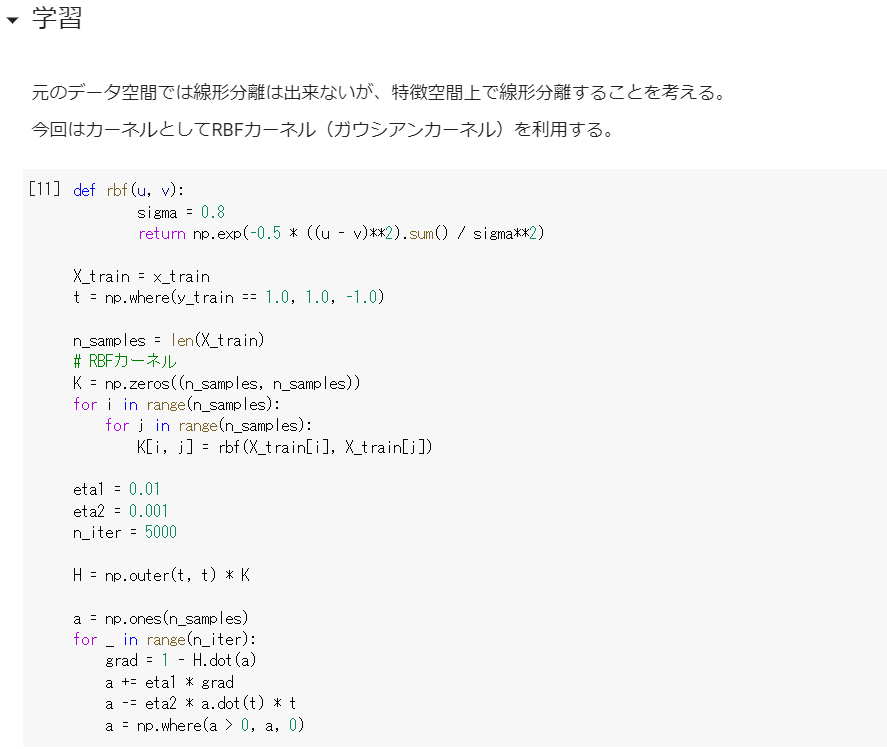

●カーネルトリック

高次元ベクトルの内積をスカラーで表現する。

特徴区間が高次元でも計算コストを抑えられる。

※目的関数の導出などは、別途、復習して知識を養っておく必要がある。(今後の目標)

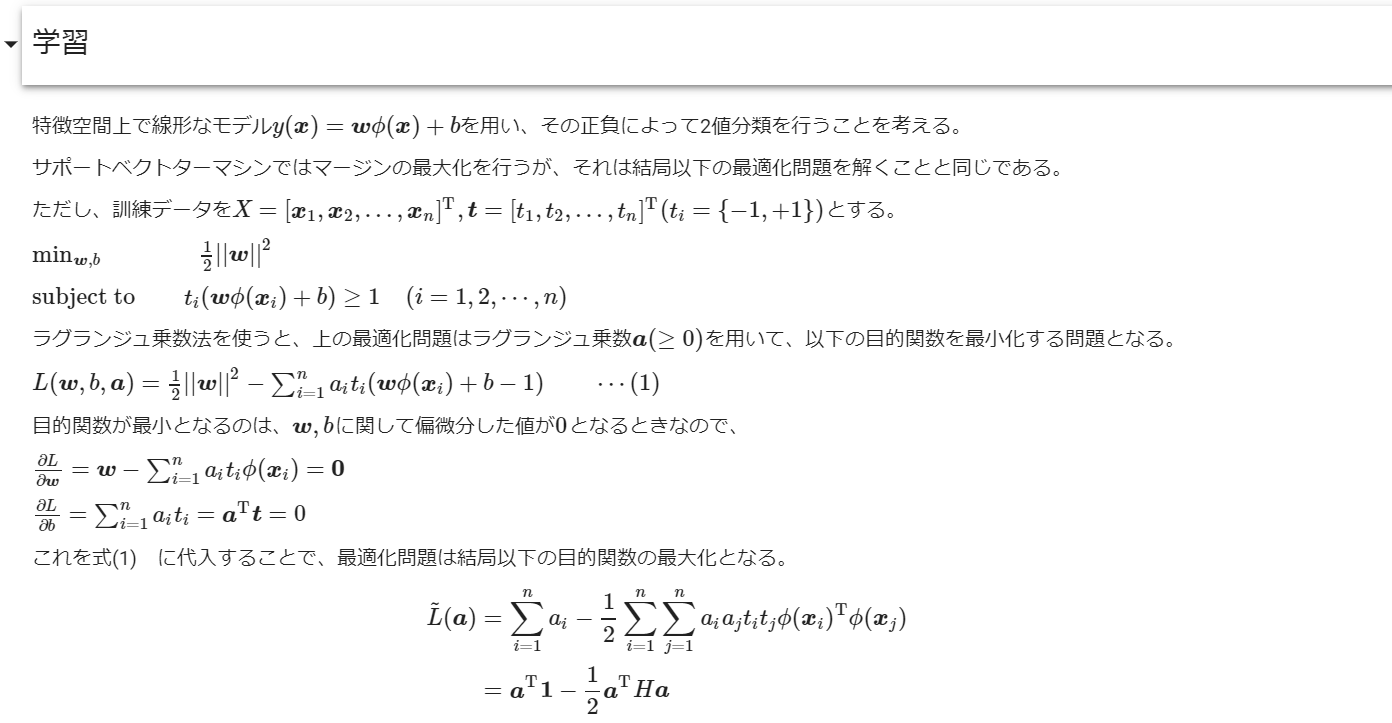

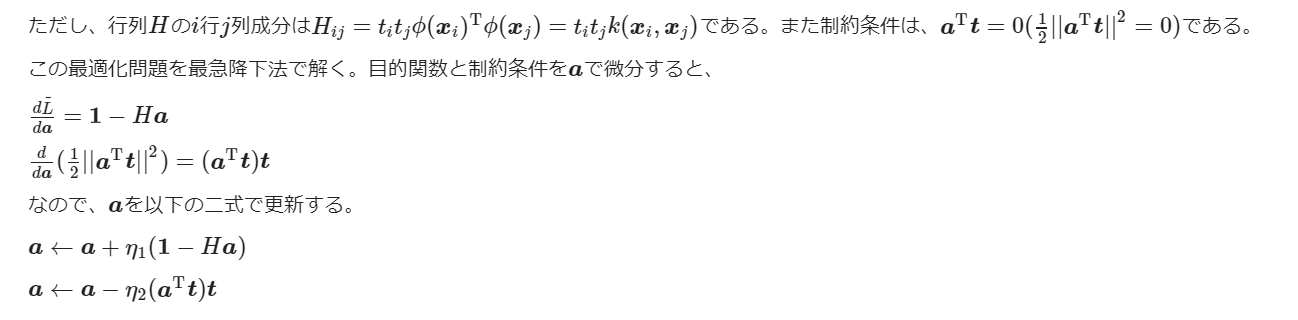

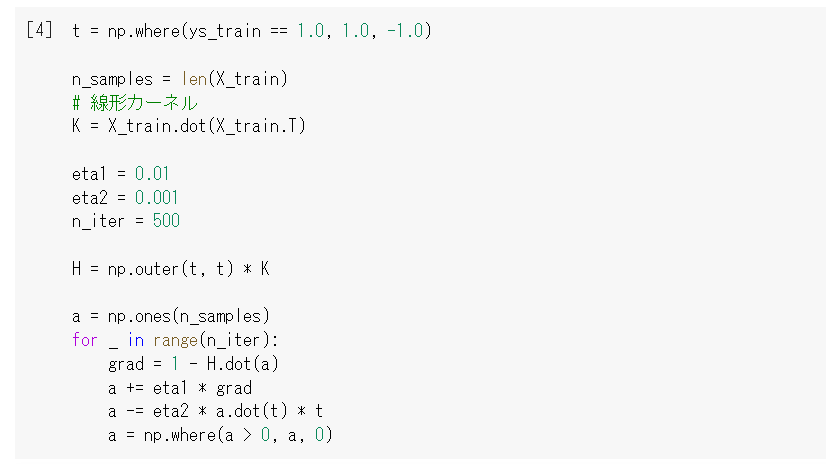

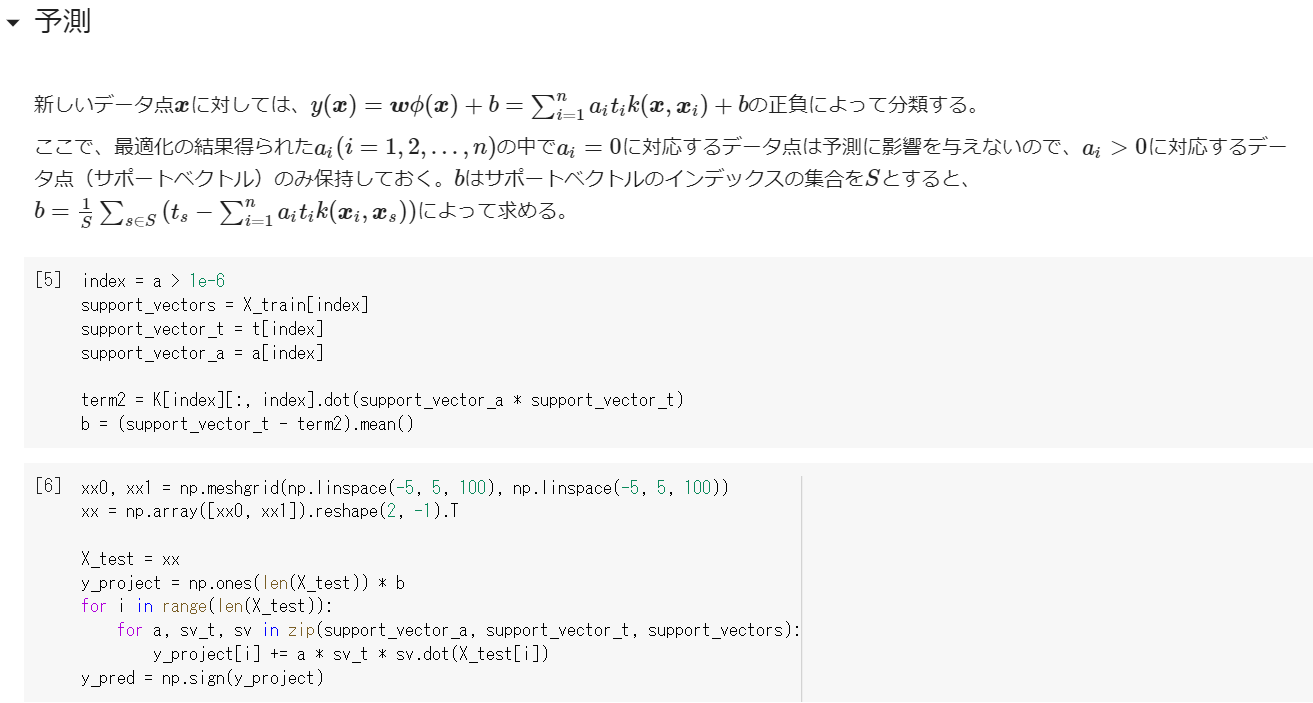

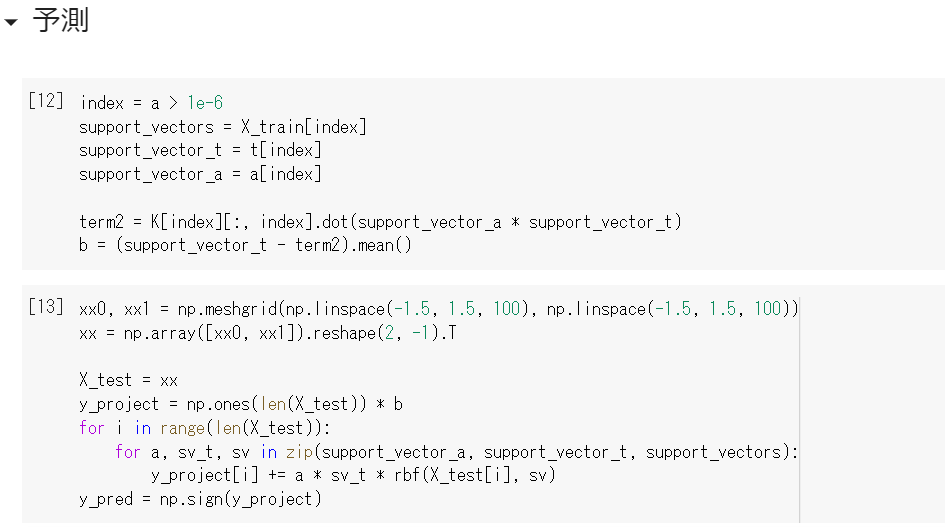

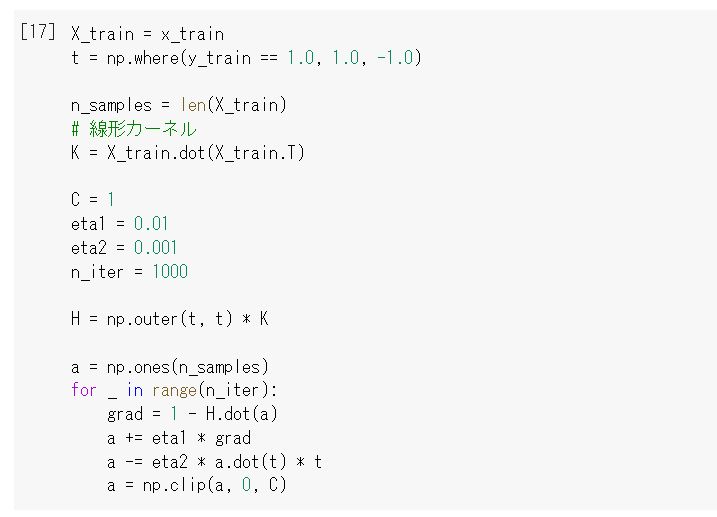

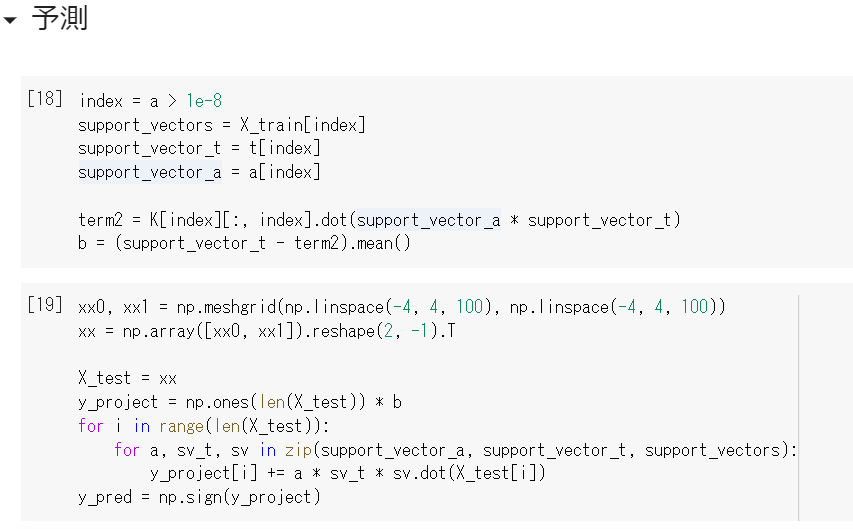

4-7-2.ハンズオン

サンプルコードをもとにして、実行して確認してみる。

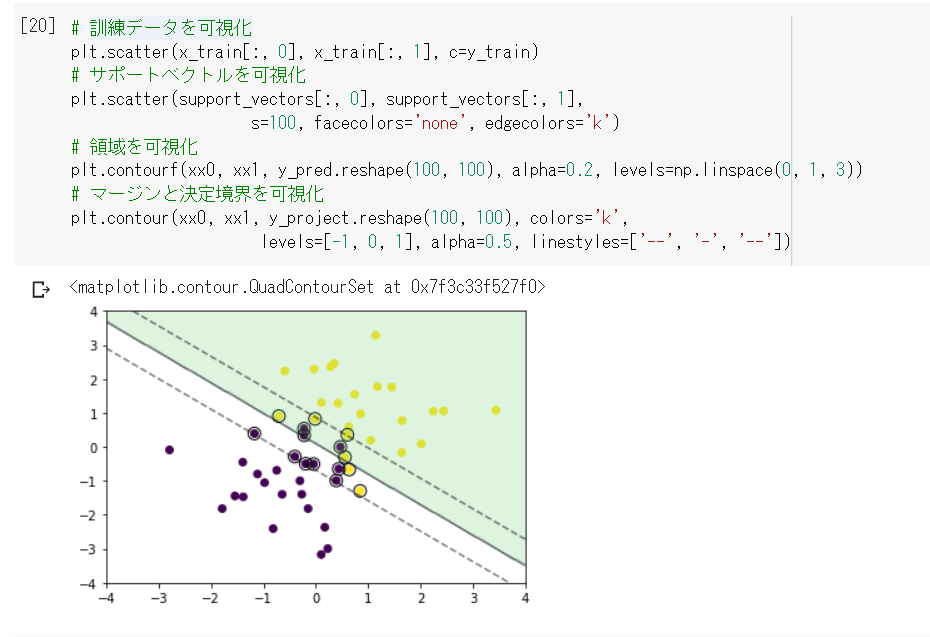

4-7-3.考察

マージンの考え方や、決定境界を可視化するやり方は、

誰かに説明をする時に理解してもらい易いだろうなと感じた。

サポートベクターマシンの・・・と言うと良く分からない人には難しく感じる。

誤分類の許容や、マージンとペナルティを与える適切な関係性など、

お試しでやってみようと思う。