概要

Unityで平面検出をしたら、俄然「バーチャル空間に現実のオブジェクトを表示し、位置・動きを同期させる」方法が気になりました。

そこで、現実のオブジェクトを検出するマーカーとしてオブジェクトそのものと2D画像の両者を比較するため、AR Tracked Object ManagerとAR Tracked Image Managerを試しました。

環境・ツール等

マシン

- Mac mini 2023 (チップ:Apple M2 Pro, OS: Sonoma 14.6.1)

- iPhone 14 (iOS: バージョン 18.0)

ツール

- Unity 2022.3.47f1

- AR Foundation 5.1.5

- Apple ARKit XR Plugin 5.1.5

- OpenXR Plugin 1.12.0

- XCode 16.0

アプリ作成手順

基本設定

-

以下の記事の「アプリ作成手順 1.Unityプロジェクトのセットアップ〜2.必要なパッケージのインストール」までを順に実行します

平面を検出してオブジェクトを置けるARアプリをUnityで作る -

XR Originのセットアップ

- デフォルトでシーンに追加されている「Main Camera」「Directional Light」を削除(画面左上の「Hierarchy」メニュー内に並んでいます)

- 「GameObject > XR > XR Origin (AR)」を選択してシーンに追加

- 「GameObject > XR > AR Session」を選択してシーンに追加

対象オブジェクトをスキャンする

- 以下のページからAR Kitの3Dスキャナープロジェクトをダウンロードします

Scanning and detecting 3D objects | Apple Developer Documentation - ダウンロードしたzipファイルを適当なディレクトリで解凍し、「ScanningApp.xcodeproj」をダブルクリックしてXcodeを開きます

- サイドバーでScannerAppを選択し、「Sigining & Capabilities」タブで「Automatically manage sigining」にチェックし、Teamに開発者アカウントを選択します

画面上部(赤枠)で自分のiPhoneを選択し、再生ボタン(赤枠)を押下して、自分のiPhoneにスキャナーアプリをダウンロードします

- スキャナーアプリを使って、対象のオブジェクトをスキャンします

参考:【ARKit】3Dオブジェクトをマーカーにする - おもちゃラボ - スキャンし終わったら「Share」ボタンでiPhoneローカル上にarobjectファイルを書き出し、その後AirDropでPCに転送します

AR Object Trackを試す

-

HierarchyビューでXR Originを選択し、Inspectorビューの「Add Component」から「AR Tracked Object Manager」を選択します

-

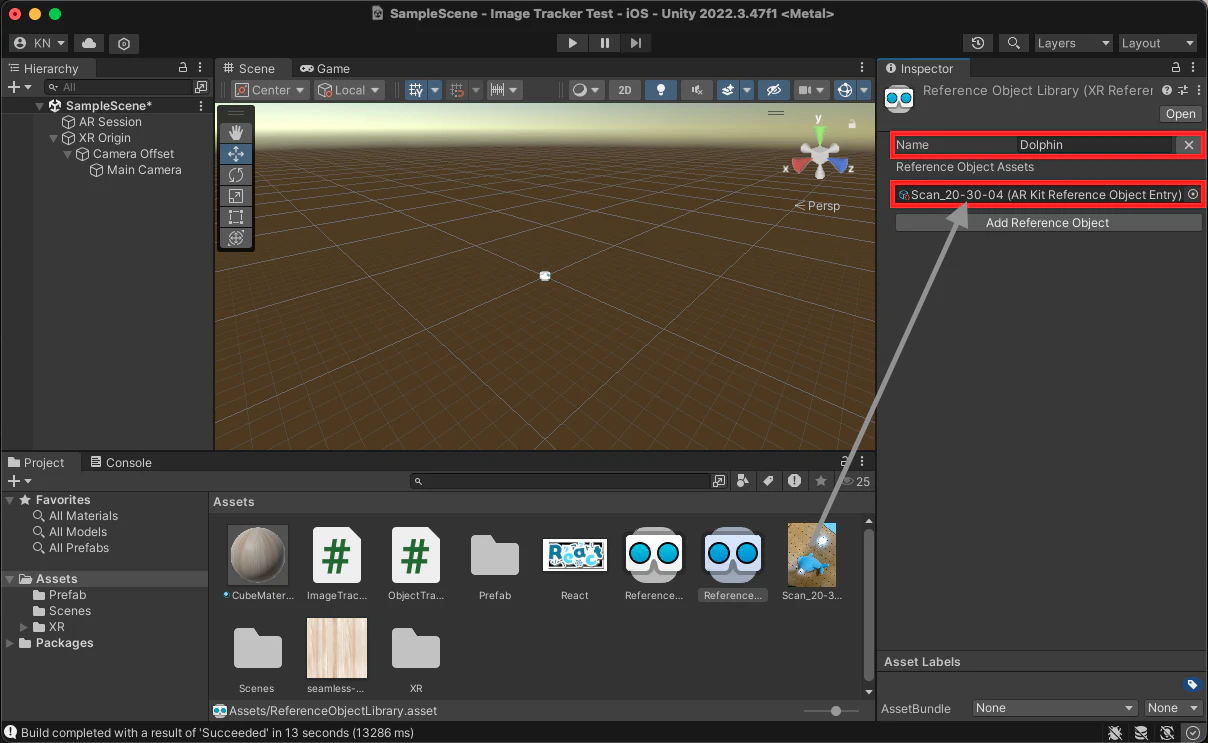

「Project」ビューで右クリックし、「Create > XR > Reference Object Library」を選択します

-

「Project」ビューにスキャンしたオブジェクトのarobjectファイルをドラッグ&ドロップします

-

「Project」ビュー内の「Reference Object Library」を選択し、「Inspector」ビュー内の以下の項目を設定します

-

以下の記事の「アプリ作成手順 4.平面検出とオブジェクト配置」の手順3. ~ 6.に従ってCubeのプレハブを作ります

平面を検出してオブジェクトを置けるARアプリをUnityで作る -

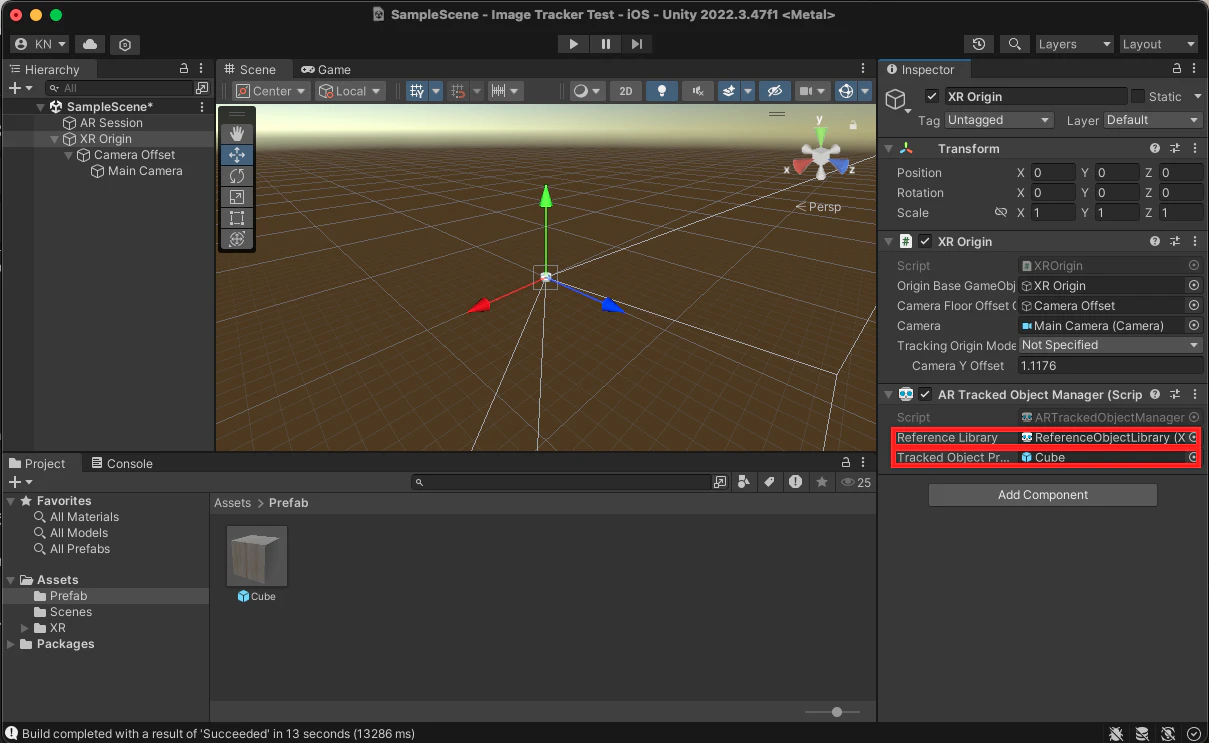

「Hierarchy」ビュー内の「XR Origin」を選択し、「Inspector」ビュー内の「AR Object Tracked Manager」の以下の項目を設定します

-

以下の記事の「アプリ作成手順 5.ビルド設定とiPhoneでの動作確認」に従ってビルドし、iPhoneを用いてテストする

平面を検出してオブジェクトを置けるARアプリをUnityで作る

AR Tracked Image Managerを試す

※横着なので、AR Tracked Object Managerの検証後、XR OriginからAR Tracked Object Managerを削除した状態から作成しました。

-

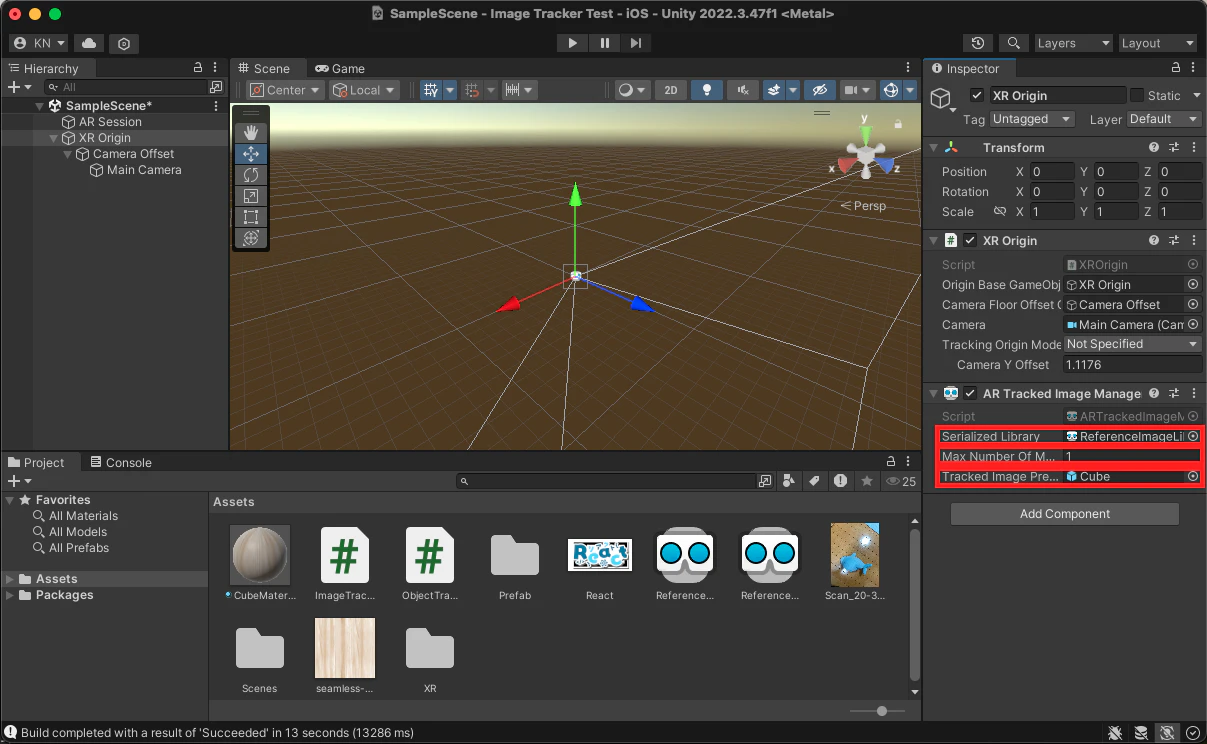

HierarchyビューでXR Originを選択し、Inspectorビューの「Add Component」から「AR Tracked Image Manager」を選択します

-

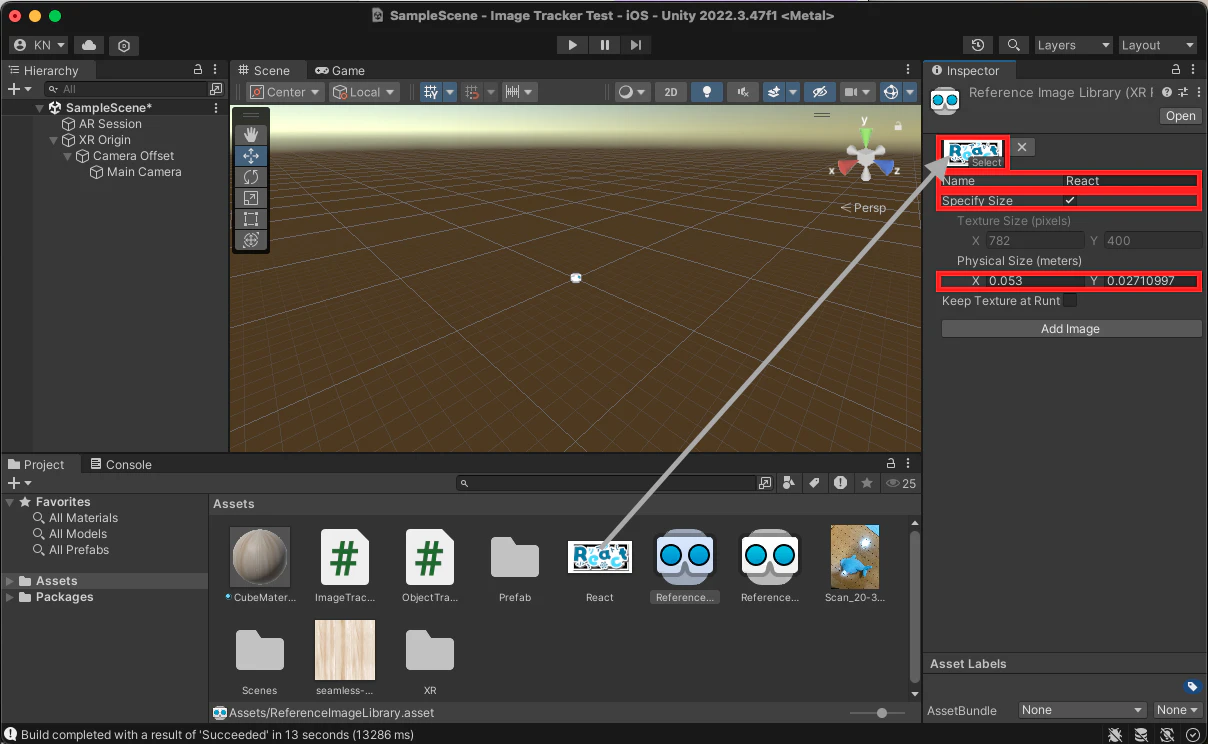

「Project」ビューで右クリックし、「Create > XR > Reference Image Library」を選択します

-

「Project」ビューに対象の2D画像ファイルをドラッグ&ドロップします

-

「Project」ビュー内の「Reference Object Library」を選択し、「Inspector」ビューの「Name」に適当な名前を、「Specify Size」にチェックを入れ、「Physical Size (meters)」に印刷後の画像の大きさをメートル単位で設定します

-

以下の記事の「アプリ作成手順 4.平面検出とオブジェクト配置」の手順3. ~ 6.に従ってCubeのプレハブを作ります

平面を検出してオブジェクトを置けるARアプリをUnityで作る -

「Hierarchy」ビュー内の「XR Origin」を選択し、「Inspector」ビュー内の「AR Object Tracked Manager」の以下の項目を設定する

-

以下の記事の「アプリ作成手順 5.ビルド設定とiPhoneでの動作確認」に従ってビルドし、iPhoneを用いてテストする

平面を検出してオブジェクトを置けるARアプリをUnityで作る

検証

AR Tracked Object Manager

今回検証に用いたのはイルカのぬいぐるみです(江ノ島水族館で買った思い出の品です)。

イルカのぬいぐるみを検知してCubeも追尾しますが、動きは遅いです。

また、大きく動かすとうまく追尾してくれません。

AR Tracked Image Manager

今回検証に用いた画像はさわらつきさんのKawaiiLogosの「React」です(ステッカーにさせていただき、iPhoneケースに入れて愛用しています)。

参考:GitHub - SAWARATSUKI/KawaiiLogos

では、このステッカーをグラスの底に貼ったら、追尾してくれるでしょうか?

グラスの動きはうまく追尾してくれません。

それならば、もっとステッカーがはっきりと見える、お菓子のトレーならどうでしょうか?(他にいいものはなかったのか...)

こちらはほぼラグなく追尾してくれました。

水平方向の動きだけではなく、上下の動きもしっかり追尾してくれます。

結論・感想

Apple ARKitの場合は、「バーチャル空間に現実のオブジェクトを表示し、位置・動きを同期させる」には、動かすもの(コップやスマホなど)の場合はAR Trakced Image Managerを用いた方が、よりリアルタイムな同期ができそうです。

しかし、検出できるオブジェクトは透明で、斜めから見ても画像が鮮明に、歪みなく見えている必要があり、すべてのオブジェクトを対象にできるわけではありません。

また、カメラに画像が見えなくなる角度ではオブジェクトを表示することができません。

ほぼ動かさないものの場合(机や置物など)の場合は、AR Tracked Object Managerを用いることで、幅広いケースでオブジェクトを検出することができそうです。

今回はバーチャル空間に表示するオブジェクトは、簡便に作れるCubeにしましたが、実際のオブジェクトをリアルに再現した3Dオブジェクトをプレハブ化して利用すれば、よりリアリティを感じられると思います。

また、まだ調査していませんが、Meta Quest 3で利用できるアプリではより高性能なObject Tracking機能を使用できるかもしれません。

引き続き、Unityでさまざまなことを試していきたいと思います。