まえがきと環境

この記事はUnity3DでMMDモデル(.pmx)を使用し、バーチャルユーチューバーになるためにいろいろと調整した記録です。できるだけわかりやすく書くよう尽力します。また、途中で書くことを放棄するかもしれないので、そのときは申し訳ないです。

では、環境は以下のとおりです

- Unity 2017.3.1f1 (同じである必要はありません)

- OpenCV for Unity $95

- Dlib FaceLandmark Detector $40

- CV VTuber Example FREE

- MMD4Mecanim (Beta) Open Source

- Web cam 1台

2番と3番は非常に高い有料アセットとなりますので、**「絶対にUnityでVTuberになる!」**という気力のない方(他に方法あります)、コーディングに自信がない方はここで諦めるのも手です。(私は1年間くらい買うか悩みました)

設定

上記と同じ環境を購入し、整えたら、まずはCV VTuber Exampleの中にあるユニティちゃんの例を動かせるように設定しましょう。

- OpenCV for Unity をAsset StoreからDL、インポートしましょう。

- Dlib FaceLandmark Detector(以下DFD)をAsset StoreからDL、インポートしましょう

- ツールバーの

Tools > OpenCV for Unity > Set Plugin Import Settingsを実行し、プラグインの設定を行ってください。

4. ツールバーの`Tools > DFD > Set Plugin Import Settings`を実行し、プラグインの設定を行ってください。

4. ツールバーの`Tools > DFD > Set Plugin Import Settings`を実行し、プラグインの設定を行ってください。

>このとき、OpenCVForUnityフォルダの中の、StreamingAssetsがまだOpenCVForUnityフォルダの中に会った場合、Asset直下に移動させましょう。(画像は設定が全て終わったあとの画像です)

>このとき、OpenCVForUnityフォルダの中の、StreamingAssetsがまだOpenCVForUnityフォルダの中に会った場合、Asset直下に移動させましょう。(画像は設定が全て終わったあとの画像です)

>( `Assets/OpenCVForUnity/StreamingAssets`を`Assets/StreamingAssets`に移動する)

>( `Assets/OpenCVForUnity/StreamingAssets`を`Assets/StreamingAssets`に移動する)

- DFDのReadMeに書かれている通り、

Assets/DFD/StreamingAssetsの中にあるファイル4つをAssets/StreamingAssetsの中に移します。 ファイルは下の通りです。- dance.avi

- haarcascade_frontalface_alt.xml

- sp_human_face_68.dat

- sp_human_face_68_for_mobile.dat

6. CV VTuber ExampleをAsset StoreからDL、インポートしましょう。(CV VTuber Exampleの中にあるReadMeでは真っ先にインポートするよう書かれていますが、私の環境では**スクリプトの参照エラーが起こり、治らなかった**のでこの順番でインポートしました)

7. Unityちゃんのモデルデータを公式サイトからダウンロードしましょう[(公式サイト)](http://unity-chan.com/contents/guideline/)

8. フォルダ内の`.unitypackage`を実行し、インポートしましょう。

9. `Assets/CVVTuberExample/CVVTuber/Addons/`にある`UnityChanCVVTuber.unitypackage`をダブルクリックしてインポートしてください。

10. `Assets/CVVTuberExample/CVVTuber/Addons/UnityChanCVVTuber/`にある、`UnityChanCVVTuberExample`というシーンを開いてください。

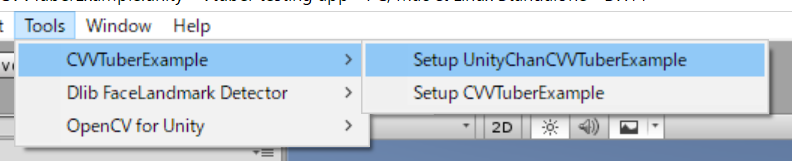

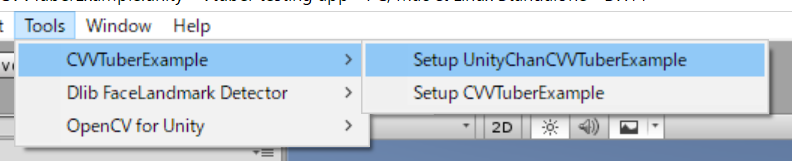

11. ツールバーから`Tools > CVVTuberExample > Setup UnityChanCVVTuberExample`を実行し、設定を行ってください。

> この時点で、ヒエラルキーウィンドウに`unitychan`というゲームオブジェクトがあるはずです。なかった場合は設定ミスになります…。

6. CV VTuber ExampleをAsset StoreからDL、インポートしましょう。(CV VTuber Exampleの中にあるReadMeでは真っ先にインポートするよう書かれていますが、私の環境では**スクリプトの参照エラーが起こり、治らなかった**のでこの順番でインポートしました)

7. Unityちゃんのモデルデータを公式サイトからダウンロードしましょう[(公式サイト)](http://unity-chan.com/contents/guideline/)

8. フォルダ内の`.unitypackage`を実行し、インポートしましょう。

9. `Assets/CVVTuberExample/CVVTuber/Addons/`にある`UnityChanCVVTuber.unitypackage`をダブルクリックしてインポートしてください。

10. `Assets/CVVTuberExample/CVVTuber/Addons/UnityChanCVVTuber/`にある、`UnityChanCVVTuberExample`というシーンを開いてください。

11. ツールバーから`Tools > CVVTuberExample > Setup UnityChanCVVTuberExample`を実行し、設定を行ってください。

> この時点で、ヒエラルキーウィンドウに`unitychan`というゲームオブジェクトがあるはずです。なかった場合は設定ミスになります…。

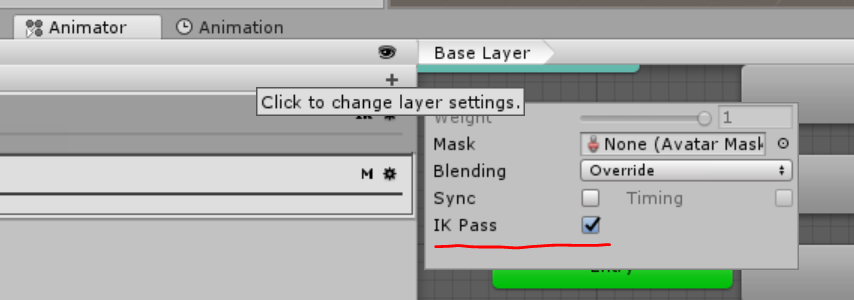

最後にunitychanのアニメーター設定にあるIK Passにチェックマークが入っていることを確認してください。

webcamを起動し、デバッグを開始してみてください。Unityちゃんが顔に合わせて動くはずです。(カメラが遠すぎたりすると、多少は狂ったようにガクガク動きます)

あとがき

Unityちゃんのライセンス表記:© Unity Technologies Japan/UCL

今回はUnityちゃんで動くように設定しましたが、次回はキズナアイちゃんのMMDデータを使用して、の設定編です。