はじめに

9/25にサポーターズさん主催のイベント「技育展」に参加しました.

今回は技育展のために作成したアプリケーションに関して解説していこうと思います.

作成したのは以下の動画のように3Dモデルと対話できるアプリケーションです.

(音声対話の動画をGIF化したため無音の動画です)

過去にもUnityとAgentCraftを利用した開発記事を書かれている方は多数いらっしゃいますが,2021年9月現在ではdocomoのデバイスSDKの利用方法がそれらの記事と変わっています.

今後も変化する可能性がありますが,それまではこの記事が他の方の助けになれば幸いです.

冗長な部分があるとは思いますが,お付き合いいただけましたら幸いです.

-----追記-----

Youtubeにてデモ動画を公開しています!

本記事をベースに改良したものですが,ぜひ見ていただけると完成品のイメージが固まるかと思います!

デモ動画リンク

環境

OS:macOS BigSur

Unity:2020.3.12f1 (対話エージェントの導入に使用するサンプルアプリケーションのUnityバージョンが3.12f1なので,このバージョンを使用することをお勧めします.)

VisualStudio: 2019 for Mac

使用したもの

対話エージェント:docomo AgentCraft

対話エージェント用SDK:docomo デバイスSDK

3Dモデル:Unity Technolosies Japan Unityちゃん

リップシンク用アセット:hecomi uLipSync

3Dモデルは口のシェイプキーが割り振られているものであれば,自作のモデルなどUnityちゃんでなくても使用できると思います!

作成手順

0.準備

本アプリの開発では,Unity向けのdocomoのエージェントのSDKのサンプルアプリを使用します.

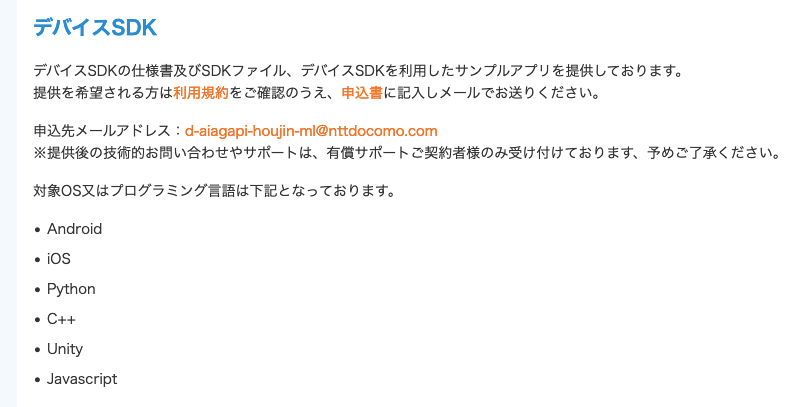

以下のページの「デバイスSDK」の項目に従い,事前にメールを送ってサンプルアプリの利用許可をもらいましょう.

申請が許可されるには1週間程度かかったので,事前に連絡をしておくとスムーズに開発できます.(技育展本番2日前まで申請通らなくて死にそうになった人←)

ドコモAIエージェントAPI インターフェース仕様書/開発ガイド

1.docomo AgentCraftでUnityちゃんの人格を作成する

それではまず,Unityちゃんの人格を作成しましょう.(字面)

こちらのリンクからAgentCraftにアクセスしていただき,アカウントを作成します.

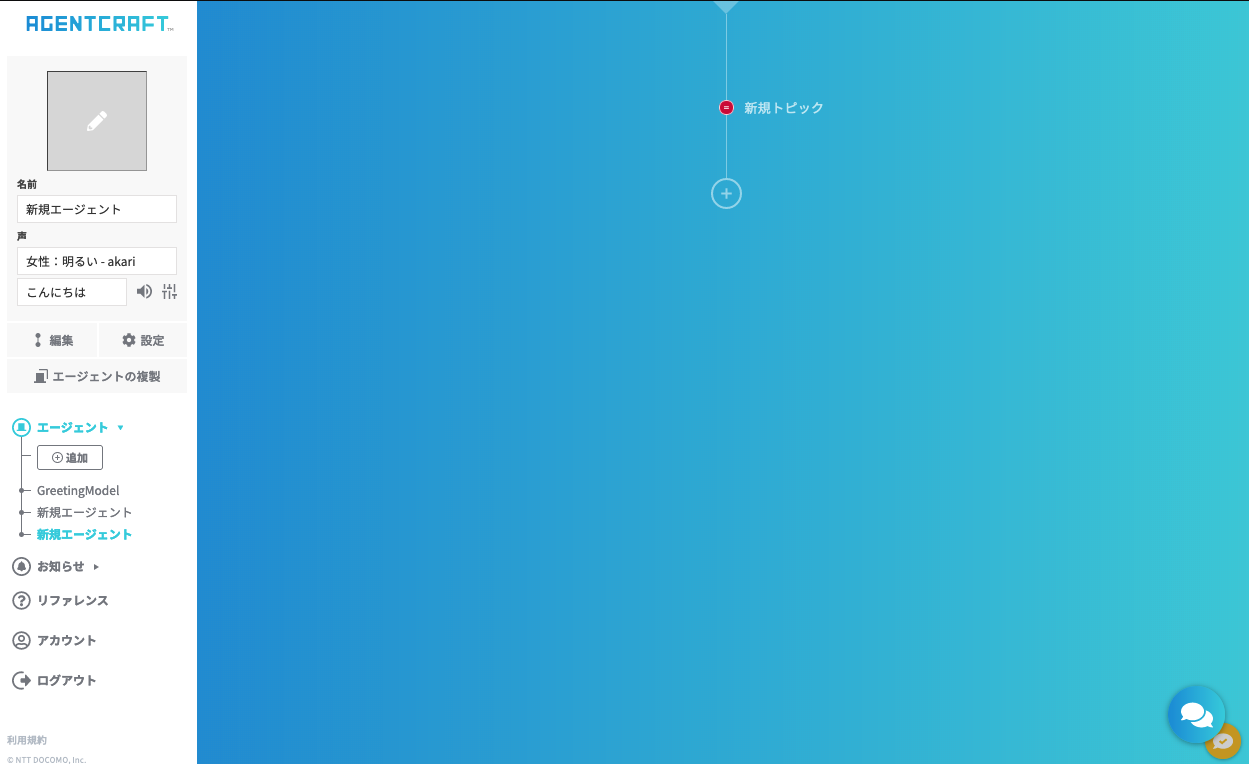

この画面がエージェントの作成画面になります.

AgentCraftのドキュメント「エージェントの作成と基本設定」を参考にUnityちゃんと交わしたいコミュニケーションをイメージしながら様々な応答を設定していきましょう.

2.UnityHubをインストール

まだUnityをインストールしていない場合は,まずUnityをインストールしていきましょう.

インストールできている方は「3.AgentCraftとUnityを連携させる」からスタートしてください.

Unity公式記事などがわかりやすく導入手順を記述してくださっています.

以下のリンクなどを参考にUnityHubをインストールをしてください.

Windows用

Mac用

iOSのビルドなどをする場合,VisualStudioまでインストールしておくと,ビルドの際にエラーを吐く確率が下がると思います...

↑私はエラーを吐かれて苦労しました()

3.AgentCraftとUnityを連携させる

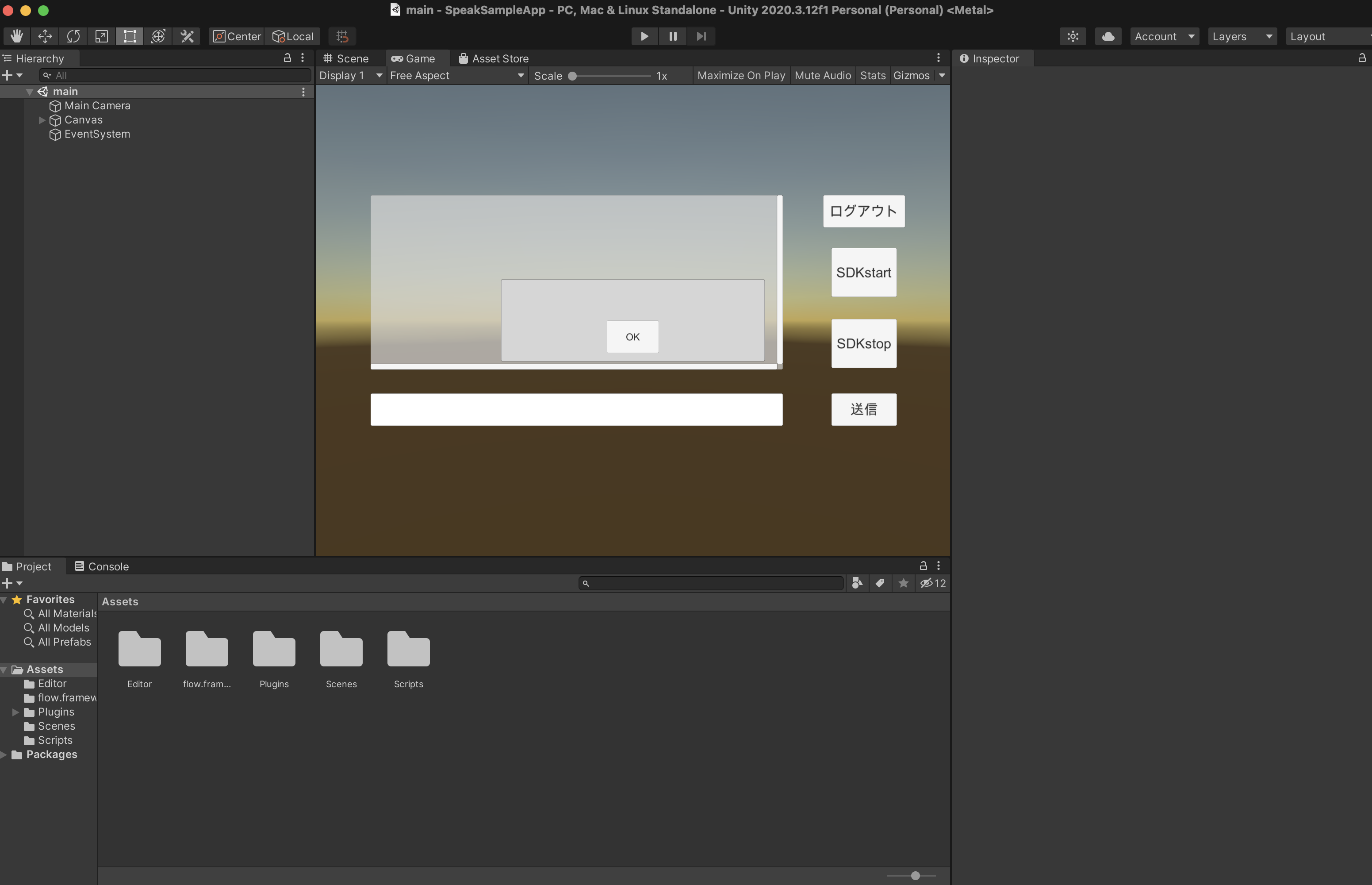

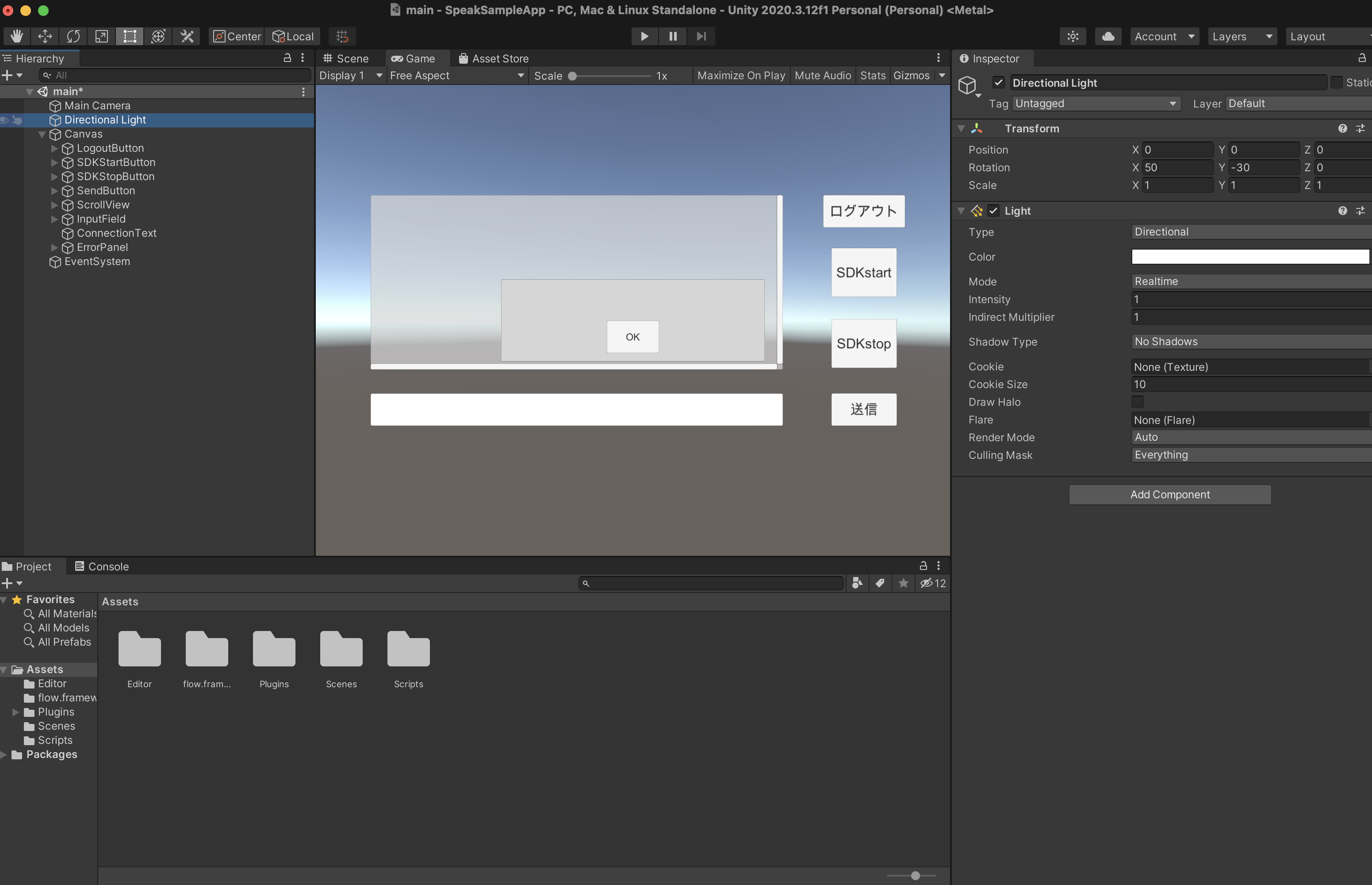

次にUnityでデバイスSDKのサンプルアプリを起動します.

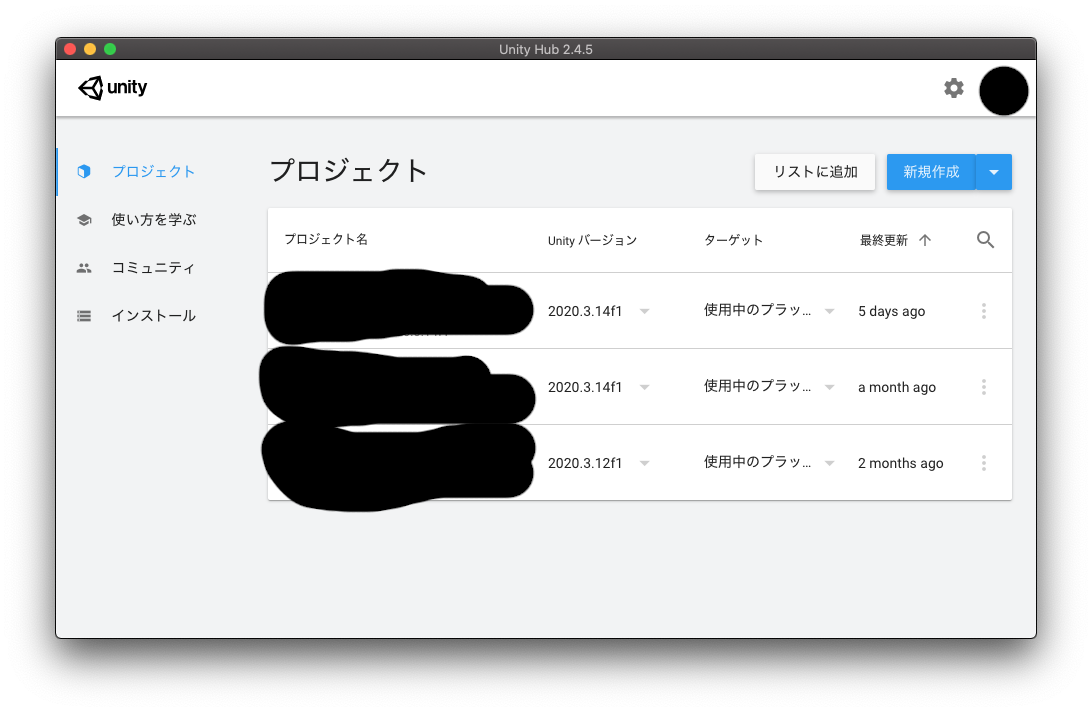

UnityHubを起動し,プロジェクト一覧の画面から「リストに追加」を選択します.

docomoさんから頂いたデバイスSDKを保存したフォルダまで移動し,「SpeakSampleApp」を開きましょう.

その後,SpeakSampleAppをダブルクリックし,プロジェクトを起動します.

プロジェクトの設定方法はデバイスSDKのフォルダ内に入っている「SpeakSDK_Unity_sampleapp」の「README.md」に記載されています.

デバイスSDKのページにある「エージェント作成チュートリアル ~UnitySDK編~」も参考になりますが,情報が古いため,基本的にはREADMEを参考にすることになると思います.

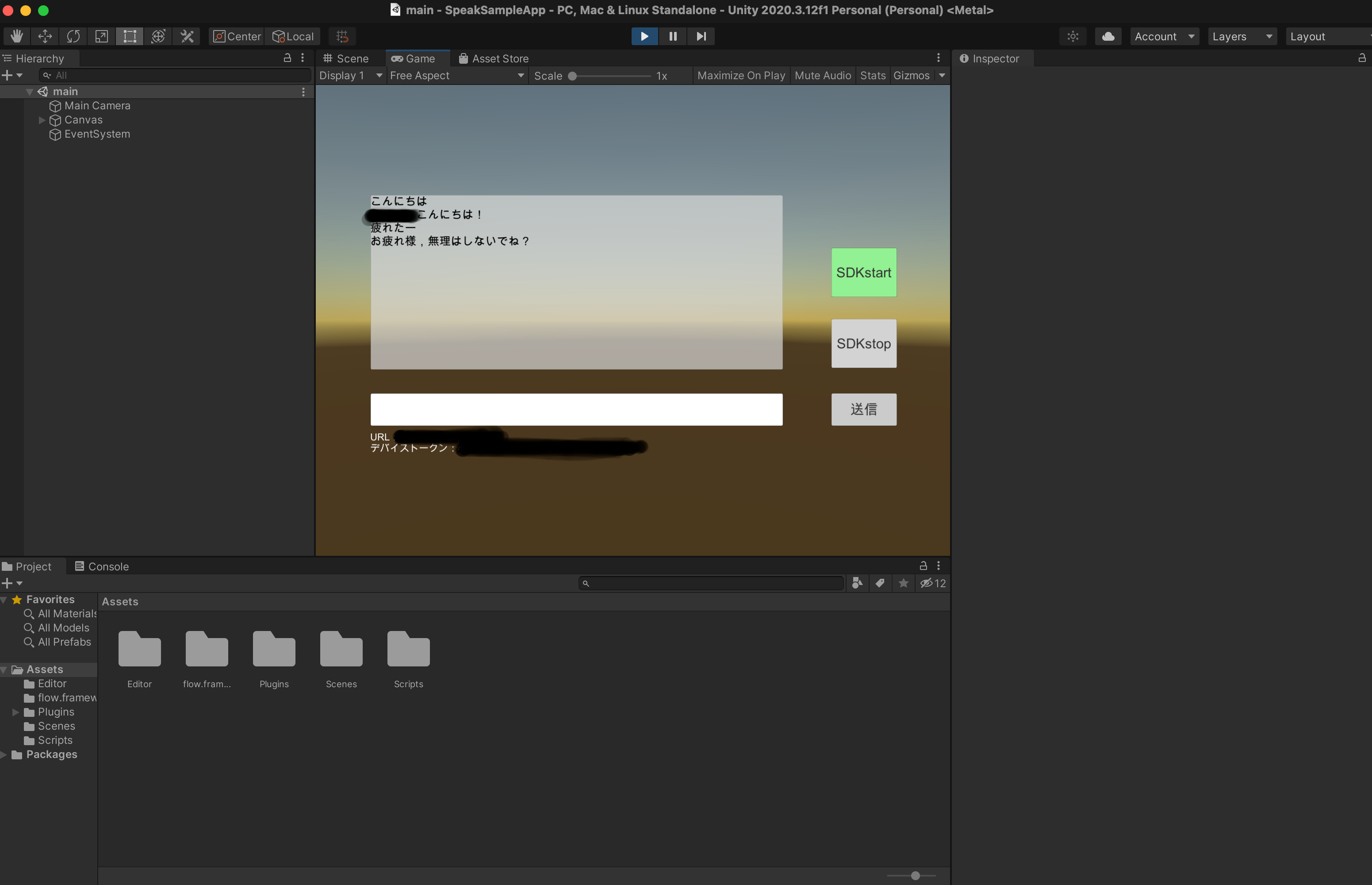

画面上部のPlay(再生ボタン)でプロジェクトを実行し,「SDKStart」ボタンを押すと,エージェントと対話ができるようになります.

設定した会話が機能するか確認してみましょう.

4.Unityちゃんを降臨させる

ここまででUnityに対話エージェントを連携させるための下準備は完了しました.

次に,Unityちゃんをお迎えしていきましょう.

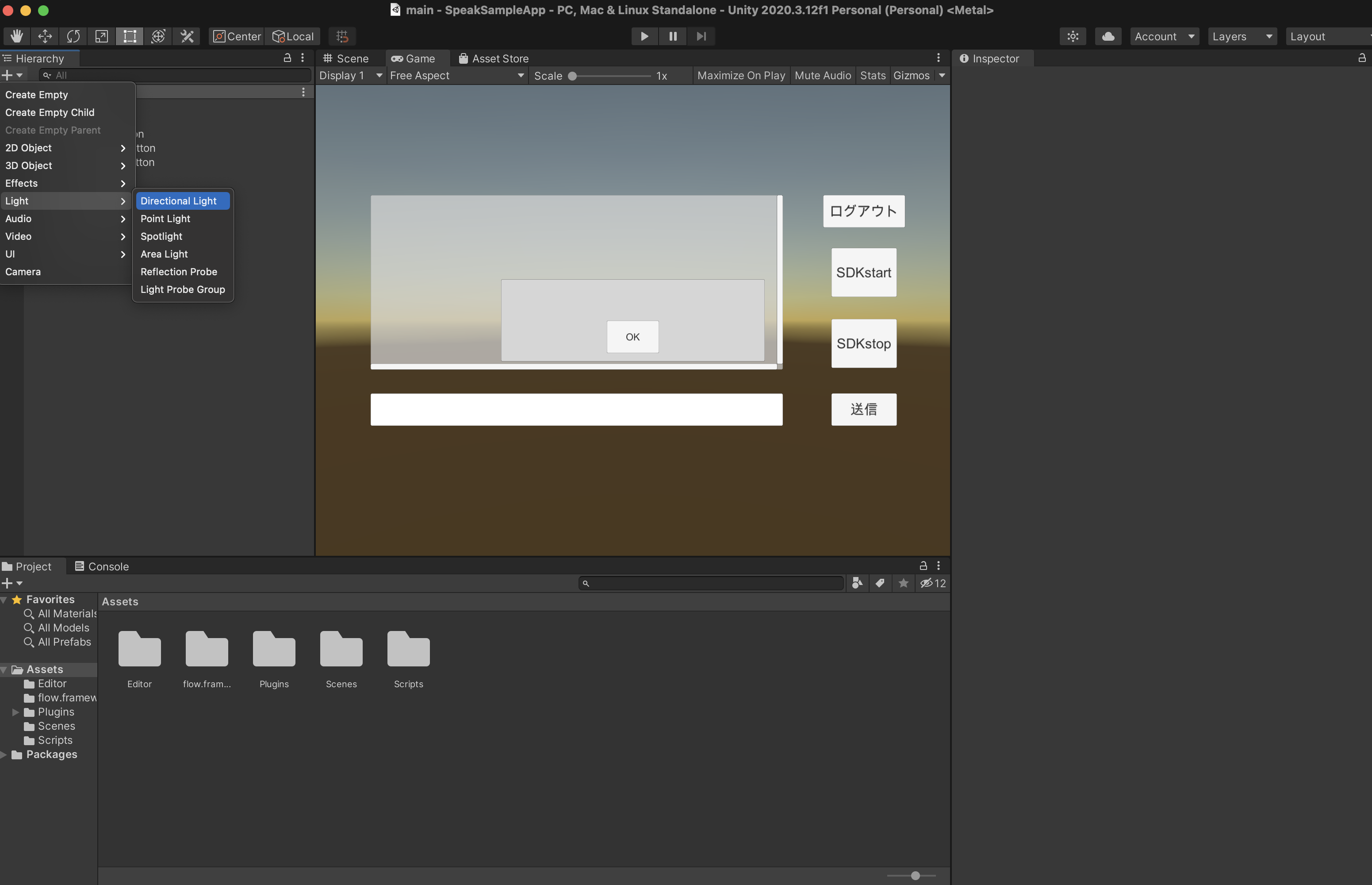

事前準備として,Hierarchyに「Directional Light」を作成しましょう.

作成すると,このように画面が明るくなると思います.(なんということでしょう)

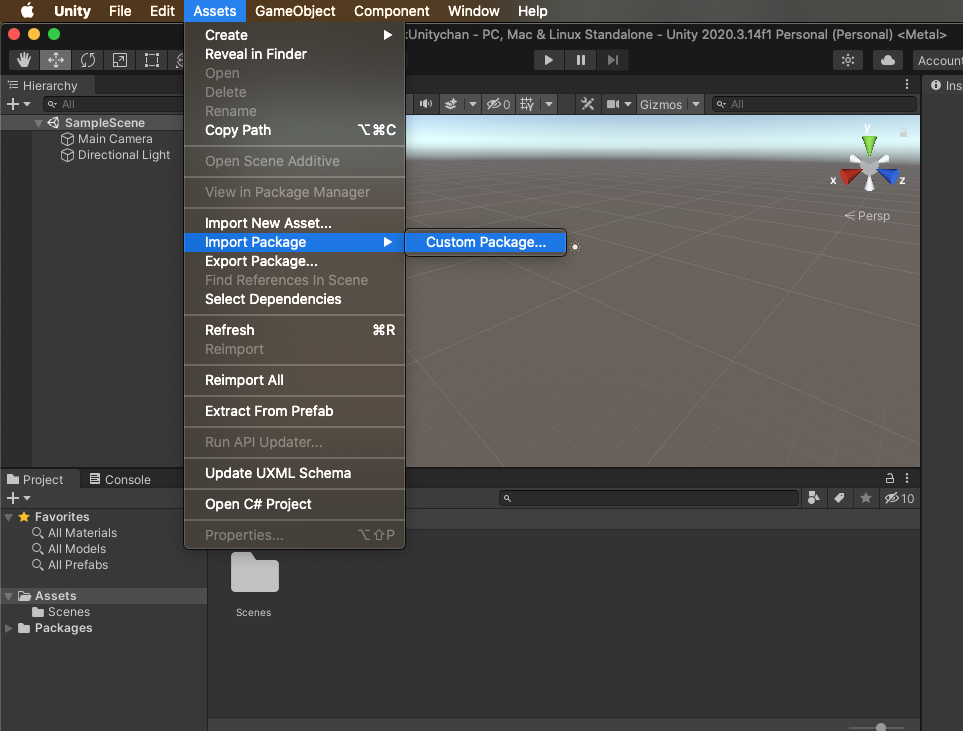

それでは,Unityちゃんをインポートしていきます.

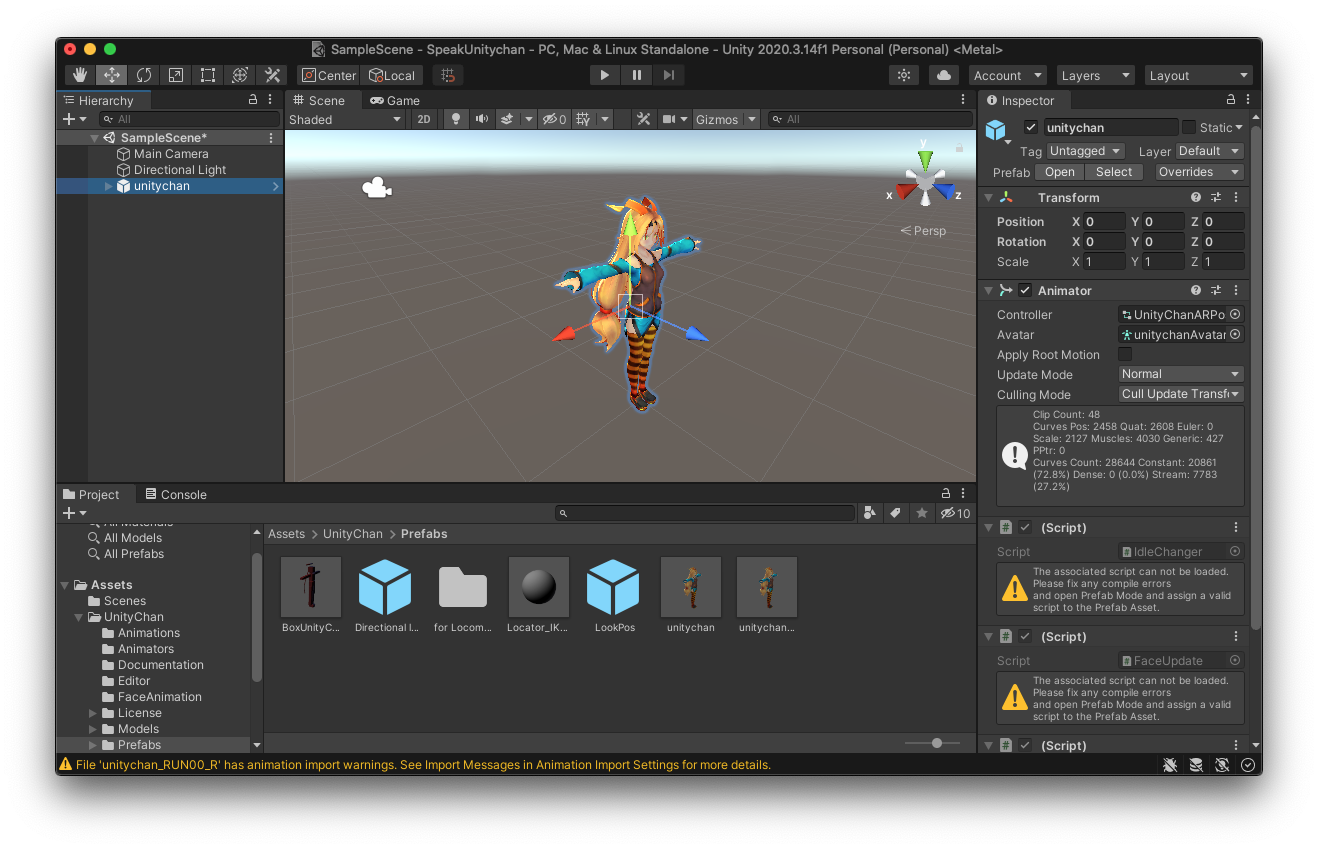

※このセクションで使用している画像は違うプロジェクトのものですが,操作自体は同じなのでご了承ください.

まずはUnityちゃんのパッケージをダウンロードします.

Unityちゃんダウンロードページ

Unityちゃんがダウンロードできたら,2.で作成したプロジェクトにインポートします.

UnityのAssetタブ>Import Package>Custum Packageを選択し,「UnityChan_1_2_1.unitypackage(執筆時の最新バージョン)」をインポートしてください.

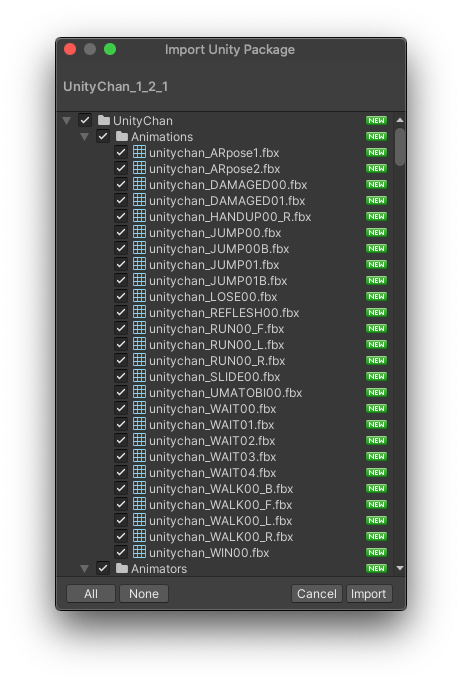

この画面が表示されたら,「Import」を押してパッケージ内容をインポートします.

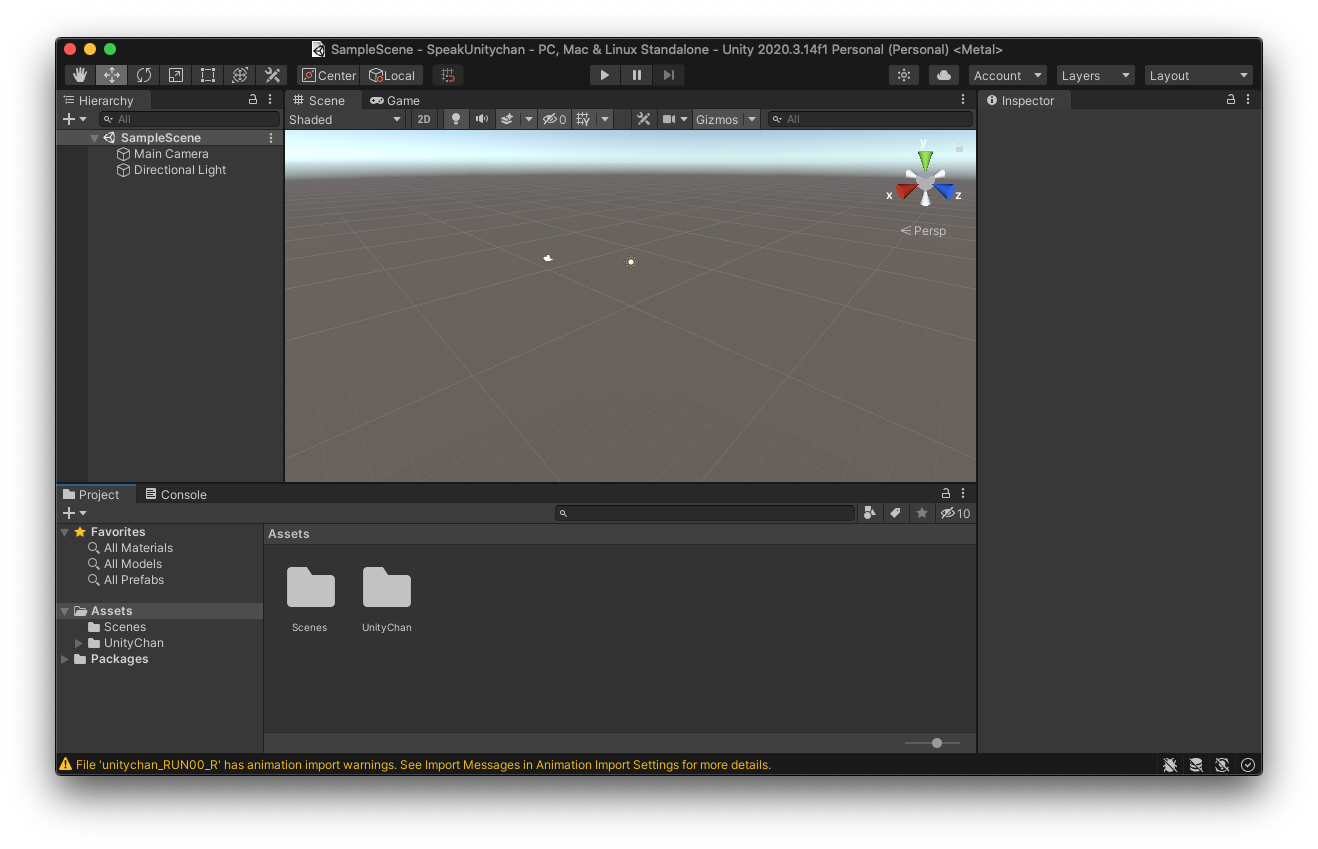

インポートが完了すると,おそらくAssetsの配下に「UnityChan」ディレクトリができていると思います.

Assets/UnityChan/Prefabs/までディレクトリを開くと,unityちゃんのPrefabがあるので,ドラッグ&ドロップなどでHierarchy上に配置してください.

5.uLipSyncを導入し,Unityちゃんがリップシンクできるようにする

無事にUnityちゃんが降臨されたので,次はUnityちゃんにしゃべる能力を獲得していただきましょう.

uLipSyncの製作者様の記事が非常に丁寧に解説してくださっているので,以下のリンクから確認していただければと思います.

凹みTips Unity でリアルタイムにリップシンクを行うプラグインを更に作り直してみた

ただ,上記記事に従って関連パッケージをインストールする際,Unity.Mathematicsのパッケージがリストに表示されないかもしれません.

その場合は,「Unity 2020.1 からパッケージマネージャで発見できなくなったパッケージのインストール方法」を参考にインストールしていただければと思います.

無事にUnityちゃんにuLipSyncの設定ができたら,いよいよ最後の作業です.

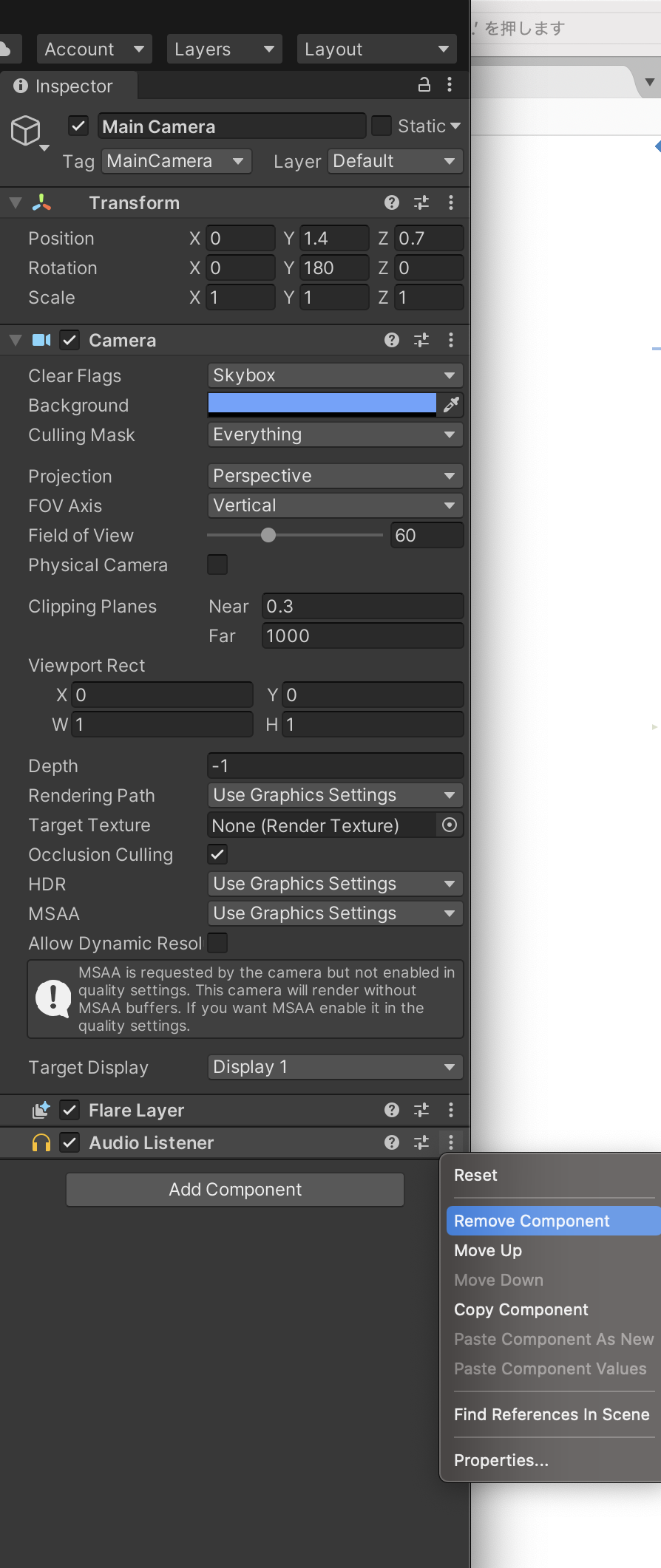

Hierarchyの「Main Camera」にアタッチされている「Audio Listener」を「Remove component」しましょう.「Audio Listener」の文字の右にある「・・・」をクリックすれば「Remove component」が見つかると思います.

その後,HierarchyのUnityちゃんのオブジェクトを選択し,「Add Component」から「Audio Listener」をアタッチしましょう.

※uLipSyncを使用した理由

現状OVRLipSyncの方が多く使用されていますが,設定が簡単であることと,更新日が新しいという理由から,今回はこちらのuLipSyncを使用しています.

6.完成!

以上でUnityちゃんと対話するための準備は整いました.

プロジェクトを実行し,Unityちゃんと対話してみましょう.

(音声対話の動画をGIF化したため無音の動画です)

終わりに

今回の開発で初めてまともにUnityを触りました.

Unityに不慣れなせいでわからないことが山のように出てきたり,SDKの利用申請が技育展の発表ギリギリまで通らなかったりと何度も死にそうになりましたが,こうして綺麗に動いてくれるものができて嬉しいです.

Unityちゃんが話し相手になってくれるようになったので,もうこれで一人暮らしも寂しくないね!やった!!(独身)

皆さんもぜひUnityちゃんとおしゃべりをしてみてください!

参考記事

他のオブジェクトについているスクリプトの変数を参照したり関数を実行したりする。

初心者向け UnityのGetComponentってなんやねん?

一日で俺の嫁を作る方法 ~一日で自分の好きな声・キャラ・見た目でおしゃべりしてくれるAIキャラクターを作ろう~

unityで音を鳴らす