Azure AI Foundry でプロンプトフローを使ってみました。以下の内容に準じています。

前提

以下の記事内容をセットアップしていることが前提です。

手順

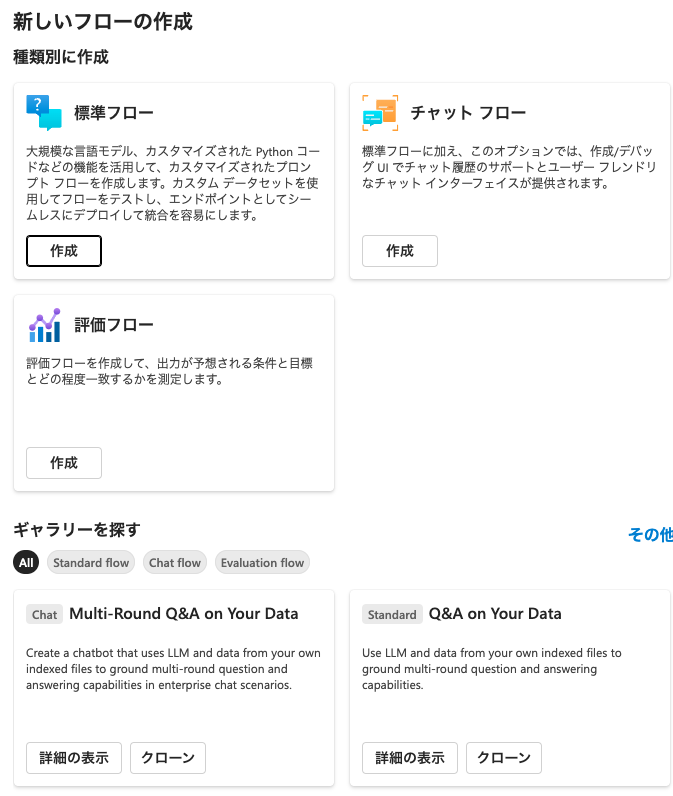

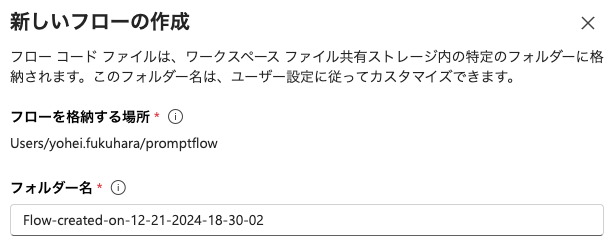

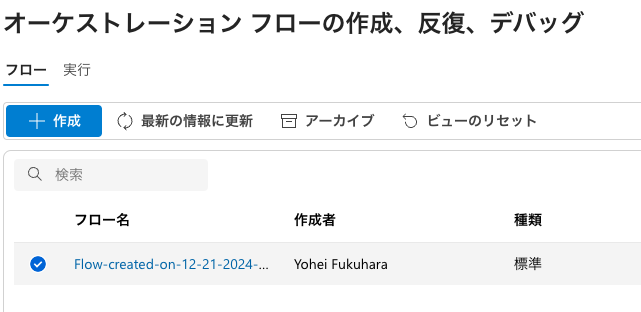

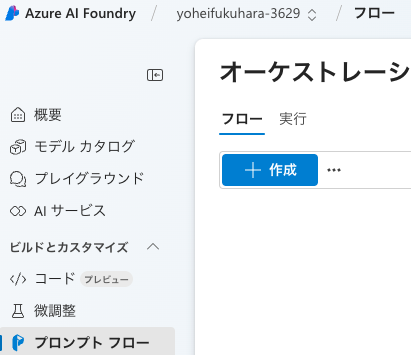

1. プロンプトフロー作成

Azure AI Foundry のプロジェクト画面でメニューから「プロンプト フロー」を選択し、「+作成」ボタンをクリック

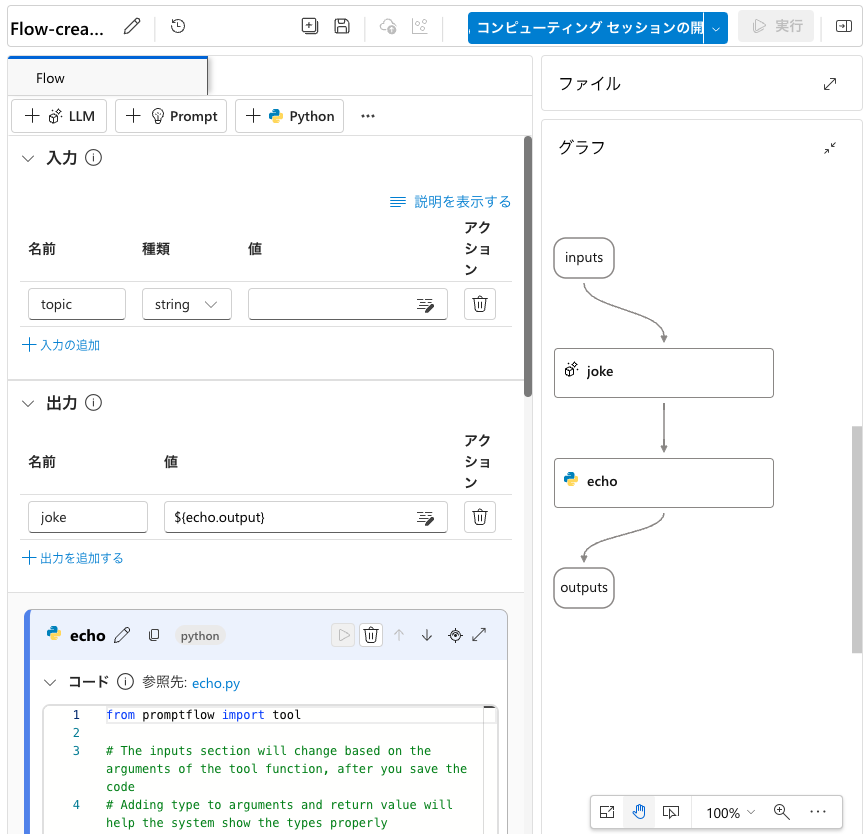

2. プロンプトフロー確認

今回は特にいじらずに中身を確認します。

画面右側に「グラフ」ブロックがあり、joke -> echoの順に実行されるのがわかります。

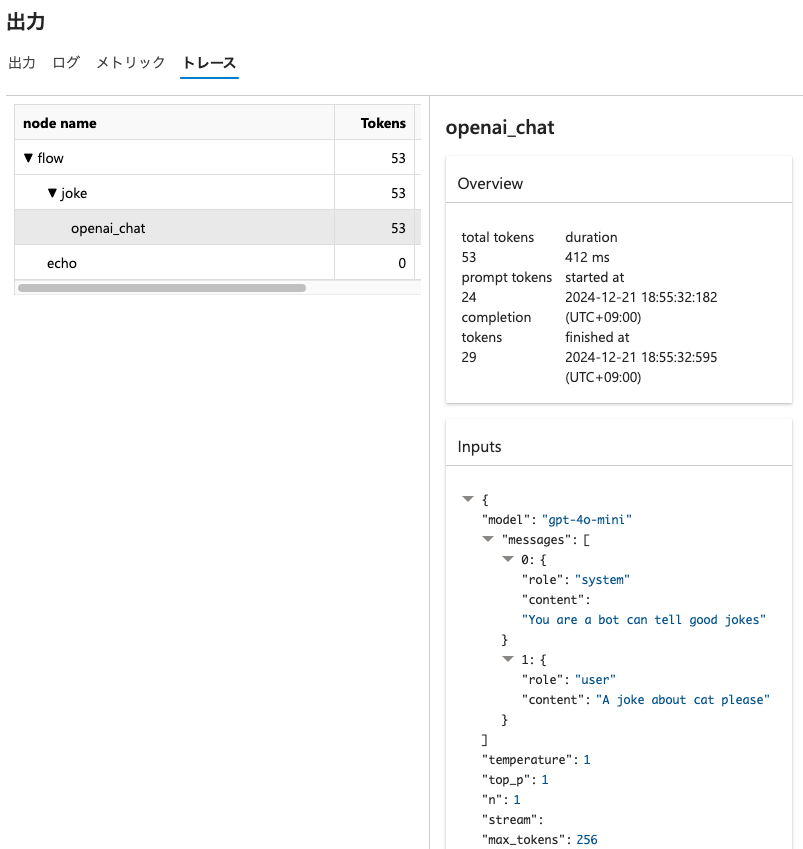

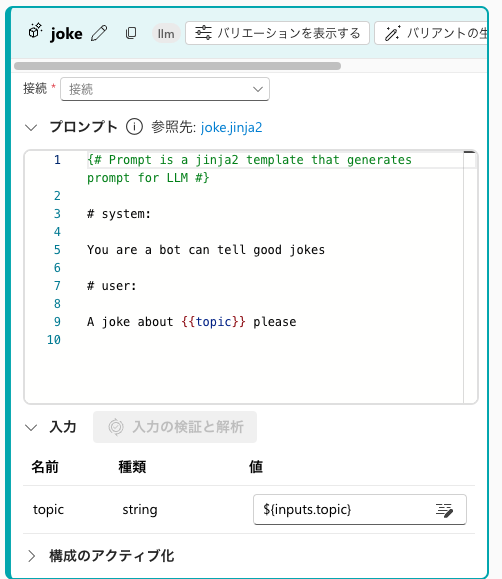

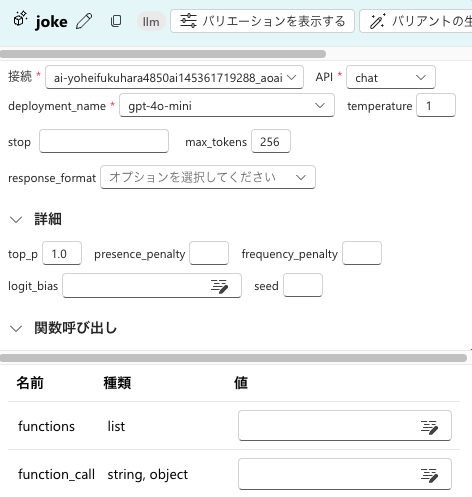

「joke」を選択すると左のブロックでjokeに遷移。どんなプロンプトが定義されているかがわかります。

後の実行に備えて「接続」にAI サービス、「deployment_name」にデプロイしたモデル名を選択します。

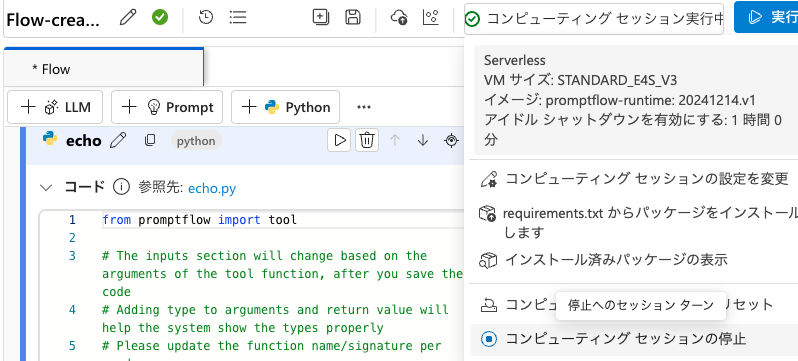

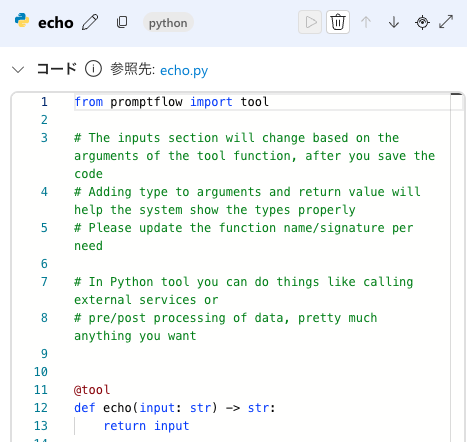

「echo」は単純にLLMの出力をそのままエコーしているだけです。

LangChainのLCELをツールで定義しているような内容でした。

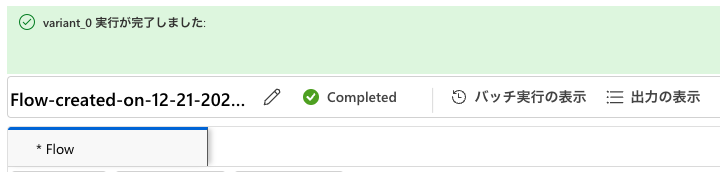

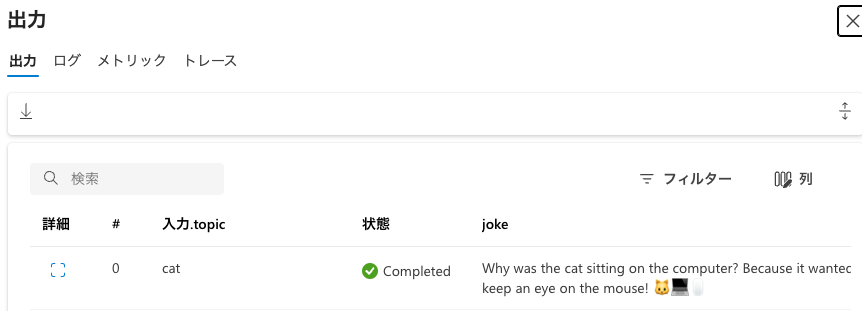

3. 実行

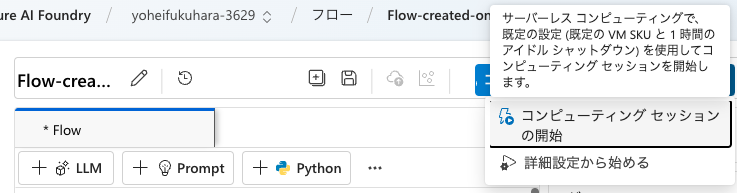

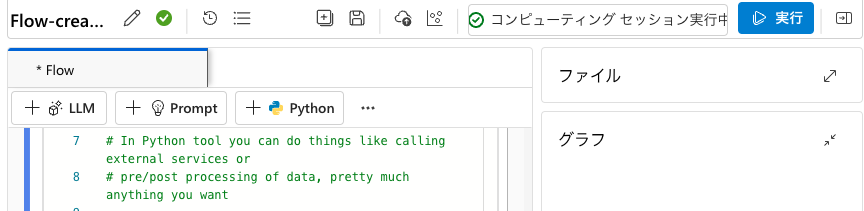

Python処理もあるので、裏ではサーバレスが動くらしく、最初に「コンピューティング セッションの開始」をクリック