Machine Learning by Stanford University WEEK6 のまとめ

学習アルゴリズムの評価

仮説関数の評価

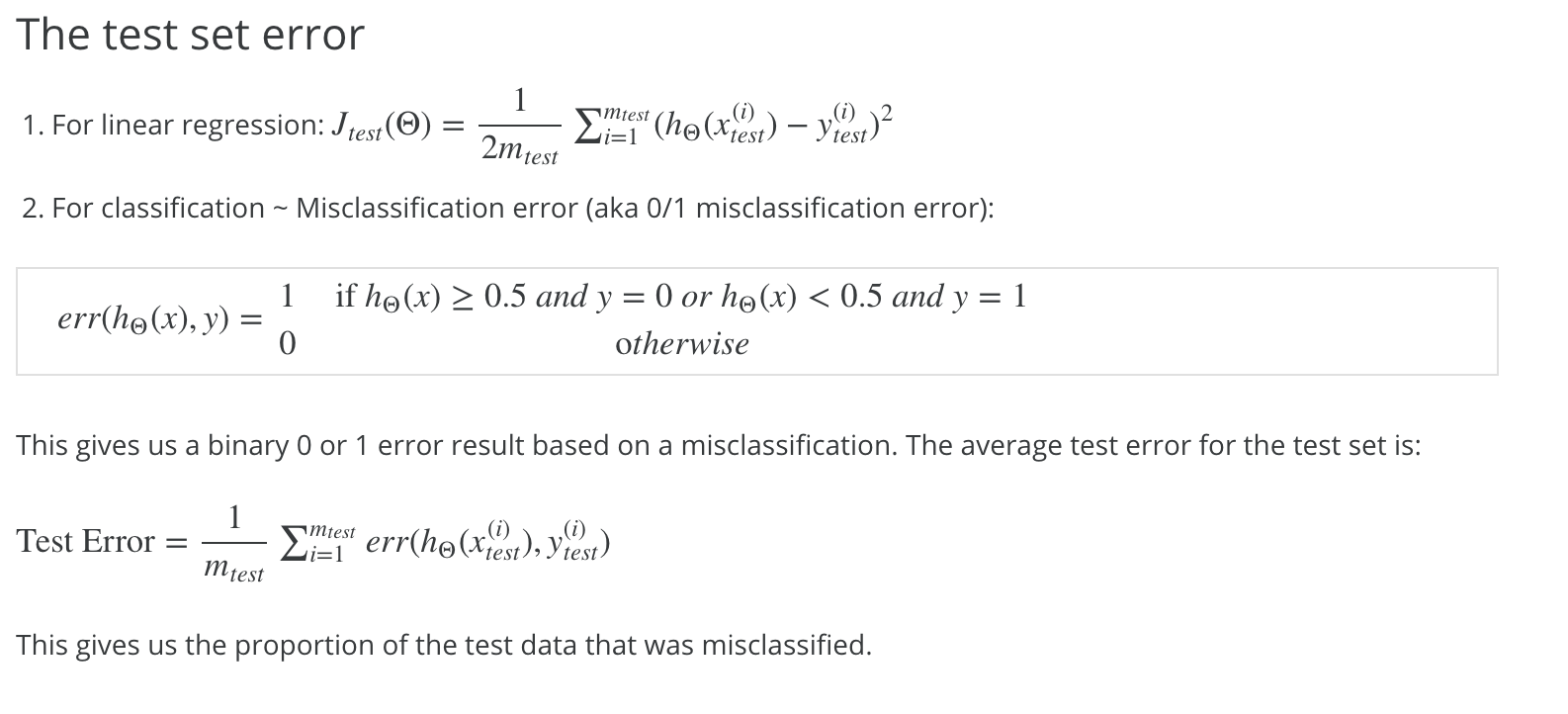

トレーニングデータの70%をトレーニングデータ、残り30%をテストデータとして、結果を評価する

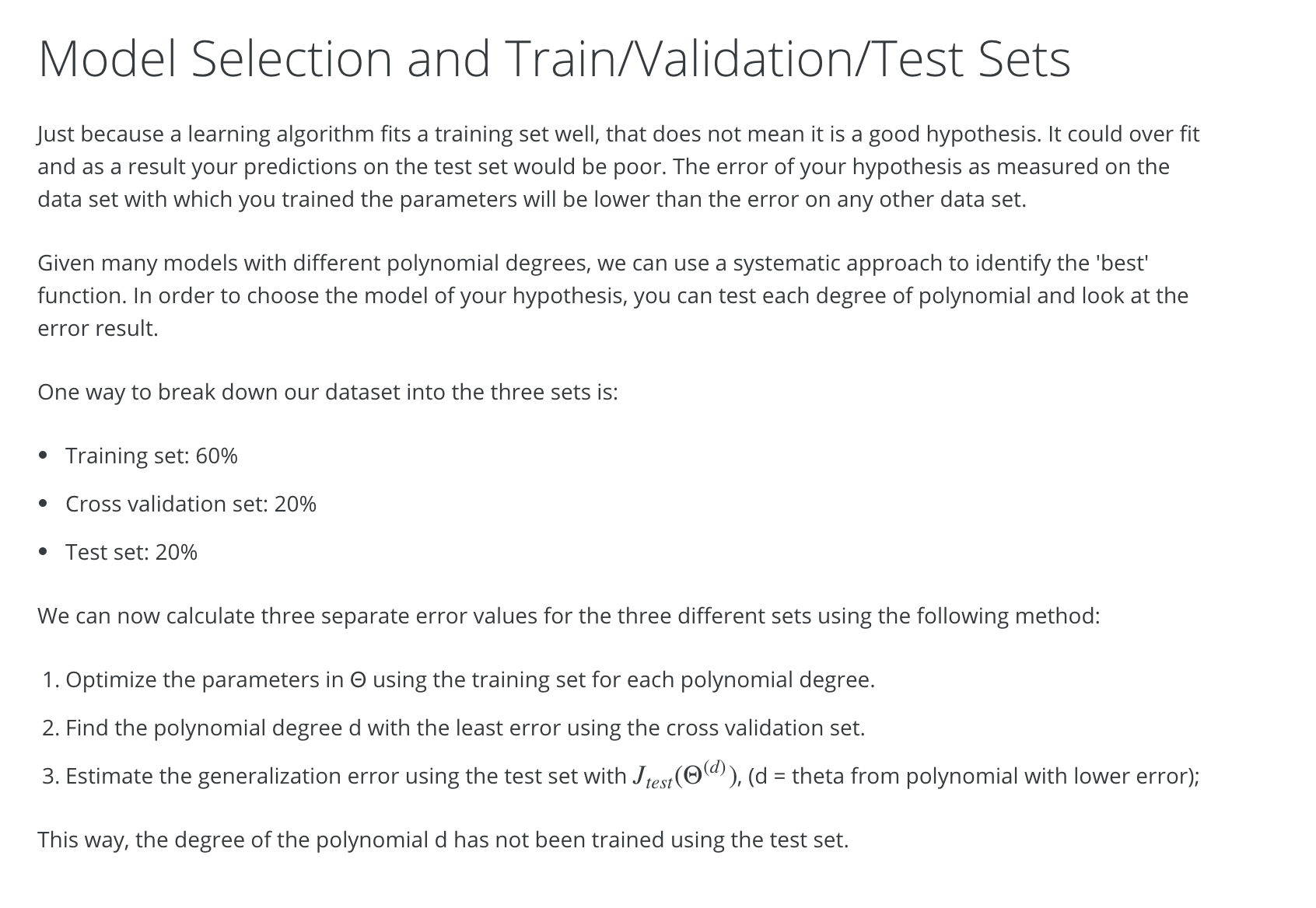

モデルの選択方法

バイアスと分散の問題

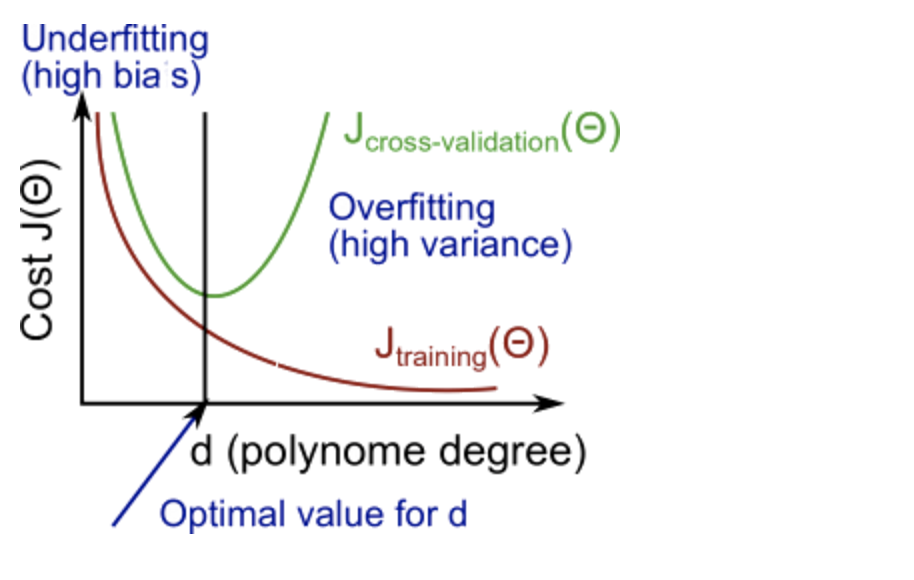

仮説関数の次数と高バイアス or 高分散

高バイアスの場合(仮説関数の次数が足りずにアンダーフィッティングが起こっている場合)は、Jcross-validation,Jtrainingの両方のコスト関数の値が大きい。

高分散(仮説関数の次数が大きすぎてオーバーフィッティングが起こっている場合は、Jcross-validationが大きく、Jtrainingは小さい。

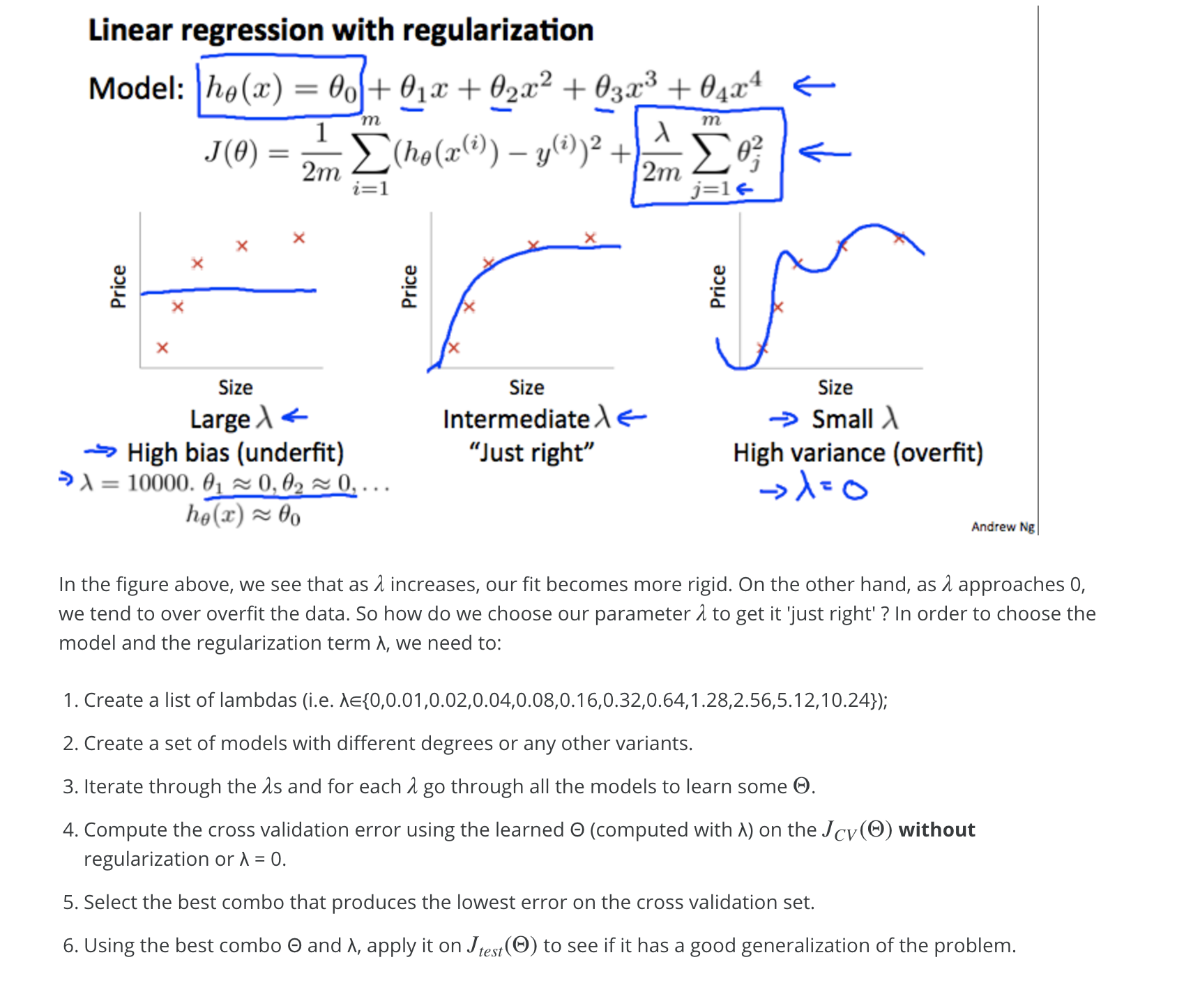

正規化の係数λと高バイアス or 高分散

λが大きい = 正規化項が大きい → アンダーフィットしやすい

λが小さい = 正規化項が小さい → オーバーフィットしやすい

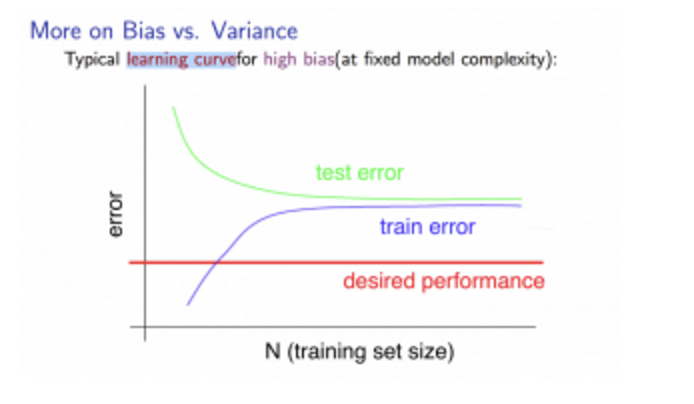

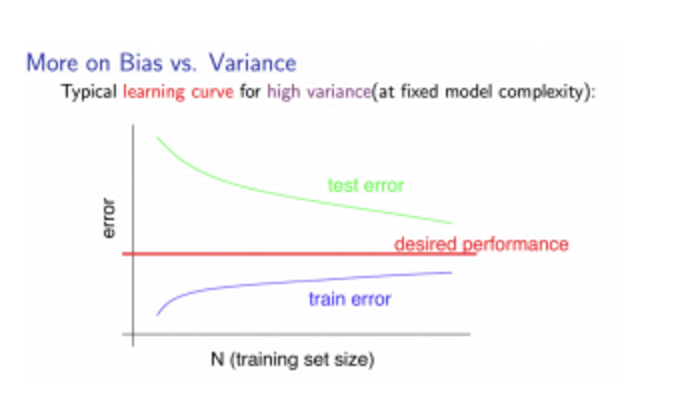

学習曲線

学習曲線をプロットすると以下のような事が分かる

高バイアス(次数が足りずにアンダーフィッティングが起きている)の場合の学習曲線は以下のような形。学習データを増やしても問題は解決しない。

高分散(次数が大きくオーバーフィッティングが起きている)の場合、学習曲線は以下のような形。この場合は学習データを増やす事に意味が有る。

学習アルゴリズムの向上の為に何をするべきか

学習アルゴリズムに問題があると分かった場合、考えられる施策は以下のようなものがあるが、この中でどの施策を取るべきか、どのように判断すべきか?

スパム分類の学習アルゴリズム構築

エラー分析

学習アルゴリズムの向上の為にどのような施策を行うべきか、判断する手法の一つがエラー分析。

エラーとなったデータを手動で見ていき、誤検知されているデータに法則性がないかを調べて、追加の変数設定等に生かす。