カメラについて基本的に理解している人の復習用。

世界座標系で表された3次元点を画像上にマップにする方法の理論部分。

OpenCVの説明

http://docs.opencv.org/3.0-beta/modules/calib3d/doc/camera_calibration_and_3d_reconstruction.html

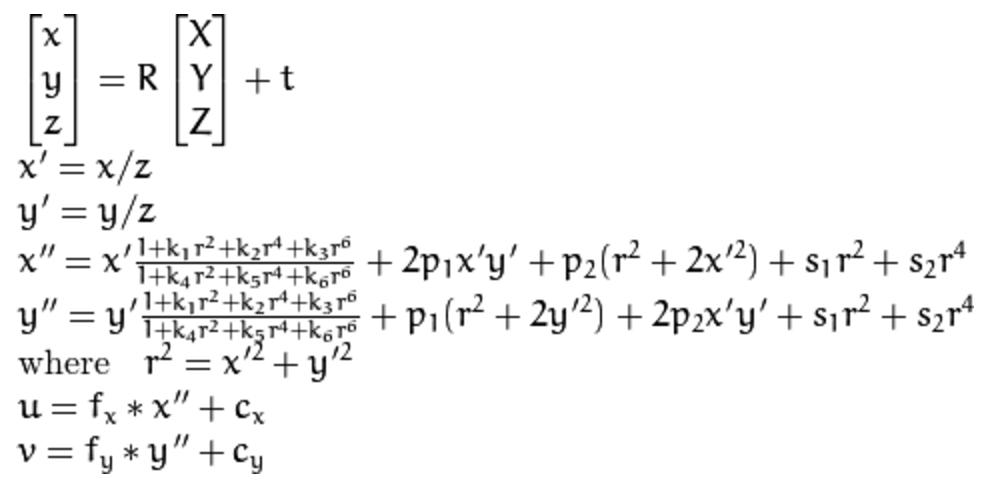

世界座標系で表された[Xw, Yw, Zw]は、カメラの外部パラメータによって[Xc, Yc, Zc]になる(カメラ座標系)。

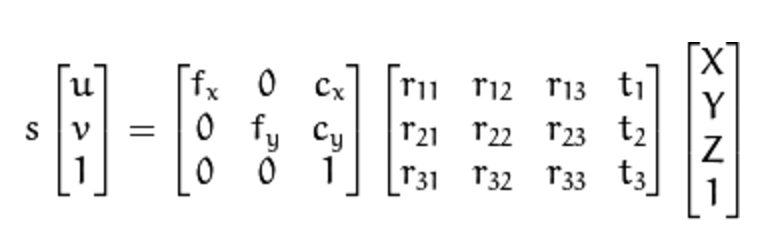

これが、カメラの内部パラメータによって、[u, v]になる。(下の式と記号は違います。)

ただ、この[u, v]は歪みを考慮していない。

つまり、ここまではundistortedなイメージの話。理想的なピンホールモデル。

実際はレンズを使っているので、この[u, v]の位置が歪む。

これが、カメラの外部パラメータ、内部パラメータ、歪み係数を使って、

世界座標系で表された3次元点を画像上にマップにする方法の理論部分。

undistortはこの歪みを取るだけなので、undistortしたとしてもCameraMatrixは変わらない。

(opencvなどのundistortで、newCameraMatrixに元のCameraMatrixを入れた場合)