記事の内容はこのページに書かれていることに、初めてIntelliJを触るのでもう少し詳しい説明があるといいなと思った部分を補完したものです。

Sparkのソースコードリーディング

SparkのコミュニティはIDEとしてIntelliJを勧めているので、今回はIntelliJで環境を整えてみます。

Sparkのコードのダウンロード

ダウンロードしたのはSpark 1.4.0-RC3です。

git clone -b branch-1.4 https://github.com/apache/spark.git

IntelliJのインストール

公式サイトからコミュニティ版をダウンロードします。

設定は全てデフォルトのままで大丈夫です。

Scalaプラグインのインストールは忘れずに。

念のためインストール後はsbtのプラグインを追加しました。

[File]->[Preferences]->[Plugins]->[Browse Repositories]からSBTのpluginをインストール

Sparkのプロジェクトの作成

- [File]->[New]->[Project from Existing Sources...]

- 先ほどgitでcloneしたディレクトリを指定

- [Import project from external model]でMavenを選択

4. Import Maven projects automaticallyにチェック

5. Import Projectはお好みで(今回はデフォルトに加えてyarn、hadoop-2.6、他いくつかにチェック)

これで作業は完了です。

あとはIntelliJがSparkのプロジェクトをビルドしてくれます。

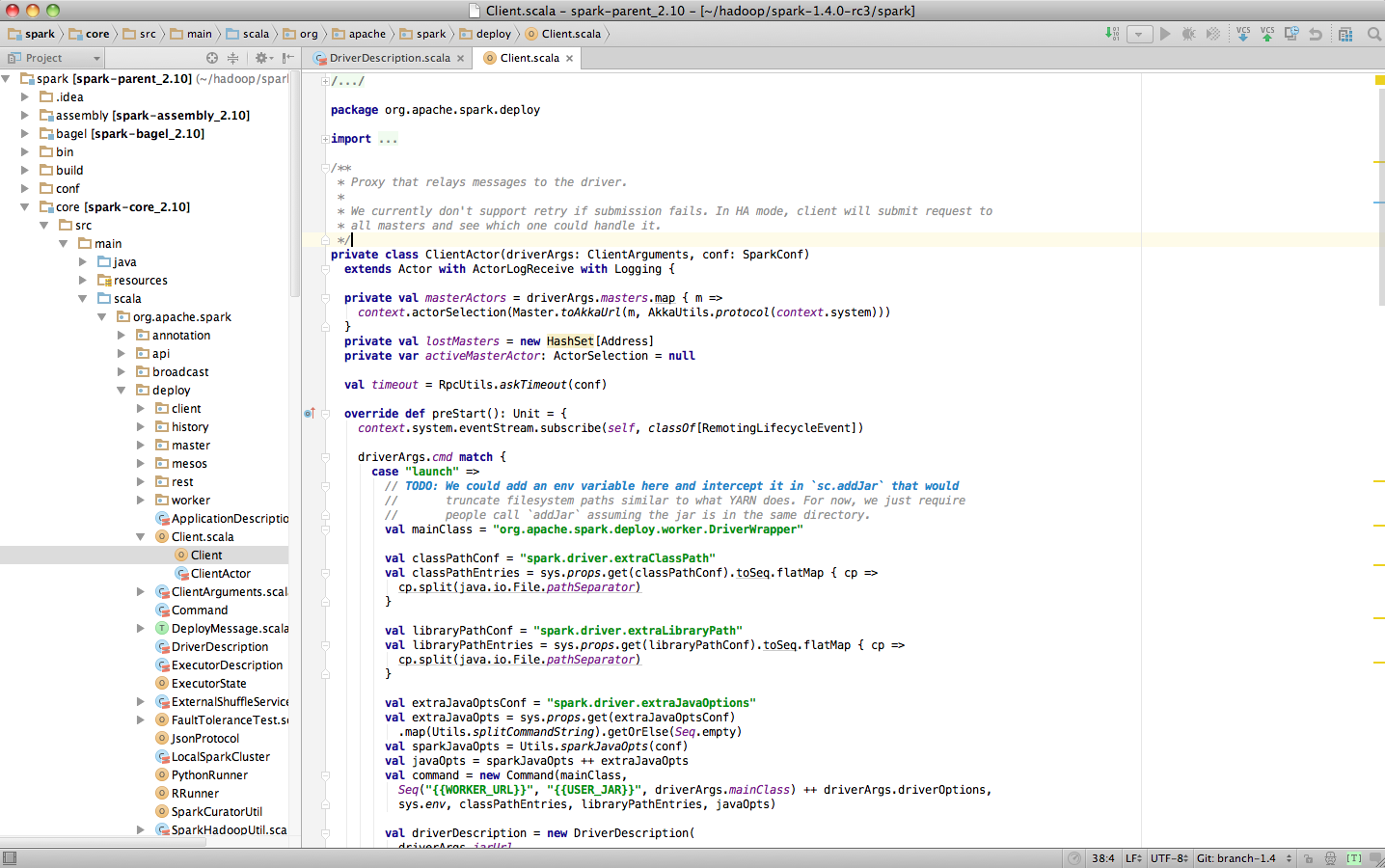

ビルドが完了するとこんな画面になるはずです。